logstash日志采集工具的安装部署

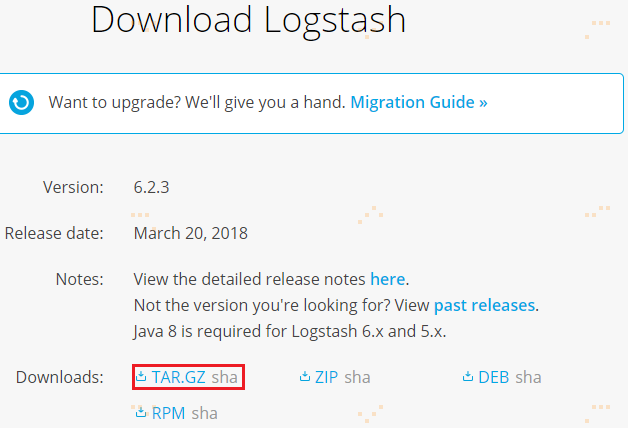

1.从官网下载安装包,并通过Xftp5上传到机器集群上

下载logstash-6.2.3.tar.gz版本,并通过Xftp5上传到hadoop机器集群的第一个节点node1上的/opt/uploads/目录:

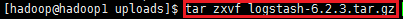

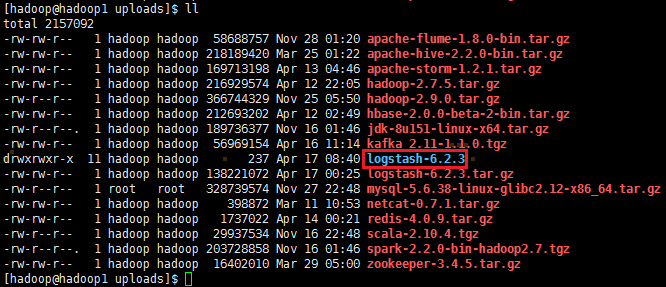

2、解压logstash-6.2.3.tar.gz,并把解压的安装包移动到/opt/app/目录上

tar zxvf logstash-6.2.3.tar.gz

mv logstash-6.2.3 /opt/app/ && cd /opt/app/

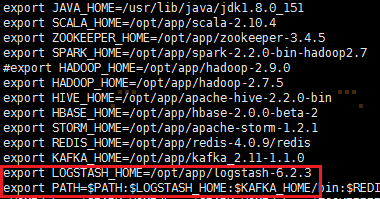

3、修改环境变量,编辑/etc/profile,并生效环境变量,输入如下命令:

sudo vi /etc/profile

添加如下内容:

export LOGSTASH_HOME=/opt/app/logstash-6.2.3

export PATH=:$PATH:$LOGSTASH_HOME/bin

使环境变量生效:source /etc/profile

4、配置文件类型

4.1 log-kafka配置文件

输入源为nginx的日志文件,输出源为kafka

input {

file {

path => "/var/logs/nginx/*.log"

discover_interval => 5

start_position => "beginning"

}

}

output {

kafka {

topic_id => "accesslog"

codec => plain {

format => "%{message}"

charset => "UTF-8"

}

bootstrap_servers => "hadoop1:9092,hadoop2:9092,hadoop3:9092"

}

}

4.2 file-kafka配置文件

输入源为txt文件,输出源为kafka

input {

file {

codec => plain {

charset => "GB2312"

}

path => "D:/GameLog/BaseDir/*/*.txt"

discover_interval => 30

start_position => "beginning"

}

}

output {

kafka {

topic_id => "gamelog"

codec => plain {

format => "%{message}"

charset => "GB2312"

}

bootstrap_servers => "hadoop1:9092,hadoop2:9092,hadoop3:9092"

}

}

4.3 log-elasticsearch配置文件

输入源为nginx的日志文件,输出源为elasticsearch

input {

file {

type => "flow"

path => "var/logs/nginx/*.log"

discover_interval => 5

start_position => "beginning"

}

}

output {

if [type] == "flow" {

elasticsearch {

index => "flow-%{+YYYY.MM.dd}"

hosts => ["hadoop1:9200", "hadoop2:9200", "hadoop3:9200"]

}

}

}

4.4 kafka-elasticsearch配置文件

输入源为kafka的accesslog和gamelog主题,并在中间分别针对accesslog和gamelog进行过滤,输出源为elasticsearch。当input里面有多个kafka输入源时,client_id => "es*"必须添加且需要不同,否则会报错javax.management.InstanceAlreadyExistsException: kafka.consumer:type=app-info,id=logstash-0。

input {

kafka {

type => "accesslog"

codec => "plain"

auto_offset_reset => "earliest"

client_id => "es1"

group_id => "es1"

topics => ["accesslog"]

bootstrap_servers => "hadoop1:9092,hadoop2:9092,hadoop3:9092"

}

kafka {

type => "gamelog"

codec => "plain"

auto_offset_reset => "earliest"

client_id => "es2"

group_id => "es2"

topics => ["gamelog"]

bootstrap_servers => "hadoop1:9092,hadoop2:9092,hadoop3:9092"

}

}

filter {

if [type] == "accesslog" {

json {

source => "message"

remove_field => ["message"]

target => "access"

}

}

if [type] == "gamelog" {

mutate {

split => { "message" => " " }

add_field => {

"event_type" => "%{message[3]}"

"current_map" => "%{message[4]}"

"current_x" => "%{message[5]}"

"current_y" => "%{message[6]}"

"user" => "%{message[7]}"

"item" => "%{message[8]}"

"item_id" => "%{message[9]}"

"current_time" => "%{message[12]}"

}

remove_field => ["message"]

}

}

}

output {

if [type] == "accesslog" {

elasticsearch {

index => "accesslog"

codec => "json"

hosts => ["hadoop1:9200","hadoop2:9200","hadoop3:9200"]

}

}

if [type] == "gamelog" {

elasticsearch {

index => "gamelog"

codec => plain {

charset => "UTF-16BE"

}

hosts => ["hadoop1:9200","hadoop2:9200","hadoop3:9200"]

}

}

}

注:UTF-16BE为解决中文乱码,而不是UTF-8

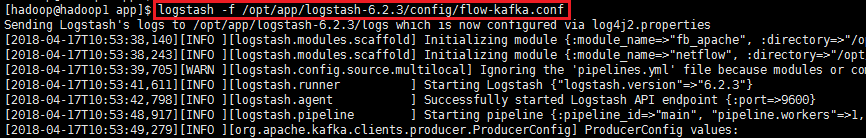

5、logstash启动

logstash -f /opt/app/logstash-6.2.3/conf/flow-kafka.conf

6、logstash遇到的问题

1) 在使用logstash采集日志时,如果我们采用file为input类型,采用不能反复对一份文件进行测试!第一次会成功,之后就会失败!

参考资料:

https://blog.csdn.net/lvyuan1234/article/details/78653324

logstash日志采集工具的安装部署的更多相关文章

- 日志采集客户端 filebeat 安装部署

linux----------------1. 下载wget https://artifacts.elastic.co/downloads/beats/filebeat/filebeat-5.5.1- ...

- filebeat + logstash 日志采集链路配置

1. 概述 一个完整的采集链路的流程如下: 所以要进行采集链路的部署需要以下几个步聚: nginx的配置 filebeat部署 logstash部署 kafka部署 kudu部署 下面将详细说明各个部 ...

- Hadoop生态圈-flume日志收集工具完全分布式部署

Hadoop生态圈-flume日志收集工具完全分布式部署 作者:尹正杰 版权声明:原创作品,谢绝转载!否则将追究法律责任. 目前为止,Hadoop的一个主流应用就是对于大规模web日志的分析和处理 ...

- docker可视化集中管理工具shipyard安装部署

docker可视化集中管理工具shipyard安装部署 Shipyard是在Docker Swarm实现对容器.镜像.docker集群.仓库.节点进行管理的web系统. 1.Shipyard功能 Sh ...

- 大数据应用日志采集之Scribe 安装配置指南

大数据应用日志采集之Scribe 安装配置指南 大数据应用日志采集之Scribe 安装配置指南 1.概述 Scribe是Facebook开源的日志收集系统,在Facebook内部已经得到大量的应用.它 ...

- flume 日志采集工具

Flume是Cloudera提供的一个高可用的,高可靠的,分布式的海量日志采集.聚合和传输的系统,Flume支持在日志系统中定制各类数据发送方,用于收集数据:同时,Flume提供对数据进行简单处理,并 ...

- 运维工具Ansible安装部署

http://blog.51cto.com/liqingbiao/1875921 centos7安装部署ansible https://www.cnblogs.com/bky185392793/p/7 ...

- 日志采集工具Flume的安装与使用方法

安装Flume,参考厦门大学林子雨教程:http://dblab.xmu.edu.cn/blog/1102/ 并完成案例1 1.案例1:Avro source Avro可以发送一个给定的文件给Flum ...

- Filebeat轻量级日志采集工具

Beats 平台集合了多种单一用途数据采集器.这些采集器安装后可用作轻量型代理,从成百上千或成千上万台机器向 Logstash 或 Elasticsearch 发送数据. 一.架构图 此次试验基于前几 ...

随机推荐

- linux 开放80端口

必须确保两块都开放 1.云服务器-->安全组开放 比如百度云服务器: 2.linux内置防火墙开放 注意:此处如果不设置开放,即时云端开放了也没用,如果同时存在 80 (拒绝) 80(允许) ...

- 【题解】 bzoj3555: [Ctsc2014]企鹅QQ (字符串Hash)

题面戳我 Solution 我们分析题意,他要求的是两个字符串只有一个字符不同,然后我们再看长度\(L \leq 200\),显然我们就可以把每一位删除后\(Hash\),然后判断相同个数即可 我一开 ...

- Hdoj 4540.威威猫系列故事——打地鼠 题解

Problem Description 威威猫最近不务正业,每天沉迷于游戏"打地鼠". 每当朋友们劝他别太着迷游戏,应该好好工作的时候,他总是说,我是威威猫,猫打老鼠就是我的工作! ...

- IT人员必须掌握的10项软技能

现代企业的IT部门员工在具备技术能力的同时,还需要掌握一些软技能.现在来看这些软技能其实并不是什么新鲜事物,只是IT人员所需的这些软技能的范围与数量正在不断增加着. IT人员需要具备哪些技术能力,要取 ...

- C语言学习记录之二

各种语句及编程笔记记录 1.if & else #include<stdio.h> int main(){ int if (situation) { //m ...

- linux/mac下一键删除下载失败的maven jar包

echo 正在搜索... find . -name "*lastUpdated" | xargs rm -fr echo 搜索完毕

- ubuntu 15 安装docker

最近听说Docker很火,不知道什么东西,只知道是一个容器,可以跨平台.闲来无事,我也来倒弄倒弄.本文主要介绍:Ubuntu下的安装,以及基本的入门命令介绍:我的机器是Ubuntu 15.04 64位 ...

- 洛谷P2414 阿狸的打字机

题意:以trie的形式给出n个字符串,每次询问第x个字符串在第y个字符串中出现了几次. 解:总串长是n2级别的,所以不能用什么后缀自动机... [update]可以建triesam但是不知道trie上 ...

- P1972 HHのnecklace 离线+树状数组

此题莫队可过 然而太难了...... 我在胡雨菲那看的解法,然后自己打了一波,调了一个错,上交,自信AC. 做法:离线,对于L排序. 每种颜色可能出现很多次,那么我们如何不算重复呢? 只需把[L,n] ...

- pandas 读取excel文件对数据简单清洗并用matplotlib 将数据展示

首先我们看下数据 接下来数据分析操作 import numpy as np import pandas as pd from matplotlib import pyplot as plt if __ ...