开始学习tensorflow

搭建神经网络:

- 准备数据

- 定义数据输入层

- 定义网络隐藏层和预测层

- 定义loss 表达式

- 选择optimizer使得loss 最小

import tensorflow as tf

import numpy as np # 定义一个添加层的函数为网络构建做准备

# 默认情况下没有激活函数,input 是神经元输入, in_size 输入神经元的个数,out_size输出的个数。

def add_layer(inputs, in_size,out_size,activation_function=None):

weights=tf.Variable(tf.random_normal([in_size,out_size]))

# 定义权重是变量,在tensorflow中定义是一个变量才是变量

biase=tf.Variable(tf.zeros([1,out_size])+0.1)

# 矩阵乘法

w_plus_b=tf.matmul(inputs,weights)+biase

# 定义运算

if activation_function is None:

outputs=w_plus_b

else:

outputs=activation_function(w_plus_b)

return outputs #1. 准备训练数据

x_data=np.linspace(-1,1,300)[:,np.newaxis]

# linspace 类似matlab 中的[-1:1:300],生成一个数组从-1 到300 每次加1,

# np.newaxis 等价于None,np.linspace 生成的是一个行向量,使用newaxis 增加一个维度大小为1 的新维度。x=[1,2,3],x.shape=3.,x[:,newaxis].shape=(3,1)在3后加一维

noise=np.random.normal(0,0.05,x_data.shape)

# 获得一个正态分布的值,和x_data大小相同, mu=0,v=0.05

y_data=np.square(x_data)-0.5+noise #2. 定义节点接受数据

# 要给节点输入数据时,要用placeholder 占位符,类似于函数的参数描述待输入的节点,在运行时传入,和feed_dict是绑定使用的。

xs=tf.placeholder(tf.float32,[None,1])

ys=tf.placeholder(tf.float32,[None,1]) #3.定义网络结构

l1=add_layer(xs,1,10,activation_function=tf.nn.relu)

prediction=add_layer(l1,10,1,activation_function=None) #4.定义loss

# reduce_sum 是求和,求和的对象时tensor,沿着tensor的某些维度求和。 本质是降维,reduce_sum 以求和的手段降维, reduce_mean 以求平均手段降维。 这种操作都有reduce_indices, 默认值为None,将tensor 降到0维 loss=tf.reduce_mean(tf.reduce_sum(tf.square(ys-prediction),reduction_indices=[1])) #5.选择optimizer

# 使用梯度下降的方法,学习率为0.1,最小化loss

train_step=tf.train.GradientDescentOptimizer(0.1).minimize(loss) #

# 初始化参数, 如果有变量一定要给变量初始化

init=tf.initialize_all_variables()

# 定义一个Session对象, 在session 中执行

sess=tf.Session()

sess.run(init) # 迭代1000次,在sess中run optimizer

for i in range(1000):

# train_step 中loss 是由 placeholder 定义的运算,要用feed 传入参数

sess.run(train_step,feed_dict={xs:x_data,ys:y_data})

if i%50==0:

print(sess.run(loss,feed_dict={xs:x_data,ys:y_data}))

reduce_sum:

在tensorflow 1.0 中,reduction_indices 改为axis,

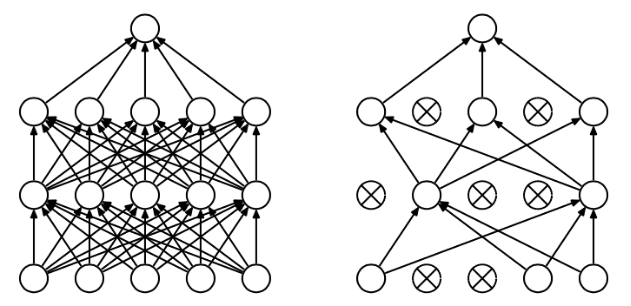

dropout 是训练过程中,按照一定概率将一部分神经单元暂时从网络中丢弃。

在tensorflow 中实现就是在add layer 函数中加上dropout,keep_prob保存多少不被drop

Wx_plus_b = tf.nn.dropout(Wx_plus_b, keep_prob)使用tensorboard: 要用with tf.name_scope 定义各个框架,

开始学习tensorflow的更多相关文章

- 学习TensorFlow,打印输出tensor的值

在学习TensorFlow的过程中,我们需要知道某个tensor的值是什么,这个很重要,尤其是在debug的时候.也许你会说,这个很容易啊,直接print就可以了.其实不然,print只能打印输出sh ...

- 学习TensorFlow,浅析MNIST的python代码

在github上,tensorflow的star是22798,caffe是10006,torch是4500,theano是3661.作为小码农的我,最近一直在学习tensorflow,主要使用pyth ...

- 学习TensorFlow,线性回归模型

学习TensorFlow,在MNIST数据集上建立softmax回归模型并测试 一.代码 <span style="font-size:18px;">from tens ...

- 学习Tensorflow的LSTM的RNN例子

学习Tensorflow的LSTM的RNN例子 基于TensorFlow一次简单的RNN实现 极客学院-递归神经网络 如何使用TensorFlow构建.训练和改进循环神经网络

- gcp上使用gpu来学习tensorflow

1080ti显卡实在是太贵了,8k一张的价格,让我感到无耐.还好,有gcp的gpu来训练,最有意思的是,他还提供300美元,让你挥霍. 1.当然是申请gcp的账号. 2.登录后,左侧->&quo ...

- 深度学习-tensorflow学习笔记(1)-MNIST手写字体识别预备知识

深度学习-tensorflow学习笔记(1)-MNIST手写字体识别预备知识 在tf第一个例子的时候需要很多预备知识. tf基本知识 香农熵 交叉熵代价函数cross-entropy 卷积神经网络 s ...

- 深度学习-tensorflow学习笔记(2)-MNIST手写字体识别

深度学习-tensorflow学习笔记(2)-MNIST手写字体识别超级详细版 这是tf入门的第一个例子.minst应该是内置的数据集. 前置知识在学习笔记(1)里面讲过了 这里直接上代码 # -*- ...

- 深度学习Tensorflow相关书籍推荐和PDF下载

深度学习Tensorflow相关书籍推荐和PDF下载 baihualinxin关注 32018.03.28 10:46:16字数 481阅读 22,673 1.机器学习入门经典<统计学习方法&g ...

- 学习TensorFlow,调用预训练好的网络(Alex, VGG, ResNet etc)

视觉问题引入深度神经网络后,针对端对端的训练和预测网络,可以看是特征的表达和任务的决策问题(分类,回归等).当我们自己的训练数据量过小时,往往借助牛人已经预训练好的网络进行特征的提取,然后在后面加上自 ...

- 学习TensorFlow,TensorBoard可视化网络结构和参数

在学习深度网络框架的过程中,我们发现一个问题,就是如何输出各层网络参数,用于更好地理解,调试和优化网络?针对这个问题,TensorFlow开发了一个特别有用的可视化工具包:TensorBoard,既可 ...

随机推荐

- poj3061(尺取法)

---恢复内容开始--- 题目意思:给你一段非负序列,再给你一个值k,找出这段序列中最少的连续子序列使得和为k: 解题思路:因为都是正数,我们只需要找到一段区间不大于k,就停止,然后左边趋近看是否能得 ...

- 腾讯云 Ubuntu16.04 搭建Git 服务

一.安装Git服务器所需软件 1.安装git-core, openssh-server, openssh-client三个软件.git-core是git的核心软件: openssh-server.op ...

- Layui_1.0.9_分页实例_Java

一.实体 package com.ebd.application.modules.taskManage.pojo; import com.ebd.application.common.Base.Bas ...

- 斜率DP个人理解

斜率DP 斜率DP的一版模式:给你一个序列,至多或分成m段,每段有花费和限制,问符合情况的最小花费是多少: 一版都用到sum[],所以符合单调,然后就可以用斜率优化了,很模板的东西: 如果看不懂可以先 ...

- Linux开机自动挂载存储的两种方式

登录服务器,给查看了下,发现确实是没有自动加载,df -h只能显示本地硬盘的分区,fdisk -l 还是能看到存储空间,这说明这个服务器连接存储是木有问题的. 输入history | grep mou ...

- MT【235】两道函数题

已知$g(x)=x^2-ax+4a$,记$h(x)=|\dfrac{x}{g(x)}|$,若$h(x)$在$(0,1]$上单调递增,求$a$的取值范围. 解答: 已知$$g(x)=\begin{cas ...

- 分数拆分(Fractions Again?!, UVa 10976)

题目链接:https://vjudge.net/problem/UVA-10976 It is easy to see that for every fraction in the form 1k(k ...

- Elasticsearch 常见问题的解决思路

本文为es性能监控基础的扩展,大家可以先看下性能监控基础,熟悉下es的基本原理.为翻译性质文档,感谢原作者,原始文档地址 类似于汽车的运行方式,Elasticsearch旨在让用户快速上手和运行,而无 ...

- A1001. A+B Format

Calculate a + b and output the sum in standard format -- that is, the digits must be separated into ...

- (转)Redis的那些最常见面试问题

背景:最近在准备面试相关的题目,发现redis基本一片空白,有必要好好总结下. 转自:https://www.cnblogs.com/Survivalist/p/8119891.html 1.什么是r ...