Hadoop入门学习笔记---part4

紧接着《Hadoop入门学习笔记---part3》中的继续了解如何用java在程序中操作HDFS。

众所周知,对文件的操作无非是创建,查看,下载,删除。下面我们就开始应用java程序进行操作,前提是按照《Hadoop入门学习笔记---part2》中的已经在虚拟机中搭建好了Hadoop伪分布环境;并且确定现在linux操作系统中hadoop的几个进程已经完全启动了。

好了,废话不多说!实际的例子走起。

在myeclipse中新建一个java工程:

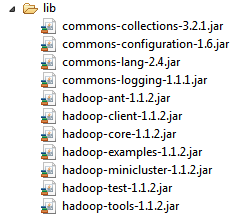

在项目工程中新建一个lib包用于存放项目需要的相关jar包,关于build path我就不多说了。相关jar包如下:

1. 创建文件:

public static final String HDFS_PATH = "hdfs://hadoop:9000/hello"; //创建文件的url

public static void main(String[] args) {

try {

URL.setURLStreamHandlerFactory(new FsUrlStreamHandlerFactory());

final URL url = new URL(HDFS_PATH);

final InputStream in = url.openStream();

IOUtils.copyBytes(in, System.out, 1024, true);

} catch (Exception e) {

e.printStackTrace();

}

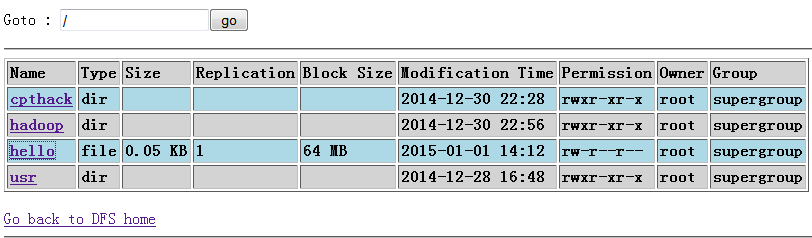

在浏览器中查看效果:输入http://hadoop:50070/ 然后点击Browse the filesystem 就可以查看到在HDFS根目录下刚刚新建的那个文件了。

2. 上传文件:首先应该明白的就是上传首先需要在HDFS中创建,然后以流的形式写入。

public static final String HDFS_PATH = "hdfs://hadoop:9000/";

final FileSystem fileSystem = FileSystem.get(new URI(HDFS_PATH),new Configuration());

// 上传文件

final FSDataOutputStream out = fileSystem.create(new Path(FILE_PATH));

final FileInputStream in = new FileInputStream("H:/redTestFileForHadoop");

IOUtils.copyBytes(in, out, 1024, true);

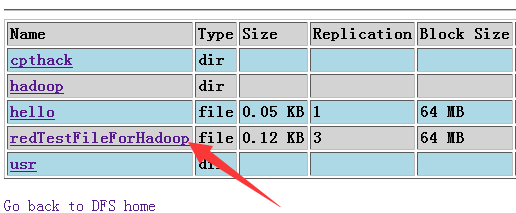

效果如下:直接在浏览器中打开。

(上传1)

(上传1)

---------------------------------------分割线---------------------------------------------------------

(上传2)

(上传2)

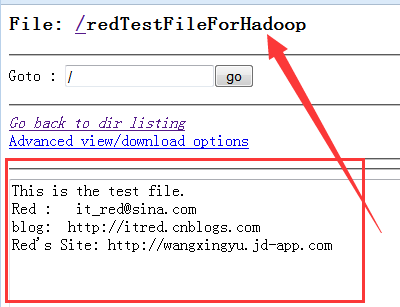

3. 下载文件,直接输出到控制台,也可以单独将这个写入到一个文件里面,这里就不介绍了,代码如下:

public static final String HDFS_PATH = "hdfs://hadoop:9000/";

final FileSystem fileSystem = FileSystem.get(new URI(HDFS_PATH),new Configuration());

// 下载文件

final FSDataInputStream in = fileSystem.open(new Path(FILE_PATH));

IOUtils.copyBytes(in, System.out,1024, true);

效果图如下:

4. 删除文件:

public static final String HDFS_PATH = "hdfs://hadoop:9000/";

final FileSystem fileSystem = FileSystem.get(new URI(HDFS_PATH),new Configuration());

fileSystem.delete(new Path(FILE_PATH), true);

效果就不用说了,直接在浏览器中看不到这个文件了。

很多时候看起来很复杂的东西其实是自己心里面的认可,实际上也没有想象中的那么难!好好体验一下吧。瞬间感觉这个和我们平常用到的云网盘有几分一样了。哈哈,不妨做一个属于自己的云网盘。绝对可以的!

作者:itRed 邮箱:it_red@sina.com

博客:http://www.cnblogs.com/itred 个人网站:http://wangxingyu.jd-app.com

***版权声明:本文版权归作者和博客园共有,欢迎转载,但请在文章显眼位置标明文章出处。未经本人书面同意,将其作为他用,本人保留追究责任的所有权利。

Hadoop入门学习笔记---part4的更多相关文章

- Hadoop入门学习笔记---part3

2015年元旦,好好学习,天天向上.良好的开端是成功的一半,任何学习都不能中断,只有坚持才会出结果.继续学习Hadoop.冰冻三尺,非一日之寒! 经过Hadoop的伪分布集群环境的搭建,基本对Hado ...

- Hadoop入门学习笔记---part2

在<Hadoop入门学习笔记---part1>中感觉自己虽然总结的比较详细,但是始终感觉有点凌乱.不够系统化,不够简洁.经过自己的推敲和总结,现在在此处概括性的总结一下,认为在准备搭建ha ...

- Hadoop入门学习笔记---part1

随着毕业设计的进行,大学四年正式进入尾声.任你玩四年的大学的最后一次作业最后在激烈的选题中尘埃落定.无论选择了怎样的选题,无论最后的结果是怎样的,对于大学里面的这最后一份作业,也希望自己能够尽心尽力, ...

- Hadoop入门学习笔记(一)

Week2 学习笔记 Hadoop核心组件 Hadoop HDFS(分布式文件存储系统):解决海量数据存储 Hadoop YARN(集群资源管理和任务调度框架):解决资源任务调度 Hadoop Map ...

- Hadoop入门学习笔记总结系列文章导航

一.为何要学习Hadoop? 这是一个信息爆炸的时代.经过数十年的积累,很多企业都聚集了大量的数据.这些数据也是企业的核心财富之一,怎样从累积的数据里寻找价值,变废为宝炼数成金成为当务之急.但数据增长 ...

- Hadoop入门学习笔记之一

http://hadoop.apache.org/docs/r1.2.1/api/index.html 适当的利用 null 在map中可以实现对文件的简单处理,如排序,和分集合输出等. 需要关心的内 ...

- Hadoop入门学习笔记(二)

Yarn学习 YARN简介 YARN是一个通用资源管理系统和调度平台,可为上层应用提供统一的资源管理和调度 YARN功能说明 资源管理系统:集群的硬件资源,和程序运行相关,比如内存.CPU等. 调度平 ...

- Hadoop入门学习笔记-第一天 (HDFS:分布式存储系统简单集群)

准备工作: 1.安装VMware Workstation Pro 2.新建三个虚拟机,安装centOS7.0 版本不限 配置工作: 1.准备三台服务器(nameNode10.dataNode20.da ...

- Hadoop入门学习笔记-第二天 (HDFS:NodeName高可用集群配置)

说明:hdfs:nn单点故障,压力过大,内存受限,扩展受阻.hdfs ha :主备切换方式解决单点故障hdfs Federation联邦:解决鸭梨过大.支持水平扩展,每个nn分管一部分目录,所有nn共 ...

随机推荐

- 2017-1-5 天气雨 React 学习笔记

官方example 中basic-click-counter <script type="text/babel"> var Counter = React.create ...

- AFNetworking 3.0 源码解读(九)之 AFNetworkActivityIndicatorManager

让我们的APP像艺术品一样优雅,开发工程师更像是一名匠人,不仅需要精湛的技艺,而且要有一颗匠心. 前言 AFNetworkActivityIndicatorManager 是对状态栏中网络激活那个小控 ...

- 代码的坏味道(19)——狎昵关系(Inappropriate Intimacy)

坏味道--狎昵关系(Inappropriate Intimacy) 特征 一个类大量使用另一个类的内部字段和方法. 问题原因 类和类之间应该尽量少的感知彼此(减少耦合).这样的类更容易维护和复用. 解 ...

- 编写高质量代码:改善Java程序的151个建议(第7章:泛型和反射___建议106~109)

建议106:动态代理可以使代理模式更加灵活 Java的反射框架提供了动态代理(Dynamic Proxy)机制,允许在运行期对目标类生成代理,避免重复开发.我们知道一个静态代理是通过主题角色(Prox ...

- Java进击C#——前言

本章简言 记得三年前笔者来到现在的公司的时候,公司人口不出十个人.那个时候笔者刚从日本回来,想在福州.厦门.青岛找一个合适自己发展的机会.最后我的一个福州的朋友打电话希望我能过去帮他,跟他一起创业.这 ...

- 6.在MVC中使用泛型仓储模式和依赖注入实现增删查改

原文链接:http://www.c-sharpcorner.com/UploadFile/3d39b4/crud-operations-using-the-generic-repository-pat ...

- [修正] Firemonkey TFrame 存档后,下次载入某些事件连结会消失(但源码还在)

问题:Firemonkey TFrame 存档后,下次载入某些事件连结会消失(但源码还在) 解决:(暂时方法) type TTestFrame = class(TFrame) public const ...

- https 安全验证问题

最近为了满足苹果的 https 要求, 经过努力终于写出了方法 验证 SSL 证书是否满足 ATS 要求 nscurl --ats-diagnostics --verbose https://你的域名 ...

- Android NDK debug 方法

最近又频繁遇到 NDK 的错误,记录一下debug调试的一些经验,以备后续查看 一般来说,在Android Studio中的Monitor中将过滤器的 LOG TAG 设置为 "DEBUG& ...

- ASP.NET Aries DataGrid 配置表头说明文档

DataGrid 配置表头 字段 中文 说明 Field 字段 注意:mg_ 开头的字段为层级表头 Title 列称 OrderNum 序号 显示的顺序(冻结和非冻结列是两个组的序号) Width 列 ...