Hidden Markov Models笔记

Andrew Ng CS229 讲义: https://pan.baidu.com/s/12zMYBY1NLzkluHNeMNO6MQ

HMM模型常用于NLP、语音等领域。

- 马尔科夫模型(Markov Model)

只有状态序列z。状态转移矩阵A。

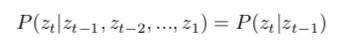

有限视野假设(limited horizon assumption),Markov性:

静态过程假设(stationary process assumption),参数时不变性:

两个问题:1)概率问题,2)学习问题

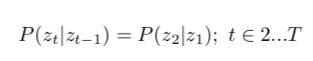

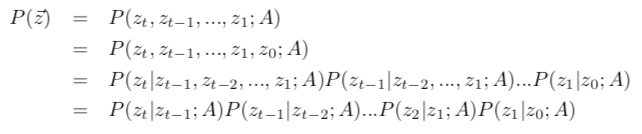

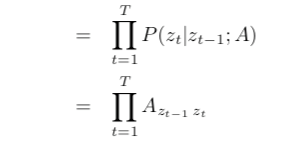

问题1)概率问题:已知转移矩阵A,求某观测状态序列z的概率是多少

根据有限视野假设,

带入计算即可。

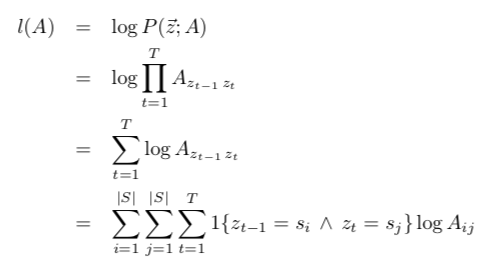

问题2)学习问题:已知观测状态序列z,求参数A最大化z出现的概率

使用最大似然估计,最大化log似然函数

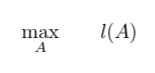

即求解问题

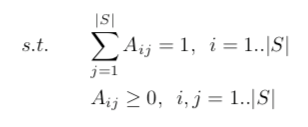

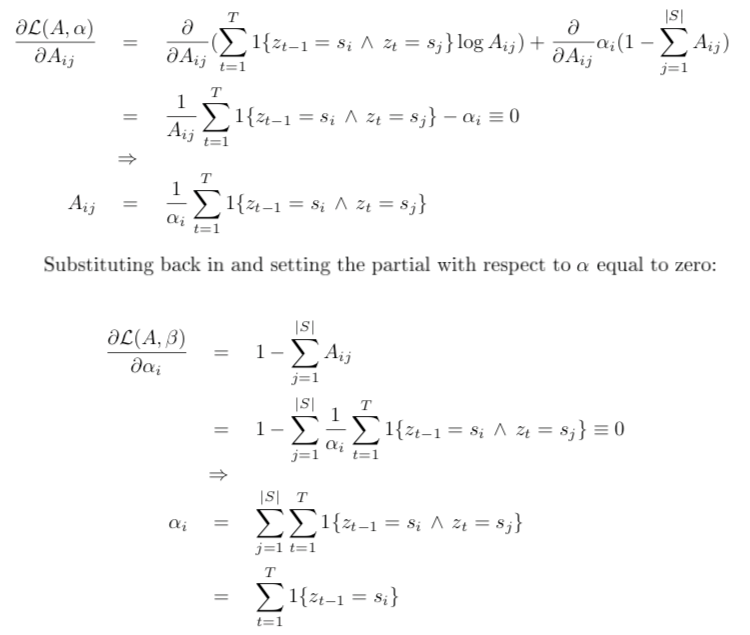

分别对参数求偏导并令其为零:

代入得到状态转移矩阵A的估计:

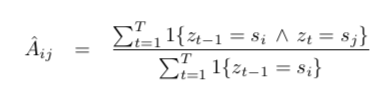

- 隐马尔科夫模型(Hidden Markov Model)

状态序列z,观测序列x。状态转移矩阵A,发射(生成输出)矩阵B。

输出独立假设(output independence assumption):

三个问题:1)概率问题,2)解码问题,3)学习问题

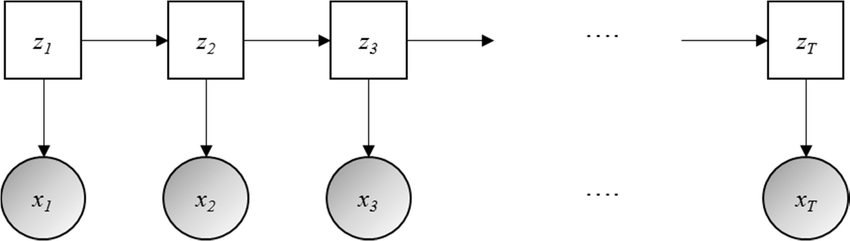

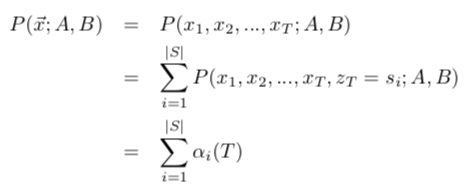

1)概率问题:已知转移矩阵A、发射矩阵B,求观测序列x的概率 - 前向算法

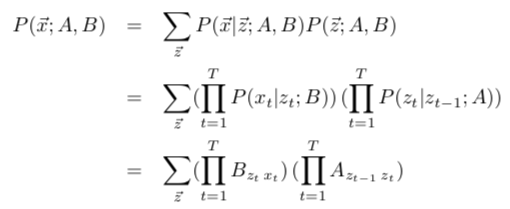

根据输出独立假设,

更快的做法是动态规划,即前向算法。

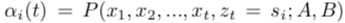

定义

重新推导概率:

类似地,对应有后向算法:

2)解码问题:已知转移矩阵A、发射矩阵B,观测序列x,求状态序列z的概率 - Viterbi算法

使用贝叶斯定理:

更快的做法同样是动态规划。和前向算法不同的地方在于,使用最大化操作代替求和操作,即Viterbi算法。也就是说,现在是跟踪最大化见过的观测子序列的概率,而不是前向算法是对见过的观测子序列的概率全部求和。

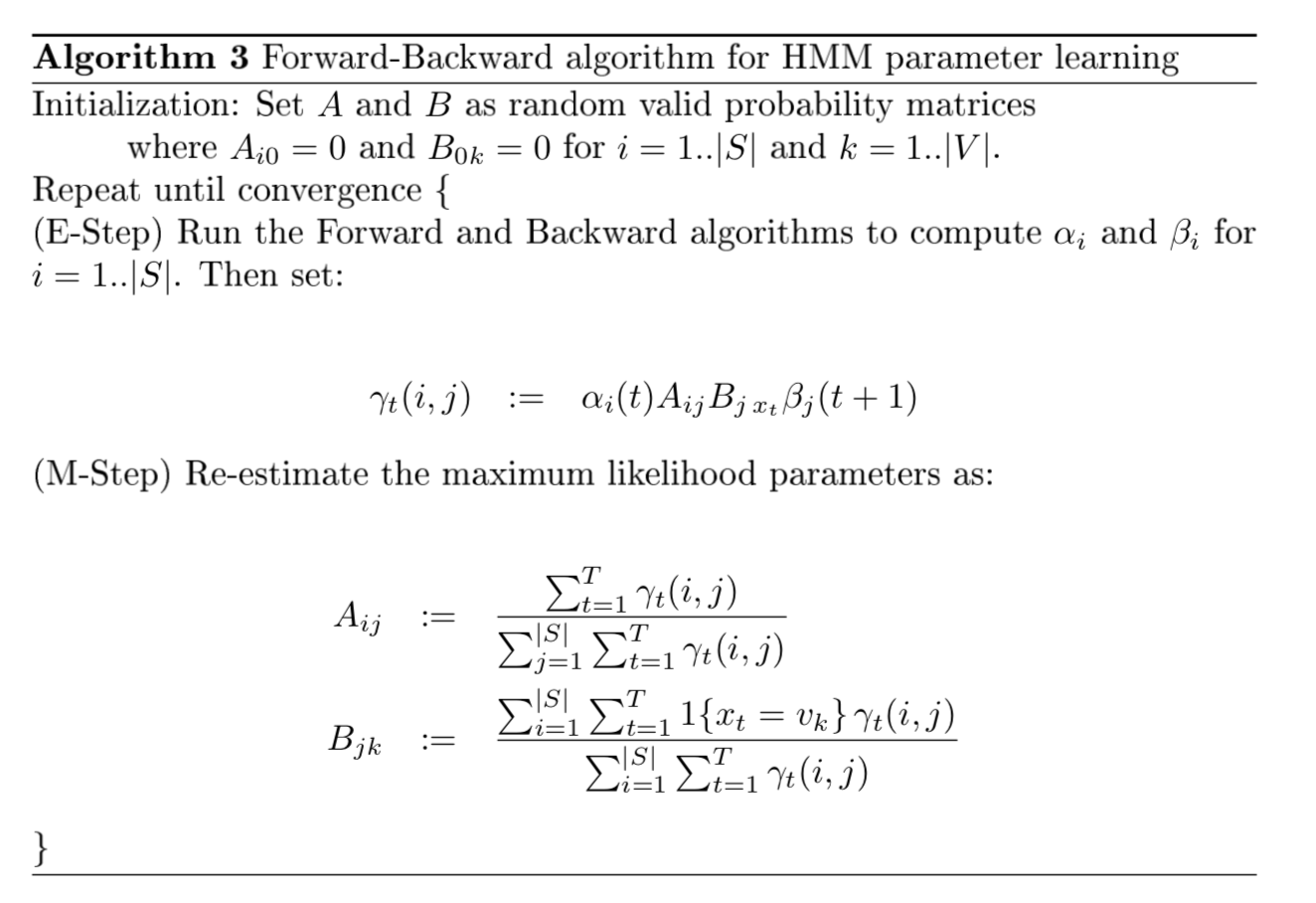

3)学习问题:已知观测序列x,求转移矩阵A、发射矩阵B - Baum-Welch算法(前向-后向算法)

可以理解x是一个很长的序列,和通常的监督学习问题不同在于并非是批量的label-feature样本。

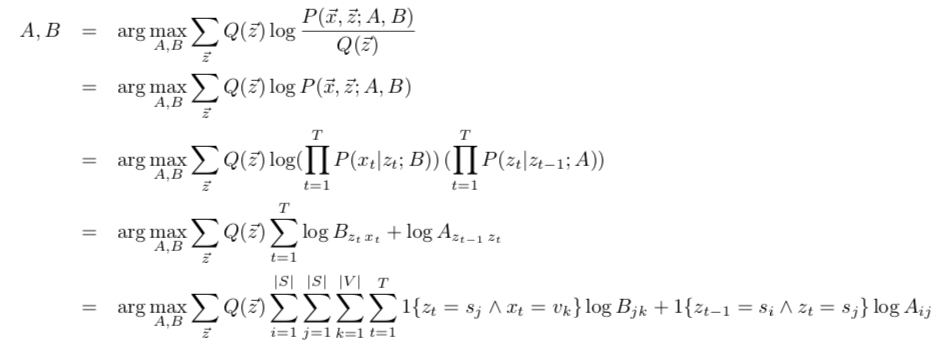

状态序列是隐变量序列。根据EM算法,E步找一个下界逼近目标函数,M步调整参数最大化这个下界:

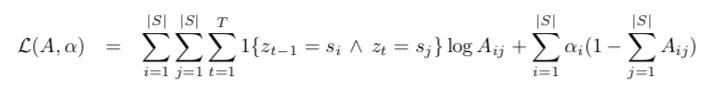

转化为Lagrange multipliers:

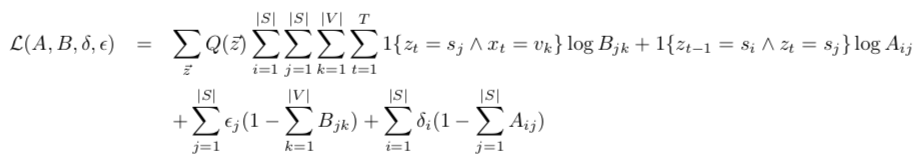

分别对参数求偏导并令其为零:

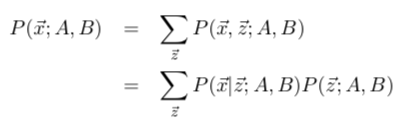

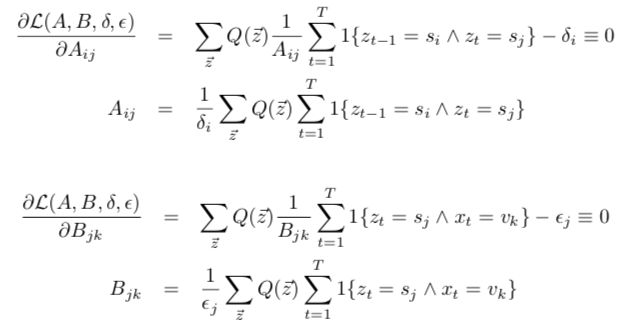

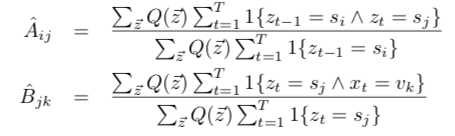

代入得到参数A,B的估计:

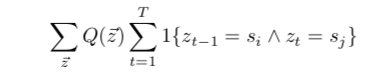

对A的分子部分使用bayes定理并用前向算法和后向算法转化:

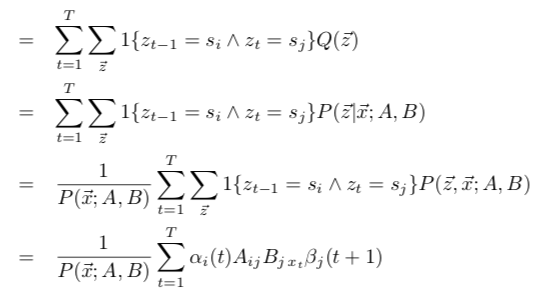

A的分母部分类似:

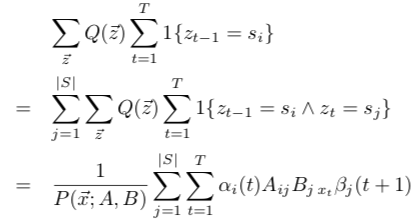

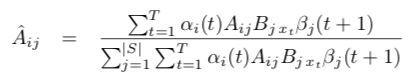

综合得到A的估计:

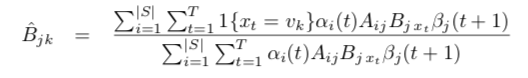

同理得到B的估计:

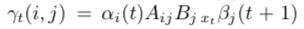

实际计算中直接计算充分统计量

和通常的EM求解的问题类似,也是非凸问题,容易陷入局部极值。因此需要做不同的初始化运行多次算法。另外,对于没有样本覆盖到A、B的转移或发射概率的实际问题,需要做平滑操作。

Hidden Markov Models笔记的更多相关文章

- 隐马尔科夫模型(Hidden Markov Models)

链接汇总 http://www.csie.ntnu.edu.tw/~u91029/HiddenMarkovModel.html 演算法笔记 http://read.pudn.com/downloads ...

- PRML读书会第十三章 Sequential Data(Hidden Markov Models,HMM)

主讲人 张巍 (新浪微博: @张巍_ISCAS) 软件所-张巍<zh3f@qq.com> 19:01:27 我们开始吧,十三章是关于序列数据,现实中很多数据是有前后关系的,例如语音或者DN ...

- 机器学习 Hidden Markov Models 1

Introduction 通常,我们对发生在时间域上的事件希望可以找到合适的模式来描述.考虑下面一个简单的例子,比如有人利用海草来预测天气,民谣告诉我们说,湿漉漉的海草意味着会下雨,而干燥的海草意味着 ...

- 机器学习 Hidden Markov Models 2

Hidden Markov Models 下面我们给出Hidden Markov Models(HMM)的定义,一个HMM包含以下几个要素: ∏=(πi)表示初始状态的向量.A={aij}状态转换矩阵 ...

- 隐马尔科夫模型(Hidden Markov Models) 系列之三

转自:http://blog.csdn.net/eaglex/article/details/6418219 隐马尔科夫模型(Hidden Markov Models) 定义 隐马尔科夫模型可以用一个 ...

- [Bayesian] “我是bayesian我怕谁”系列 - Markov and Hidden Markov Models

循序渐进的学习步骤是: Markov Chain --> Hidden Markov Chain --> Kalman Filter --> Particle Filter Mark ...

- 机器学习 Hidden Markov Models 3

Viterbi Algorithm 前面我们提到过,HMM的第二类问题是利用HMM模型和可观察序列寻找最有可能生成该观察序列的隐藏变量的序列.简单来说,第一类问题是通过模型计算生成观察序列的概率,而第 ...

- 隐马尔科夫模型(Hidden Markov Models) 系列之五

转自:http://blog.csdn.net/eaglex/article/details/6458541 维特比算法(Viterbi Algorithm) 找到可能性最大的隐藏序列 通常我们都有一 ...

- 隐马尔科夫模型(Hidden Markov Models) 系列之四

转自:http://blog.csdn.net/eaglex/article/details/6430389 前向算法(Forward Algorithm) 一.如果计算一个可观察序列的概率? 1 ...

随机推荐

- HTML相关知识和经验的碎片化记录

1.标签input在type="file"时,name是必须属性 <form id="MainFileUpload" name="MainFil ...

- Spring学习大纲

1.BeanFactory 和 FactoryBean? 2.Spring IOC 的理解,其初始化过程? 3.BeanFactory 和 ApplicationContext? 4.Spring B ...

- 利用using和try/finally语句来清理资源

使用非托管资源的类型必须实现IDisposable接口的Dispose()方法来精确的释放系统资源..Net环境的这一规则使得释放资源代码的职责 是类型的使用者,而不是类型或系统.因此,任何时候你在使 ...

- 重建freescale 4.6.2 multilib toolchain

patch和crosstool-ng 可以从下面的网址下载, https://community.freescale.com/thread/386450 不过估计你会失望的,改了脚本,编译了后发现不对 ...

- C#使用Newtonsoft.Json操作json

1.下载 Newtonsoft.Json 右键引用,选择 管理NuGet程序包,选择浏览,输入log4net,然后点击下载 2.json数据的组装与解析 public class Class { pu ...

- MongoDB 分片2

mongodb 在windows下面进行分片 mongodb 更新很快,在做分片的时候,查找了不少文章,但是很多已经过时了.现在把我搭建的过程及命令分享给大家.我用的是最新版本windows版3.4. ...

- 算法训练 Cowboys(DP)

问题描述 一个间不容发的时刻:n个牛仔站立于一个环中,并且每个牛仔都用左轮手枪指着他旁边的人!每个牛仔指着他顺时针或者逆时针方向上的相邻的人.正如很多西部片那样,在这一刻,绳命是入刺的不可惜……对峙的 ...

- 【BZOJ 2120】【国家集训队 2011】【数颜色】(莫队)

题目描述 墨墨购买了一套N支彩色画笔(其中有些颜色可能相同),摆成一排,你需要回答墨墨的提问.墨墨会向你发布如下指令: 1. Q L R代表询问你从第L支画笔到第R支画笔中共有几种不同颜色的画笔. 2 ...

- 洛谷P2526 [SHOI2001]小狗散步(二分图匹配)

题目背景 Grant喜欢带着他的小狗Pandog散步.Grant以一定的速度沿着固定路线走,该路线可能自交.Pandog喜欢游览沿途的景点,不过会在给定的N个点和主人相遇.小狗和主人同时从(X1,Y1 ...

- Q的进阶用法

Q的实例化用法 #q1 里面的条件都是or的关系 q1=Q() q1.connector = 'OR' q1.children.append(('id',1)) q1.children.append( ...