部署ceph存储集群及块设备测试

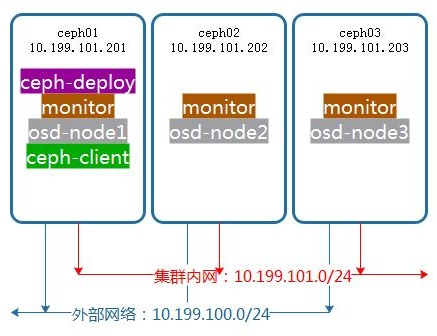

集群环境

配置基础环境

添加ceph.repo

wget -O /etc/yum.repos.d/ceph.repo https://raw.githubusercontent.com/aishangwei/ceph-demo/master/ceph-deploy/ceph.repo

yum makecache

配置NTP

yum -y install ntpdate ntp

ntpdate cn.ntp.org.cn

systemctl restart ntpd ntpdate;systemctl enable ntpd ntpdate

创建用户和ssh免密登录

useradd ceph-admin

echo "ceph-admin"|passwd --stdin ceph-admin

echo "ceph-admin ALL = (root) NOPASSWD:ALL" | sudo tee /etc/sudoers.d/ceph-admin

sudo chmod /etc/sudoers.d/ceph-admin

配置host解析

cat >>/etc/hosts<<EOF

10.1.10.201 ceph01

10.1.10.202 ceph02

10.1.10.203 ceph03

EOF

配置sudo不需要tty

sed -i 's/Default requiretty/#Default requiretty/' /etc/sudoers

使用ceph-deploy部署集群

配置免密登录

su - ceph-admin

ssh-keygen

ssh-copy-id ceph-admin@ceph01

ssh-copy-id ceph-admin@ceph02

ssh-copy-id ceph-admin@ceph03

安装ceph-deploy

sudo yum install -y ceph-deploy python-pip

部署节点

mkdir my-cluster;cd my-cluster

ceph-deploy new ceph01 ceph02 ceph03

安装ceph包(代替ceph-deploy install node1 node2,下面命令需要在每台node上安装)

sudo wget -O /etc/yum.repos.d/epel.repo http://mirrors.aliyun.com/repo/epel-7.repo

rpm --import /etc/pki/rpm-gpg/RPM-GPG-KEY-EPEL-7

sudo yum install -y ceph ceph-radosgw

配置初始monitor(s),收集所有密钥

sudo systemctl stop firewalld;sudo systemctl disable firewalld #确认防火墙已关闭

ceph-deploy mon create-initial

ls -l *.keyring

把配置信息拷贝到各节点

ceph-deploy admin ceph01 ceph02 ceph03

配置osd

su - ceph-admin

cd /home/my-cluster

for dev in /dev/sdb /dev/sdc /dev/sdd

do

ceph-deploy disk zap ceph01 $dev

ceph-deploy osd create ceph01 --data $dev

ceph-deploy disk zap ceph02 $dev

ceph-deploy osd create ceph02 --data $dev

ceph-deploy disk zap ceph03 $dev

ceph-deploy osd create ceph03 --data $dev

done

sudo ceph osd tree #查看osd

部署mgr,Luminous版以后才需要部署

ceph-deploy mgr create ceph01 ceph02 ceph03

开启dashboard模块

sudo chown -R ceph-admin /etc/ceph/

ceph mgr module enable dashboard

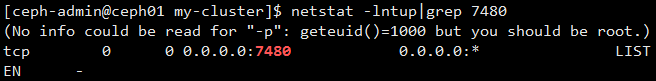

netstat -lntup|grep

http://10.1.10.201:7000

删除集群

ceph-deploy purge ceph01 ceph02 ceph03

ceph-deploy purgedata ceph01 ceph02 ceph03

ceph-deploy forgetkeys

配置ceph块存储

检查是否复合块设备环境要求

uname -r

sudo modprobe rbd

echo $?

创建池和块设备

ceph osd lspools

ceph osd pool create rbd

确定pg_num取值是强制性的,因为不能自动计算,下面是几个常用的值

少于5个OSD时,pg_num设置为128

OSD数量在5到10个时,pg_num设置为512

OSD数量在10到50个时,pg_num设置为4096

OSD数量大于50时,理解权衡方法、以及如何自己计算pg_num取值

客户端创建块设备

sudo rbd create rbd1 --size 1G --image-feature layering --name client.admin

映射块设备

sudo rbd map --image rbd1 --name client.admin

创建文件系统并挂载

fdisk -l /dev/rbd0

mkfs.xfs /dev/rbd0

mkdir /mnt/ceph-disk1

mount /dev/rbd0 /mnt/ceph-disk1

df -h /mnt/ceph-disk1

写入数据测试

dd if=/dev/zero of=/mnt/ceph-disk1/file1 count= bs=1M

配置ceph对象存储

安装ceph对象网关

ceph-deploy install --rgw ceph01 ceph02 ceph03

新建对象网关实例

ceph-deploy rgw create ceph01 ceph02 ceph03

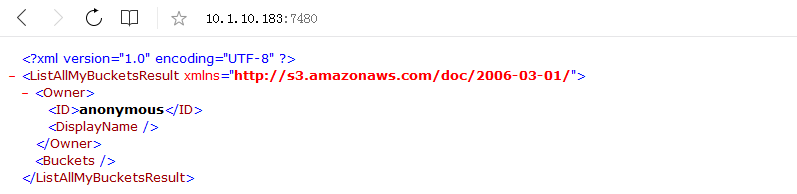

一旦网关开始运行,你就可以通过 7480 端口来访问它(比如 http://client-node:7480)

采用fio软件压力测试

安装fio压测软件

yum install libaio-devel -y

yum install zlib-devel -y

yum install ceph-devel -y

git clone git://git.kernel.dk/fio.git

cd fio/

./configure

make;make install

测试磁盘性能

fio -direct= -iodepth= -rw=read -ioengine=libaio -bs=2k -size=100G -numjobs= -runtime= -group_reporting -

filename=/dev/rbd0 -name=readiops

fio -direct= -iodepth= -rw=write -ioengine=libaio -bs=2k -size=100G -numjobs= -runtime= -group_reporting -

filename=/dev/rbd0 -name=writeiops

fio -direct= -iodepth= -rw=randread -ioengine=libaio -bs=2k -size=100G -numjobs= -runtime= -group_reporting -

filename=/dev/rbd0 -name=randreadiops

fio -direct= -iodepth= -rw=randwrite -ioengine=libaio -bs=2k -size=100G -numjobs= -runtime= -group_reporting -

filename=/dev/rbd0 -name=randwriteiops

部署ceph存储集群及块设备测试的更多相关文章

- 利用ceph-deploy部署ceph存储集群

一.环境准备 创建两台主机,ip地址和主机名如下 192.168.2.100,主机名ceph-1 192.168.2.101,主机名ceph-2 每个主机 新增加一块数据盘,分区根据自己需要分区即可, ...

- Ceph 存储集群第一部分:配置和部署

内容来源于官方,经过个人实践操作整理,官方地址:http://docs.ceph.org.cn/rados/ 所有 Ceph 部署都始于 Ceph 存储集群. 基于 RADOS 的 Ceph 对象存储 ...

- 002.RHCS-配置Ceph存储集群

一 前期准备 [kiosk@foundation0 ~]$ ssh ceph@serverc #登录Ceph集群节点 [ceph@serverc ~]$ ceph health #确保集群状态正常 H ...

- Ceph 存储集群搭建

前言 Ceph 分布式存储系统,在企业中应用面较广 初步了解并学会使用很有必要 一.简介 Ceph 是一个开源的分布式存储系统,包括对象存储.块设备.文件系统.它具有高可靠性.安装方便.管理简便.能够 ...

- Ceph 存储集群5-数据归置

一.数据归置概览 Ceph 通过 RADOS 集群动态地存储.复制和重新均衡数据对象.很多不同用户因不同目的把对象存储在不同的存储池里,而它们都坐落于无数的 OSD 之上,所以 Ceph 的运营需要些 ...

- Ceph 存储集群4-高级运维:

一.高级运维 高级集群操作主要包括用 ceph 服务管理脚本启动.停止.重启集群,和集群健康状态检查.监控和操作集群. 操纵集群 运行 Ceph 每次用命令启动.重启.停止Ceph 守护进程(或整个集 ...

- Ceph 存储集群3-部署:

ceph-deploy 工具是一种部署 Ceph 的方法,它只依赖到服务器的 SSH 访问. sudo 和 Python .它可在你的工作站上运行,不需要服务器.数据库.或其它工具.如果你安装.拆卸过 ...

- Ceph 存储集群2-配置:心跳选项、OSD选项、存储池、归置组和 CRUSH 选项

一.心跳选项 完成基本配置后就可以部署.运行 Ceph 了.执行 ceph health 或 ceph -s 命令时,监视器会报告 Ceph 存储集群的当前状态.监视器通过让各 OSD 自己报告.并接 ...

- Ceph 存储集群1-配置:硬盘和文件系统、配置 Ceph、网络选项、认证选项和监控器选项

所有 Ceph 部署都始于 Ceph 存储集群.基于 RADOS 的 Ceph 对象存储集群包括两类守护进程: 1.对象存储守护进程( OSD )把存储节点上的数据存储为对象: 2.Ceph 监视器( ...

随机推荐

- [LeetCode] 905. Sort Array By Parity 按奇偶排序数组

Given an array A of non-negative integers, return an array consisting of all the even elements of A, ...

- thinkphp5.1 - twig模板-全局变量

thinkphp5.1 - twig模板-全局变量我们在定义 ccs 之类的静态文件的时候,经常会使用<link rel="stylesheet" href="__ ...

- 集合类源码(三)Collection之List(CopyOnWriteArrayList, Stack)

CopyOnWriteArrayList 功能 全名 public class CopyOnWriteArrayList<E> implements List<E>, Rand ...

- AtomicReference示例

对引用类型的原子性操作 /** * *对引用变量的原子操作 note: *在java中对引用类型的变量,赋值是原子性的,为什么还要有atomicReference,假如要对一个引用类型进行比较,设置等 ...

- Redis Persistent Replication Sentinel Cluster的一些理解

Redis Persistent Replication Sentinel Cluster的一些理解 我喜欢把工作中接触到的各种数据库叫做存储系统,笼统地说:Redis.Mysql.Kafka.Ela ...

- Feign切换client到okhttp无法生效天坑!(附带发生的原因)

提示:如果只看如何解决问题,请看文章的末尾如何解决这个问题 1. 场景描述 最近项目中使用了feign当做http请求工具来使用.相对于httpclient.resttemplate来说,fegin用 ...

- Java se课程设计详解——数据库接口类(1)

开始做课程设计的时候根本无从下手,后来查阅资料后发现是先从数据库开始的.整个课程设计需要用到的如下图,今天总结一下数据库接口! 数据库接口需要用到两个类,一个是DAO.java,另一个是propert ...

- 【POI】java服务生成List数据集合,后台服务生成xlsx临时文件,并将临时文件上传到腾讯云上

场景: java服务生成List数据集合,后台服务生成xlsx临时文件,并将临时文件上传到腾讯云上 今日份代码: 1.先是一个变量,作为文件名 private static final String ...

- Java中如何获取一个类中泛型的实际类型

本文链接:https://blog.csdn.net/kuuumo/article/details/83021158 _______________________________________ ...

- C# winform窗体简单保存界面控件参数到xml

引用网上的 XMLHelper 地址 :https://www.cnblogs.com/chnboy/archive/2009/04/02/1427652.html 稍做修改 using System ...