12.Flume的安装

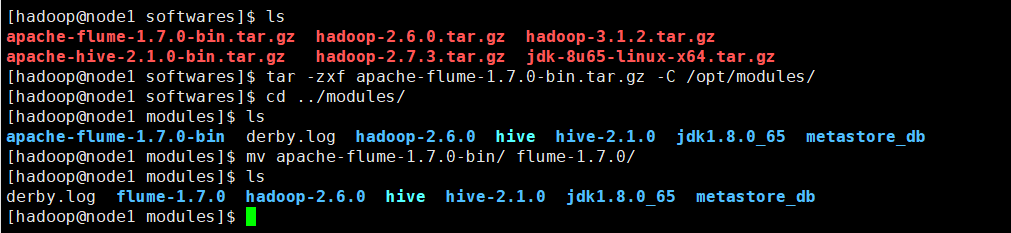

先把flume包上传并解压

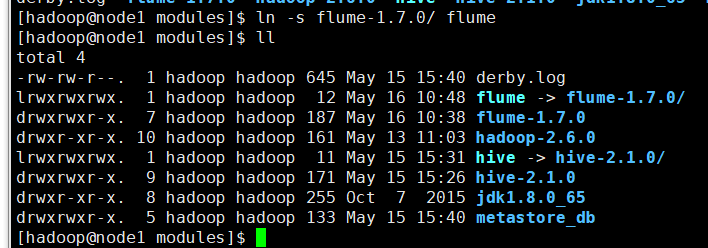

给flume创建一个软链接

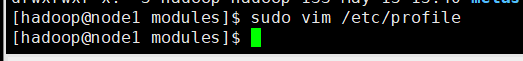

给flume配置环境变量

#flume

export FLUME_HOME=/opt/modules/flume

export PATH=$PATH:$FLUME_HOME/bin

使环境变量生效

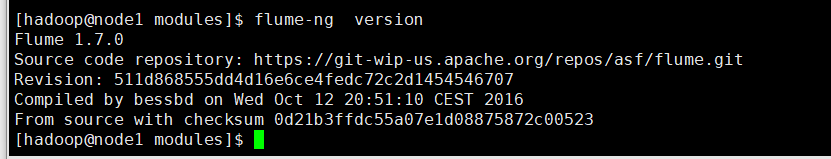

验证flume版本信息

flume-ng version

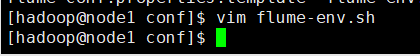

然后进入flume的目录,修改conf下的flume-env.sh,在里面配置JAVA_HOME

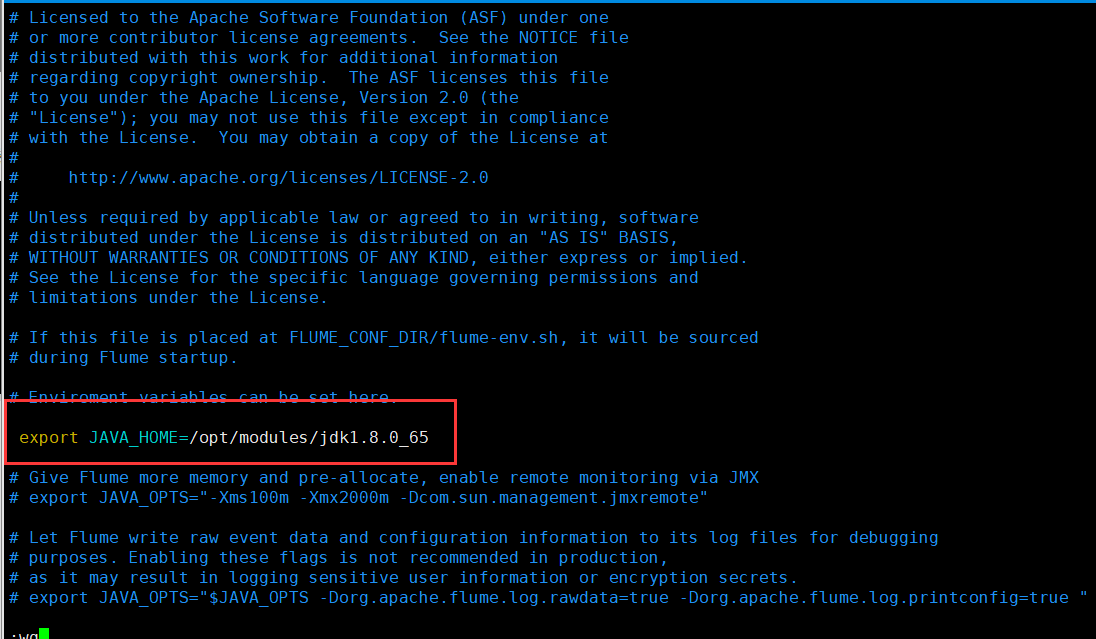

先用一个最简单的例子来测试一下程序环境是否正常

先在flume的conf目录下新建一个文件

vim netcat-logger.conf

# 定义这个agent中各组件的名字

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# 描述和配置source组件:r1

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

# 描述和配置sink组件:k1

a1.sinks.k1.type = logger

# 描述和配置channel组件,此处使用是内存缓存的方式

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000 内存里面存放1000个事件

a1.channels.c1.transactionCapacity = 100

# 描述和配置source channel sink之间的连接关系

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

a1.sources = r1

a1.sinks = k1

a1.channels = c1 a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = a1.sinks.k1.type = logger

a1.channels.c1.type = memory

a1.channels.c1.capacity =

a1.channels.c1.transactionCapacity = a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

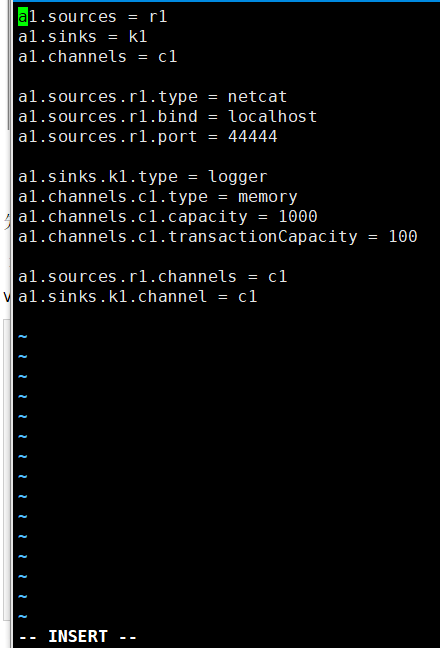

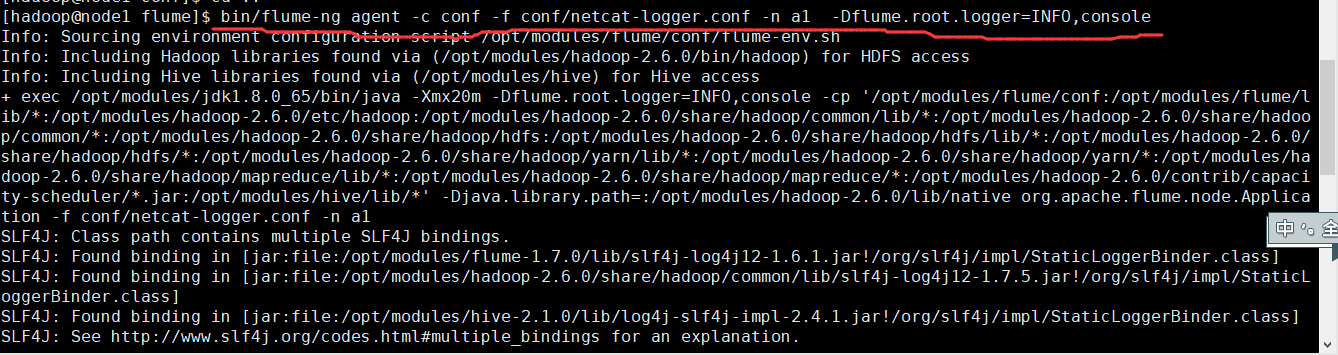

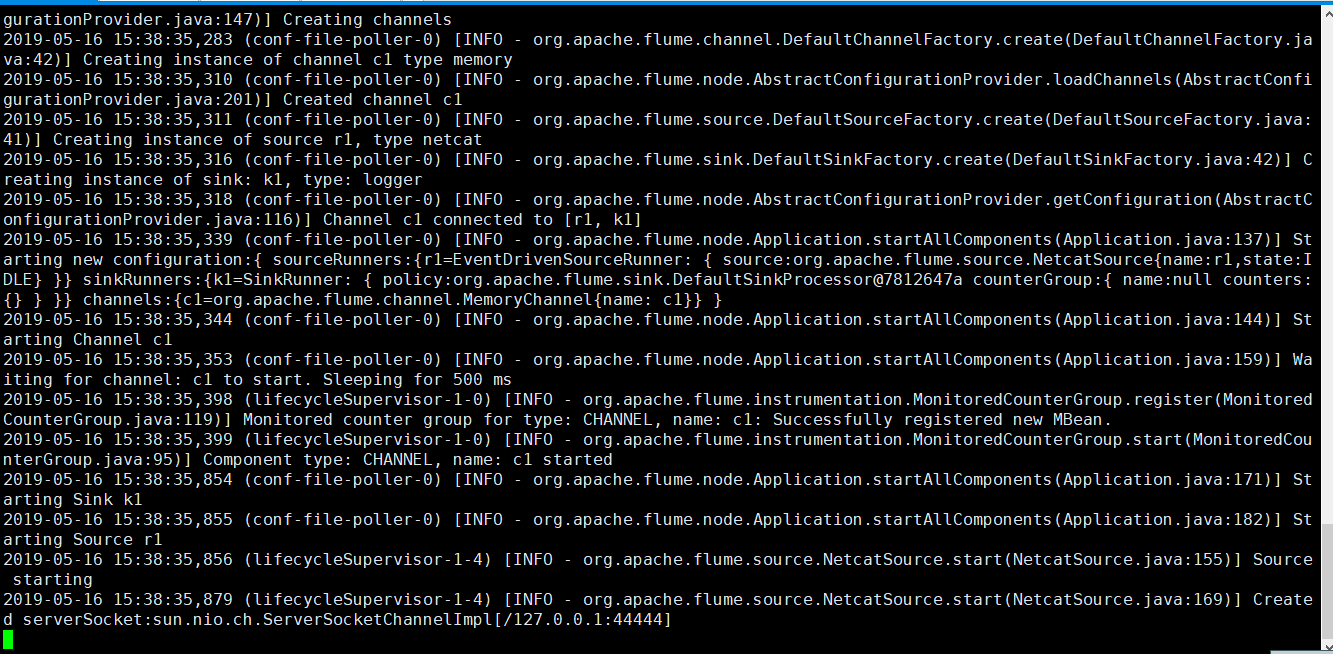

启动agent去采集数据

bin/flume-ng agent -c conf -f conf/netcat-logger.conf -n a1 -Dflume.root.logger=INFO,console

-c conf 指定flume自身的配置文件所在目录

-f conf/netcat-logger.conf 指定我们所描述的采集方案

-n a1 指定我们这个agent的名字

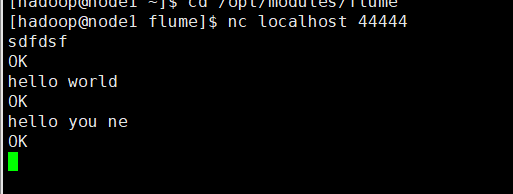

启动nc的客户端

$>nc localhost 44444

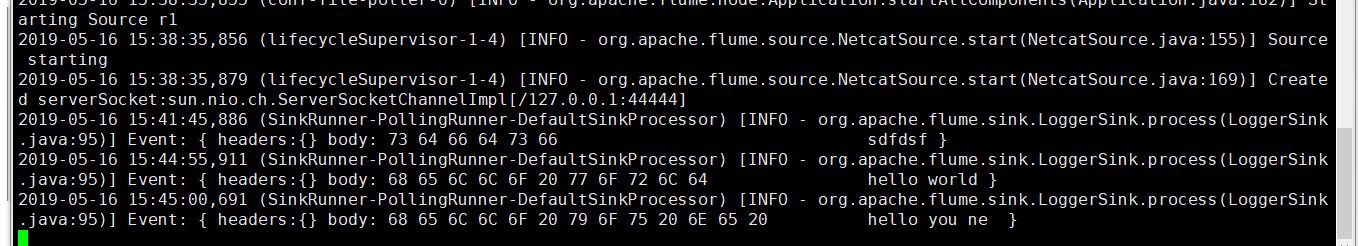

可以看到flume接收到

采集本地目录的数据文件到HDFS上

采集需求:某服务器的某特定目录下,会不断产生新的文件,每当有新文件出现,就需要把文件采集到HDFS中去

根据需求,首先定义以下3大要素

1.采集源,即source——监控文件目录 : spooldir

2.下沉目标,即sink——HDFS文件系统 : hdfs sink

3.source和sink之间的传递通道——channel,可用file channel 也可以用内存channel

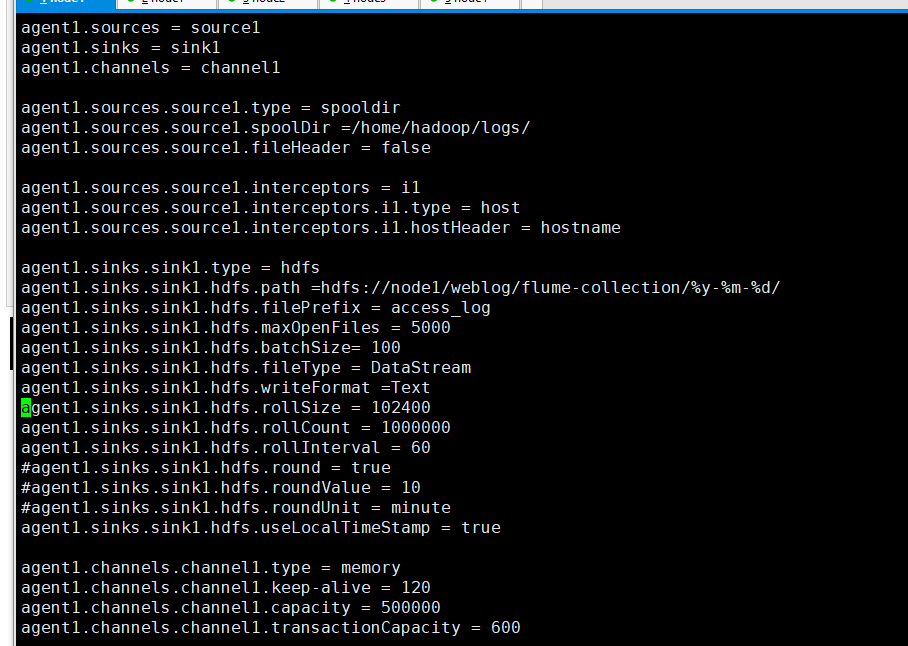

新建配置文件

#定义三大组件的名称

agent1.sources = source1

agent1.sinks = sink1

agent1.channels = channel1 # 配置source组件

agent1.sources.source1.type = spooldir(监听的文件不能重复)

agent1.sources.source1.spoolDir =/home/hadoop/logs/

agent1.sources.source1.fileHeader = false #配置拦截器

agent1.sources.source1.interceptors = i1

agent1.sources.source1.interceptors.i1.type = host

agent1.sources.source1.interceptors.i1.hostHeader = hostname # 配置sink组件

agent1.sinks.sink1.type = hdfs

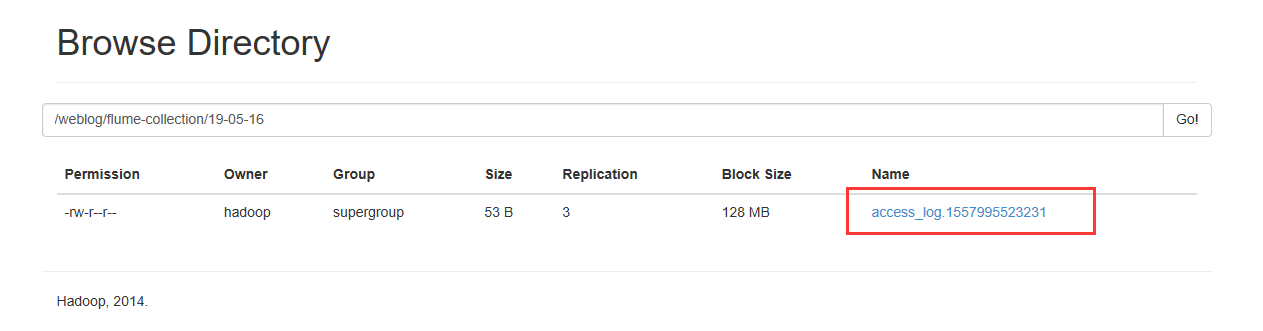

agent1.sinks.sink1.hdfs.path =hdfs://node1/weblog/flume-collection/%y-%m-%d/

agent1.sinks.sink1.hdfs.filePrefix = access_log

agent1.sinks.sink1.hdfs.maxOpenFiles =

agent1.sinks.sink1.hdfs.batchSize=

agent1.sinks.sink1.hdfs.fileType = DataStream

agent1.sinks.sink1.hdfs.writeFormat =Text

agent1.sinks.sink1.hdfs.rollSize =

agent1.sinks.sink1.hdfs.rollCount =

agent1.sinks.sink1.hdfs.rollInterval =

#agent1.sinks.sink1.hdfs.round = true

#agent1.sinks.sink1.hdfs.roundValue =

#agent1.sinks.sink1.hdfs.roundUnit = minute

agent1.sinks.sink1.hdfs.useLocalTimeStamp = true

# Use a channel which buffers events in memory

agent1.channels.channel1.type = memory

agent1.channels.channel1.keep-alive =

agent1.channels.channel1.capacity =

agent1.channels.channel1.transactionCapacity = # Bind the source and sink to the channel

agent1.sources.source1.channels = channel1

agent1.sinks.sink1.channel = channel1

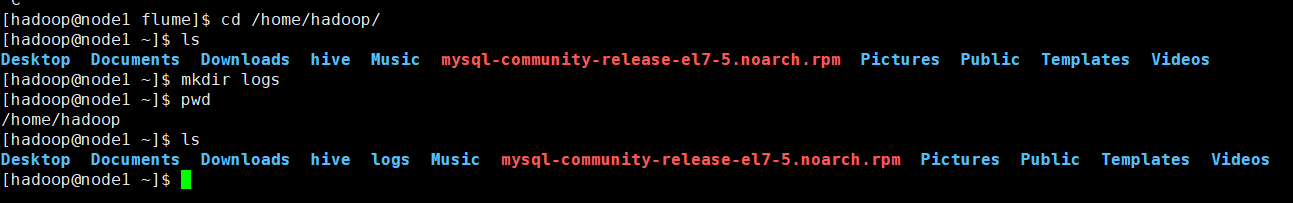

在本地创建目录

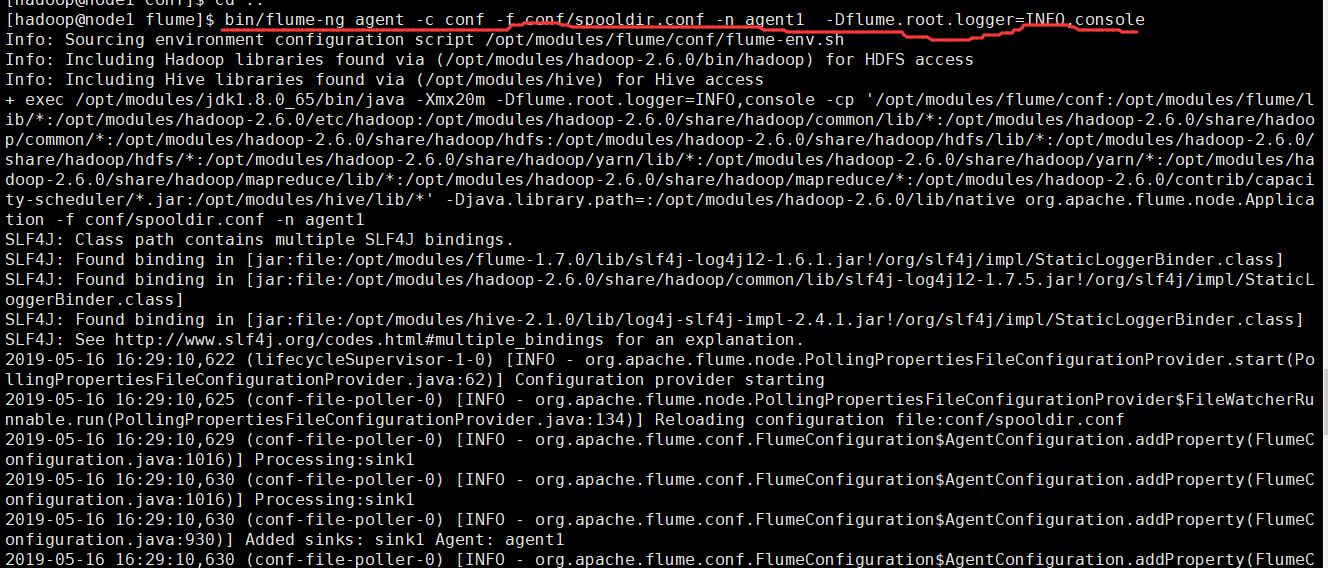

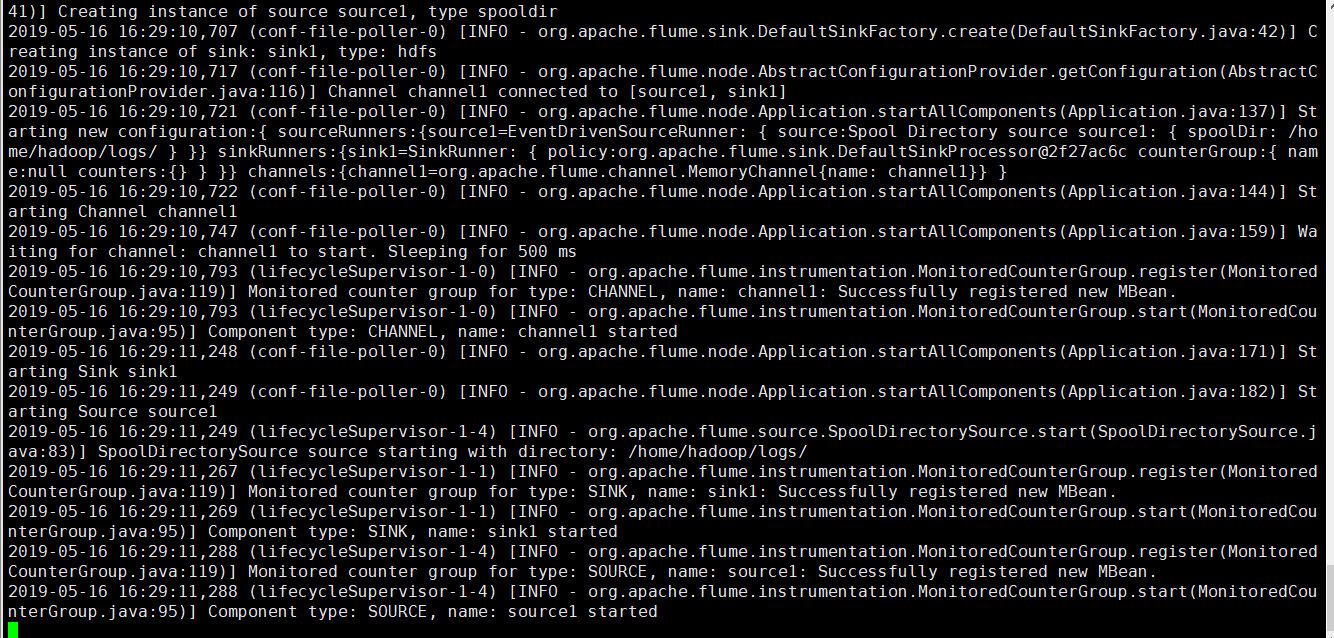

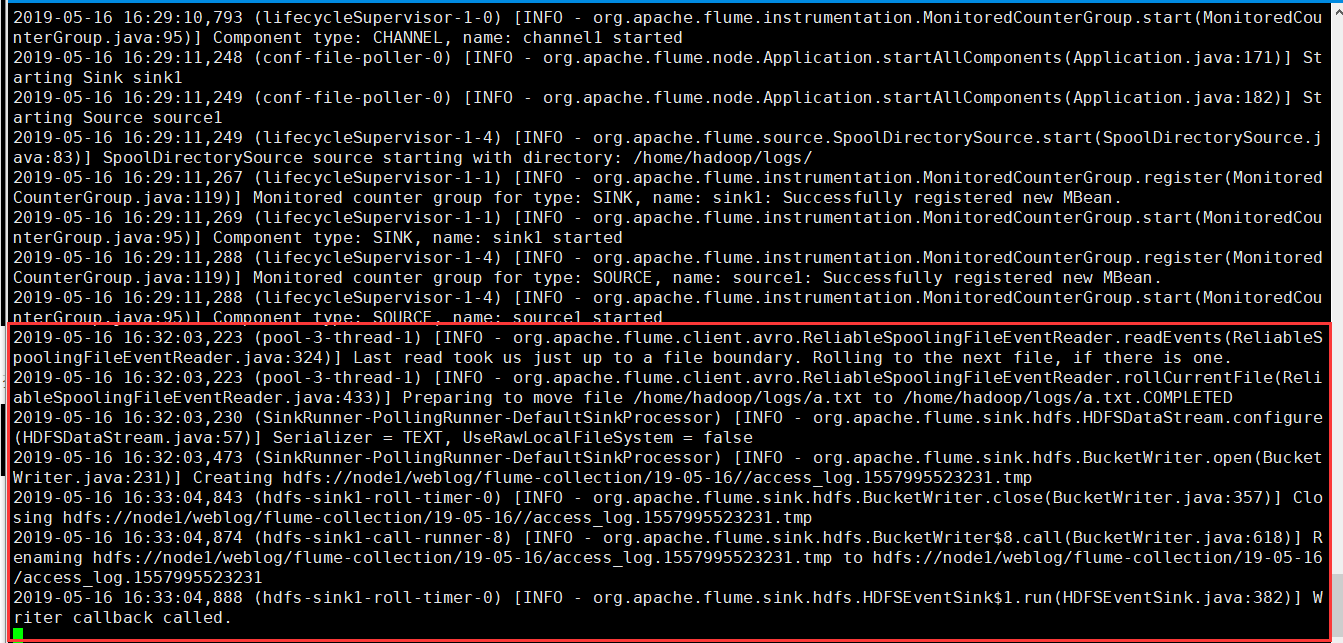

运行flume

bin/flume-ng agent -c conf -f conf/spooldir.conf -n agent1 -Dflume.root.logger=INFO,console

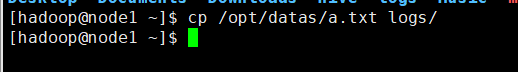

把a.txt数据文件拷贝到被监听的本地目录下

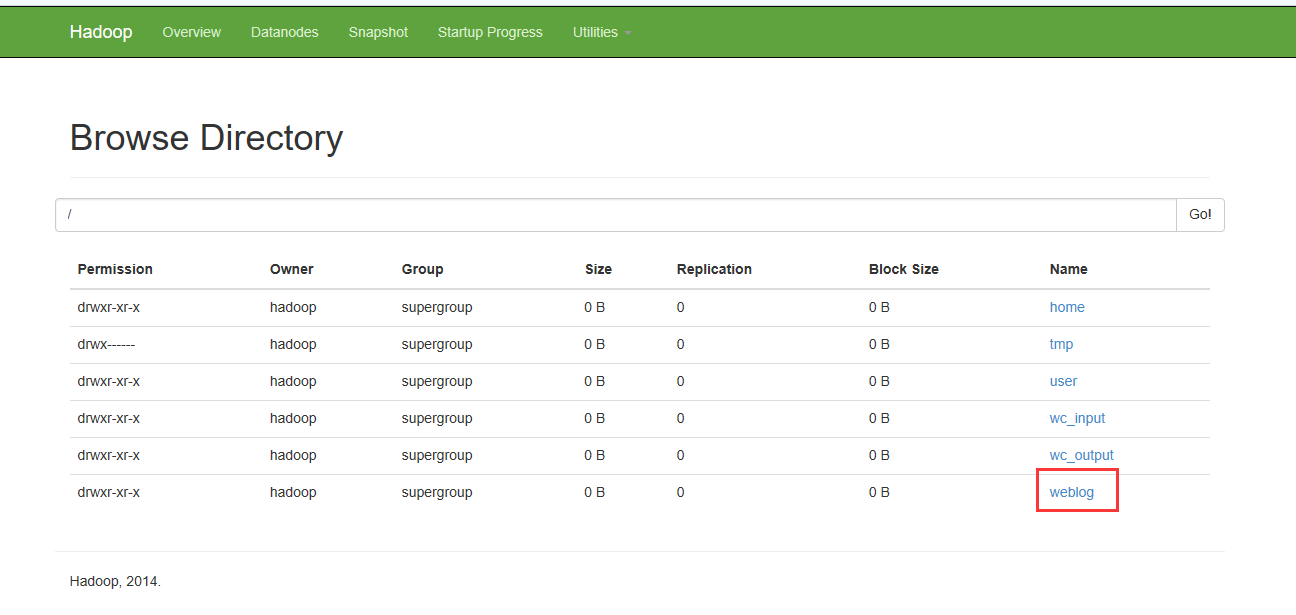

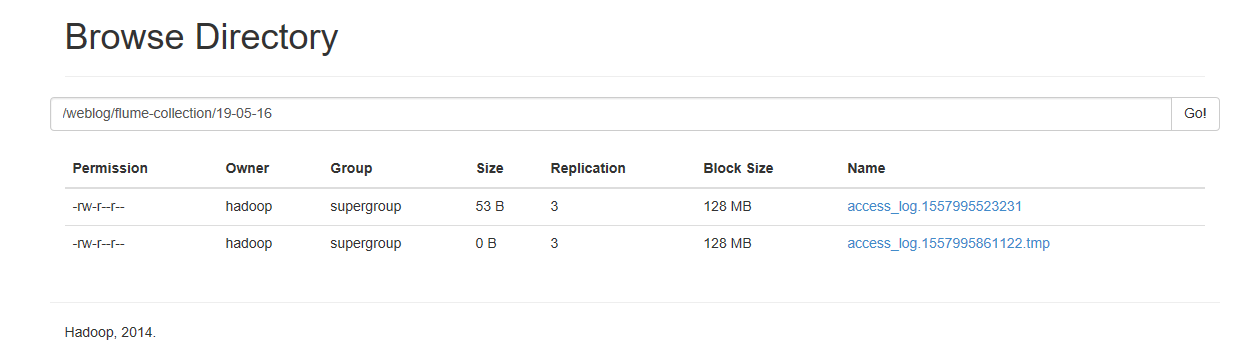

HDFS上多了个目录

我们再上传一个数据文件到本地的监听目录下

采集文件到HDFS

采集需求:比如业务系统使用log4j生成的日志,日志内容不断增加,需要把追加到日志文件中的数据实时采集到hdfs

根据需求,首先定义以下3大要素

1. 采集源,即source——监控文件内容更新 : exec ‘tail -F file’

即时输出文件变化后追加的数据。

tail -f file 动态跟踪文件file的增长情况,tail会每隔一秒去检查一下文件是否增加新的内容。如果增加就追加在原来的输出后面显示。但这种情况,必须保证在执行tail命令时,文件已经存在。

2.下沉目标,即sink——HDFS文件系统 : hdfs sink

3. Source和sink之间的传递通道——channel,可用file channel 也可以用 内存channel

首先创建一个配置文件

agent1.sources = source1

agent1.sinks = sink1

agent1.channels = channel1 # Describe/configure tail -F source1

agent1.sources.source1.type = exec

agent1.sources.source1.command = tail -F /home/hadoop/logs/access_log

agent1.sources.source1.channels = channel1 #configure host for source

agent1.sources.source1.interceptors = i1

agent1.sources.source1.interceptors.i1.type = host

agent1.sources.source1.interceptors.i1.hostHeader = hostname # Describe sink1

agent1.sinks.sink1.type = hdfs

#a1.sinks.k1.channel = c1

agent1.sinks.sink1.hdfs.path =hdfs://node1/weblog/flume/%y-%m-%d/

agent1.sinks.sink1.hdfs.filePrefix = access_log

agent1.sinks.sink1.hdfs.maxOpenFiles =

agent1.sinks.sink1.hdfs.batchSize=

agent1.sinks.sink1.hdfs.fileType = DataStream

agent1.sinks.sink1.hdfs.writeFormat =Text

agent1.sinks.sink1.hdfs.rollSize =

agent1.sinks.sink1.hdfs.rollCount =

agent1.sinks.sink1.hdfs.rollInterval =

#agent1.sinks.sink1.hdfs.round = true

#agent1.sinks.sink1.hdfs.roundValue =

#agent1.sinks.sink1.hdfs.roundUnit = minute

agent1.sinks.sink1.hdfs.useLocalTimeStamp = true # Use a channel which buffers events in memory

agent1.channels.channel1.type = memory

agent1.channels.channel1.keep-alive =

agent1.channels.channel1.capacity =

agent1.channels.channel1.transactionCapacity = # Bind the source and sink to the channel

agent1.sources.source1.channels = channel1

agent1.sinks.sink1.channel = channel1

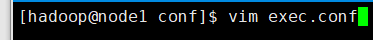

配置完后就启动flume

bin/flume-ng agent -c conf -f conf/exec.conf -n agent1 -Dflume.root.logger=INFO,console

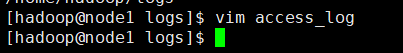

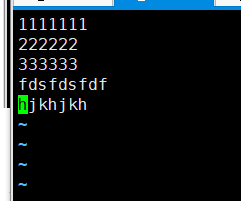

先在本地的被监听目录下创建log日志文件,并往改文件写入内容

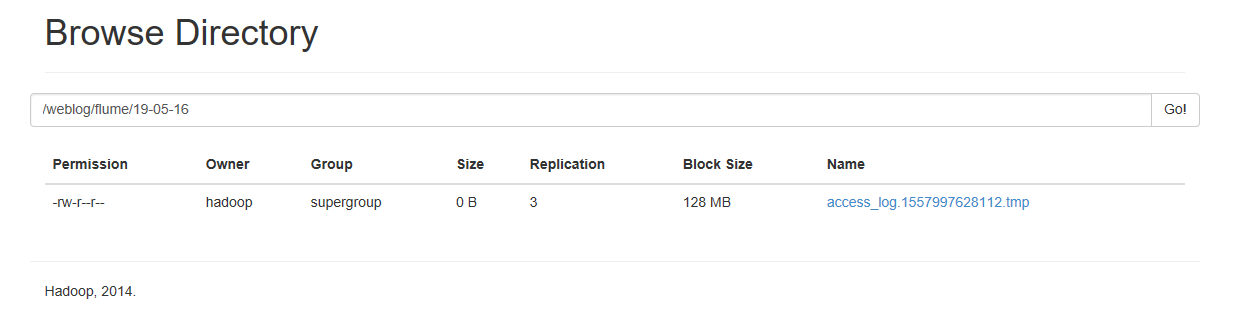

可以看到HDFS的目录上产生了对于的日志文件

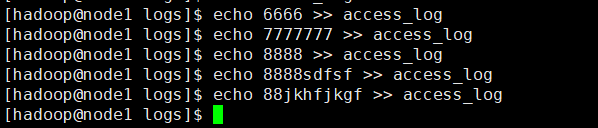

我们给监听文件继续追加内容

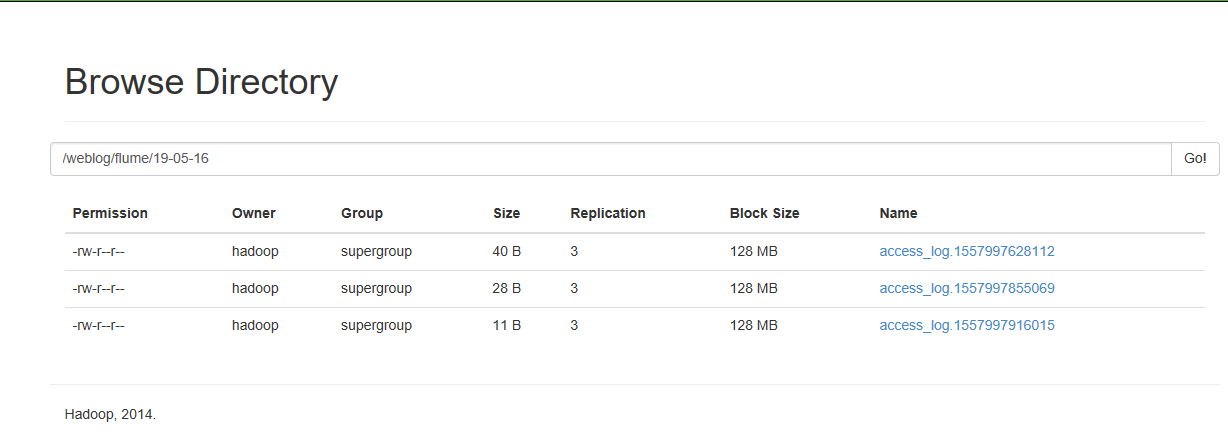

HDFS同时会更新日志文件

12.Flume的安装的更多相关文章

- Centos7的安装、Docker1.12.3的安装,以及Docker Swarm集群的简单实例

目录 [TOC] 1.环境准备 本文中的案例会有四台机器,他们的Host和IP地址如下 c1 -> 10.0.0.31 c2 -> 10.0.0.32 c3 -> 10.0.0. ...

- Angularjs学习---angularjs环境搭建,ubuntu 12.04下安装nodejs、npm和karma

1.下载angularjs 进入其官网下载:https://angularjs.org/,建议下载最新版的:https://ajax.googleapis.com/ajax/libs/angular ...

- Flume的安装与配置

Flume的安装与配置 一. 资源下载 资源地址:http://flume.apache.org/download.html 程序地址:http://apache.fayea.com/fl ...

- 如何在ubuntu 12.04 中安装经典的 GNOME桌面

这次介绍的是如何在ubuntu 12.04 中安装经典的 GNOME桌面,默认的 Ubuntu 12.04 默认unity桌面,一些用户不喜欢 Unity 桌面,所以想找回昔日的经典Gnome桌面. ...

- 对<< ubuntu 12.04编译安装linux-3.6.10内核笔记>>的修正

前题: 在前几个月的时候,写了一篇笔记,说的是kernel compile的事情,当时经验不足,虽说编译过了,但有些地方写的有错误--因为当时的理解是有错误的.今天一一更正,记录如下: 前文笔记链接: ...

- Ubuntu 12.04 下安装 Eclipse

方法一:(缺点是安装时附加openjdk等大量程序并无法去除,优点是安装简单) $ sudo apt-get install eclipse 方法二:(优点是安装内容清爽,缺点是配置麻烦)1.安装JD ...

- VMware Workstation 12 Pro 之安装Windows10 EP系统

VMware Workstation 12 Pro 之安装Windows10 EP系统... --------------- 先准备好要用的Win10的镜像文件ISO ---------------- ...

- VMware Workstation 12 Pro 之安装林耐斯Ubuntu X64系统

VMware Workstation 12 Pro 之安装林耐斯Ubuntu X64系统... -------------- Linux依照国际音标应该是/'linэks/——类似于“里讷克斯&quo ...

- VMware Workstation 12 Pro 之安装林耐斯Debian X64系统

VMware Workstation 12 Pro 之安装林耐斯Debian X64系统... --------------------- 看到它的LOGO就很喜欢: ---------------- ...

随机推荐

- centos6.5linux安装docker之升级内核

一.运行docker Linux内核版本需要在3.8以上,针对centos6.5 内核为2.6的系统需要先升级内核.不然会特别卡 在yum的ELRepo源中,有mainline(4.5).long-t ...

- Vue 项目中对路由文件进行拆分(解构的方法)

项目需求场景: 在开发项目过程中,在项目过于庞大,路由信息非常多的情况下,如果将路由配置信息都放在一个文件里面,那么这个JS是不方便维护的, 那么,这个时候需要我们把这个庞大的路由文件,根据项目功能分 ...

- AGC029C - Lexicographic constraints

记录我心路历程吧,这道小水题暴露出我很多问题. 给定 \(n\) 个字符串长度 \(a_i\) ,求字符集最小多大,才能构造出按字典序比较 \(s_1 < s_2 < \dots < ...

- Python实用黑科技——解包元素(2)

需求: 前面的文章讲的是使用变量的个数需要和迭代器数据变量的元素个数相同的方法,但更多的时候确实不想根据元素个数n来定义相应多的变量,而是希望用较少的变量( def drop_first_last(g ...

- Jury Compromise

K - Jury Compromise 参考:ACM POJ 1015 Jury Compromise(陪审团的人选,动态规划题,难) 说实话真有点难想,用一个DP[i][j]来表示在选取i个人,辩控 ...

- Java基础_线程的使用及创建线程的三种方法

线程:线程是操作系统能够进行运算调度的最小单位.它被包含在进程之中,是进程中的实际运作单位.一条线程指的是进程中一个单一顺序的控制流,一个进程中可以并发多个线程,每条线程并行执行不同的任务. 进程:进 ...

- 8.6 JavaScript之HTML的DOM(三)

8.5 HTML和JavaScript的DOM(三) 一.DOM 是Document Object Model( 文档对象模型 )的缩写. DOM把所有的html都转换为节点 .整个文档 是一个节点 ...

- 使用Spring基于应用层实现读写分离(一)基础版

背景 我们一般应用对数据库而言都是“读多写少”,也就说对数据库读取数据的压力比较大,有一个思路就是说采用数据库集群的方案, 其中一个是主库,负责写入数据,我们称之为:写库: 其它都是从库,负责读取数据 ...

- dos切换其他目录加参数/D

D:\>cd /D c:\Windows c:\Windows> 不加参数/D 无法切换到另一个盘符

- 对 Python 迭代的深入研究

在程序设计中,通常会有 loop.iterate.traversal 和 recursion 等概念,他们各自的含义如下: 循环(loop),指的是在满足条件的情况下,重复执行同一段代码.比如 Pyt ...