『cs231n』线性分类器损失函数

代码部分

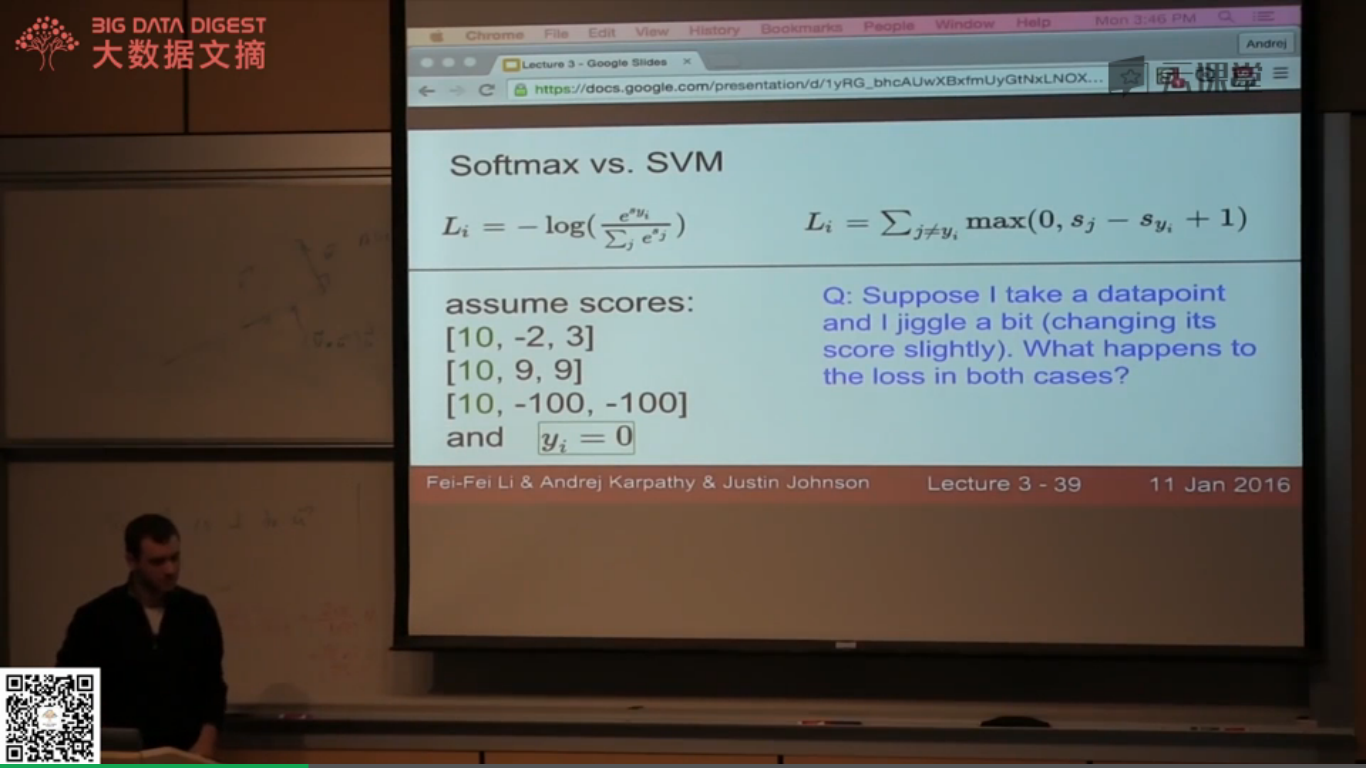

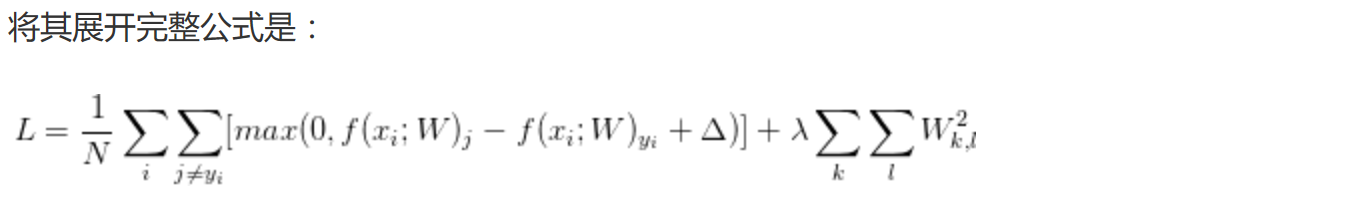

SVM损失函数 & SoftMax损失函数:

注意一下softmax损失的用法:

SVM损失函数:

import numpy as np def L_i(x, y, W):

'''

非向量化SVM损失计算

:param x: 输入矢量

:param y: 标准分类

:param W: 参数矩阵

:return:

'''

delta = 1.0

scores = W.dot(x)

correct_score = scores[y]

D = W.shap[0]

loss_i = 0.0

for j in range(D):

if j==y:

continue

loss_i += max(0.0, scores[j] - correct_score + delta)

return loss_i def L_i_vectorized(x, y, W):

'''

半向量化SVM损失计算

:param x: 输入矢量

:param y: 标准分类

:param W: 参数矩阵

:return:

'''

delta = 1.0

scores = W.dot(x)

margins = np.maximum(0, scores - scores[y] + delta)

margins[y] = 0

loss_i = np.sum(margins)

return loss_i

softmax分类器:

import numpy as np # 正常的softmax分类器

f = np.array([123, 456, 789])

# p = np.exp(f) / np.sum(np.exp(f))

# print(p) # 数值稳定化的softmax分类器

f -= np.max(f)

p = np.exp(f) / np.sum(np.exp(f))

print(p)

SoftMax实际应用

练习,softmax 模型:

Note: 你的 softmax(x) 函数应该返回一个形状和x相同的NumPy array类型。

例如,当输入为一个列表或者一维矩阵(用列向量表示一个样本样本)时,比如说以下的:

scores = [1.0, 2.0, 3.0]

应该返回一个同样长度(即3个元素)的一维矩阵:

print softmax(scores)

[ 0.09003057 0.24472847 0.66524096]

对于一个二维矩阵,如以下(列向量表示单个样本),例如:

scores = np.array([[1, 2, 3, 6],

[2, 4, 5, 6],

[3, 8, 7, 6]])

该函数应该返回一个同样大小(3,4)的二维矩阵,如以下:

[[ 0.09003057 0.00242826 0.01587624 0.33333333]

[ 0.24472847 0.01794253 0.11731043 0.33333333]

[ 0.66524096 0.97962921 0.86681333 0.33333333]]

每个样本(列向量)中的概率加起来应当等于 1。你可以用以上的例子来测试你的函数。

ANSWER:

"""Softmax.""" scores = [3.0, 1.0, 0.2] import numpy as np def softmax(x):

"""Compute softmax values for each sets of scores in x."""

return np.exp(x)/np.sum(np.exp(x),axis=0) print(softmax(scores)) # Plot softmax curves

import matplotlib.pyplot as plt

x = np.arange(-2.0, 6.0, 0.1)

scores = np.vstack([x, np.ones_like(x), 0.2 * np.ones_like(x)])

plt.plot(x, softmax(scores).T, linewidth=2)

plt.show()

比较好玩的是plt.plot(x, softmax(scores).T)中,后面的转置了,多线画图时,后面的都是要转置的,因为plt必须要求x和y第一维度大小相等:

plt.plot(np.linspace(0,1,100),np.asarray([10*np.linspace(0,2,100),10*np.linspace(0,1,100)]).T,linewidth=2)

# 可以绘图

# 查看一下shape:

np.linspace(0,1,100).shape

# Out[26]:

# (100,)

np.asarray([10*np.linspace(0,2,100),10*np.linspace(0,1,100)]).shape

# Out[25]:

# (2, 100)

# 必须对应x,y的第一维度大小

SoftMax特点

SoftMax(y*10)后分类器会更自信,SoftMax(y/10)后分类器会失去自信(结果概率平均化)

概念部分

损失函数=代价函数=目标函数

损失函数=代价函数=目标函数

svm给出一个得分,softmax给出一个概率。

『cs231n』线性分类器损失函数的更多相关文章

- 『cs231n』计算机视觉基础

线性分类器损失函数明细: 『cs231n』线性分类器损失函数 最优化Optimiz部分代码: 1.随机搜索 bestloss = float('inf') # 无穷大 for num in range ...

- 『cs231n』通过代码理解风格迁移

『cs231n』卷积神经网络的可视化应用 文件目录 vgg16.py import os import numpy as np import tensorflow as tf from downloa ...

- cs331n 线性分类器损失函数与最优化

tip:老师语速超快...痛苦= = 线性分类器损失函数与最优化 \(Multiclass SVM loss: L_{i} = \sum_{j \neq y_{i}} max(0,s_{i}-s_{y ...

- 『cs231n』视频数据处理

视频信息 和我之前的臆想不同,视频数据不仅仅是一帧一帧的图片本身,还包含个帧之间的联系,也就是还有一个时序的信息维度,包含人的动作判断之类的任务都是要依赖动作的时序信息的 视频数据处理的两种基本方法 ...

- 『cs231n』绪论

笔记链接 cs231n系列所有图片笔记均拷贝自网络,链接如上,特此声明,后篇不再重复. 计算机视觉历史 总结出视觉两个重要结论:1.基础的视觉神经识别的是简单的边缘&轮廓2.视觉是分层的 数据 ...

- 『cs231n』通过代码理解gan网络&tensorflow共享变量机制_上

GAN网络架构分析 上图即为GAN的逻辑架构,其中的noise vector就是特征向量z,real images就是输入变量x,标签的标准比较简单(二分类么),real的就是tf.ones,fake ...

- 『cs231n』无监督学习

经典无监督学习 聚类 K均值 PCA主成分分析 等 深度学习下的无监督学习 自编码器 传统的基于特征学习的自编码器 变种的生成式自编码器 Gen网络(对抗式生成网络) 传统自编码器 原理 类似于一个自 ...

- 『cs231n』RNN之理解LSTM网络

概述 LSTM是RNN的增强版,1.RNN能完成的工作LSTM也都能胜任且有更好的效果:2.LSTM解决了RNN梯度消失或爆炸的问题,进而可以具有比RNN更为长时的记忆能力.LSTM网络比较复杂,而恰 ...

- 『cs231n』循环神经网络RNN

循环神经网络 循环神经网络介绍摘抄自莫凡博士的教程 序列数据 我们想象现在有一组序列数据 data 0,1,2,3. 在当预测 result0 的时候,我们基于的是 data0, 同样在预测其他数据的 ...

随机推荐

- bootstrap实战教程

bootstrap实战教程 bootstrap介绍 简介 Bootstrap 是最受欢迎的 HTML.CSS 和 JS 框架,用于开发响应式布局.移动设备优先的 WEB 项目.全球数以百万计的网站都是 ...

- fastDFS errcode:9 path:Bad file descriptor errcode:22 path:Invalid argument

fastDFS errcode:9 path:Bad file descriptor errcode:22 path:Invalid argument <error>status:4 er ...

- mysql 替换函数replace()实现mysql 替换字符串

mysql 替换字符串的实现方法:mysql中replace函数直接替换mysql数据库中某字段中的特定字符串,不再需要自己写函数去替换,用起来非常的方便,mysql 替换函数replace()Upd ...

- ES6学习笔记之map、set与数组、对象的对比

ES6 ES5中的数据结构,主要是用Array和Object.在ES6中主要新增了Set和Map数据结构.到目前为止,常用的数据结构有四种Array.Object.Set.Map.下面话不多说了,来一 ...

- ELK学习笔记之ELK分析nginx日志

0x00 配置FIlebeat搜集syslog #安装 rpm -ivh filebeat-6.2.3-x86_64.rpm mv /etc/filebeat/filebeat.yml /etc/fi ...

- mysql 批处理文件出错后继续执行

在升级批处理sql脚本的时候,由于各种编写的不规范.不可重复执行,我们通常希望在sql脚本出错后不中止,而是执行完成.虽然这些问题可通过编写可重复执行的mysql存储过程比如add_column/dr ...

- QTQuick控件基础(3)视图

1.spliteview 2.stackview ApplicationWindow {visible: truewidth: 640height: 480MouseArea{anchors.fill ...

- SQL语句 查询同一个字符在某一个字符串中出现的次数

select len(replace(字段名A,';','--'))-len(字段名A) from table表名

- 51nod 1199 Money out of Thin Air(线段树+树剖分)

http://www.51nod.com/onlineJudge/questionCode.html#!problemId=1199 题意: 思路:因为是一棵树,所以需要把它剖分一下再映射到线段树上, ...

- BZOJ 1005: [HNOI2008]明明的烦恼(prufer数列)

http://www.lydsy.com/JudgeOnline/problem.php?id=1005 题意: Description 自从明明学了树的结构,就对奇怪的树产生了兴趣......给出标 ...