Kafka:Springboot整合Kafka消息队列

本文主要分享下Spring Boot和Spring Kafka如何配置整合,实现发送和接收来自Spring Kafka的消息。

项目结构

pom依赖包

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion> <groupId>com.java.zy</groupId>

<artifactId>base-kafka</artifactId>

<version>1.0-SNAPSHOT</version> <parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>2.1.2.RELEASE</version>

<relativePath/>

</parent> <dependencies> <dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>1.2.47</version>

</dependency> <dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency> <!--引入kafak和spring整合的jar-->

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

<version>2.2.8.RELEASE</version>

</dependency> <!-- https://mvnrepository.com/artifact/org.springframework.kafka/spring-kafka-test -->

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka-test</artifactId>

<version>2.2.8.RELEASE</version>

<scope>test</scope>

</dependency> </dependencies> </project>

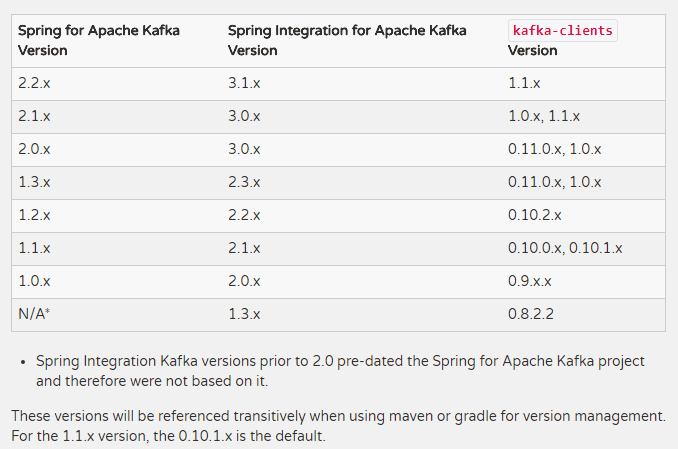

Springboot+kafka对应表

JAVA代码

定义数据传输对象

package com.java.common.entity; import org.springframework.stereotype.Component; @Component

public class UserLog { private String username;

private String userid;

private String state; public String getUsername() {

return username;

} public void setUsername(String username) {

this.username = username;

} public String getUserid() {

return userid;

} public void setUserid(String userid) {

this.userid = userid;

} public String getState() {

return state;

} public void setState(String state) {

this.state = state;

}

}

定义发送信息实体 ( 消息的发送直接使用KafkaTemplate模板即可,都封装好了,直接使用 )

package com.java.common.controller; import com.alibaba.fastjson.JSON;

import com.java.common.entity.UserLog;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.kafka.core.KafkaTemplate;

import org.springframework.stereotype.Component; @Component

public class UserLogProducer { @Autowired

private KafkaTemplate kafkaTemplate; /**

* 发送数据

* @param userid

*/

public void sendLog(String userid){

UserLog userLog = new UserLog();

userLog.setUsername("jhp");

userLog.setUserid(userid);

userLog.setState("0");

System.err.println("发送用户日志数据:"+userLog);

kafkaTemplate.send("user-log", JSON.toJSONString(userLog));

} }

获取消息的消费者实体

注意:消费机制是通过监听器实现的,直接使用@KafkaListener(topics = {"user-log"})注解,根据指定的条件进行消息的监听

package com.java.common.controller; import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.springframework.kafka.annotation.KafkaListener;

import org.springframework.stereotype.Component; import java.util.Optional; @Component

public class UserLogConsumer { @KafkaListener(topics = {"user-log"})

public void consumer(ConsumerRecord<?,?> consumerRecord){

//判断是否为null

Optional<?> kafkaMessage = Optional.ofNullable(consumerRecord.value());

System.out.println(">>>>>>>>>> record = " + kafkaMessage);

if(kafkaMessage.isPresent()){

//得到Optional实例中的值

Object message = kafkaMessage.get();

System.err.println("消费消息:"+message);

}

} }

Springboot应用启动类(方便测试,在容器初始化的就开始模拟消息的发送)

package com.java.common; import com.java.common.controller.UserLogProducer;

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication; import javax.annotation.PostConstruct; @SpringBootApplication

public class KafkaApplication { @Autowired

private UserLogProducer kafkaSender;

@PostConstruct

public void init(){

for (int i = 0; i < 10; i++) {

//调用消息发送类中的消息发送方法

kafkaSender.sendLog(String.valueOf(i));

}

} public static void main(String[] args) {

SpringApplication.run(KafkaApplication.class,args);

} }

对应的application.properties配置文件

spring.application.name=base-kafka

server.port=8080

#============== kafka ===================

# 指定kafka 代理地址,可以多个

spring.kafka.bootstrap-servers=localhost:9092,192.168.100.1:9093 #=============== provider =======================

spring.kafka.producer.retries=0

# 每次批量发送消息的数量

spring.kafka.producer.batch-size=16384

spring.kafka.producer.buffer-memory=33554432

# 指定消息key和消息体的编解码方式

spring.kafka.producer.key-serializer=org.apache.kafka.common.serialization.StringSerializer

spring.kafka.producer.value-serializer=org.apache.kafka.common.serialization.StringSerializer #=============== consumer =======================

# 指定默认消费者group id

spring.kafka.consumer.group-id=user-log-group

spring.kafka.consumer.auto-offset-reset=earliest

spring.kafka.consumer.enable-auto-commit=true

spring.kafka.consumer.auto-commit-interval=100

# 指定消息key和消息体的编解码方式

spring.kafka.consumer.key-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.consumer.value-deserializer=org.apache.kafka.common.serialization.StringDeserializer

对应的application.yml配置文件

server:

port: 8080 spring:

application:

name: base-kafka

#============== kafka ===================

# 指定kafka 代理地址,可以多个

kafka:

bootstrap-servers: 192.168.200.27:19092 #=============== provider =======================

producer:

retries: 0

# 每次批量发送消息的数量

batch-size: 16384

buffer-memory: 33554432

# 指定消息key和消息体的编解码方式

key-serializer: org.apache.kafka.common.serialization.StringSerializer

value-serializer: org.apache.kafka.common.serialization.StringSerializer #=============== consumer =======================

consumer:

# 指定默认消费者group id(消息组)

group-id: user-log

auto-offset-reset: earliest

enable-auto-commit: true

auto-commit-interval: 100

# 指定消息key和消息体的编解码方式

key-serializer: org.apache.kafka.common.serialization.StringSerializer

value-serializer: org.apache.kafka.common.serialization.StringSerializer

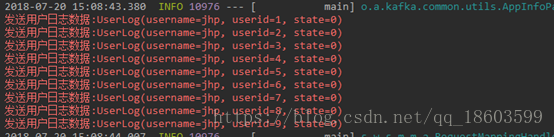

测试结果

启动项目,观察控制台打印的消息

和

springboot和kafka成功整合!

文章转载至:https://blog.csdn.net/qq_18603599/article/details/81169488

Kafka:Springboot整合Kafka消息队列的更多相关文章

- springBoot(11)---整合Active消息队列

Springboot整合Active消息队列 简单理解: Active是Apache公司旗下的一个消息总线,ActiveMQ是一个开源兼容Java Message Service(JMS) 面向消息的 ...

- SpringBoot系列八:SpringBoot整合消息服务(SpringBoot 整合 ActiveMQ、SpringBoot 整合 RabbitMQ、SpringBoot 整合 Kafka)

声明:本文来源于MLDN培训视频的课堂笔记,写在这里只是为了方便查阅. 1.概念:SpringBoot 整合消息服务 2.具体内容 对于异步消息组件在实际的应用之中会有两类: · JMS:代表作就是 ...

- SpringBoot整合Kafka和Storm

前言 本篇文章主要介绍的是SpringBoot整合kafka和storm以及在这过程遇到的一些问题和解决方案. kafka和storm的相关知识 如果你对kafka和storm熟悉的话,这一段可以直接 ...

- SpringBoot整合kafka(安装)

项目路径:https://github.com/zhaopeng01/springboot-study/tree/master/study_14 序言 Kafka 是一种高吞吐的分布式发布订阅消息系统 ...

- SpringBoot整合Kafka

一.准备工作 提前启动zk,kafka,并且创建一个Topic("Hello-Kafk") bin/kafka-topics.sh --create --zookeeper 192 ...

- 为什么要用kafka、rabbit等消息队列

1.解耦: 允许你独立的扩展或修改两边的处理过程,只要确保它们遵守同样的接口约束. 2.冗余: 消息队列把数据进行持久化直到它们已经被完全处理,通过这一方式规避了数据丢失风险.许多消息队列所采用的&q ...

- SpringBoot日记——MQ消息队列整合(一)

除了之前讲到的缓存,我们还会用到消息队列来存储一些消息,为了提升系统的异步性能等等: 消息服务有两个概念需要知道:消息代理-message broker,目的地-destination.消息发送由代理 ...

- Kafka,Mq,Redis作为消息队列有何差异?

Kafka作为新一代的消息系统,mq是比较成熟消息系统,而redis也可以发布订阅,那么这三者有何异同? RabbitMQ 是使用Erlang编写的一个开源的消息队列,本身支持很多的协议:AMQP,X ...

- springboot 整合kafka

本文介绍如何在springboot项目中集成kafka收发message. 1.先解决依赖 springboot相关的依赖我们就不提了,和kafka相关的只依赖一个spring-kafka集成包 &l ...

随机推荐

- shell基础之综合练习

0.脚本一键完成下面所有操作1.准备2台centos7系统的服务器,远程互相免密登录,以下所有题目过程中开启防火墙2.给1号机和2号机使用光盘搭建本地yum源(永久生效)3.给服务器1添加2块硬盘,1 ...

- mysql8 安装配置教程

第一步 下载安装包 MySQL 是甲骨文(Oracle)公司产品,可以到官网上下载 MySQL: 官网下载地址:https://dev.mysql.com/downloads/mysql/ 如果嫌弃官 ...

- 优秀电路资料--- IOT方案

完整的IOT方案 http://www.cirmall.com/circuit/4117/%E3%80%90%E5%BC%80%E6%BA%90%E3%80%91%E5%AE%8C%E6%95%B4% ...

- 处理SpringMVC中遇到的乱码问题

乱码在日常开发写代码中是非常常见的,以前乱码使用的是通过设置一个过滤器解决, 现在可以使用SpringMVC给提供的过滤器,在web.xml设置,这比我们自己写的过滤器强大的的多. 注意:每次修改了x ...

- GO语言基础---值传递与引用传递

package main import ( "fmt" ) /* 值传递 函数的[形式参数]是对[实际参数]的值拷贝 所有对地址中内容的修改都与外界的实际参数无关 所有基本数据类型 ...

- Python+Selenium学习笔记4 - submit&get_attribute

1.submit() submit()方法用于提交表单.如在搜索框输入关键字后按回车键进行查询操作,就可用submit()方法模拟.若不能按回车键进入下一步,则不能用submit()举例,百度的查询提 ...

- Spring的controller接受Date类型数据,接受枚举类型数据

1. Controller接收Date类型的数据 核心使用@DateTimeFormat(pattern = "yyyy-MM-dd HH:mm:ss") 来将传递过来的时间字符串 ...

- SpringCloud Alibaba实战(3:存储设计与基础架构设计)

1.存储设计 在上一章中,我们已经完成了基本业务流程的梳理和服务模块的划分,接下来,开始设计数据存储. 虽然在微服务的理论中,没有对数据库定强制性的规范,但一般,服务拆分之后,数据库也会对应的拆分. ...

- CVPR2020最新论文扫描盘点(上)

CVPR2020最新论文扫描盘点(上) 最近计算机视觉三大顶会之一CVPR2020接收结果已经公布,一共有1470篇论文被接收,接收率为22%,相比去年降低3个百分点,竞争越来越激烈.这里整理来自Tw ...

- MLIR中间表示和编译器框架

MLIR中间表示和编译器框架 TensorFlow生态系统包含许多在软件和硬件堆栈的多个级别上运行的编译器和优化器.作为TensorFlow的日常用户,使用不同类型的硬件(GPU,TPU,移动设备)时 ...