python生成数据后,快速导入数据库

1、使用python生成数据库文件内容

# coding=utf-8

import random

import time

def create_user():

start = time.time()

count = 1000 # 一千万条数据

beginId = 200010000

with open(r"./userInfo.txt", "w") as fp:

for i in range(1,count+1):

id = str(i)

userId = beginId + i

name = ''.join(random.sample('zyxwvutsrqponmlkjihgfedcba', 4)).replace('', '')

sex = str(random.choice(['男', '女']))

weight = str(random.randrange(10, 99))

address = str(random.choice(['北京', '上海', '深圳', '广州', '杭州']))

insert_t_user_weight = (

"INSERT INTO t_user_weight VALUES ('%s', '%s', '%s','%s', '%s', '%s', '%s');"

% (id, userId, name, sex, weight, address, time.strftime("%Y-%m-%d %H:%M:%S", time.localtime()))

)

insert_t_user_weight = insert_t_user_weight + '\n'

# print(insert_t_user_weight)

fp.write(insert_t_user_weight)

print('共创建%d条sql耗时:'% count, time.time() - start)

if __name__ == "__main__":

create_user()

2、使用命令导入数据库

load data infile "/tmp/userInfo.txt" into table test_insert fields terminated by ',';

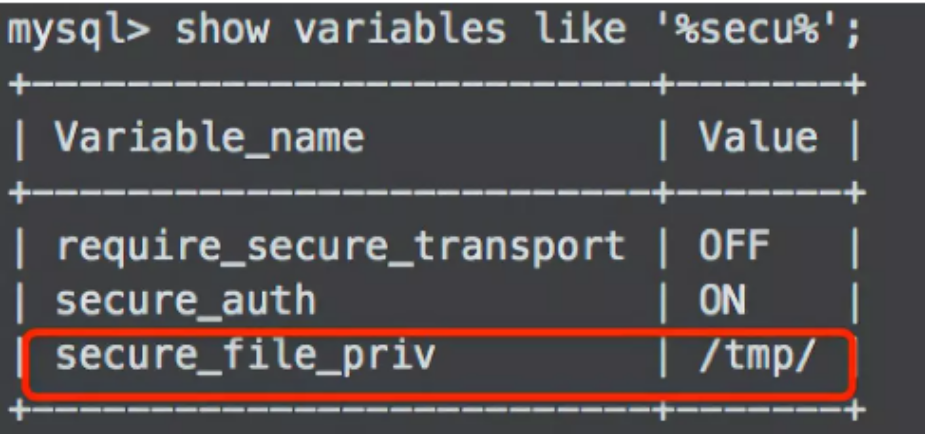

3、MYSQL导入数据出现The MySQL server is running with the --secure-file-priv option so it cannot execute this statement

这个原因是因为在安装MySQL的时候限制了导入与导出的目录权限,只能在规定的目录下才能导入,我们需要通过下面命令查看 secure-file-priv 当前的值是什么。

show variables like '%secure%';

只需要把相对应的文件放在上面的目录下,即可成功读取,而不会报上面的错误了。

python生成数据后,快速导入数据库的更多相关文章

- 图解JanusGraph系列 - 关于JanusGraph图数据批量快速导入的方案和想法(bulk load data)

大家好,我是洋仔,JanusGraph图解系列文章,实时更新~ 图数据库文章总目录: 整理所有图相关文章,请移步(超链):图数据库系列-文章总目录 源码分析相关可查看github(码文不易,求个sta ...

- mysql分批导出数据和分批导入数据库

mysql分批导出数据和分批导入数据库 由于某些原因,比如说测试环境有很多库,需要迁移到新的环境中,不需要导出系统库的数据.而数据库又有好多,如何才能将每个库导出到独立的文件中呢?导入到一个文件的话, ...

- [DJANGO] excel十几万行数据快速导入数据库研究

先贴原来的导入数据代码: 8 import os os.environ.setdefault("DJANGO_SETTINGS_MODULE", "www.setting ...

- excel十几万行数据快速导入数据库研究(转,下面那个方法看看还是可以的)

先贴原来的导入数据代码: 8 import os os.environ.setdefault("DJANGO_SETTINGS_MODULE", "www.setting ...

- python时间序列数据的对齐和数据库的分批查询

欲直接下载代码文件,关注我们的公众号哦!查看历史消息即可! 0. 前言 在机器学习里,我们对时间序列数据做预处理的时候,经常会碰到一个问题:有多个时间序列存在多个表里,每个表的的时间轴不完全相同,要如 ...

- DataTable 快速导入数据库——百万条数据只需几秒

public void InsertTable(DataTable dt, string TabelName, DataColumnCollection dtColum) { string str = ...

- 通过Python将Excel表格信息导入数据库

前言 公司原采用Excel表格方式记录着服务器资产信息,随着业务的增加,相应的硬件资产也增加,同时物理机虚拟化出多台虚拟机,存在表格管理杂乱.变更资产信息不能及时相互同步, 为了紧跟时代的步伐,老大搞 ...

- 包含LOB_Data列的表删除大量数据后表及数据库文件的收缩

最近有一张表(内含varchar(max)字段),占用空间达到240G,删除历史数据后几十万条后,空间并未得到释放. 然后用DBCC CLEANTABLE(0,tb_name,100)来释放删除记录后 ...

- Python生成gexf文件并导入gephi做网络图分析

Gephi是一款优秀的复杂网络分析软件,支持导入多种格式的文件.gexf格式是Gephi 推荐的格式,基于 XML.本文是一个用python写的简单Demo,示例如何生成一个典型的gexf格式文件.代 ...

随机推荐

- AOP注解使用详解

AOP为Aspect Oriented Programming的缩写,意为:面向切面编程,通过预编译方式和运行期动态代理实现程序功能的统一维护的一种技术.AOP是OOP的延续,是软件开发中的一个热点, ...

- Vofuria ARCamera相机问题

想要发射 射线 Camera.allCameras[0] 该语句来选择相机:Camera.main 此语句只能找到Tag为MainCamera的相机:

- 【sklearn】数据预处理 sklearn.preprocessing

数据预处理 标准化 (Standardization) 规范化(Normalization) 二值化 分类特征编码 推定缺失数据 生成多项式特征 定制转换器 1. 标准化Standardization ...

- intellij idea创建maven项目

1.安装好JDK,Tomcat,安装好maven: 2.配置maven全局变量:file->Other Settings ->Default Settings->Build,Exec ...

- ES6 语法学习(一)

1.let 和 const 关键字 let 与 var 的区别有: a.let 声明的变量只在当前的块级作用域内有效(块级作用域通俗的话就是被{}包裹起来的区域声明对象的{}例外). b.let 声明 ...

- python 2.7 数据结构之列表list: 基础面试总结

python 列表函数及方法: 函数如下: 1 cmp(list1,list2) 比较两个列表中的元素 2 len(list) 列表元素个数 3 max(list) 返回列表元素最大值 4 min(l ...

- sqlserver 脚本生成数据库文档

SELECT ( then d.name else '' end)表名, --a.colorder 字段序号, a.name 字段名, --(case ...

- 企业级中带你ELK如何实时收集分析Mysql慢查询日志

什么是Mysql慢查询日志? 当SQL语句执行时间超过设定的阈值时,便于记录到指定的日志文件中或者表中,所有记录称之为慢查询日志 为什么要收集Mysql慢查询日志? 数据库在运行期间,可能会存在这很多 ...

- Microsoft Office Word 中的公式自动编号

先插入公式,#,插入题注(交叉引用),生成了标号.此时整个公式是题注样式.在公式和标号之间插入一个样式分隔符. ____________________________________________ ...

- System优化

从系统方面考虑,性能通常取决于connection的连接效率和Integration Service所在机器的负荷程度,常见的原因有: 多用户同时使用 不同的网络协议 网络上有多个路由及转换 源和目标 ...