简单总结scrapy使用方法

应课程需要写了几天爬虫,一开始使用requests+bs4的技术路线,但是速度不是很理想而且不能暂停,通过查阅资料,发现scrapy正是我需要的

做一下简短的记录:

首先应该毫不犹豫的scrapy startproject gnspider;scrapy genspider gnspider http://www.chinanews.com;

然后定义items文件,写下我们希望爬虫下载的内容

紧接着去测试gnspider能否请求到网页

gnspider的写法

class GnspiderSpider(scrapy.Spider): name = “gnspider” #从seed页开始,放入start_urls = [] #seed页很多,则可以在def start_requests(self):重定义scrapy.Request(url),并返回由其组成的请求列表,即retuen [scrapy.Request(url),scrapy.Request(url),.....] def parse(self,response): #response是我们需要的网页的响应,我们通过css选择器或者xpath进行定位标签元素,这一步是最关键的,快速定位是必须的

response.css("div.content_list ul li div.dd_bt a::attr(href)").extract() #由于本科时了解过css,这里二话不说就用cssSelector,extract()是为了提取内容,结束提取则extract(),未结束则接着找标签。 response.css("div.left_zw p::text").extract() content_list=response.xpath('//div[@id=\"artibody\"]/p/text()').extract() big_urls=sel.xpath('//div[@id=\"tab01\"]/div/h3/a/@href').extract() #'http://news.sina.com.cn/guide'

big_titles=sel.xpath("//div[@id=\"tab01\"]/div/h3/a/text()").extract()

second_urls =sel.xpath('//div[@id=\"tab01\"]/div/ul/li/a/@href').extract()

second_titles=sel.xpath('//div[@id=\"tab01\"]/div/ul/li/a/text()').extract() divs = response.xpath("//div[@id='J_ItemList']/div[@class='product']/div") div.xpath("p[@class='productPrice']/em/@title")[0].extract() div.xpath("p[@class='productTitle']/a/@title")[0].extract() div.xpath("p[@class='productTitle']/a/@href")[0].extract() item["SHOP_NAME"] = div.xpath("li[1]/div/a/text()")[0].extract()

item["SHOP_URL"] = div.xpath("li[1]/div/a/@href")[0].extract()

item["COMPANY_NAME"] = div.xpath("li[3]/div/text()")[0].extract().strip()

item["COMPANY_ADDRESS"] = div.xpath("li[4]/div/text()")[0].extract().strip( #对于每个链接进行请求,这里我想强调的是meta这个参数,可以帮助我们将一级页面上爬到的内容传递到二级页面上,通过response.meta这个字典进行传递,非常方便我们对item进行组装 for li in lis: yield scrapy.Request(li,callback = self.parse_detail,meta={"cate":cate}) def parse_detail(self,response): #解析二级页面 #经常我们爬取的是一个列表 str1 = “”.join(lis) #split方法中不带参数时,表示分割所有换行符、制表符、空格。 str1 = replace(" ","").replace("\u3000","") return item

写gnspider的时候一定不要一口气写完,一定要一个函数一个函数的测,首先保证地址写对了,其次保证标签选对了,最后保证item组装好了,我把它称为爬虫三段式

既然爬到了内容就应该存下来留个纪念,通过pipelines定义存储方式,在这里使用文件存储

class MyspiderPipeline(object):

# def open_spider(self,spider):#针对爬虫

# self.f = open('gn.txt','a') # def close_spider(self,spider):

# self.f.close() def process_item(self, item, spider):#针对item

self.f = open(cate[item["CATEGORY"]] + '.txt','a') #注意文件操作,防止乱码

line = str(dict(item)["CONTENT"]) + '\n'

self.f.write(line)

self.f.close()

return item

最后别忘了在配置文件中启用pipelines

总结如下:

简单爬虫三步走,1.定义items,2.parse页面,3.pipelines定义存储方式

其中parse页面又分为三步1.写对网址,2.找到标签,3.组装item

scrapy还提供了暂停功能:开始爬虫时使用命令 scrapy crawl gnspider -s JOBDIR=supplement/auto

暂停时使用ctrl + c

再次启动时还使用命令 scrapy crawl gnspider -s JOBDIR=supplement/auto

当爬取大量数据时推荐写多个爬虫,同时进行,可使电脑资源发挥最大效果

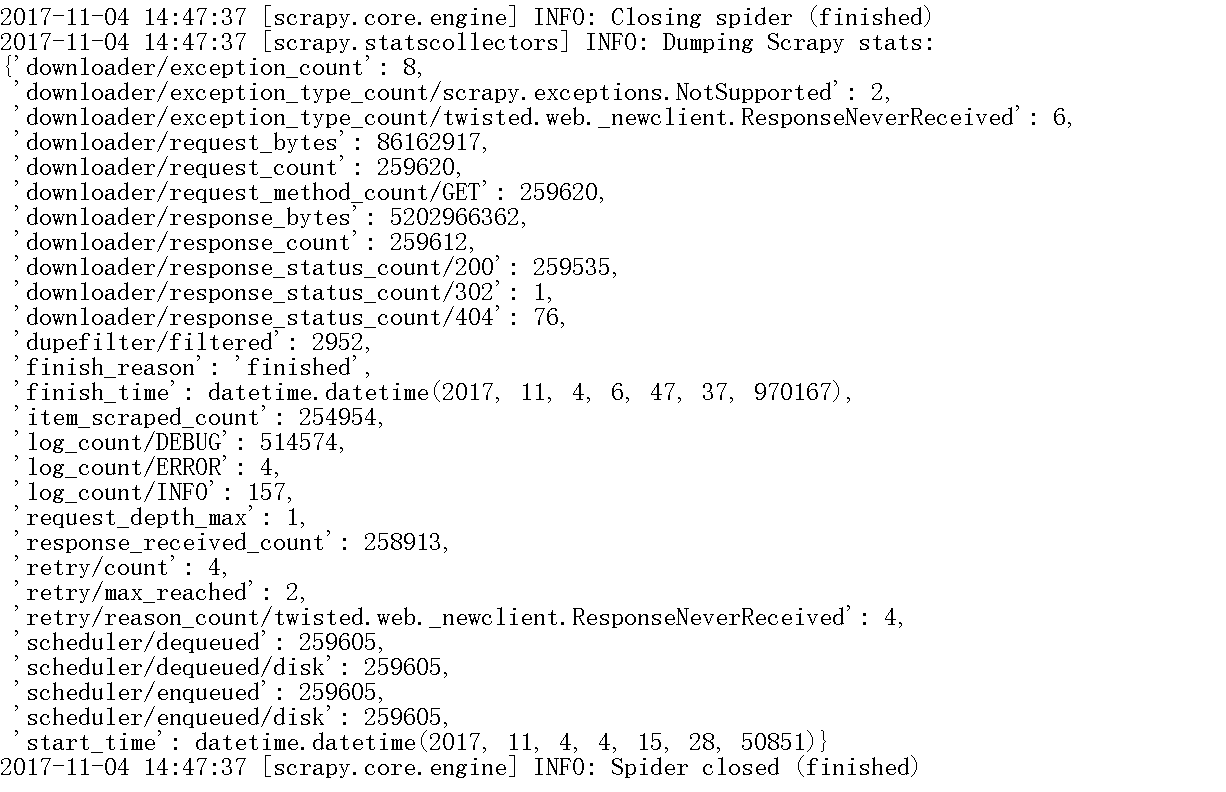

爬完结束提示信息如下

简单总结scrapy使用方法的更多相关文章

- 简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息

简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息 简单的scrapy实战:爬取腾讯招聘北京地区的相关招聘信息 系统环境:Fedora22(昨天已安装scrapy环境) 爬取的开始URL:ht ...

- R语言:用简单的文本处理方法优化我们的读书体验

博客总目录:http://www.cnblogs.com/weibaar/p/4507801.html 前言 延续之前的用R语言读琅琊榜小说,继续讲一下利用R语言做一些简单的文本处理.分词的事情.其实 ...

- CSharpGL(40)一种极其简单的半透明渲染方法

CSharpGL(40)一种极其简单的半透明渲染方法 开始 这里介绍一个实现半透明渲染效果的方法.此方法极其简单,不拖累渲染速度,但是不能适用所有的情况. 如下图所示,可以让包围盒显示为半透明效果. ...

- 简单工厂VS工厂方法

前言: GOF经典的23种设计模式在IT界现已被广为流传.由于比较长时间没有用了,个人对于不同模式与模式之间的区别也渐渐模糊,故开始重温设计模式的思想.也希望更给对设计模式感兴趣的朋友些许的启发. - ...

- Simple Factory vs. Factory Method vs. Abstract Factory【简单工厂,工厂方法以及抽象工厂的比较】

I ran into a question on stackoverflow the other day that sort of shocked me. It was a piece of code ...

- 结合实例分析简单工厂模式&工厂方法模式&抽象工厂模式的区别

之前写过一篇关于工厂模式(Factory Pattern)的随笔,里面分析了简单工厂模式,但对于工厂方法和抽象工厂的分析较为简略.这里重新分析分析三者的区别,工厂模式是java设计模式中比较简单的一个 ...

- Java设计模式之简单工厂、工厂方法和抽象工厂

在前面的学习中(参见前面的博客),我们学到了很多OO原则: 封装变化 多用组合,少用继承 针对接口/超类编程,不针对实现编程 松耦合 开闭原则 让我们从一个简单的类开始,看看如何将之改造成符合OO原则 ...

- 最简单的 RabbitMQ 监控方法 - 每天5分钟玩转 OpenStack(158)

这是 OpenStack 实施经验分享系列的第 8 篇. 先来看张图:这是 Nova 的架构图,我们可以看到有两个组件处于架构的中心位置:数据库和Queue.数据库保存状态信息,而几乎所有的 nova ...

- Java实现一个简单的加密解密方法

Crypto是Java语言写的一个简单的加密解密方法. 使用方法: 加密方法 String cipherte=Enande.encrypt(content, pass): 解密方法 Enande.de ...

随机推荐

- asp.net mvc如何获取url的相关信息

1.获取完整url信息(协议名+域名+虚拟目录名+文件名+参数) string url = Request.Url.ToString(); 如: //1)获取完整url(协议名+域名+虚拟目录名+文件 ...

- 基础数据类型的坑和集合及深浅copy

一.基础数据类型的坑: 元组: 如果一个元组中,只有一个元素,且没有逗号,则该"元组"与里面的数据的类型相同. # 只有一个数据,且没有逗号的情况: print(tu1,type( ...

- spark使用正则表达式读入多个文件

String dir = "s3a://example/";String currentDir = dir + "{1[5-9],2[01]}/*.txt";J ...

- pl/sql美化

因为这个问题曾经浪费过俺很多时间,不过今天终于发现一个小技巧,分享给大家, 在上面DDL语句前后加上begin 和 end,哈哈,再美化下试试看,DDL被成功被美化了. 具体如下: begin---① ...

- 修改Host,配置域名访问

修改Host,配置域名访问 虽然我们已经能够通过localhost访问本地网站了,为了提高逼格,我们可以修改host文件,设置一个自己喜欢的域名指向本地网站,岂不是更高大上. 明确需求 通过配置, ...

- dell win10 productkey

- redis:集群配置

一.redis集群相关 1.概念:redis集群是通过数据分区提供可用性的,这样即使一部分节点失效也可以继续处理请求. 2.原理:集群使用数据分片实现,一个redis集群包括16384个哈希槽,数据库 ...

- C++构造函数和析构函数,以及构造函数特殊成员变量和函数的初始化

body, table{font-family: 微软雅黑; font-size: 10pt} table{border-collapse: collapse; border: solid gray; ...

- java泛型讲解

原文: https://blog.csdn.net/briblue/article/details/76736356 泛型,一个孤独的守门者. 大家可能会有疑问,我为什么叫做泛型是一个守门者.这其实是 ...

- aspnet core 2.0 发布之后没有 views文件夹

在项目文件里面 增加这个节点: MvcRazorCompileOnPublish 设置为false 是会发布views <PropertyGroup> <PackageTargetF ...