图卷积神经网络分类的pytorch实现

图神经网络(GNN)目前的主流实现方式就是节点之间的信息汇聚,也就是类似于卷积网络的邻域加权和,比如图卷积网络(GCN)、图注意力网络(GAT)等。下面根据GCN的实现原理使用Pytorch张量,和调用torch_geometric包,分别对Cora数据集进行节点分类实验。

Cora是关于科学文献之间引用关系的图结构数据集。数据集包含一个图,图中包括2708篇文献(节点)和10556个引用关系(边)。其中每个节点都有一个1433维的特征向量,即文献内容的嵌入向量。文献被分为七个类别:计算机科学、物理学等。

GCN计算流程

对于某个GCN层,假设输入图的节点特征为$X\in R^{|V|\times F_{in}}$,边索引表示为序号数组$Ei\in R^{2\times |E|}$,GCN层输出$Y\in R^{|V|\times F_{out}}$。计算流程如下:

0、根据$Ei$获得邻接矩阵$A_0\in R^{|V|\times |V|}$。

1、为了将节点自身信息汇聚进去,每个节点添加指向自己的边,即 $A=A_0+I$,其中$I$为单位矩阵。

2、计算度(出或入)矩阵 $D$,其中 $D_{ii}=\sum_j A_{ij}$ 表示第 $i$ 个节点的度数。$D$为对角阵。

3、计算对称归一化矩阵 $\hat{D}$,其中 $\hat{D}_{ii}=1/\sqrt{D_{ii}}$。

4、构建对称归一化邻接矩阵 $\tilde{A}$,其中 $\tilde{A}= \hat{D} A \hat{D}$。

5、计算节点特征向量的线性变换,即 $Y = \tilde{A} X W$,其中 $X$ 表示输入的节点特征向量,$W\in R^{F_{in}\times F_{out}}$ 为GCN层中待训练的权重矩阵。

即:

$Y=D^{-0.5}(A_0+I)D^{-0.5}XW$

在torch_geometric包中,normalize参数控制是否使用度矩阵$D$归一化;cached控制是否缓存$D$,如果每次输入都是相同结构的图,则可以设置为True,即所谓转导学习(transductive learning)。另外,可以看到GCN的实现只考虑了节点的特征,没有考虑边的特征,仅仅通过聚合引入边的连接信息。

GCN实验

调包实现

Cora的图数据存放在torch_geometric的Data类中。Data主要包含节点特征$X\in R^{|V|\times F_v}$、边索引$Ei\in R^{2\times |E|}$、边特征$Ea\in R^{|E|\times F_e}$等变量。首先导出Cora数据:

from torch_geometric.datasets import Planetoid cora = Planetoid(root='./data', name='Cora')[0]

print(cora)

构建GCN,训练并测试。

import torch

from torch import nn

from torch_geometric.nn import GCNConv

import torch.nn.functional as F

from torch.optim import Adam class GCN(nn.Module):

def __init__(self, in_channels, hidden_channels, class_n):

super(GCN, self).__init__()

self.conv1 = GCNConv(in_channels, hidden_channels)

self.conv2 = GCNConv(hidden_channels, class_n) def forward(self, x, edge_index):

x = torch.relu(self.conv1(x, edge_index))

x = torch.dropout(x, p=0.5, train=self.training)

x = self.conv2(x, edge_index)

return torch.log_softmax(x, dim=1) model = GCN(cora.num_features, 16, cora.y.unique().shape[0]).to('cuda')

opt = Adam(model.parameters(), 0.01, weight_decay=5e-4) def train(its):

model.train()

for i in range(its):

y = model(cora.x, cora.edge_index)

loss = F.nll_loss(y[cora.train_mask], cora.y[cora.train_mask])

loss.backward()

opt.step()

opt.zero_grad() def test():

model.eval()

y = model(cora.x, cora.edge_index)

right_n = torch.argmax(y[cora.test_mask], 1) == cora.y[cora.test_mask]

acc = right_n.sum()/cora.test_mask.sum()

print("Acc: ", acc) for i in range(15):

train(1)

test()

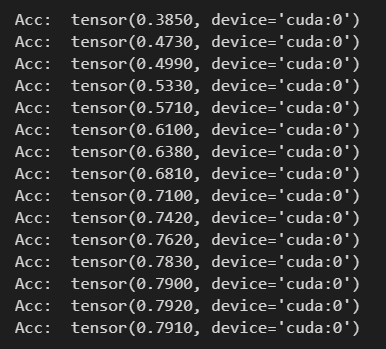

仅15次迭代就收敛,测试精度如下:

张量实现

主要区别就是自定义一个My_GCNConv来代替GCNConv,My_GCNConv定义如下:

from torch import nn

from torch_geometric.utils import to_dense_adj class My_GCNConv(nn.Module):

def __init__(self, in_channels, out_channels):

super(My_GCNConv, self).__init__()

self.weight = torch.nn.Parameter(nn.init.xavier_normal(torch.zeros(in_channels, out_channels)))

self.bias = torch.nn.Parameter(torch.zeros([out_channels])) def forward(self, x, edge_index):

adj = to_dense_adj(edge_index)[0]

adj += torch.eye(x.shape[0]).to(adj)

dgr = torch.diag(adj.sum(1)**-0.5)

y = torch.matmul(dgr, adj)

y = torch.matmul(y, dgr)

y = torch.matmul(y, x)

y = torch.matmul(y, self.weight) + self.bias

return y

其它代码仅将GCNConv修改为My_GCNConv。

对比实验

MLP实现

下面不使用节点之间的引用关系,仅使用节点特征向量在MLP中进行实验,来验证GCN的有效性。

import torch

from torch import nn

import torch.nn.functional as F

from torch.optim import Adam class MLP(nn.Module):

def __init__(self, in_channels, hidden_channels, class_n):

super(MLP, self).__init__()

self.l1 = nn.Linear(in_channels, hidden_channels)

self.l2 = nn.Linear(hidden_channels, hidden_channels)

self.l3 = nn.Linear(hidden_channels, class_n) def forward(self, x):

x = torch.relu(self.l1(x))

x = torch.relu(self.l2(x))

x = torch.dropout(x, p=0.5, train=self.training)

x = self.l3(x)

return torch.log_softmax(x, dim=1) model = MLP(cora.num_features, 512, cora.y.unique().shape[0]).to('cuda')

opt = Adam(model.parameters(), 0.01, weight_decay=5e-4) def train(its):

model.train()

for i in range(its):

y = model(cora.x[cora.train_mask])

loss = F.nll_loss(y, cora.y[cora.train_mask])

loss.backward()

opt.step()

opt.zero_grad() def test():

model.eval()

y = model(cora.x[cora.test_mask])

right_n = torch.argmax(y, 1) == cora.y[cora.test_mask]

acc = right_n.sum()/cora.test_mask.sum()

print("Acc: ", acc) for i in range(15):

train(30)

test()

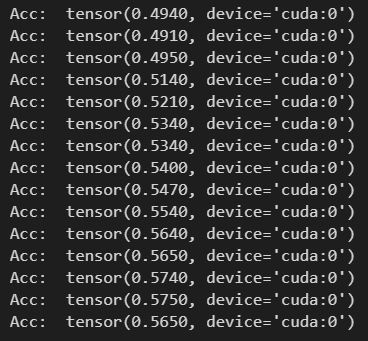

可以看出MLP包含了3层,并且隐层参数比GCN多得多。结果如下:

精度收敛在57%左右,效果比GCN的79%差。说明节点之间的链接关系对节点类别的划分有促进作用,以及GCN的有效性。

图卷积神经网络分类的pytorch实现的更多相关文章

- 图卷积神经网络(GCN)入门

图卷积网络Graph Convolutional Nueral Network,简称GCN,最近两年大热,取得不少进展.不得不专门为GCN开一个新篇章,表示其重要程度.本文结合大量参考文献,从理论到实 ...

- 论文解读丨基于局部特征保留的图卷积神经网络架构(LPD-GCN)

摘要:本文提出一种基于局部特征保留的图卷积网络架构,与最新的对比算法相比,该方法在多个数据集上的图分类性能得到大幅度提升,泛化性能也得到了改善. 本文分享自华为云社区<论文解读:基于局部特征保留 ...

- Graph 卷积神经网络:概述、样例及最新进展

http://www.52ml.net/20031.html [新智元导读]Graph Convolutional Network(GCN)是直接作用于图的卷积神经网络,GCN 允许对结构化数据进行端 ...

- 最全面的图卷积网络GCN的理解和详细推导,都在这里了!

目录 目录 1. 为什么会出现图卷积神经网络? 2. 图卷积网络的两种理解方式 2.1 vertex domain(spatial domain):顶点域(空间域) 2.2 spectral doma ...

- Graph Neural Networks:谱域图卷积

以下学习内容参考了:1,2, 0.首先回忆CNN,卷积神经网络的结构和特点 处理的数据特征:具有规则的空间结构(Euclidean domains),都可以采用一维或者二维的矩阵描述.(Convolu ...

- 卷积神经网络概念及使用 PyTorch 简单实现

卷积神经网络 卷积神经网络(CNN)是深度学习的代表算法之一 .具有表征学习能力,能够按其阶层结构对输入信息进行平移不变分类,因此也被称为“平移不变人工神经网络”.随着深度学习理论的提出和数值计算设备 ...

- 基于卷积神经网络的面部表情识别(Pytorch实现)----台大李宏毅机器学习作业3(HW3)

一.项目说明 给定数据集train.csv,要求使用卷积神经网络CNN,根据每个样本的面部图片判断出其表情.在本项目中,表情共分7类,分别为:(0)生气,(1)厌恶,(2)恐惧,(3)高兴,(4)难过 ...

- PyTorch基础——使用卷积神经网络识别手写数字

一.介绍 实验内容 内容包括用 PyTorch 来实现一个卷积神经网络,从而实现手写数字识别任务. 除此之外,还对卷积神经网络的卷积核.特征图等进行了分析,引出了过滤器的概念,并简单示了卷积神经网络的 ...

- Pytorch实现基于卷积神经网络的面部表情识别(详细步骤)

文章目录 一.项目背景 二.数据处理 1.标签与特征分离 2.数据可视化 3.训练集和测试集 三.模型搭建 四.模型训练 五.完整代码 一.项目背景数据集cnn_train.csv包含人类面部表情的图 ...

- [DL学习笔记]从人工神经网络到卷积神经网络_3_使用tensorflow搭建CNN来分类not_MNIST数据(有一些问题)

3:用tensorflow搭个神经网络出来 为什么用tensorflow呢,应为谷歌是亲爹啊,虽然有些人说caffe更适合图像啊mxnet效率更高等等,但爸爸就是爸爸,Android都能那么火,一个道 ...

随机推荐

- vue项目中,alert使用

methods:{ sendData() { ··· // 中间省略的代码 alert(`发送成功,连接失败的号码有:${failList}`) // failList里存的是后台返回的数据 } }

- dfs 序

dfs序可以\(O(1)\)判断书上两个点的从属关系 Tree Queries 题面翻译 给你一个以\(1\)为根的有根树. 每回询问\(k\)个节点\({v_1, v_2 \cdots v_k}\) ...

- day25 前端

https://www.dcloud.io/hbuilderx.html 下载HbuilderX,直接解压缩双击打开 html5 <!DOCTYPE html><!-- 文档类型,声 ...

- .net做一个基于ChatGpt的微信机器人吧~[全教程]

最近这个ChatGPT很火啊,看了B站上很多视频,自己非常手痒,高低自己得整一个啊,很多人都是把ChatGPT和微信结合在一起,正巧我是Wechaty框架的.net sdk贡献者,这不是一应俱全了吗? ...

- python 实现DES加解密

from pyDes import * import base64 class Des3(object): def __init__(self, key, iv): # 这里密钥key长度必须为16/ ...

- buuctf_Dest0g3_crypto

babyAES: 题目如下: from Crypto.Cipher import AES import os iv = os.urandom(16) key = os.urandom(16) my_a ...

- .Net 7 的AOT的程序比托管代码更容易破解?

楔子 .Net 7的一个重要功能是把托管的源码编译成Native Code,也就是二进制文件.此举看似增加了程序反编译难度,实际上是减少了程序的破解难度.本篇在不触及整个程序架构的前提下,以简单的例子 ...

- @LoadBalanced注解原理

在使用springcloud ribbon客户端负载均衡的时候,可以给RestTemplate bean 加一个@LoadBalanced注解,就能让这个RestTemplate在请求时拥有客户端负载 ...

- [python] 基于Gradio可视化部署机器学习应用

Gradio是一个开源的Python库,用于构建机器学习和数据科学演示应用.有了Gradio,你可以围绕你的机器学习模型或数据科学工作流程快速创建一个简单漂亮的用户界面.Gradio适用于以下情况: ...

- [OpenCV实战]46 在OpenCV下应用图像强度变换实现图像对比度均衡

本文主要介绍基于图像强度变换算法来实现图像对比度均衡.通过图像对比度均衡能够抑制图像中的无效信息,使图像转换为更符合计算机或人处理分析的形式,以提高图像的视觉价值和使用价值.本文主要通过OpenCV ...