Flink WordCount入门

下面通过一个单词统计的案例,快速上手应用 Flink,进行流处理(Streaming)和批处理(Batch)

单词统计(批处理)

- 引入依赖

<!--flink核心包-->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-java</artifactId>

<version>1.7.2</version>

</dependency>

<!--flink流处理包-->

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-streaming-java_2.12</artifactId>

<version>1.7.2</version>

</dependency>

- 代码实现

public class WordCountBatch {

public static void main(String[] args) throws Exception {

String inputFile= "E:\\data\\word.txt";

String outPutFile= "E:\\data\\wordResult.txt";

ExecutionEnvironment executionEnvironment = ExecutionEnvironment.getExecutionEnvironment();

//1. 读取数据

DataSource<String> dataSource = executionEnvironment.readTextFile(inputFile);

//2. 对数据进行处理,转成word,1的格式

FlatMapOperator<String, Tuple2<String, Integer>> flatMapOperator = dataSource.flatMap(new FlatMapFunction<String, Tuple2<String, Integer>>() {

@Override

public void flatMap(String s, Collector<Tuple2<String, Integer>> collector) throws Exception {

String[] words = s.split(" ");

for (String word : words) {

collector.collect(new Tuple2<>(word, 1));

}

}

});

//3. 对数据分组,相同word的一个组

UnsortedGrouping<Tuple2<String, Integer>> tuple2UnsortedGrouping = flatMapOperator.groupBy(0);

//4. 对分组后的数据求和

AggregateOperator<Tuple2<String, Integer>> sum = tuple2UnsortedGrouping.sum(1);

//5. 写出数据

sum.writeAsCsv(outPutFile).setParallelism(1);

//执行

executionEnvironment.execute("wordcount batch process");

}

}

执行 main 方法,得出结果。我测试的 word.txt 内容如下:

ni hao hi

wang mei mei

liu mei

ni hao

wo hen hao

this is a good idea

Apache Flink

输出的文件结果:

a,1

mei,3

Apache,1

Flink,1

good,1

hen,1

hi,1

idea,1

ni,2

is,1

liu,1

this,1

wo,1

hao,3

wang,1

单词统计(流数据)

需求:Socket 模拟实时发送单词,使用 Flink 实时接收数据,对指定时间窗口内(如 5s)的数据进行聚合统计,每隔 1s 汇总计算一次,并且把时间窗口内计算结果打印出来

public class WordCountStream {

public static void main(String[] args) throws Exception {

int port = 7000;

StreamExecutionEnvironment executionEnvironment = StreamExecutionEnvironment.getExecutionEnvironment();

DataStreamSource<String> textStream = executionEnvironment.socketTextStream("192.168.56.103", port, "\n");

SingleOutputStreamOperator<Tuple2<String, Integer>> tuple2SingleOutputStreamOperator = textStream.flatMap(new FlatMapFunction<String, Tuple2<String, Integer>>() {

@Override

public void flatMap(String s, Collector<Tuple2<String, Integer>> collector) throws Exception {

String[] split = s.split("\\s");

for (String word : split) {

collector.collect(Tuple2.of(word, 1));

}

}

});

SingleOutputStreamOperator<Tuple2<String, Integer>> word = tuple2SingleOutputStreamOperator.keyBy(0)

.timeWindow(Time.seconds(5),Time.seconds(1)).sum(1);

word.print();

executionEnvironment.execute("wordcount stream process");

}

}

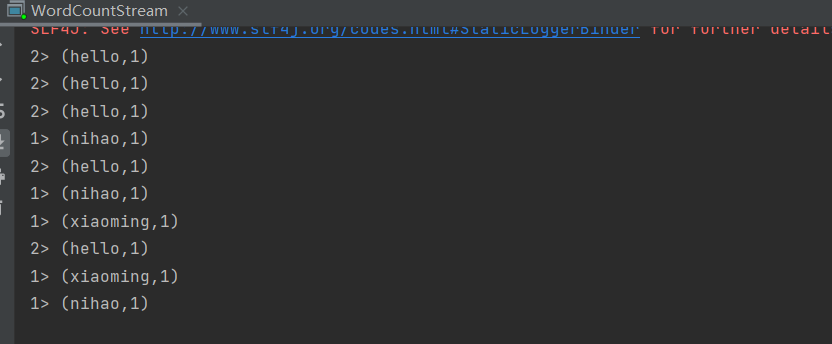

运行起来之后,我们就可以开始发送 socket 请求过去。我们测试可以使用 netcat 工具。

在 linux 上安装好后,使用下面的命令:

nc -lk 7000

然后发送数据即可。

Flink WordCount入门的更多相关文章

- [转帖]Flink(一)Flink的入门简介

Flink(一)Flink的入门简介 https://www.cnblogs.com/frankdeng/p/9400622.html 一. Flink的引入 这几年大数据的飞速发展,出现了很多热门的 ...

- Flink从入门到放弃(入门篇2)-本地环境搭建&构建第一个Flink应用

戳更多文章: 1-Flink入门 2-本地环境搭建&构建第一个Flink应用 3-DataSet API 4-DataSteam API 5-集群部署 6-分布式缓存 7-重启策略 8-Fli ...

- Flink从入门到放弃(入门篇3)-DataSetAPI

戳更多文章: 1-Flink入门 2-本地环境搭建&构建第一个Flink应用 3-DataSet API 4-DataSteam API 5-集群部署 6-分布式缓存 7-重启策略 8-Fli ...

- Flink从入门到放弃(入门篇1)-Flink是什么

戳更多文章: 1-Flink入门 2-本地环境搭建&构建第一个Flink应用 3-DataSet API 4-DataSteam API 5-集群部署 6-分布式缓存 7-重启策略 8-Fli ...

- Flink从入门到放弃(入门篇4) DataStreamAPI

戳更多文章: 1-Flink入门 2-本地环境搭建&构建第一个Flink应用 3-DataSet API 4-DataSteam API 5-集群部署 6-分布式缓存 7-重启策略 8-Fli ...

- Flink从入门到精通系列文章

戳更多文章: 1-Flink入门 2-本地环境搭建&构建第一个Flink应用 3-DataSet API 4-DataSteam API 5-集群部署 6-分布式缓存 7-重启策略 8-Fli ...

- Flink快速入门--安装与示例运行

flink是一款开源的大数据流式处理框架,他可以同时批处理和流处理,具有容错性.高吞吐.低延迟等优势,本文简述flink在windows和linux中安装步骤,和示例程序的运行. 首先要想运行Flin ...

- 「Flink」使用Java lambda表达式实现Flink WordCount

本篇我们将使用Java语言来实现Flink的单词统计. 代码开发 环境准备 导入Flink 1.9 pom依赖 <dependencies> <dependency> < ...

- Flink(一)Flink的入门简介

一. Flink的引入 这几年大数据的飞速发展,出现了很多热门的开源社区,其中著名的有 Hadoop.Storm,以及后来的 Spark,他们都有着各自专注的应用场景.Spark 掀开了内存计算的先河 ...

随机推荐

- JDBC与ODBC的区别

JDBC简介JDBC(Java Data Base Connectivity,java数据库连接)是一种用于执行SQL语句的Java API,它是Java十三个规范之一.可以为多种关系数据库提供统一访 ...

- 最近公共祖先(LCA)学习笔记 | P3379 【模板】最近公共祖先(LCA)题解

研究了LCA,写篇笔记记录一下. 讲解使用例题 P3379 [模板]最近公共祖先(LCA). 什么是LCA 最近公共祖先简称 LCA(Lowest Common Ancestor).两个节点的最近公共 ...

- .NET中MongoDB之CRUD

参考文档 https://docs.mongoing.com/mongodb-crud-operations https://docs.mongodb.com/manual/crud/ https:/ ...

- 【原创】JDK 9-17新功能30分钟详解-语法篇-var

JDK 9-17新功能30分钟详解-语法篇-var 介绍 JDK 10 JDK 10新增了新的关键字--var,官方文档说作用是: Enhance the Java Language to exten ...

- 一文搞懂EMAS Serverless小程序开发|电子书免费下载

>> 快来免费下载|电子书<五天玩转 EMAS Serverless> << 点击免费下载 <五天玩转 EMAS Serverless> EMAS Se ...

- Express 项目,res.cookie() 设置 Cookie 无法被保存在浏览器的 Application 中

res.cookie() 给客户端响应头封装的 Cookie 无法被保存在客户端浏览器的 Application 中,只能在 Set-Cookie 中看到有这个值: 在前后端分离项目中,存在跨域问题, ...

- 来开源吧!发布开源组件到 MavenCentral 仓库超详细攻略

请点赞关注,你的支持对我意义重大. Hi,我是小彭.本文已收录到 GitHub · AndroidFamily 中.这里有 Android 进阶成长知识体系,有志同道合的朋友,关注公众号 [彭旭锐] ...

- 模拟赛:树和森林(lct.cpp) (树形DP,换根DP好题)

题面 题解 先解决第一个子问题吧,它才是难点 Subtask_1 我们可以先用一个简单的树形DP处理出每棵树内部的dis和,记为dp0[i], 然后再用一个换根的树形DP处理出每棵树内点 i 到树内每 ...

- (最简单详细)IronPython下载、安装及简单使用

说实话,对于我这种小白,在网上找个IronPython找的很费劲,学会操作之后,直接整个随笔,供新手参考.前提是现在你应该有VS了 (1)找到IronPython的网站 很多人肯定就按照习惯搜索,Ir ...

- AtCoder Beginner Contest 260 (D-E)

AtCoder Beginner Contest 260 - AtCoder D - Draw Your Cards 题意:N张卡牌数字 1-n,以某种顺序排放,每次拿一张,如果这一张比前面某一张小( ...