爬虫---PyQuert简介

今天写一篇最近刚学习的一个第3方库pyquery,pyquery比bs4,lxml更强大的一个网页解析工具。

什么是pyQuery

Pyquery是python的第3方库,PyQuery库也是一个非常强大又灵活的网页解析库,它提供了和jQuery 类似的语法来解析HTML 文梢,支持css 选择器,使用非常方便。Beautifu l Soup 一样,初始化PyQuery 的时候,也需要传入HTML 文本来初始化一个PyQue1y对象。它的初始化方式有多种,比如直接传入字符串,传入URL,传人文件名

官方文档:http://pyquery.readthedocs.io/en/latest/

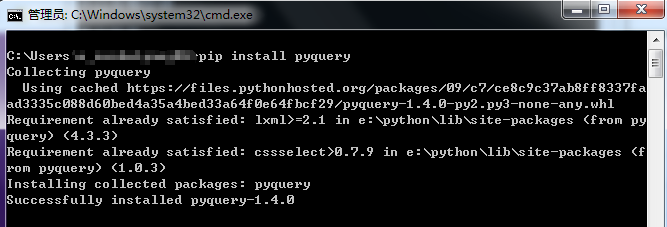

安装PyQuery

# pip安装

pip install pyquery

PyQuery使用

写一个简单的html供下面学习

text =

'''

<html>

<body>

<div id="test">

<ul class="list">

<li class="item-0"><a href="link1.html">今天天气</a></li>

<li class="item-1"><a href="link2.html">明天天气</a></li>

<li class="item-2"><a href="link3.html">后天天气</a></li>

<li class="item-3"><a href="link4.html">周末天气</a></li>

</ul>

</div>

</body>

</html>

'''

基本css选择器

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

# 通过css选择器先查找id再查找class

item = doc('#test .list')

print(item) 代码结果:

<ul class="list">

<li class="item-0"><a href="link1.html">今天天气</a></li>

<li class="item-1"><a href="link2.html">明天天气</a></li>

<li class="item-2"><a href="link3.html">后天天气</a></li>

<li class="item-3"><a href="link4.html">周末天气</a></li>

</ul>

查找子节点

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

# 通过css选择器先查找id再查找class

item = doc('#test .list')

# 查找子节点li

child = item.children('li')

# 或者使用find()函数

# child = item.find('li')

print(child) 代码结果:

<li class="item-0"><a href="link1.html">今天天气</a></li>

<li class="item-1"><a href="link2.html">明天天气</a></li>

<li class="item-2"><a href="link3.html">后天天气</a></li>

<li class="item-3"><a href="link4.html">周末天气</a></li>

查找父节点

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

# 通过css选择器先查找id再查找class

item = doc('#test .list')

# 查找父节点

container = item.parent()

print(container) 代码结果:

<div id="test">

<ul class="list">

<li class="item-0"><a href="link1.html">今天天气</a></li>

<li class="item-1"><a href="link2.html">明天天气</a></li>

<li class="item-2"><a href="link3.html">后天天气</a></li>

<li class="item-3"><a href="link4.html">周末天气</a></li>

</ul>

</div>

查找兄弟节点

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

# 查找兄弟其中一个

item = doc('.item-0')

# 查找兄弟节点

xiongdi = item.siblings('li')

print(xiongdi) 代码结果:

<li class="item-1"><a href="link2.html">明天天气</a></li>

<li class="item-2"><a href="link3.html">后天天气</a></li>

<li class="item-3"><a href="link4.html">周末天气</a></li>

遍历读取内容

1、遍历读取a标签

这个地方需要使用一个方法items(),使用该方法后得到一个生成器

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

item = doc('.list a').items()

for i in item:

print(i) 代码结果:

<a href="link1.html">今天天气</a>

<a href="link2.html">明天天气</a>

<a href="link3.html">后天天气</a>

<a href="link4.html">周末天气</a>

2、获取href的值

这个地方需要用到attr()方法

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

item = doc('.list a').items()

for i in item:

print(i.attr('href')) 代码结果:

link1.html

link2.html

link3.html

link4.html

3、获取a标签下的文字

通过调用text()方法来实现

# 导入pyquery

from pyquery import PyQuery as pq

# 创建对象

doc = pq(text)

item = doc('.list a').items()

for i in item:

print(i.text()) 代码结果:

今天天气

明天天气

后天天气

周末天气

下一篇通过简单的案例更加深刻的了解pyquery库~~~~

写了一些简单的介绍,还是那一句话,方法多多种,喜欢那种用那种~~~大家喜欢的话,也可以点个关注哈

爬虫---PyQuert简介的更多相关文章

- Python 爬虫一 简介

什么是爬虫? 爬虫可以做什么? 爬虫的本质 爬虫的基本流程 什么是request&response 爬取到数据该怎么办 什么是爬虫? 网络爬虫(又被称为网页蜘蛛,网络机器人,在FOAF社区中间 ...

- 【搜索引擎Jediael开发笔记1】搜索引擎初步介绍及网络爬虫

详细可参考 (1)书箱:<这就是搜索引擎><自己动手写网络爬虫><解密搜索引擎打桩实践> (2)[搜索引擎基础知识1]搜索引擎的技术架构 (3)[搜索引擎基础知识2 ...

- 97、爬虫框架scrapy

本篇导航: 介绍与安装 命令行工具 项目结构以及爬虫应用简介 Spiders 其它介绍 爬取亚马逊商品信息 一.介绍与安装 Scrapy一个开源和协作的框架,其最初是为了页面抓取 (更确切来说, ...

- 爬虫框架 Scrapy

一 介绍 crapy一个开源和协作的框架,其最初是为了页面抓取 (更确切来说, 网络抓取 )所设计的,使用它可以以快速.简单.可扩展的方式从网站中提取所需的数据.但目前Scrapy的用途十分广泛,可用 ...

- Python 爬虫七 Scrapy

Scrapy Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架. 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中.其最初是为了页面抓取 (更确切来说, 网络抓取 )所设 ...

- 爬虫框架之Scrapy

一.介绍 二.安装 三.命令行工具 四.项目结构以及爬虫应用简介 五.Spiders 六.Selectors 七.Items 八.Item Pipelin 九. Dowloader Middeware ...

- 爬虫基础线程进程学习-Scrapy

性能相关 学习参考:http://www.cnblogs.com/wupeiqi/articles/6229292.html 在编写爬虫时,性能的消耗主要在IO请求中,当单进程单线程模式下请求URL时 ...

- 爬虫、框架scrapy

阅读目录 一 介绍 二 安装 三 命令行工具 四 项目结构以及爬虫应用简介 五 Spiders 六 Selectors 七 Items 八 Item Pipeline 九 Dowloader Midd ...

- 爬虫之Scrapy详解

性能相关 在编写爬虫时,性能的消耗主要在IO请求中,当单进程单线程模式下请求URL时必然会引起等待,从而使得请求整体变慢. import requests def fetch_async(url): ...

随机推荐

- Django源码安装xadmin报错Apps aren't loaded yet.

环境:python2.7, django1.9 1.报错django.core.exceptions.AppRegistryNotReady:Apps aren't loaded yet.如下图所示: ...

- Idea为类生成序列号(十一)

新建一个测试的实体类Gradle,实现java.io.Serializable接口,选择类名,按Alt+Enter键,出现的提示框中没有生成serialVersionUID的提示,这个需要设置之后才会 ...

- P4728 [HNOI2009]双递增序列

题意 这个DP状态有点神. 首先考虑一个最暴力的状态:\(f_{i,j,k,u}\)表示第一个选了\(i\)个,第二个选了\(j\)个,第一个结尾为\(k\),第二个结尾为\(u\)是否可行. 现在考 ...

- c++用流控制成员函数输出数据

#include<iostream> #include<iomanip> using namespace std; int main() { ; double b=314159 ...

- Paper | Non-local Neural Networks

目录 1. 动机 2. 相关工作 3. Non-local神经网络 3.1 Formulation 3.2 具体实现形式 3.3 Non-local块 4. 视频分类模型 4.1 2D ConvNet ...

- django--DateTimeField字段orm操作

django中的models.py是我们用来创建数据库里需要的表的,规定表中各个字段的类型,选择合适的字段类型尤为重要,常用的字段类型有:CharField.choice.IntegerField.T ...

- Java连载47-多态基础语法、作用

一.多态的语法 1.两个类之间没有继承关系的,使用多态是不能编译的. 2.无论向上还是向上转型,都需要有继承关系. 3.什么时候需要向下转型? 当调用的方法或者属性是子类型特有的,在父类型中不存在,就 ...

- 轻量级监控平台之java进程监控脚本

轻量级监控平台之java进程监控脚本 #!/bin/bash #进程监控脚本 #功能需求: 上报机器Java进程的进程ID,对应的端口号service tcp端口号,tomcat http 端口号,以 ...

- jemalloc内存占用问题

最近,有部分越南的服务器内存不断上涨,怀疑是内存泄漏,因为框架提供的内存报告里,C内存和Lua占用内存都不大,和ps里看的差好多.总内存在12G左右,C和Lua的加起来约4G,两者相差了8G 经过一番 ...

- python 对Unicode解码

打印: print('我喜欢你'.encode('unicode_escape')) 得到Unicode编码: b'\\u6211\\u559c\\u6b22\\u4f60 将上面的编码赋值给str后 ...