pyspider爬取数据存入mysql--2.测试数据库能否连通

做一个简单的测试,看数据能否存入mysql

1 #!/usr/bin/env python

2 # -*- encoding: utf-8 -*-

3 # Created on 2017-10-26 16:03:21

4 # Project: mysql_test

5

6 from pyspider.libs.base_handler import *

7 import MySQLdb

8

9 class Handler(BaseHandler):

10 crawl_config = {

11 }

12

13 def __init__(self):

14 self.db = MySQLdb.connect(ip, name, password, tableName, charset='utf8')

15

16 @every(minutes=24 * 60)

17 def on_start(self):

18 try:

19 cursor = self.db.cursor()

20 sql = "insert into user(userName, userAge, userAddress) values ('pyspider',1,'园子')"

21 cursor.execute(sql)

22 cursor.close()

23 self.db.commit()

24 self.db.close()

25 except Exception, e:

26 print e

27 self.db.rollback()

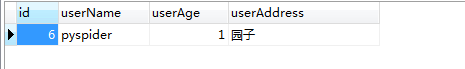

user表中已经插入了记录:

pyspider爬取数据存入mysql--2.测试数据库能否连通的更多相关文章

- pyspider爬取数据存入es--2.测试数据库连通性

写一个简单案例测试能否将数据写入es #!/usr/bin/env python # -*- encoding: utf-8 -*- # Created on 2017-10-27 08:35:57 ...

- pyspider爬取数据存入redis--2.测试数据库连通性

直接上代码 #!/usr/bin/env python # -*- encoding: utf-8 -*- # Created on 2017-10-27 09:56:50 # Project: re ...

- pyspider爬取数据存入es--1.安装驱动

跟使用mysql一样,不安装es驱动的话,也会触发模块找不到的错误 ImportError: No module named elasticsearch 通过pip安装 pip install ela ...

- pyspider爬取数据存入redis--1.安装驱动

首先安装pyredis的驱动 wget https://pypi.python.org/packages/source/r/redis/redis-2.9.1.tar.gz 解压并cd python ...

- Python使用Scrapy框架爬取数据存入CSV文件(Python爬虫实战4)

1. Scrapy框架 Scrapy是python下实现爬虫功能的框架,能够将数据解析.数据处理.数据存储合为一体功能的爬虫框架. 2. Scrapy安装 1. 安装依赖包 yum install g ...

- pyspider爬取数据导入mysql--1.安装驱动

接上篇,刚装好的pyspider,我们打算大显身手,抓一批数据到mysql中. 然而,出师未捷,提示我们:ImportError: No module named MySQLdb 这是因为还没有安装M ...

- Python 爬取数据入库mysql

# -*- enconding:etf-8 -*- import pymysql import os import time import re serveraddr="localhost& ...

- 关于js渲染网页时爬取数据的思路和全过程(附源码)

于js渲染网页时爬取数据的思路 首先可以先去用requests库访问url来测试一下能不能拿到数据,如果能拿到那么就是一个普通的网页,如果出现403类的错误代码可以在requests.get()方法里 ...

- python第一个爬虫的例子抓取数据到mysql,实测有数据

python3.5 先安装库或者扩展 1 requests第三方扩展库 pip3 install requests 2 pymysql pip3 install pymysql 3 lxml pip3 ...

随机推荐

- 3.Decorator Pattern(装饰者模式)

装饰者模式: 动态地将责任附加到对象上.想要扩展功能,装饰者提供有别于继承的另一种选择. 举例: 不知道大家学校的食堂是什么点餐制度(或者大家就直接想成吃火锅,我们要火锅料 + 配菜),我们学校的点餐 ...

- apache2.4.33伪静态配置入门教程(1)

伪静态: 把动态网页的请求方式伪装成静态网页 要使用伪静态技术,要在httpd.conf中启用伪静态模块: LoadModule rewrite_module modules/mod_rewrite. ...

- POJ3694(KB9-D 割边+LCA)

Network Time Limit: 5000MS Memory Limit: 65536K Total Submissions: 10371 Accepted: 3853 Descript ...

- Express使用Https服务器

var fs = require('fs'); var http = require('http'); var https = require('https'); var privateKey = f ...

- Android逆向 破解第一个Android程序

这节正式开始破解编写的第一个Android工程,打开Android Killer,把第一节自己编写的Android apk拖入Android Killer. PS: 如果Android Killer不 ...

- idea 关联 jdk

1.打开IntelliJ IDEA 2.选择 "File" 菜单 3.找到 "other settings" 4.选择 “Structure for new P ...

- 【jdk源码3】HashMap源码学习

可以毫不夸张的说,HashMap是容器类中用的最频繁的一个,而Java也对它进行优化,在jdk1.7及以前,当将相同Hash值的对象以key的身份放到HashMap中,HashMap的性能将由O(1) ...

- Oracle EBS OPM reshedule batch

--reschedule_batch --created by jenrry DECLARE x_message_count NUMBER; x_message_list VARCHAR2 (2000 ...

- C# 实现 JAVA AES加密解密[原创]

以下是网上普遍能收到的JAVA AES加密解密方法. 因为里面用到了KeyGenerator 和 SecureRandom,但是.NET 里面没有这2个类.无法使用安全随机数生成KEY. 我们在接收J ...

- JS获取元素宽高的两种情况

JS获取元素宽高分两种情况, 一.内联样式,也就是直接把width和height写在HTML元素中的style里: 这种情况使用 document.getElementById('xxx'). ...