Spark3.0YarnCluster模式任务提交流程源码分析

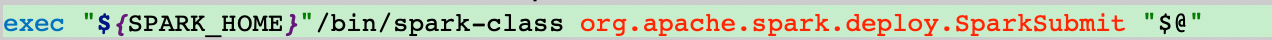

1.通过spark-submit脚本提交spark程序

在spark-submit脚本里面执行了SparkSubmit类的main方法

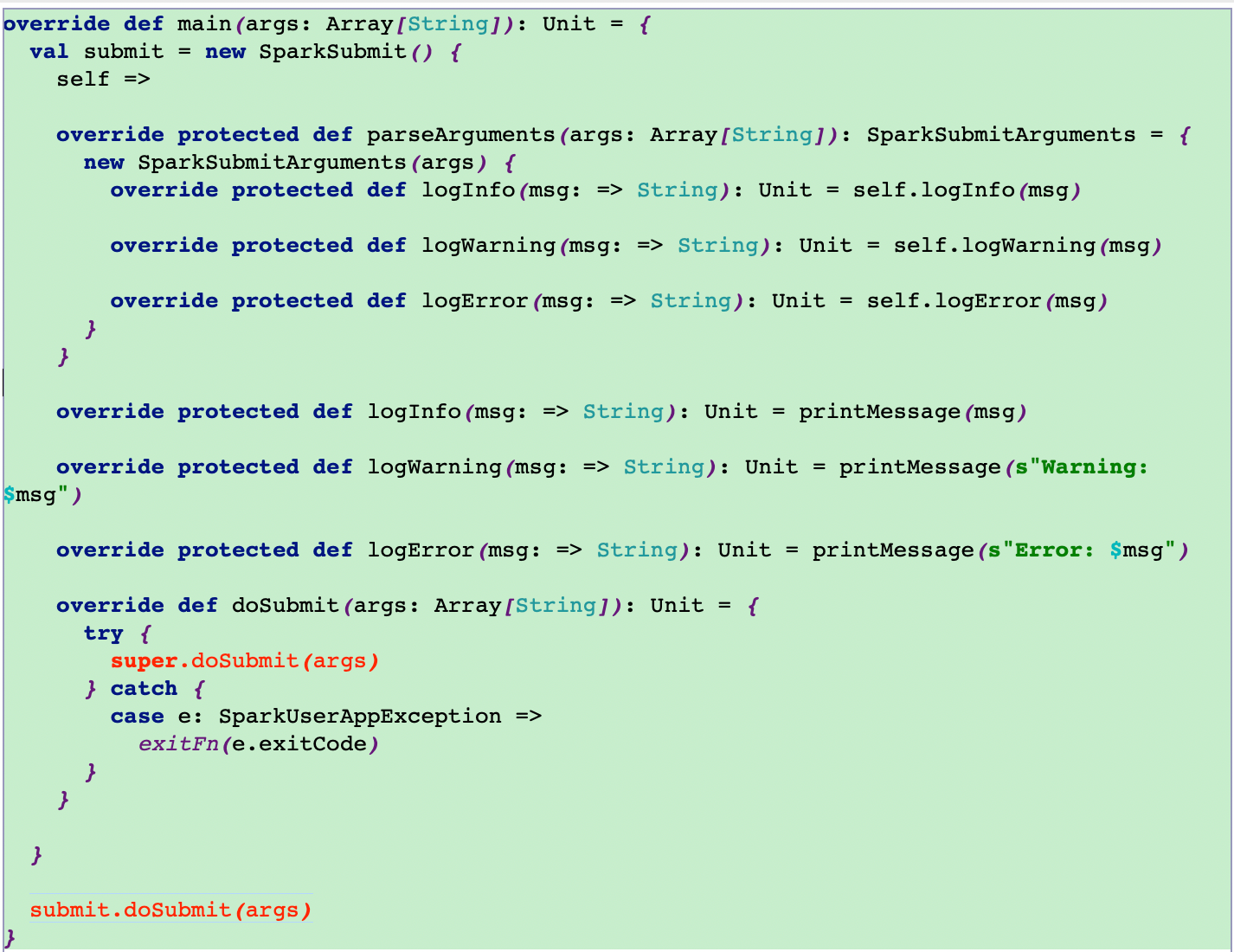

2.运行SparkSubmit类的main方法

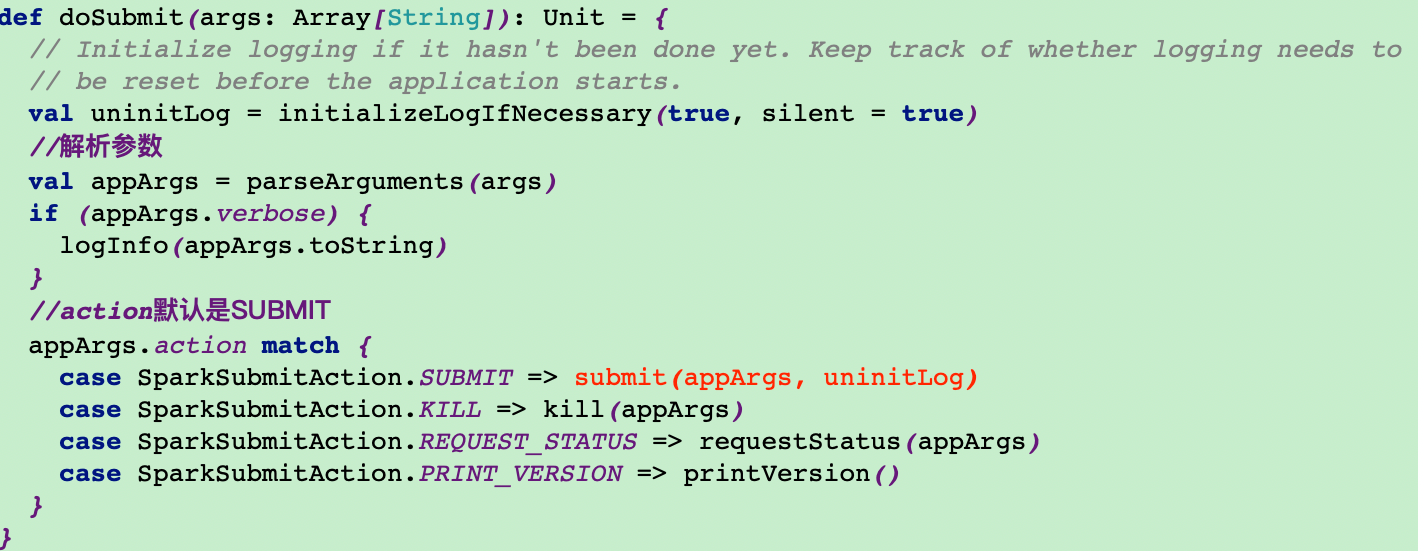

3.调用doSubmit方法

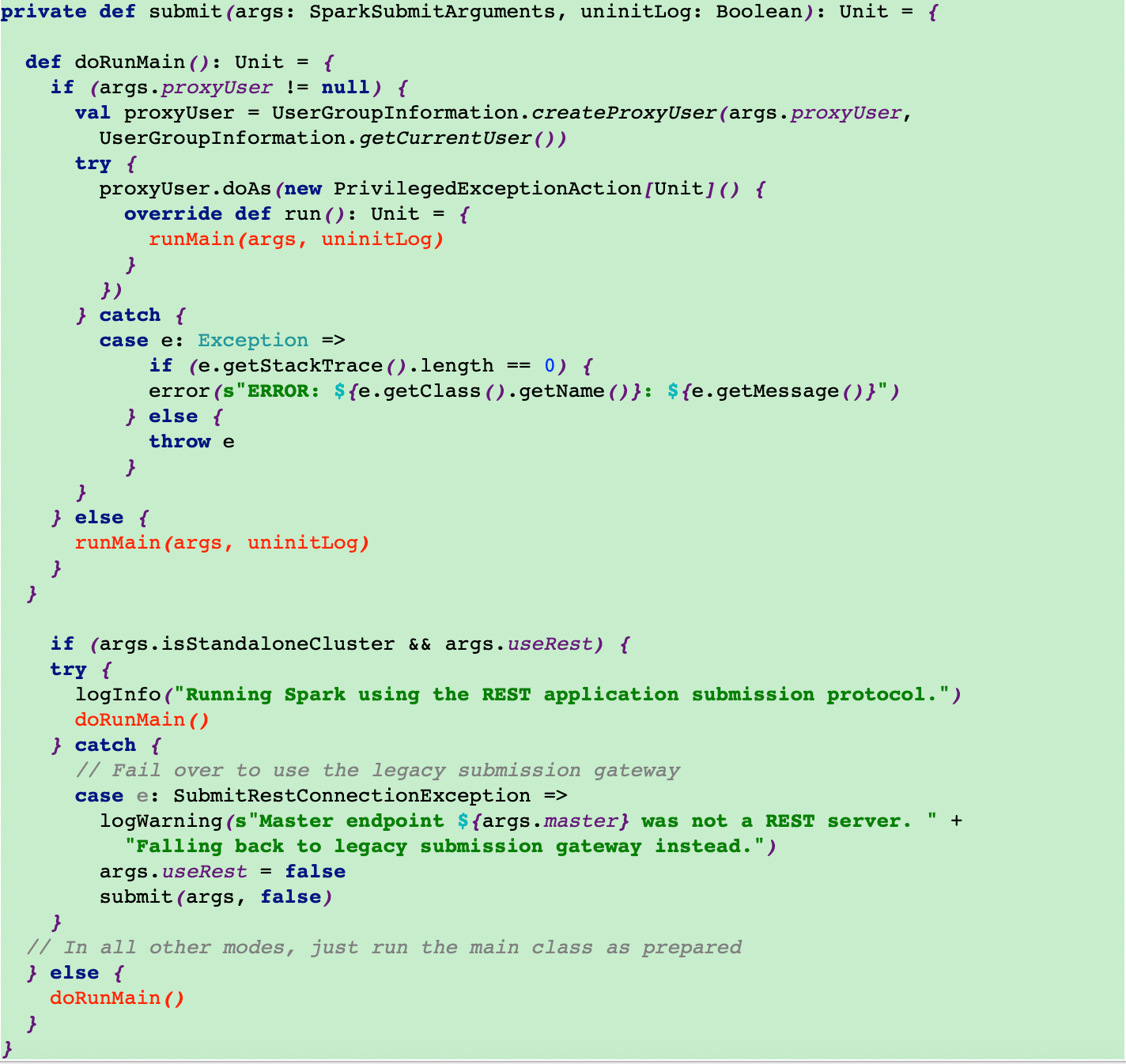

4.调用submit方法

在submit方法里调用doRunMain方法,最终调用runMain方法

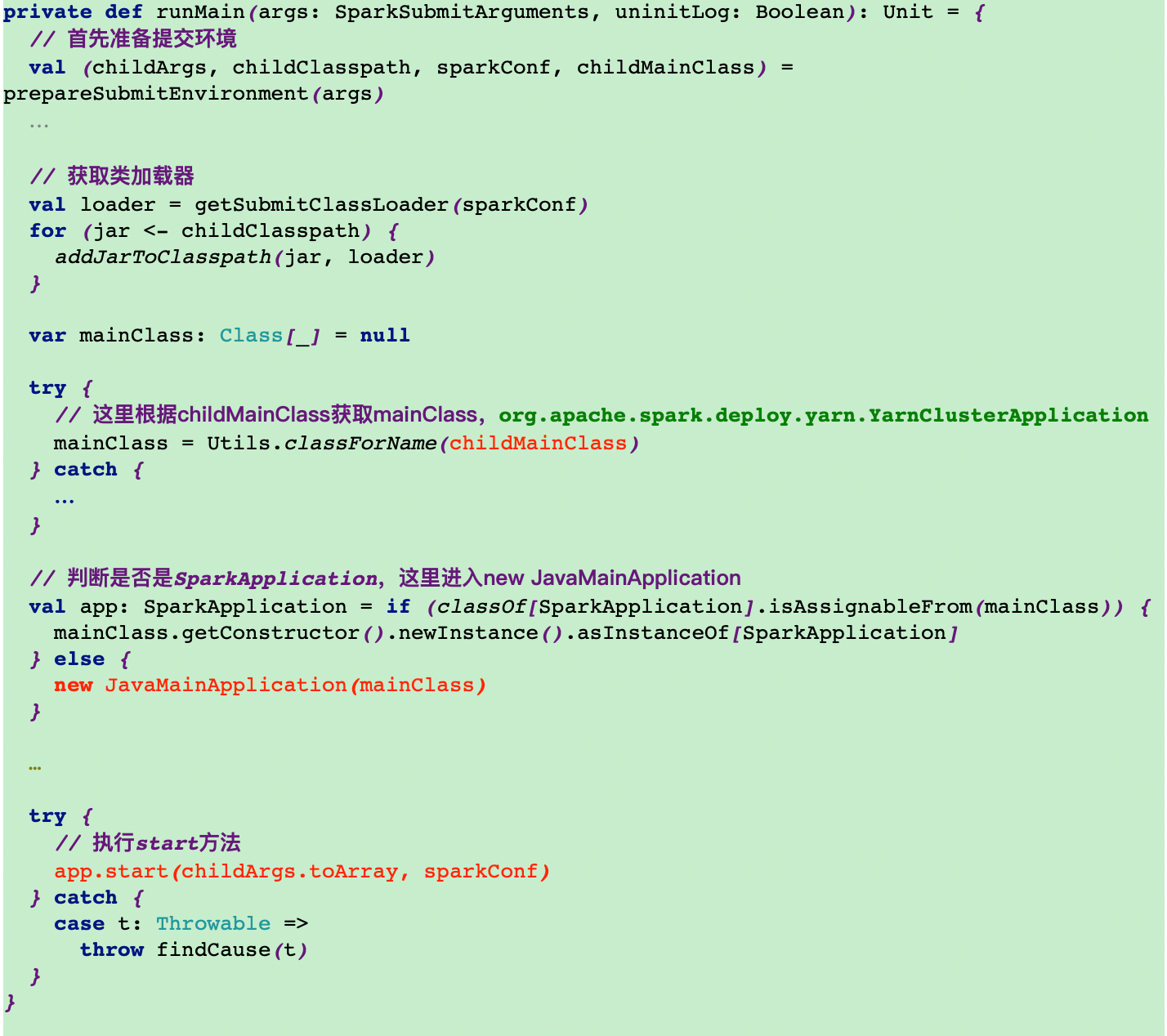

5.在runMain方法里面获取mainClass,再去执行start方法

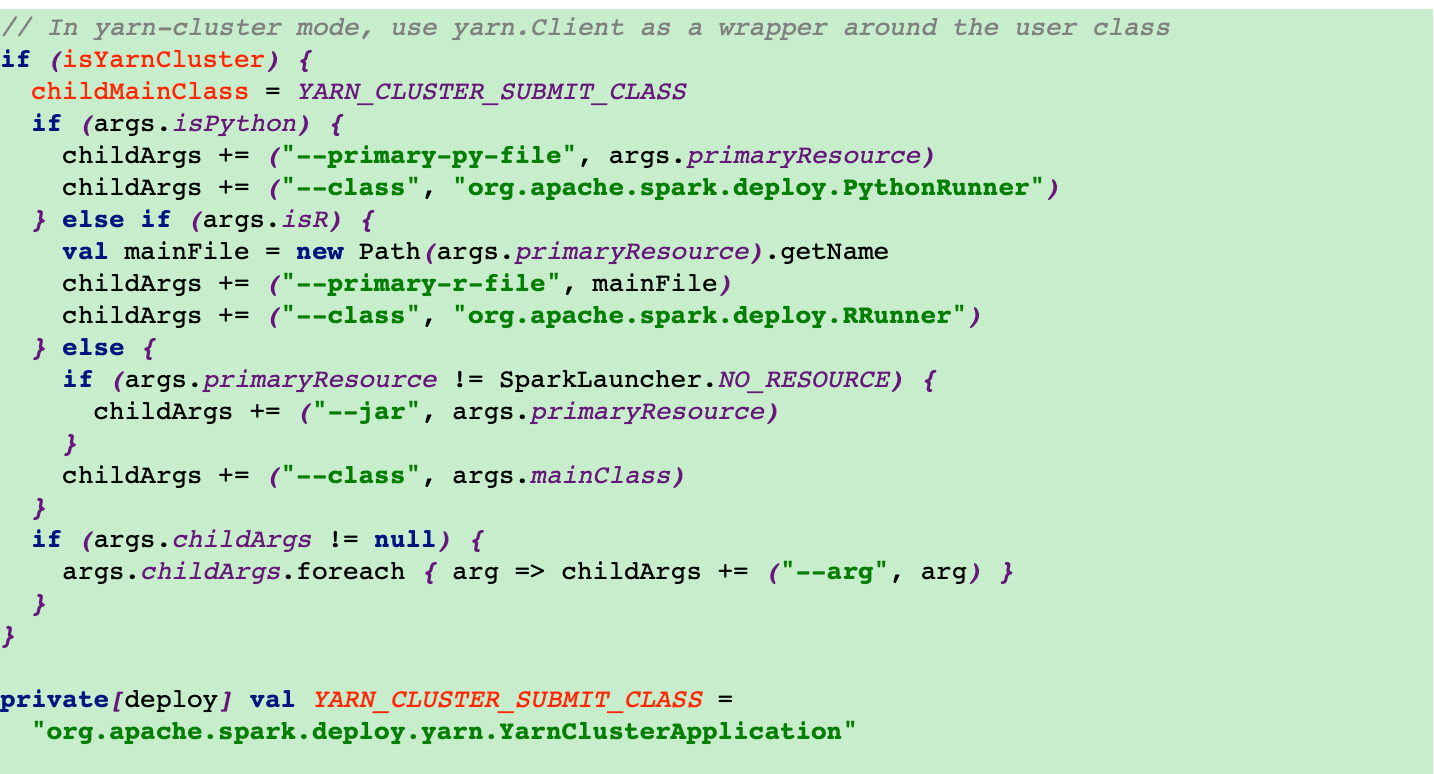

在这里根据提交模式来选择mainClass

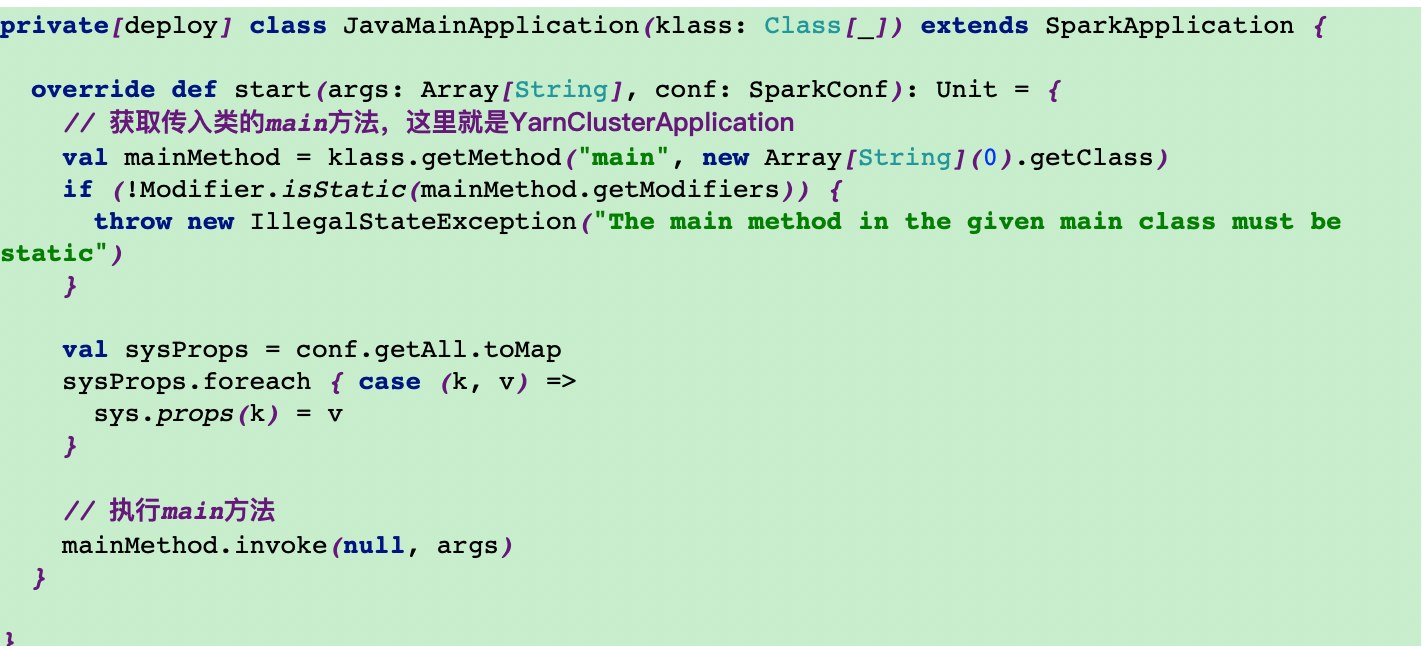

6.在start方法里面去调用YarnClusterApplication的start方法

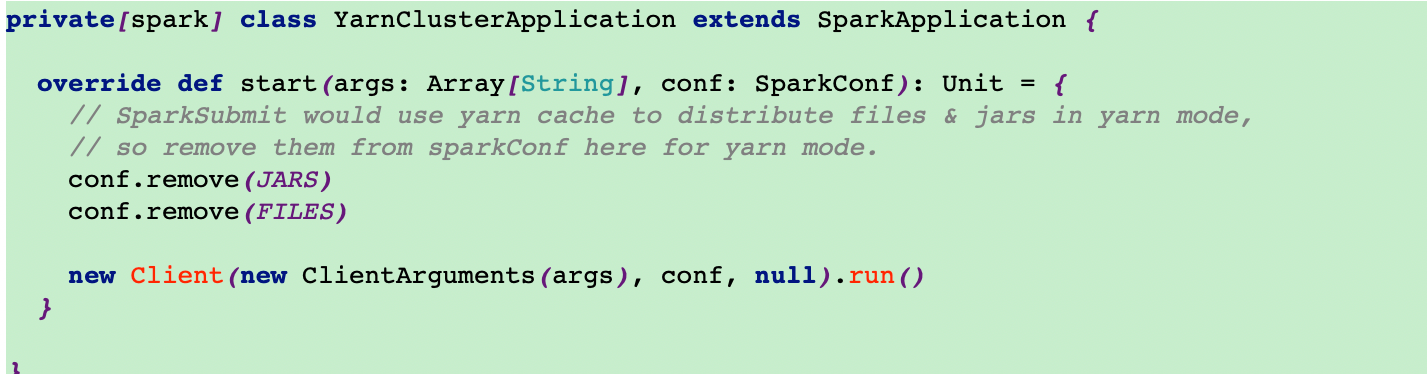

7.YarnClusterApplication方法里面new一个yarnClient对象,并执行run方法

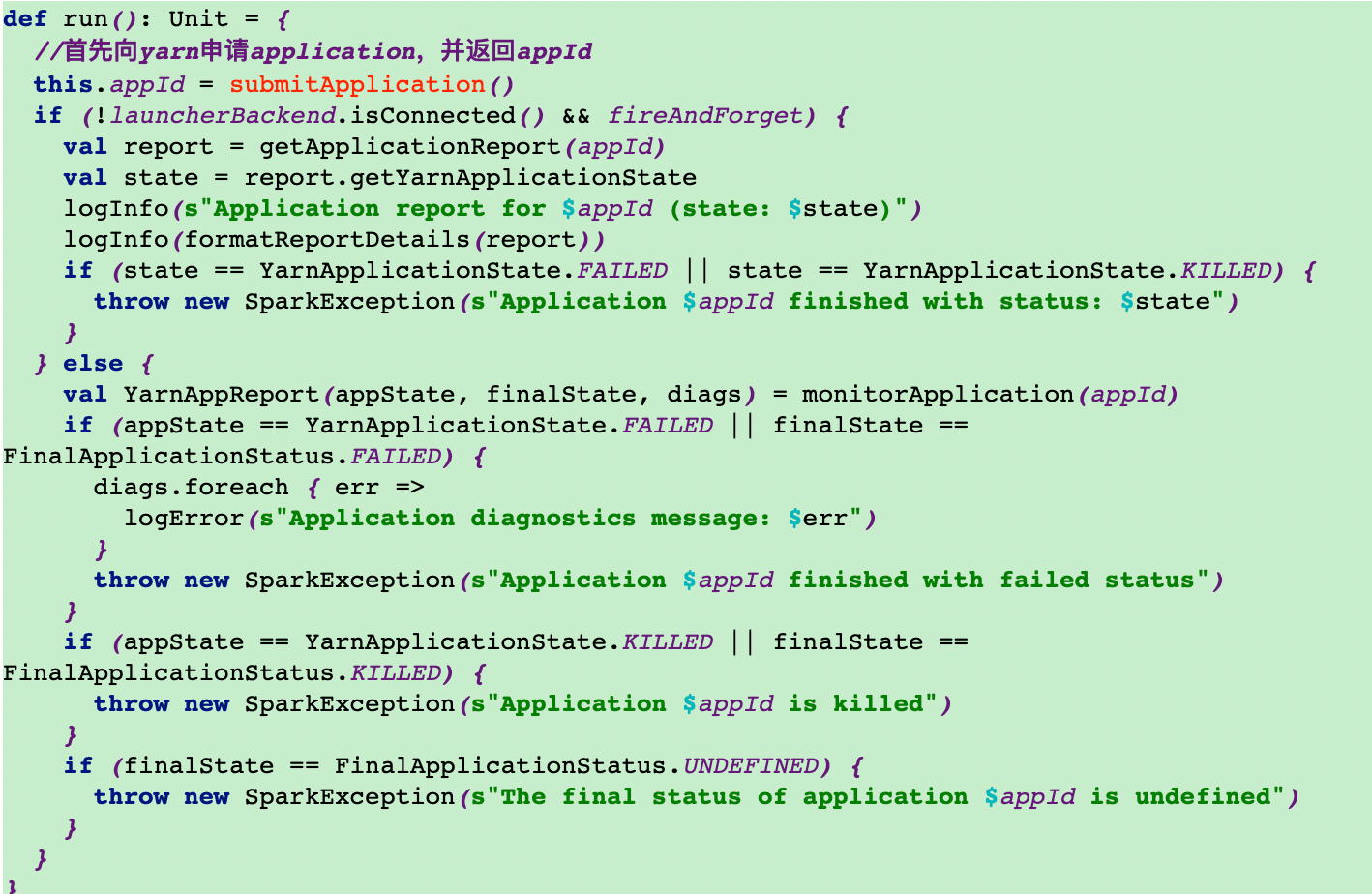

8.run方法里执行submitApplication提交application

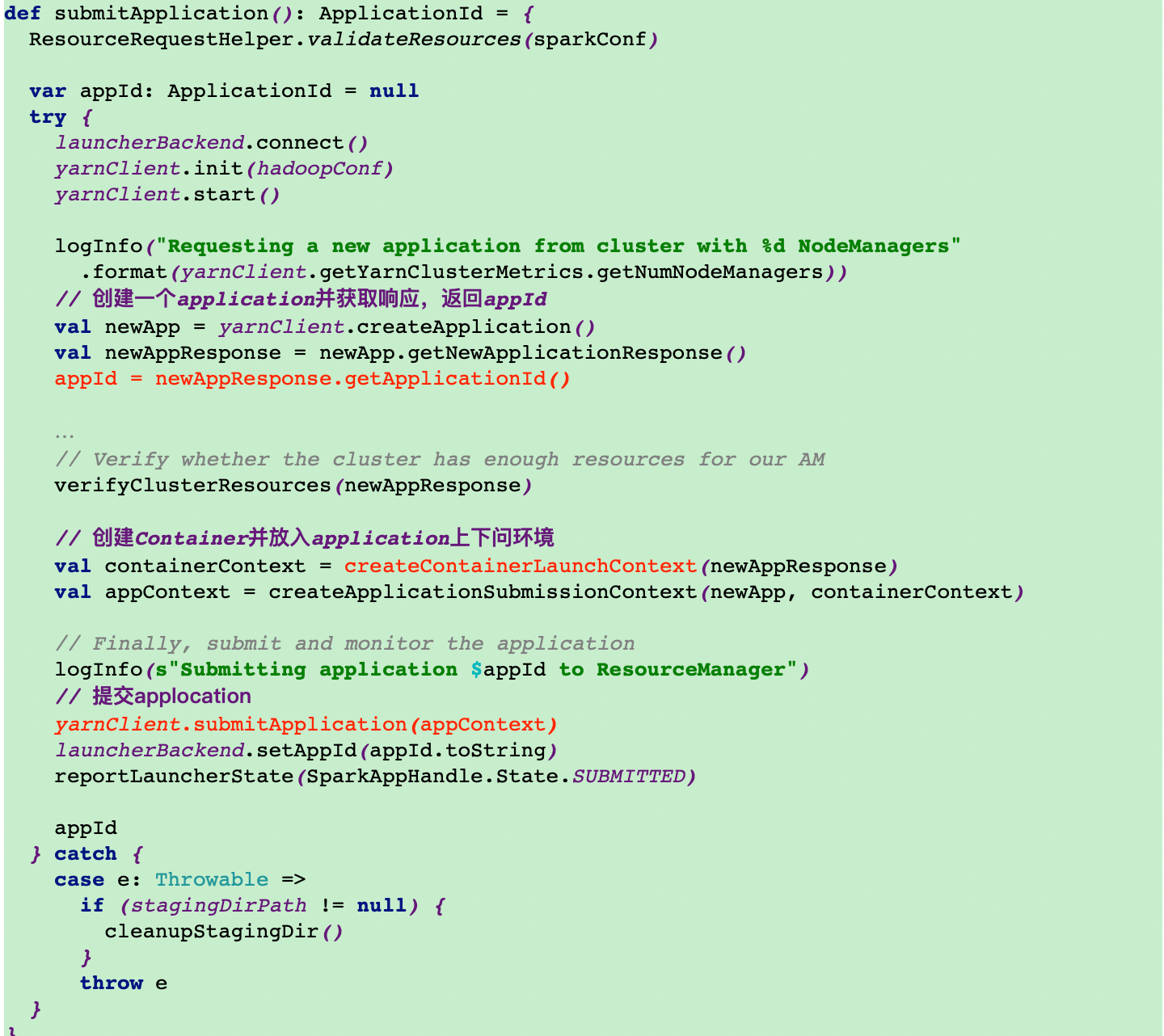

9.submitApplication方法里首先会去请求RM并返回一个appId,然后创建container和application上下文环境并执行submitApplication提交application

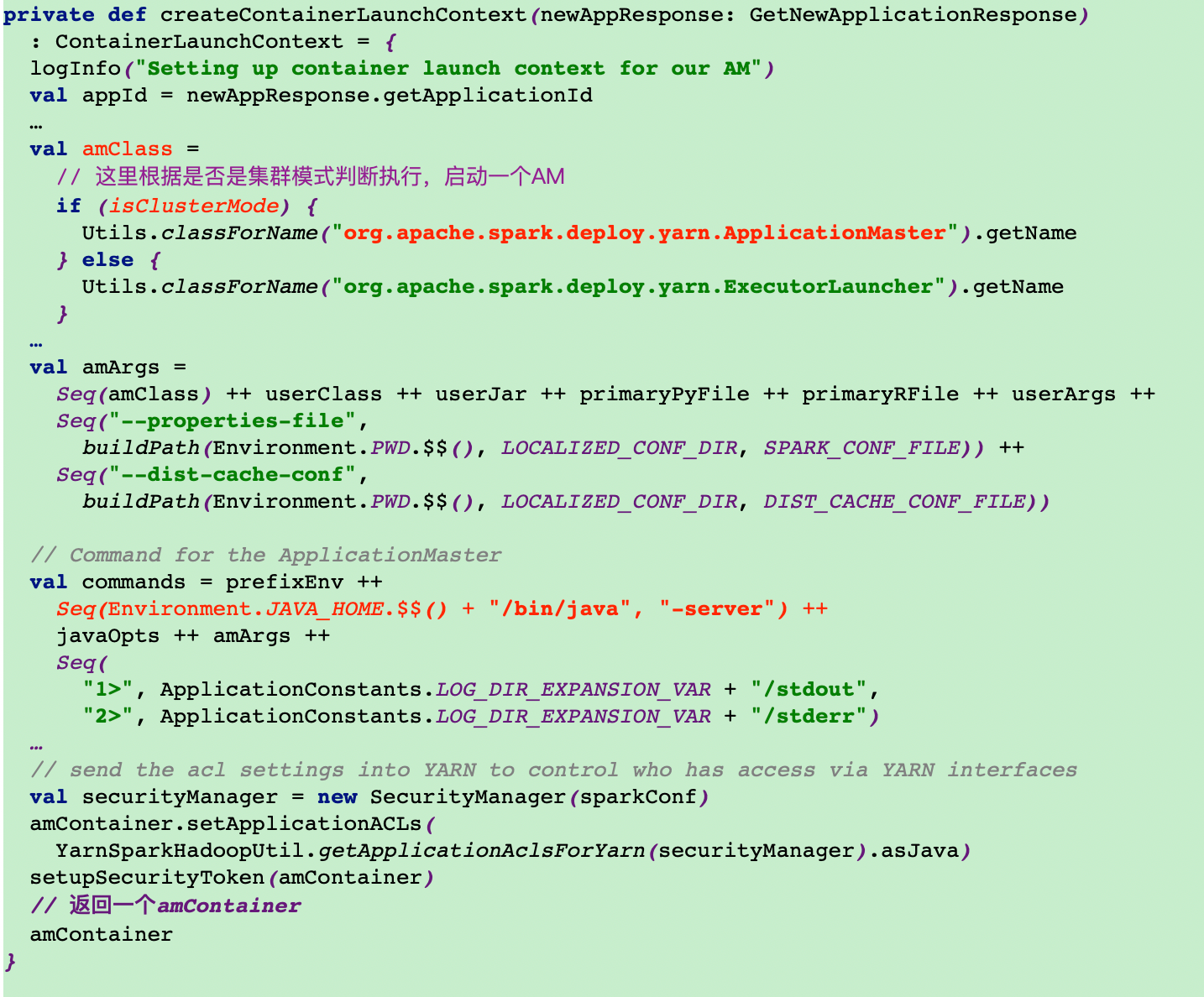

这里通过createContainerLaunchContext方法启动了ApplicationMaster

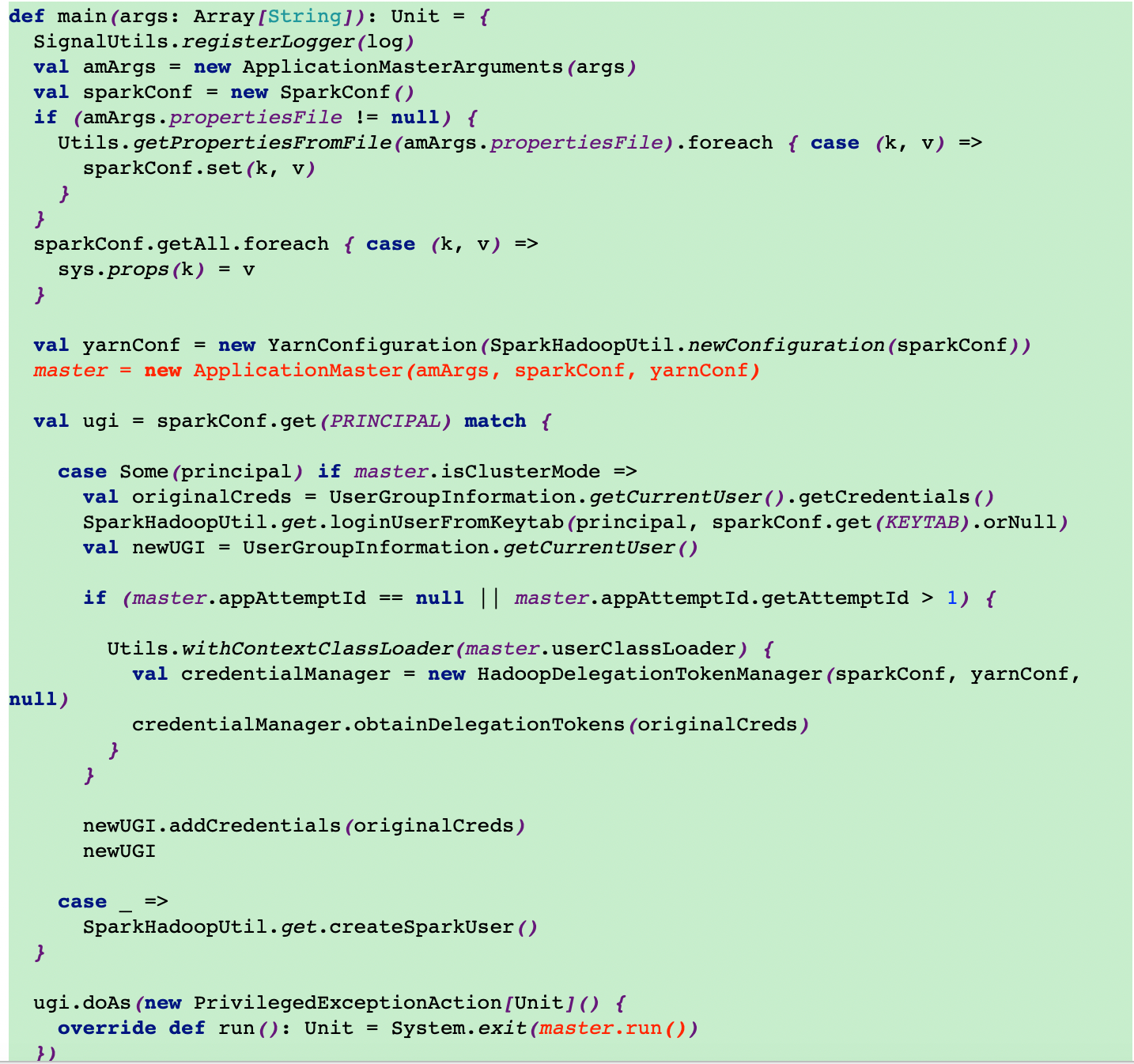

10.调用ApplicationMaster类的main方法

在这里首先new一个ApplicationMaster,然后调用了master的run方法

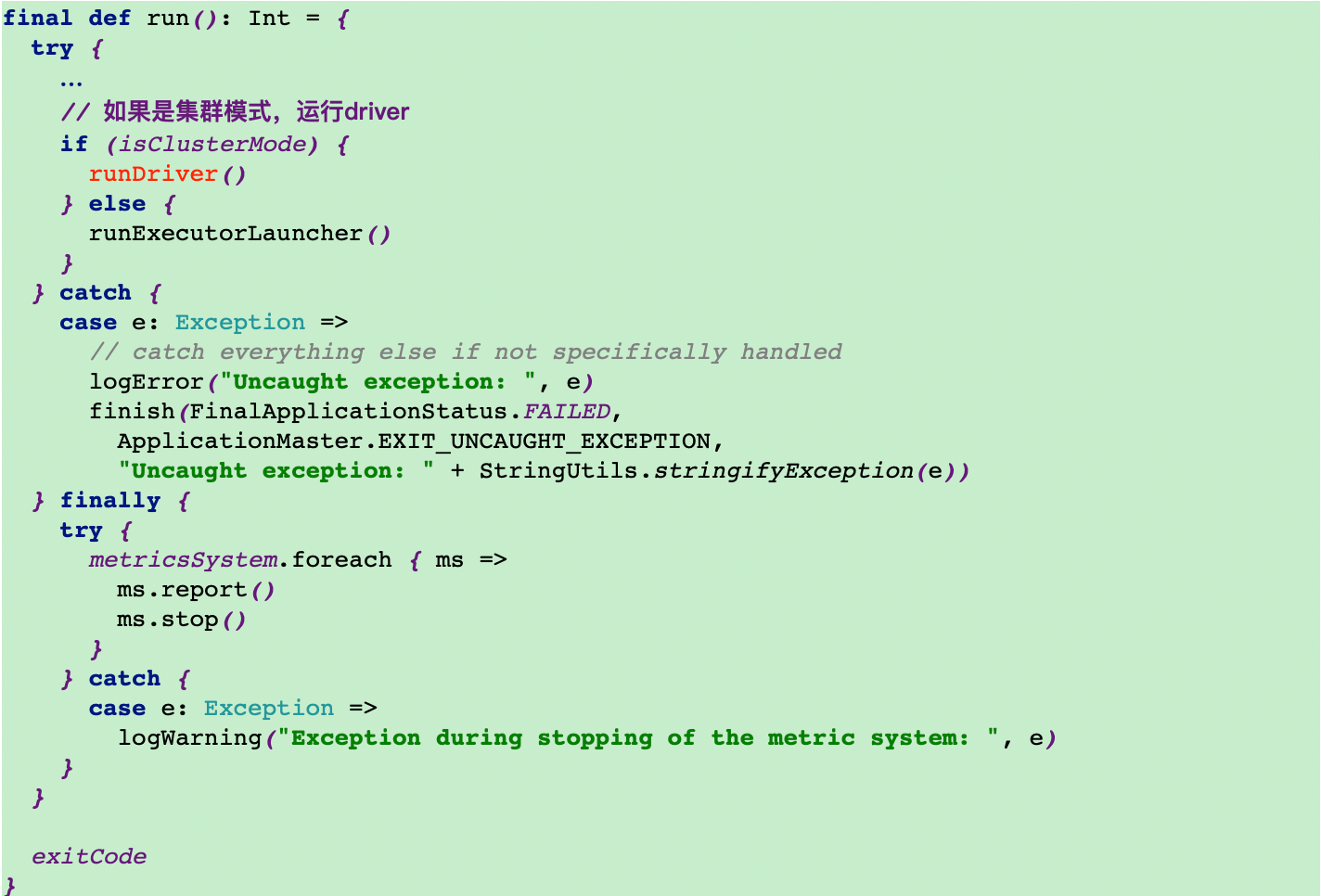

11.调用ApplicationMaster的run方法

这里会根据是否是集群模式执行不同的方法

12.调用runDriver方法

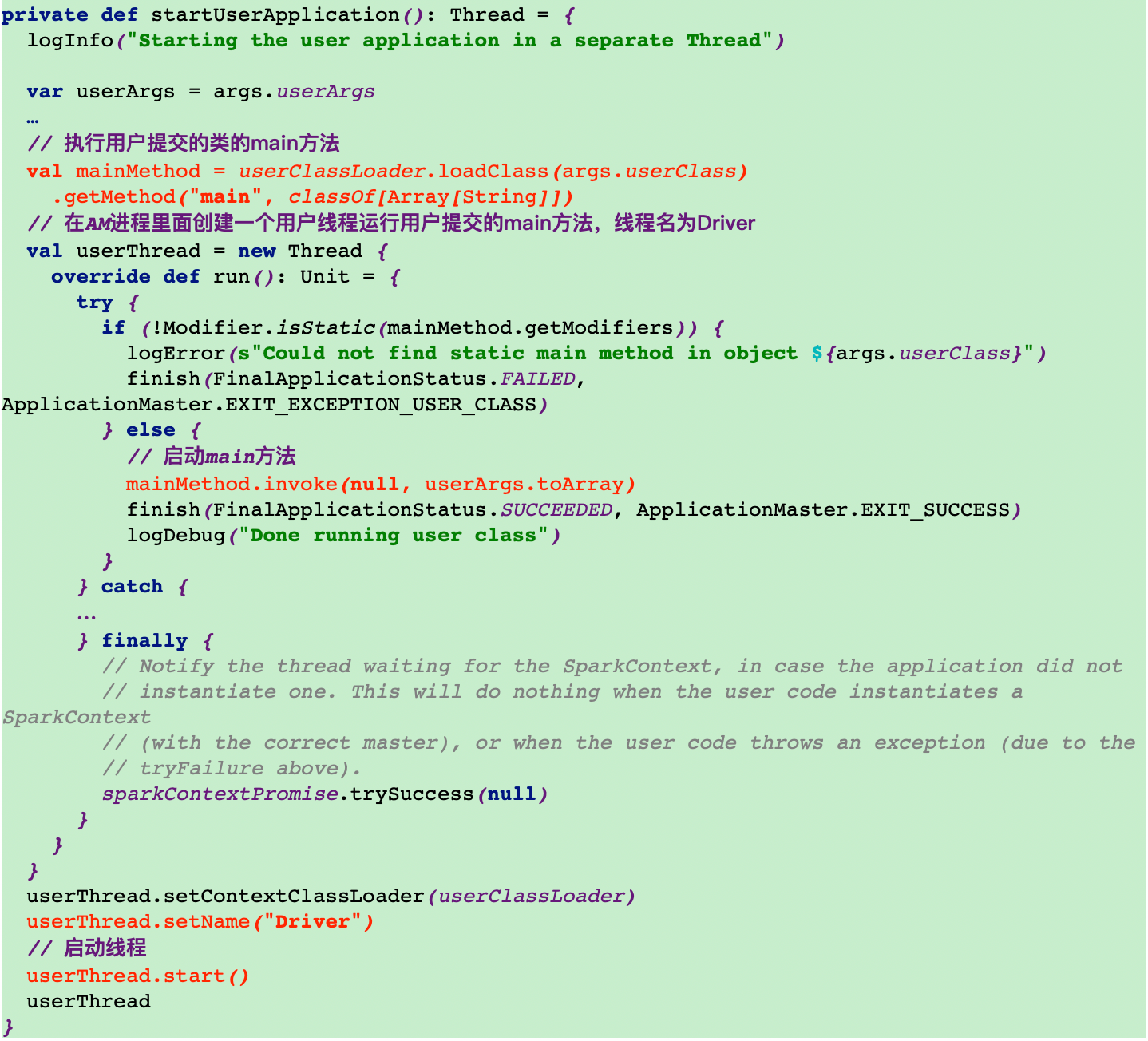

12.1调用startUserApplication方法启动一个driver线程

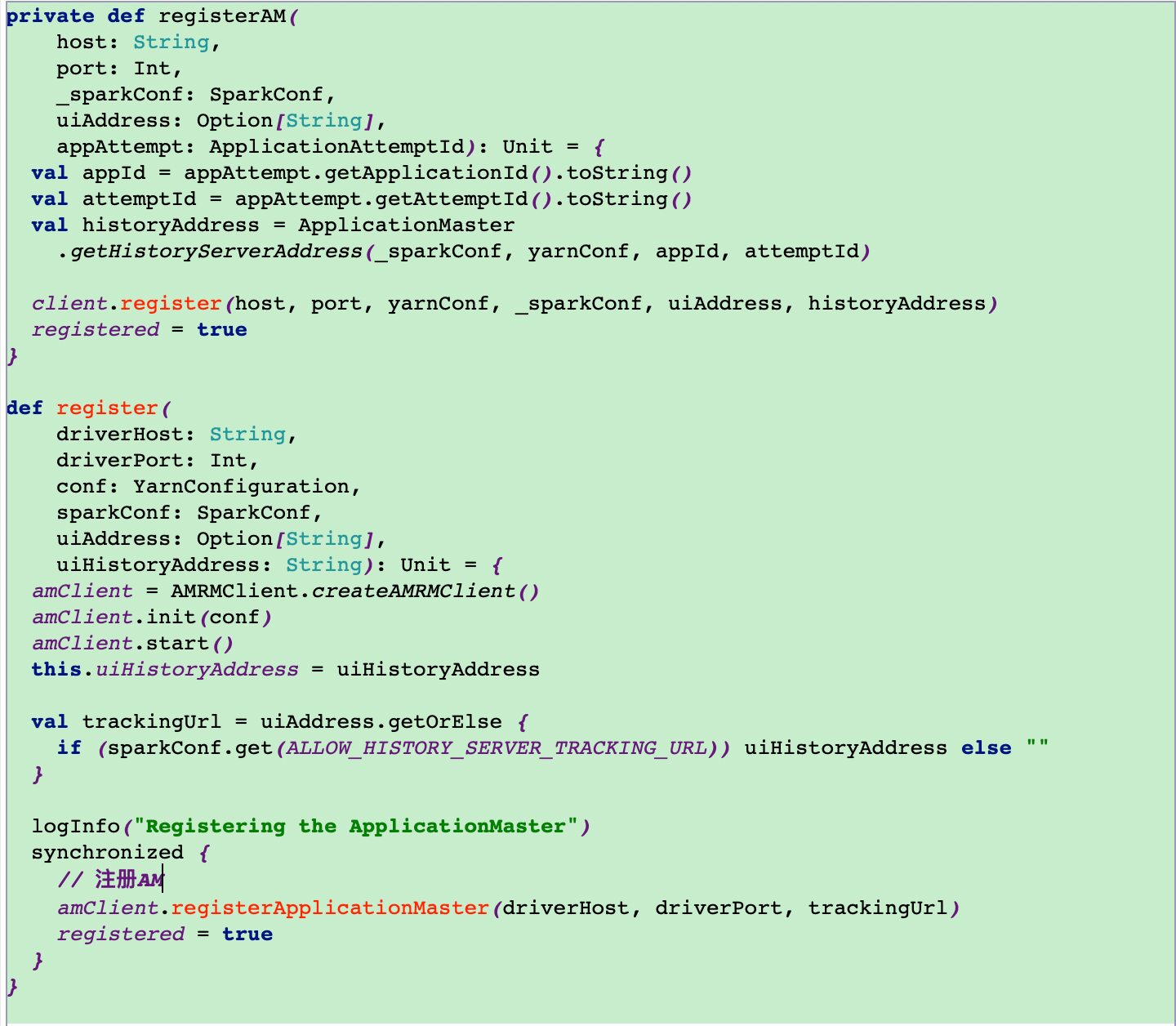

12.2将AM注册到RM

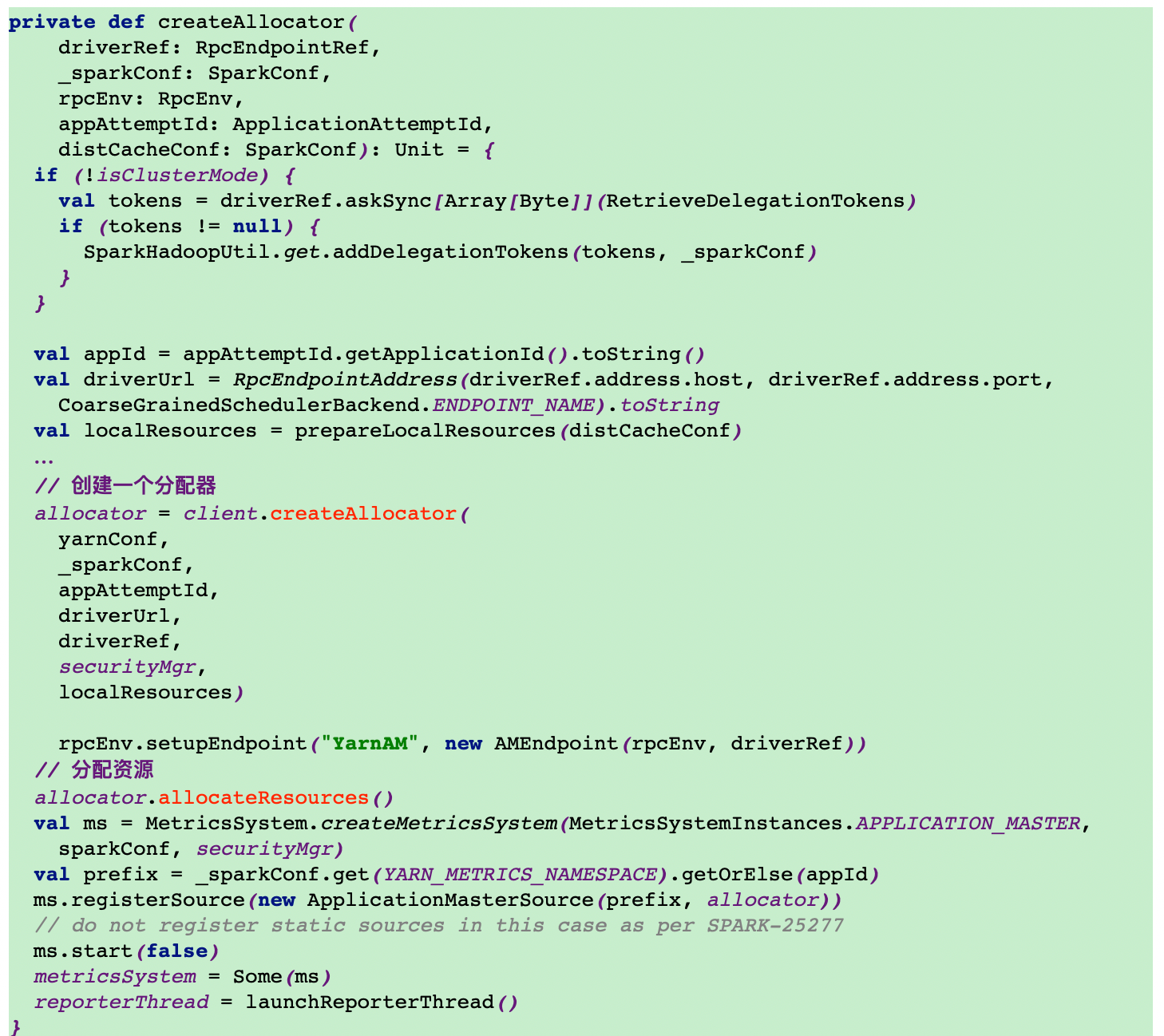

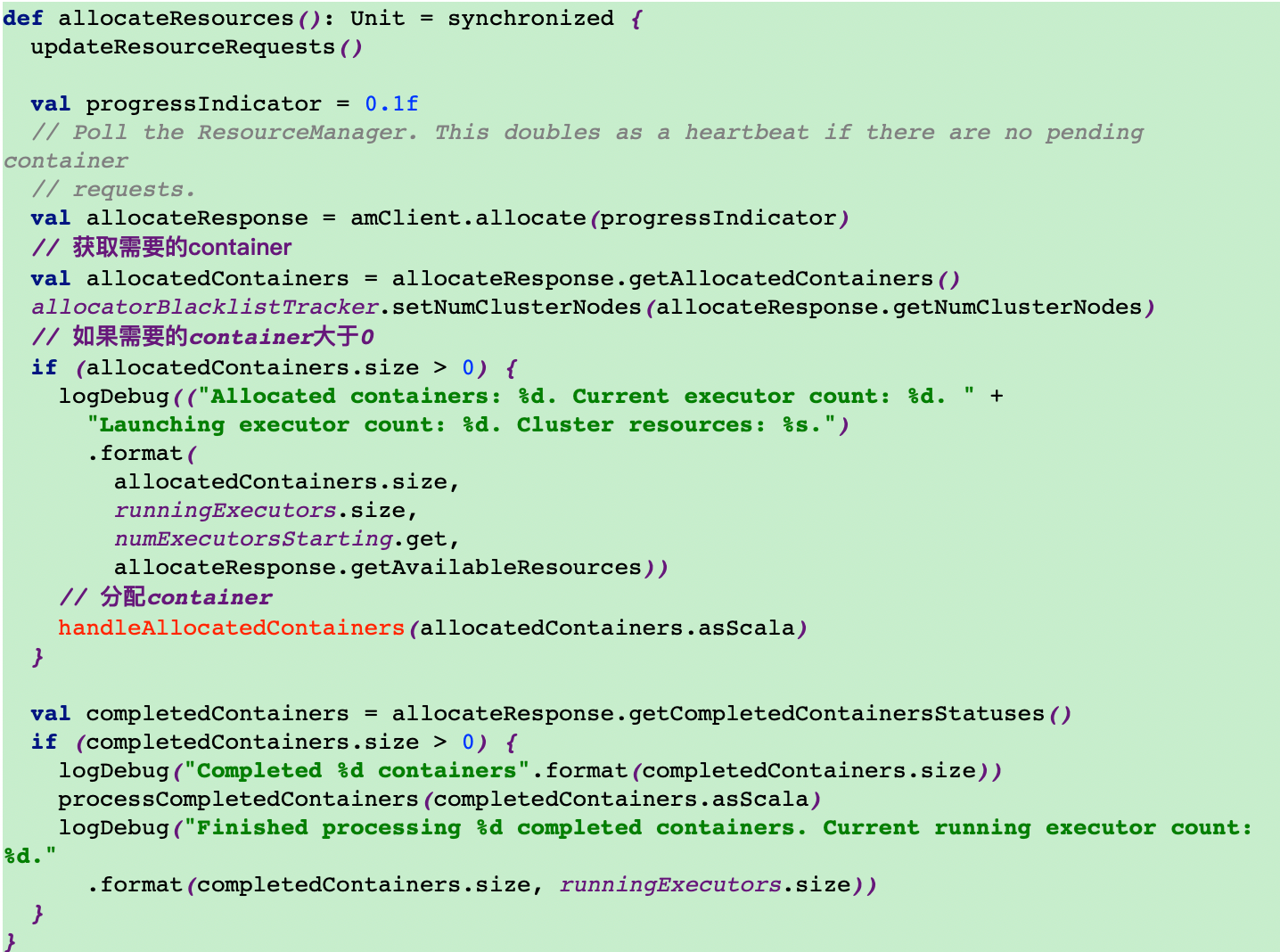

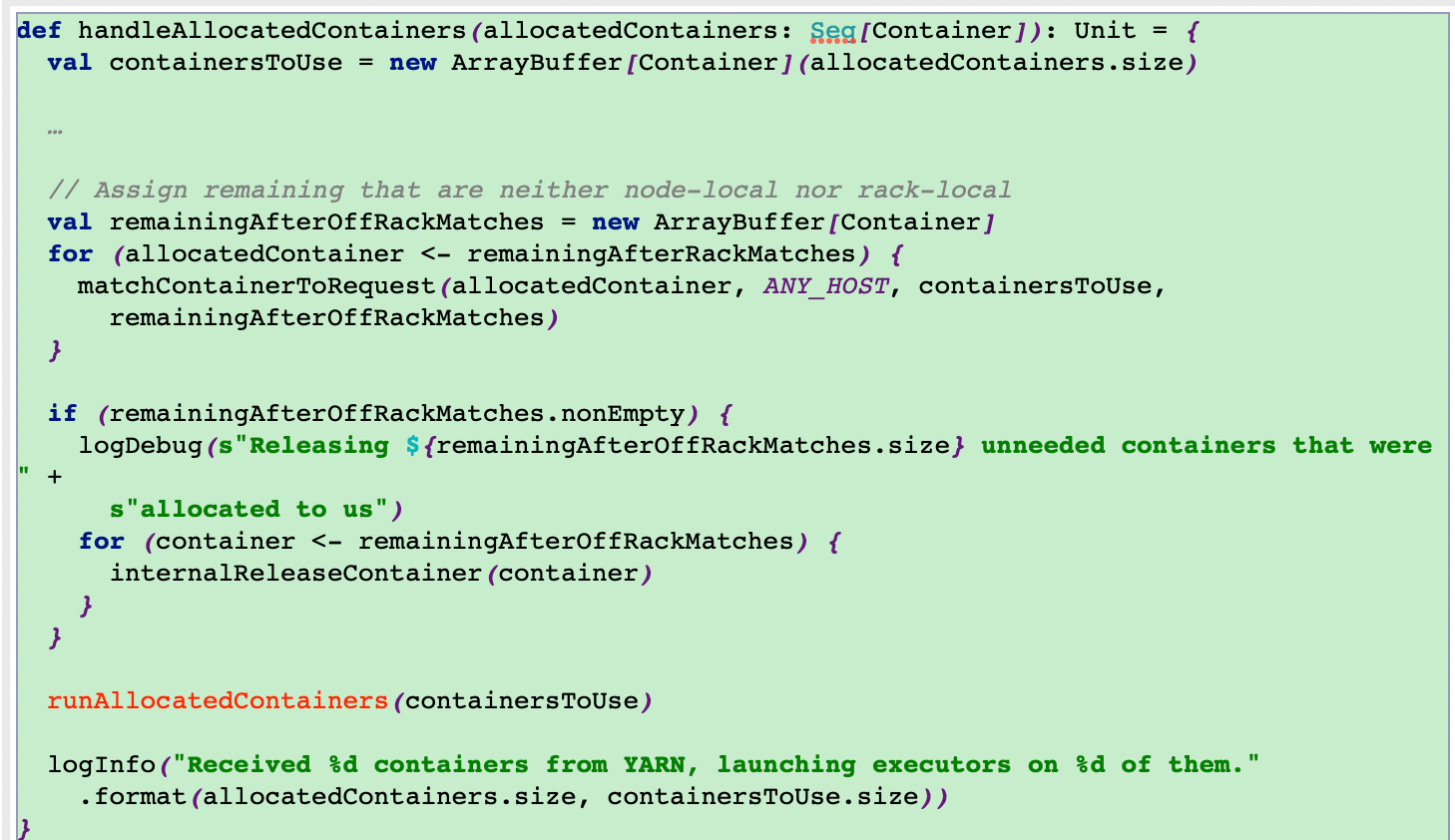

12.3分配资源

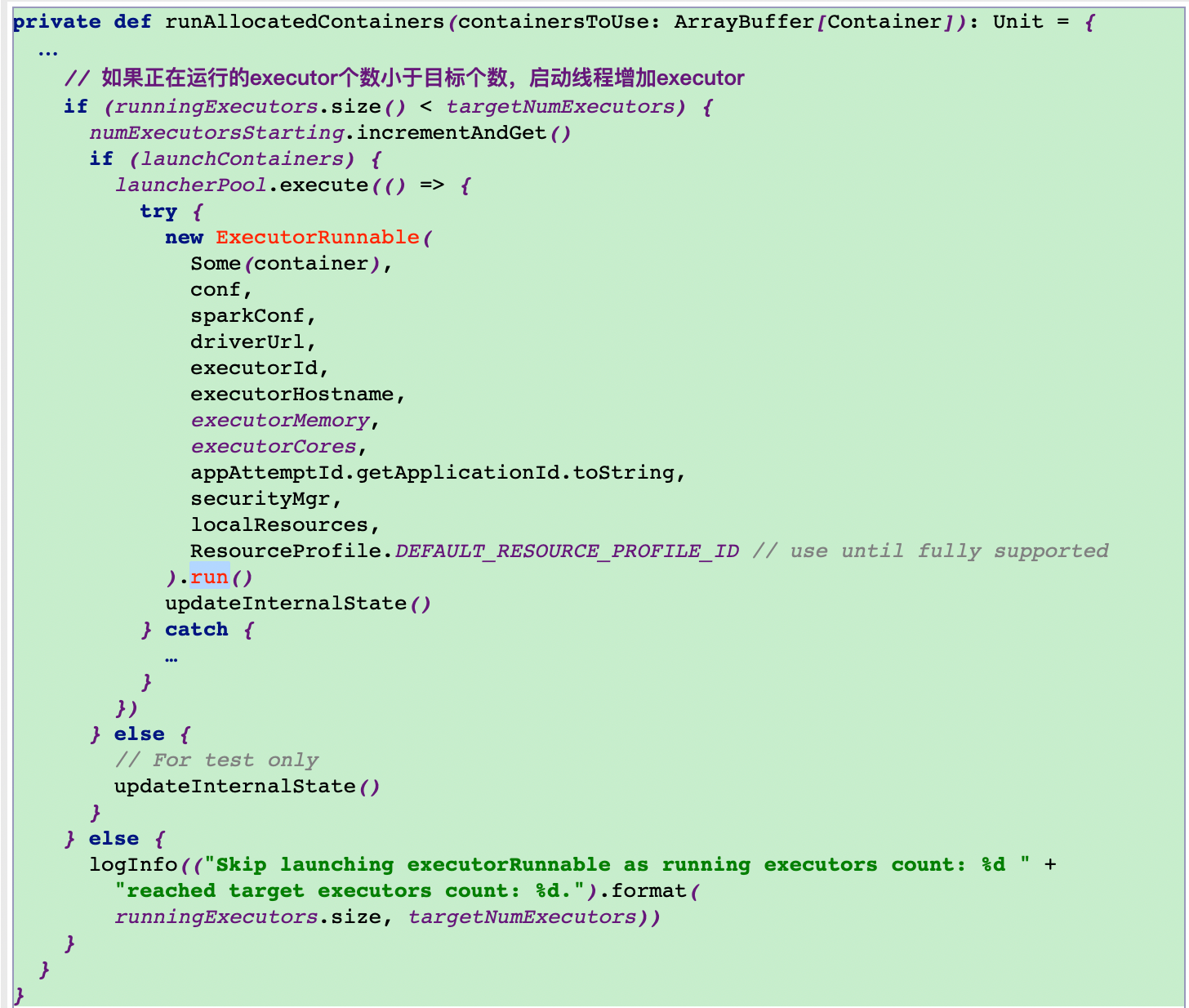

这里通过调用runAllocatedContainers方法在分配的container里面运行executors

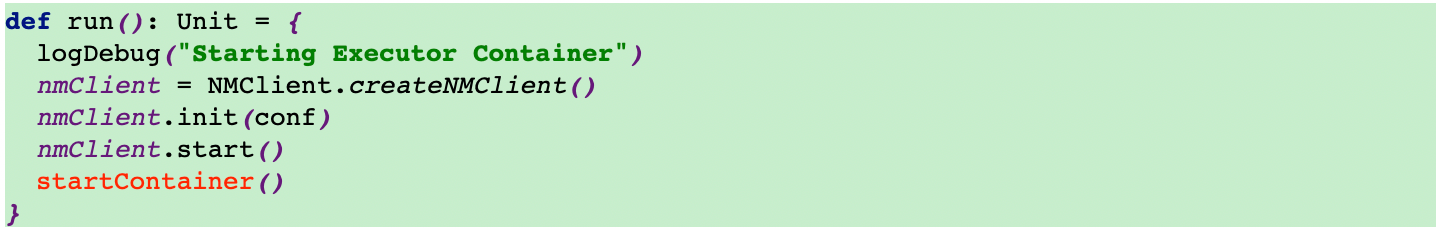

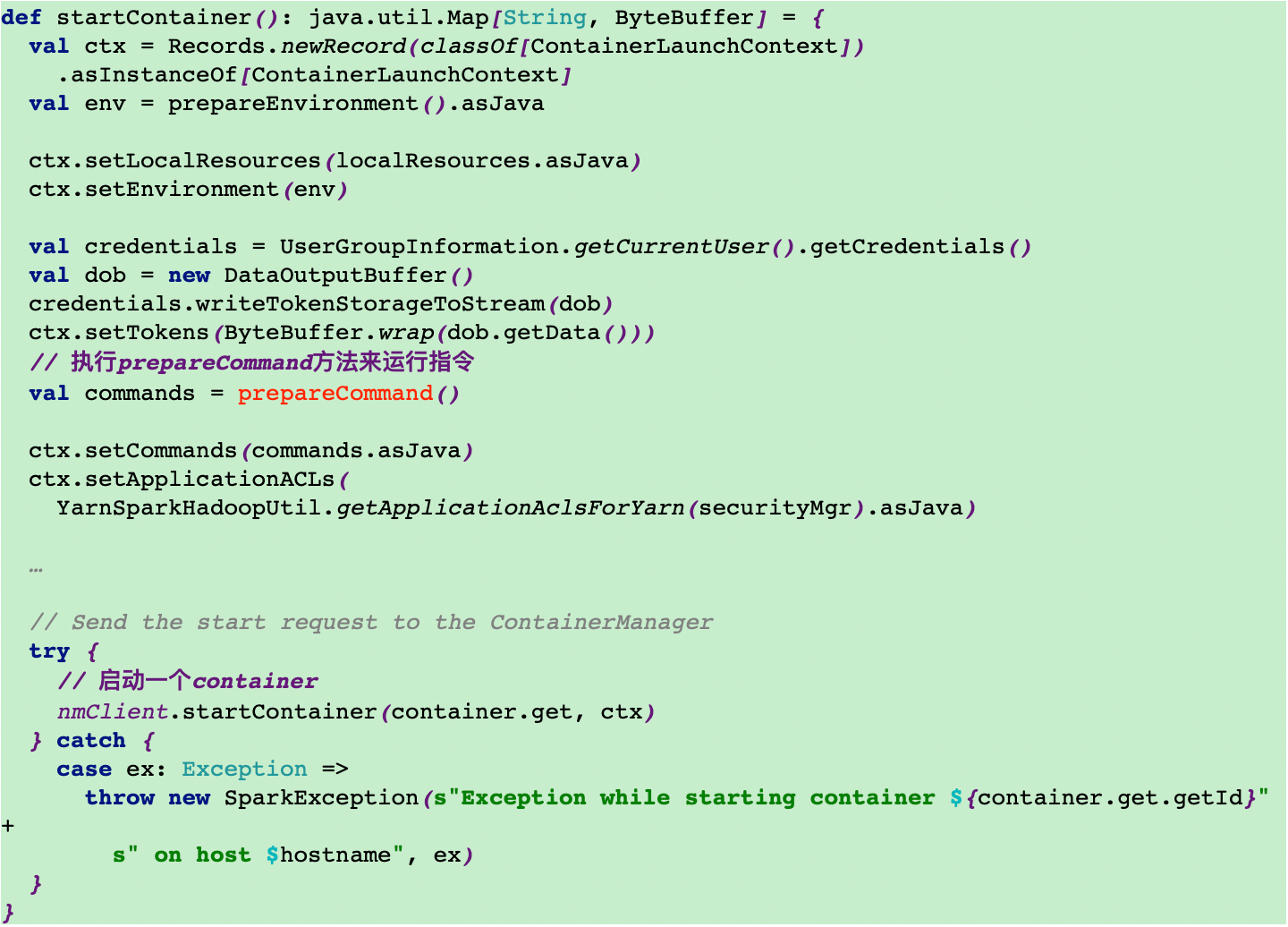

12.4调用ExecutorRunnable的run方法,然后调用run方法里面的startContainer方法来启动executor

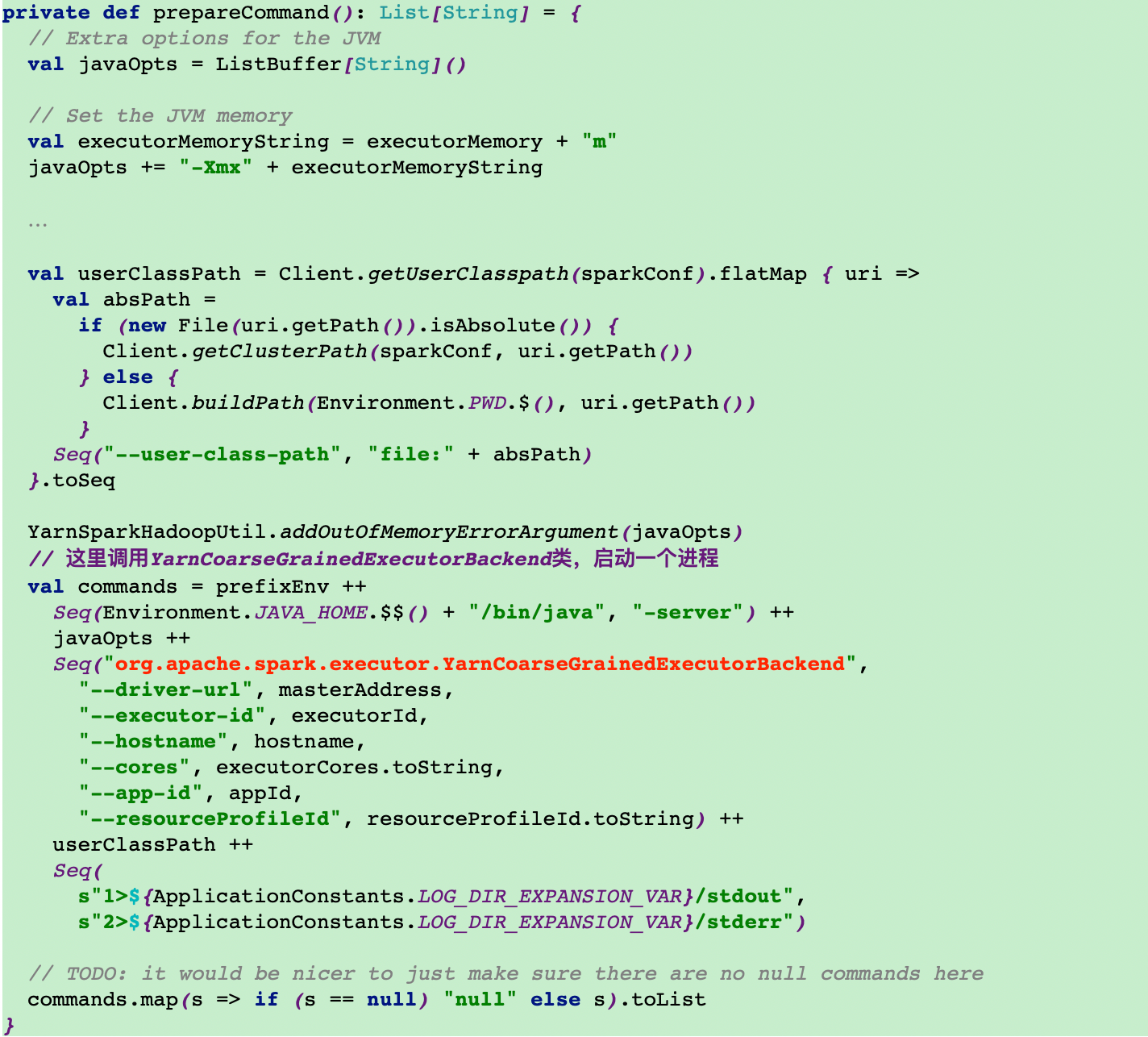

12.5调用prepareCommand方法来运行org.apache.spark.executor.YarnCoarseGrainedExecutorBackend类

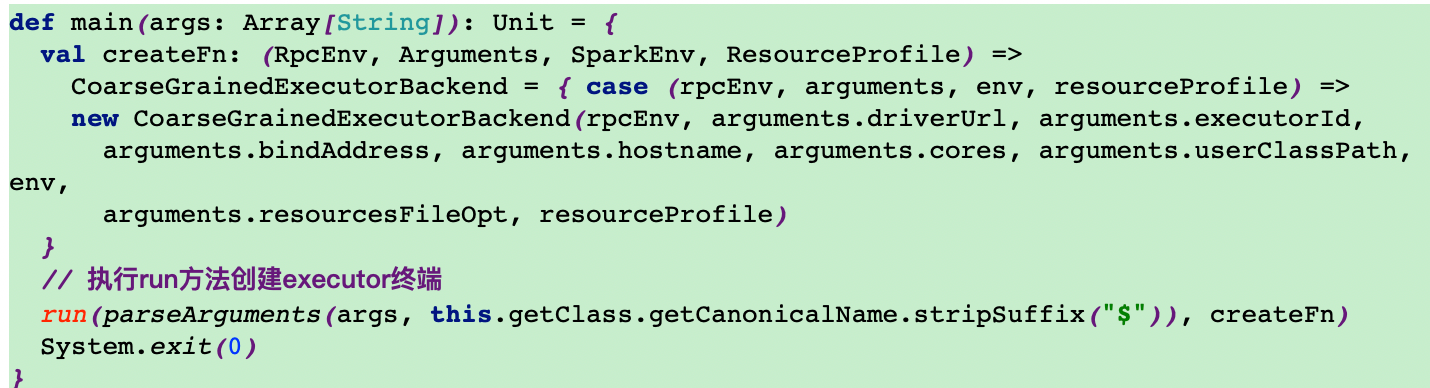

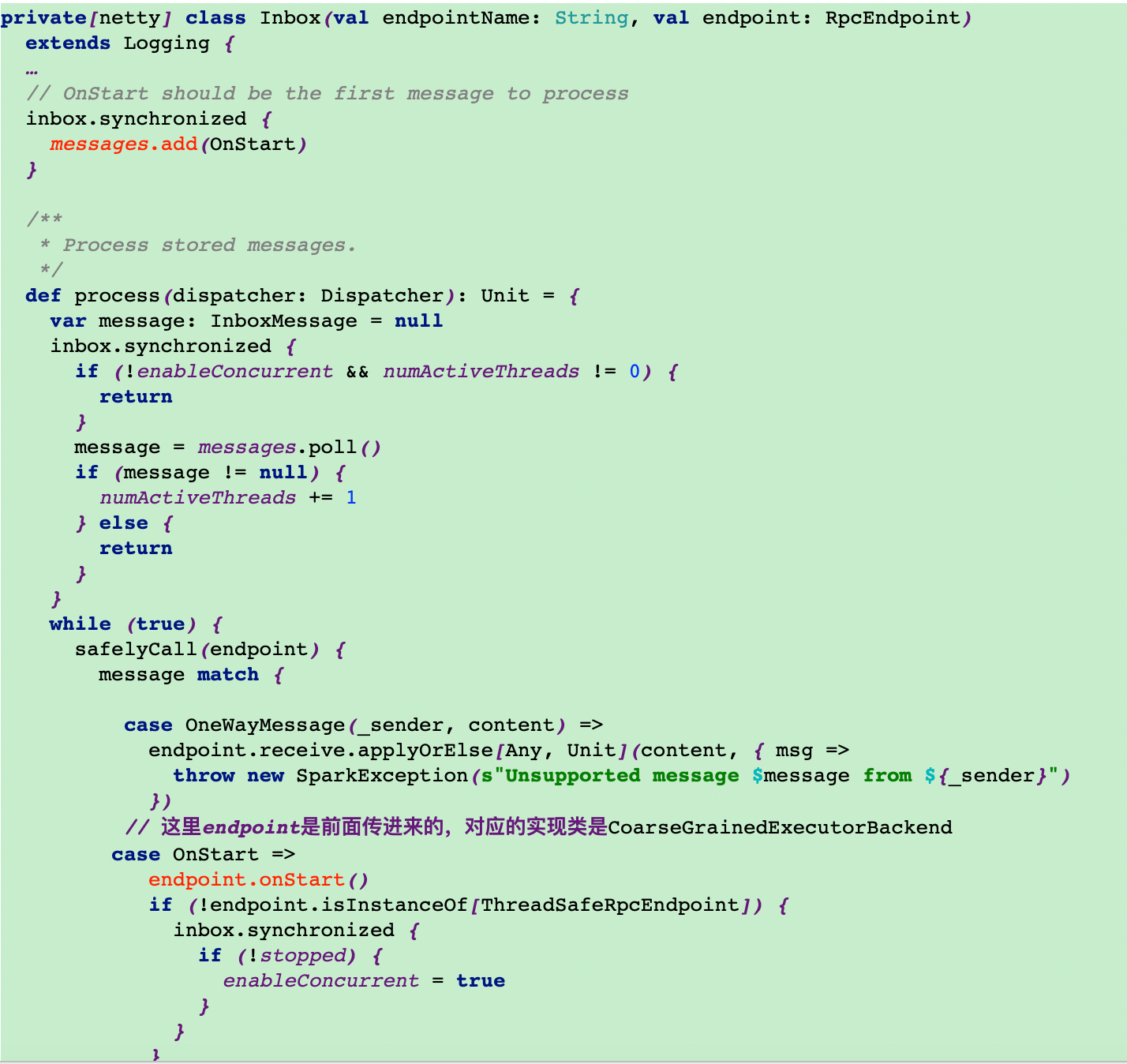

13.执行YarnCoarseGrainedExecutorBackend类main方法的run方法创建executor终端

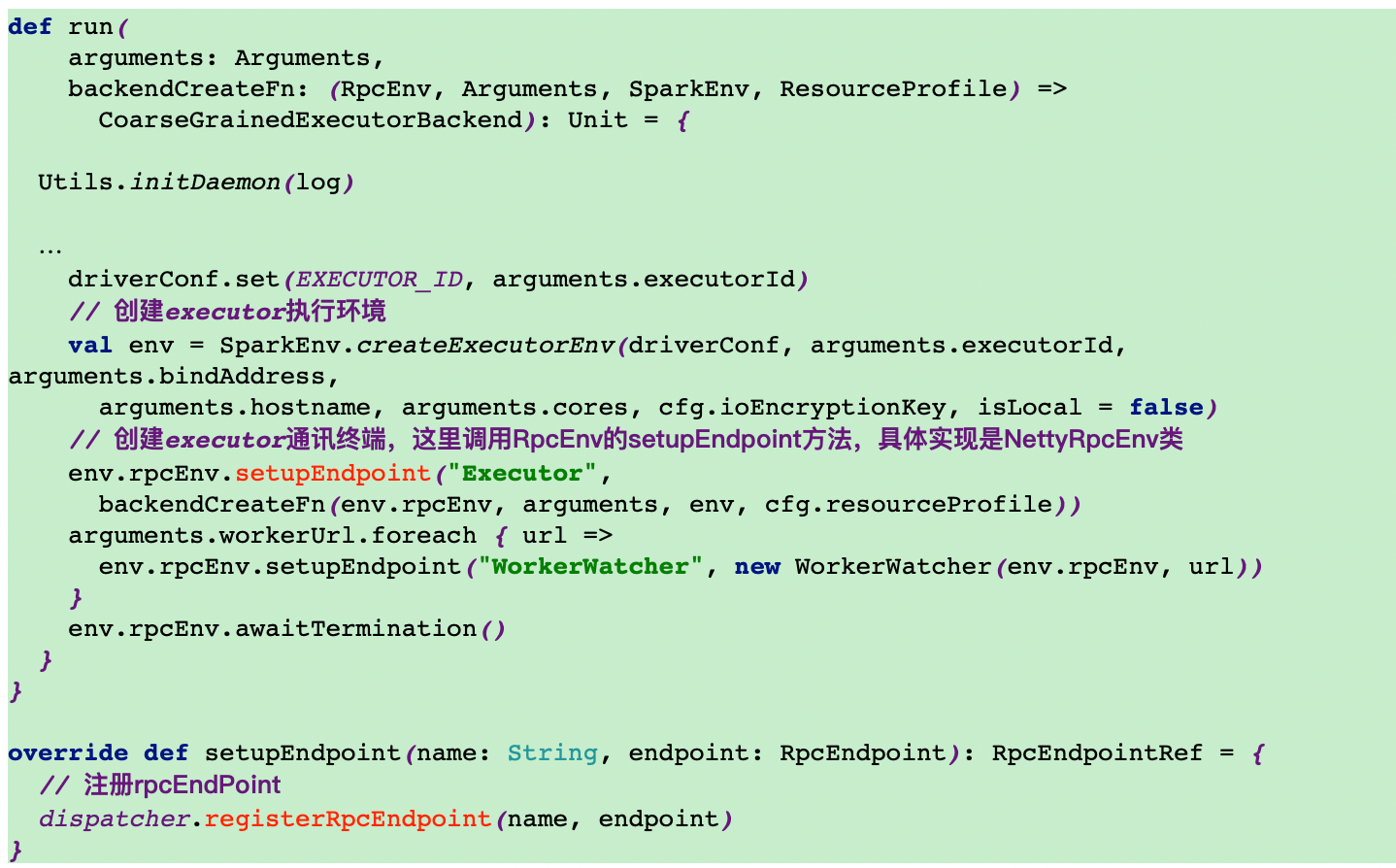

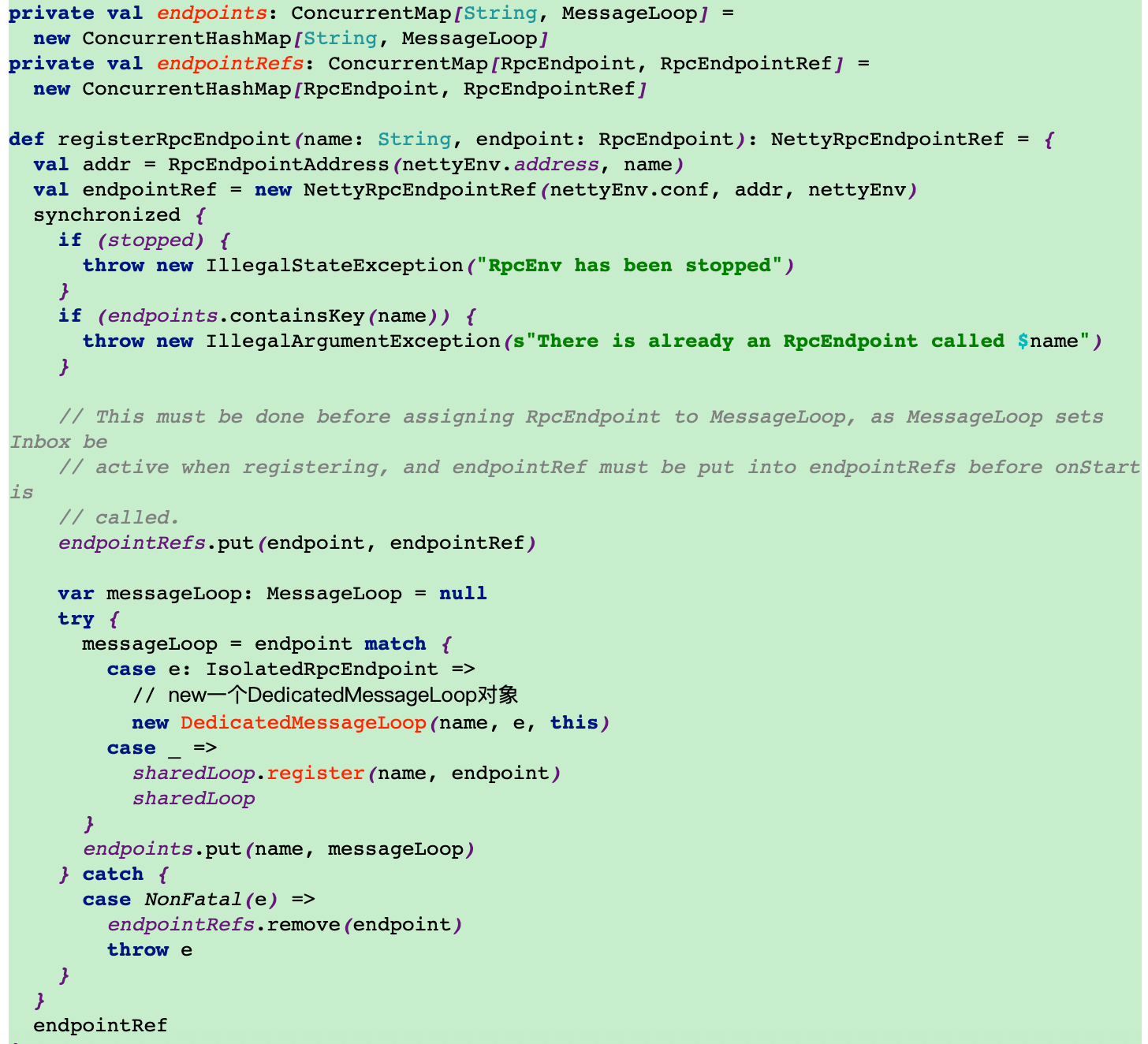

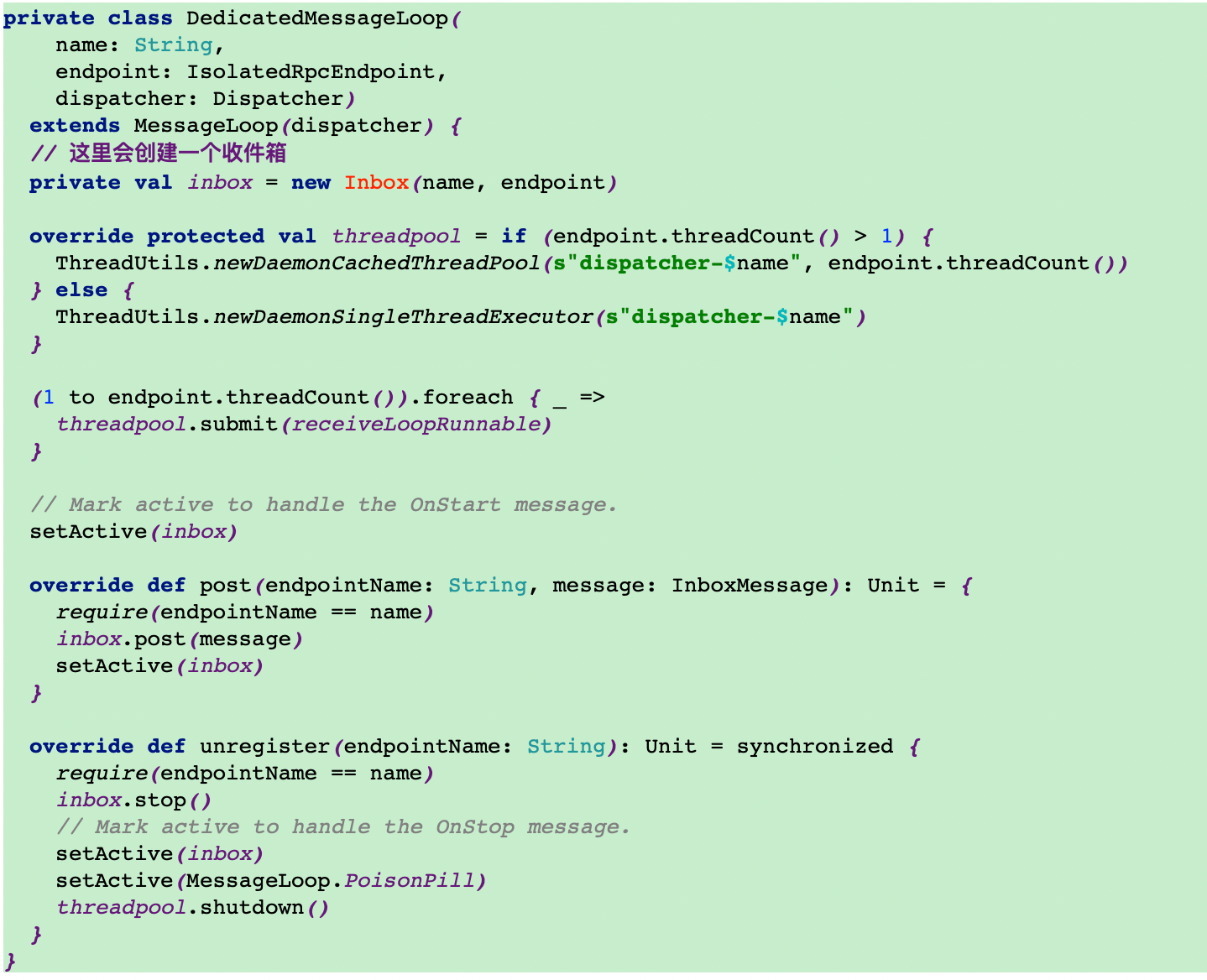

14.调用setupEndpoint创建executor终端

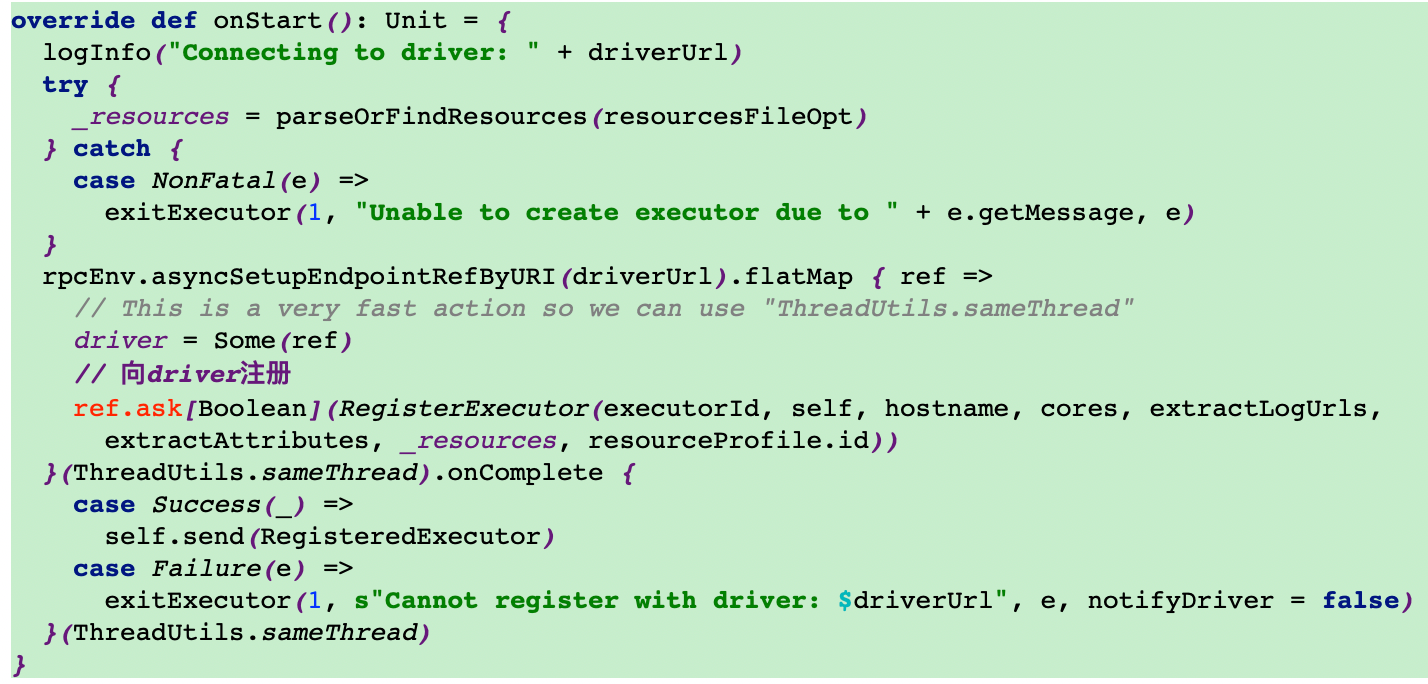

15.反向注册executor到driver

16.driver端接收

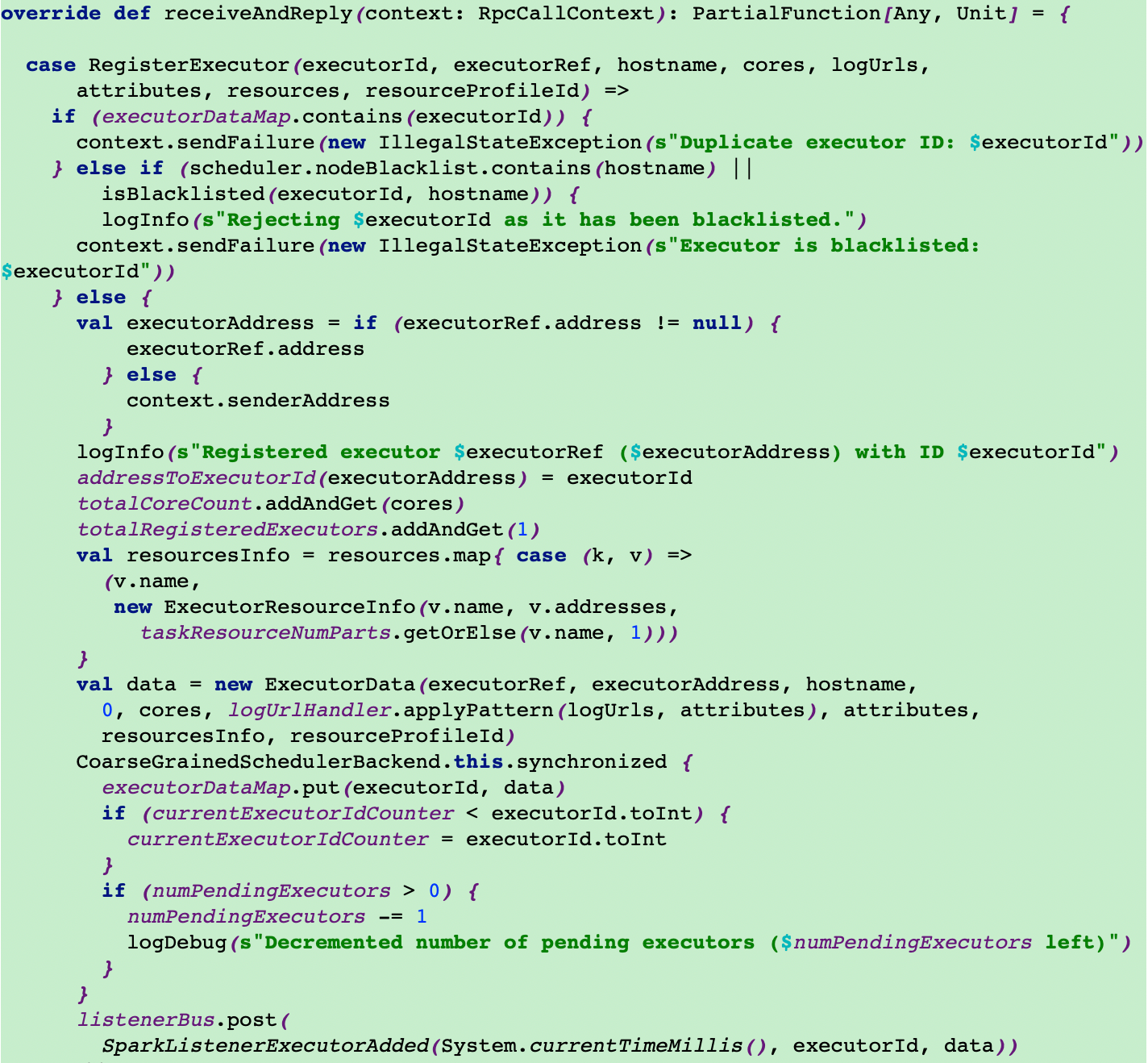

在SparkContext中有SchedulerBackend,它是一个特质,具体实现类为CoarseGrainedSchedulerBackend,该类中有一个receiveAndReply方法来对executor的注册做回复

Spark3.0YarnCluster模式任务提交流程源码分析的更多相关文章

- mapreduce job提交流程源码级分析(三)

mapreduce job提交流程源码级分析(二)(原创)这篇文章说到了jobSubmitClient.submitJob(jobId, submitJobDir.toString(), jobCop ...

- Spark(五十一):Spark On YARN(Yarn-Cluster模式)启动流程源码分析(二)

上篇<Spark(四十九):Spark On YARN启动流程源码分析(一)>我们讲到启动SparkContext初始化,ApplicationMaster启动资源中,讲解的内容明显不完整 ...

- MapReduce之Job提交流程源码和切片源码分析

hadoop2.7.2 MapReduce Job提交源码及切片源码分析 首先从waitForCompletion函数进入 boolean result = job.waitForCompletion ...

- mapreduce job提交流程源码级分析(一)(原创)

首先,在自己写的MR程序中通过org.apache.hadoop.mapreduce.Job来创建Job.配置好之后通过waitForCompletion方法来提交Job并打印MR执行过程的log.H ...

- mapreduce job提交流程源码级分析(二)(原创)

上一小节(http://www.cnblogs.com/lxf20061900/p/3643581.html)讲到Job. submit()方法中的: info = jobClient.submitJ ...

- Spark On YARN(Yarn-Cluster模式)启动流程源码分析(二)

转自:https://www.cnblogs.com/yy3b2007com/p/11087180.html 本章将针对yarn-cluster(--master yarn –deploy-mode ...

- Spark(四十九):Spark On YARN启动流程源码分析(一)

引导: 该篇章主要讲解执行spark-submit.sh提交到将任务提交给Yarn阶段代码分析. spark-submit的入口函数 一般提交一个spark作业的方式采用spark-submit来提交 ...

- [Android]从Launcher开始启动App流程源码分析

以下内容为原创,欢迎转载,转载请注明 来自天天博客:http://www.cnblogs.com/tiantianbyconan/p/5017056.html 从Launcher开始启动App流程源码 ...

- 【高速接口-RapidIO】5、Xilinx RapidIO核例子工程源码分析

提示:本文的所有图片如果不清晰,请在浏览器的新建标签中打开或保存到本地打开 一.软件平台与硬件平台 软件平台: 操作系统:Windows 8.1 64-bit 开发套件:Vivado2015.4.2 ...

随机推荐

- SpringMvc接收multipart/form-data 传输的数据 及 PostMan各类数据类型的区别

前段时间遇到一个问题,在spring mvc 服务端接收post请求时,通过html 表单提交的时候,服务端能够接收到参数的值.但是使用httpclient4.3构造post请求,却无法接收到参数的值 ...

- Python笔试——毕业旅行问题

毕业旅行问题 小明目前在做一份毕业旅行的规划.打算从北京出发,分别去若干个城市,然后再回到北京,每个城市之间均乘坐高铁,且每个城市只去一次.由于经费有限,希望能够通过合理的路线安排尽可能的省一些路上的 ...

- springboot多环境部署(profile多环境支持)

springboot多环境部署(profile多环境支持) 背景 项目开发过程中会有开发环境(dev),测试环境(test)和生产环境(prod),不同的环境需要配置不同的配置,profile提供 ...

- 简单认识Adam优化器

转载地址 https://www.jianshu.com/p/aebcaf8af76e 基于随机梯度下降(SGD)的优化算法在科研和工程的很多领域里都是极其核心的.很多理论或工程问题都可以转化为对目标 ...

- JS实现call,apply,bind函数

实现之前的预备知识 ...用作展开 ...用作剩余参数 Object.create()的作用 原型链与构造函数 这些有时间补上吧 call函数实现 Function.prototype.myCall ...

- Maven项目在进行单元测试报错:ClassNoFoundExceptipon

解决方法: 只要把Java--------compiler-------building-------Buil path problems ------- incomplete build path ...

- 浏览器自动化的一些体会8 HttpWebRequest的几个问题

前面说过了,httpWebRequest的好处在于轻量,不需要界面,缺点在于无法执行javascript.这里再归纳一些问题. 1. 设置代理 1) httpWebRequest不支持https的代理 ...

- python去除 数据的 重复行

原文链接:https://www.cnblogs.com/loren880898/p/11303672.html

- topic的相关操作

1.建立topic cd 进入kafka的安装根目录的bin目录下 执行:./kafka-topics.sh --zookeeper ip:port,ip:port,ip:port/kafka-tes ...

- pandas | DataFrame中的排序与汇总方法

本文始发于个人公众号:TechFlow,原创不易,求个关注 今天是pandas数据处理专题的第六篇文章,我们来聊聊DataFrame的排序与汇总运算. 在上一篇文章当中我们主要介绍了DataFrame ...