动量法应用NASA测试不同飞机机翼噪音

%matplotlib inline

from mxnet import nd

import numpy as np

from mxnet import autograd,gluon,init,nd

from mxnet.gluon import nn,data as gdata,loss as gloss

import time def get_data():

data = np.genfromtxt('./data/airfoil_self_noise.dat', delimiter='\t')

data = (data - data.mean(axis=0)) / data.std(axis=0)

return nd.array(data[:1500, :-1]), nd.array(data[:1500, -1]) features, labels = get_data()

features[0]

labels[0] # 定义网络

def linreg(X,w,b):

return nd.dot(X,w) + b # 平方损失

def squared_loss(y_hat,y):

return (y_hat - y.reshape(y_hat.shape))**2/2 # 初始化参数

def init_momentum_states():

v_w = nd.zeros((features.shape[1], 1))

v_b = nd.zeros(1)

return (v_w, v_b) # params [w,b]

# states [v_w,v_b] 初始化状态

# hyperparams {'lr':0.02,'momentum':0.5}

def sgd_momentum(params, states, hyperparams):

for p, v in zip(params, states):

v[:] = hyperparams['momentum'] * v + hyperparams['lr'] * p.grad

p[:] -= v def train(trainer_fn, states, hyperparams, features, labels,

batch_size=10, num_epochs=2):

# 初始化模型。

net, loss = gb.linreg, gb.squared_loss

w = nd.random.normal(scale=0.01, shape=(features.shape[1], 1))

b = nd.zeros(1)

w.attach_grad()

b.attach_grad() def eval_loss():

return loss(net(features, w, b), labels).mean().asscalar() ls = [eval_loss()]

data_iter = gdata.DataLoader(

gdata.ArrayDataset(features, labels), batch_size, shuffle=True)

for _ in range(num_epochs):

start = time.time()

for batch_i, (X, y) in enumerate(data_iter):

with autograd.record():

l = loss(net(X, w, b), y).mean() # 使用平均损失。

l.backward()

trainer_fn([w, b], states, hyperparams) # 迭代模型参数。

if (batch_i + 1) * batch_size % 100 == 0:

ls.append(eval_loss()) # 每 100 个样本记录下当前训练误差。

# 打印结果和作图。

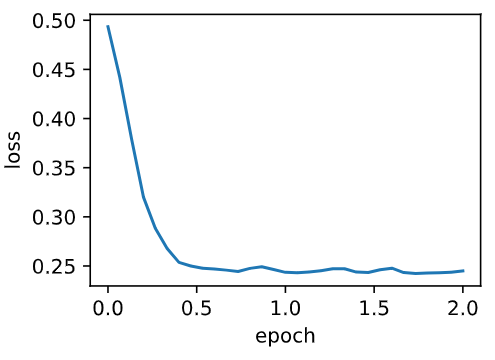

print('loss: %f, %f sec per epoch' % (ls[-1], time.time() - start))

gb.set_figsize()

gb.plt.plot(np.linspace(0, num_epochs, len(ls)), ls)

gb.plt.xlabel('epoch')

gb.plt.ylabel('loss') train(trainer_fn=sgd_momentum,states= init_momentum_states(),hyperparams={'lr': 0.02, 'momentum': 0.5}, features=features, labels=labels) train(sgd_momentum,init_momentum_states(),{'lr':0.02,'momentum':0.9},features,labels) train(sgd_momentum,init_momentum_states(),{'lr':0.004,'momentum':0.9},features,labels)

gluon 版:

def train_gluon(trainer_name,trainer_hyperparams,features,labels,batch_size=10,num_epochs=2):

# 初始化模型

net = nn.Sequential()

net.add(nn.Dense(1))

net.initialize(init.Normal(sigma=0.01))

loss = gloss.L2Loss() def eval_loss():

return loss(net(features),labels).mean().asscalar() ls = [eval_loss()]

data_iter = gdata.DataLoader(gdata.ArrayDataset(features,labels),batch_size,shuffle=True) # 创建 Trainer 实例迭代模型参数

trainer = gluon.Trainer(net.collect_params(),trainer_name,trainer_hyperparams) for _ in range(num_epochs):

start = time.time()

for batch_i, (X,y) in enumerate(data_iter):

with autograd.record():

l = loss(net(X),y)

l.backward()

trainer.step(batch_size)

if (batch_i + 1) * batch_size % 100 ==0:

ls.append(eval_loss()) # 打印结果和作图。

print('loss: %f, %f sec per epoch' % (ls[-1], time.time() - start))

gb.set_figsize()

gb.plt.plot(np.linspace(0, num_epochs, len(ls)), ls)

gb.plt.xlabel('epoch')

gb.plt.ylabel('loss') train_gluon('sgd',{'learning_rate':0.004,'momentum':0.9},features,labels)

动量法应用NASA测试不同飞机机翼噪音的更多相关文章

- NLP之基于Seq2Seq和注意力机制的句子翻译

Seq2Seq(Attention) @ 目录 Seq2Seq(Attention) 1.理论 1.1 机器翻译 1.1.1 模型输出结果处理 1.1.2 BLEU得分 1.2 注意力模型 1.2.1 ...

- NLP之基于Bi-LSTM和注意力机制的文本情感分类

Bi-LSTM(Attention) @ 目录 Bi-LSTM(Attention) 1.理论 1.1 文本分类和预测(翻译) 1.2 注意力模型 1.2.1 Attention模型 1.2.2 Bi ...

- 基于Seq2Seq和注意力机制的句子翻译

Seq2Seq(Attention) 目录 Seq2Seq(Attention) 1.理论 1.1 机器翻译 1.1.1 模型输出结果处理 1.1.2 BLEU得分 1.2 注意力模型 1.2.1 A ...

- NLP之基于Seq2Seq的单词翻译

Seq2Seq 目录 Seq2Seq 1.理论 1.1 基本概念 1.2 模型结构 1.2.1 Encoder 1.2.2 Decoder 1.3 特殊字符 2.实验 2.1 实验步骤 2.2 算法模 ...

- NLP之Bi-LSTM(在长句中预测下一个单词)

Bi-LSTM @ 目录 Bi-LSTM 1.理论 1.1 基本模型 1.2 Bi-LSTM的特点 2.实验 2.1 实验步骤 2.2 实验模型 1.理论 1.1 基本模型 Bi-LSTM模型分为2个 ...

- NLP之TextLSTM(预测单词下一个字母)

LSTM 目录 LSTM 1.理论 1.1 LSTM与RNN 1.1.1 RNN的缺点 1.1.2 LSTM 1.2 LSTM基本结构 2.实验 2.1 实验步骤 2.2 算法模型 1.理论 1.1 ...

- NLP之TextRNN(预测下一个单词)

TextRNN @ 目录 TextRNN 1.基本概念 1.1 RNN和CNN的区别 1.2 RNN的几种结构 1.3 多对多的RNN 1.4 RNN的多对多结构 1.5 RNN的多对一结构 1.6 ...

- NLP之基于TextCNN的文本情感分类

TextCNN @ 目录 TextCNN 1.理论 1.1 基础概念 最大汇聚(池化)层: 1.2 textCNN模型结构 2.实验 2.1 实验步骤 2.2 算法模型 1.理论 1.1 基础概念 在 ...

- 用javascript写星际飞机大战游戏

在github里看到了个不错的脚本游戏,决定亲自动手来写,效果如下 下面是代码的思路分享 把整个代码理解消化确实不容易,但是如果你坚持看完相信你一定会有收获 如果没兴趣可以直接点击下面的链接 复制代码 ...

随机推荐

- 记一次java程序内存溢出问题

一个自然语言处理程序,在封装为web-service后,部署到线上运行. 但最近出现了内存溢出的情况,频繁的out of memory. 先盲目尝试在启动脚本中增加-XX:-UseGCOverhead ...

- ASP.NET MVC4 新手入门教程特别篇之一----Code First Migrations更新数据库结构(数据迁移)修改Entity FrameWork 数据结构(不删除数据)

背景 code first起初当修改model后,要持久化至数据库中时,总要把原数据库给删除掉再创建(DropCreateDatabaseIfModelChanges),此时就会产生一个问题,当我们的 ...

- [javaEE] tomcat内部连接池

在META-INF的目录下,新建context.xml 在程序中获取数据源,通过jndi,这个jndi必须在Servlet中才能获取,并且需要配置web.xml使servlet一启动就拿到数据源 co ...

- 一:SpringIOC&DI

一:spring 1.spring介绍 spring负责管理项目中的所有对象,看作是项目中对象的管家. spring一站式框架: spring框架性质是属于容器性质的 容器中装什么对象就有什么功能,所 ...

- tomcat启动编码等部署遇到问题

版权声明:本文为博主原创文章,转载请注明文章链接.https://blog.csdn.net/xiaoanzi123/article/details/58254318 2017-02-27 21:01 ...

- javascript获取元素样式值

使用css控制页面有4种方式,分别为行内样式(内联样式).内嵌式.链接式.导入式. 行内样式(内联样式)即写在html标签中的style属性中,如<div style="width:1 ...

- Stirling数

第一类: 定义 第一类Stirling数表示表示将 n 个不同元素构成m个圆排列的数目.又根据正负性分为无符号第一类Stirling数 和带符号第一类Stirling数 .有无符号Stir ...

- 在 CentOS6 上安装 GraphicsMagick-1.3.30

在 CentOS6 上安装 GraphicsMagick-1.3.30 1.简介: 1.1.在介绍 GraphicsMagick 前我们不得不先介绍下 ImageMagick: ImageMagick ...

- MASQL语法大全

mysql sql语句大全 1.说明:创建数据库 CREATE DATABASE database-name 2.说明:删除数据库 drop database dbname 3.说明:备份sql se ...

- 各种优化方法总结比较(sgd/momentum/Nesterov/adagrad/adadelta)

前言 这里讨论的优化问题指的是,给定目标函数f(x),我们需要找到一组参数x,使得f(x)的值最小. 本文以下内容假设读者已经了解机器学习基本知识,和梯度下降的原理. SGD SGD指stochast ...