Note of Jieba

Note of Jieba

jieba库是python 一个重要的第三方中文分词函数库,但需要用户自行安装。

一、jieba 库简介

(1) jieba 库的分词原理是利用一个中文词库,将待分词的内容与分词词库进行比对,通过图结构和动态规划方法找到最大概率的词组;除此之外,jieba 库还提供了增加自定义中文单词的功能。

(2) jieba 库支持3种分词模式:

精确模式:将句子最精确地切开,适合文本分析。

全模式:将句子中所以可以成词的词语都扫描出来,速度非常快,但是不能消除歧义。

搜索引擎模式:在精确模式的基础上,对长分词再次切分,提高召回率,适合搜索引擎分词。

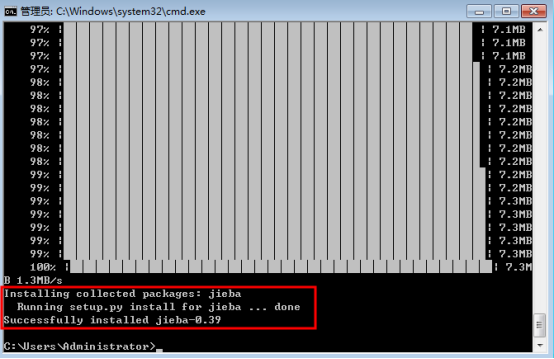

二、安装库函数

(1) 在命令行下输入指令:

pip install jieba

(2) 安装进程:

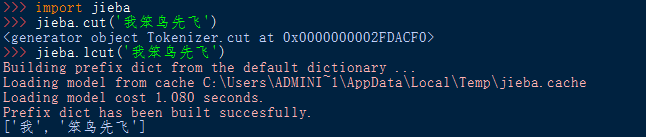

三、调用库函数

(1) 导入库函数:import <库名>

使用库中函数:<库名> . <函数名> (<函数参数>)

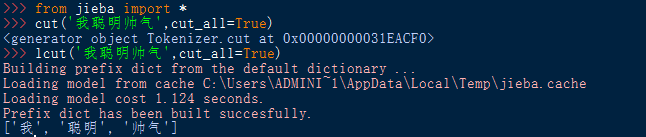

(2) 导入库函数:from <库名> import * ( *为通配符 )

使用库中函数:<函数名> (<函数参数>)

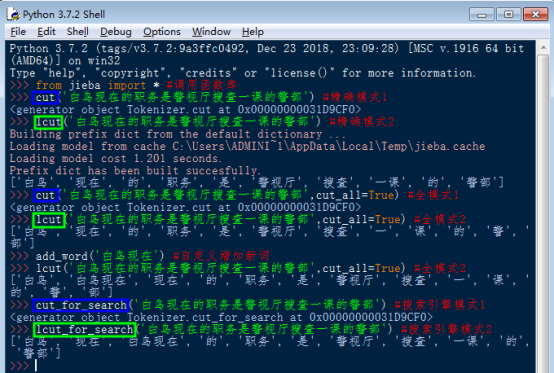

四、jieba 库函数

(1) 库函数功能

|

模式 |

函数 |

说明 |

|

精确模式 |

cut(s) |

返回一个可迭代数据类型 |

|

lcut(s) |

返回一个列表类型 (建议使用) |

|

|

全模式 |

cut(s,cut_all=True) |

输出s中所以可能的分词 |

|

lcut(s,cut_all=True) |

返回一个列表类型 (建议使用) |

|

|

搜索引擎模式 |

cut_for_search(s) |

适合搜索引擎建立索引的分词结果 |

|

lcut_for_search(s) |

返回一个列表类型 (建议使用) |

|

|

自定义新词 |

add_word(w) |

向分词词典中增加新词w |

(2) 函数使用实例

五、对一篇文档进行词频统计

(1) jieba 库单枪匹马

A. 代码实现

注:代码使用的文档 >>> Detective_Novel(utf-8).zip[点击下载],也可自行找 utf-8 编码格式的txt文件。

1 # -*- coding:utf-8 -*-

2 from jieba import *

3

4 def Replace(text,old,new): #替换列表的字符串

5 for char in old:

6 text = text.replace(char,new)

7 return text

8

9 def getText(filename): #读取文件内容(utf-8 编码格式)

10 #特殊符号和部分无意义的词

11 sign = '''!~·@¥……*“”‘’\n(){}【】;:"'「,」。-、?'''

12 txt = open('{}.txt'.format(filename),encoding='utf-8').read()

13 return Replace(txt,sign," ")

14

15 def word_count(passage,N): #计算passage文件中的词频数,并将前N个输出

16 words = lcut(passage) #精确模式分词形式

17 counts = {} #创建计数器 --- 字典类型

18 for word in words: #消除同意义的词和遍历计数

19 if word == '小五' or word == '小五郎' or word == '五郎':

20 rword = '毛利'

21 elif word == '柯' or word == '南':

22 rword = '柯南'

23 elif word == '小' or word == '兰':

24 rword = '小兰'

25 elif word == '目' or word == '暮' or word == '警官':

26 rword = '暮目'

27 else:

28 rword = word

29 counts[rword] = counts.get(rword,0) + 1

30 excludes = lcut_for_search("你我事他和她在这也有什么的是就吧啊吗哦呢都了一个")

31 for word in excludes: #除去意义不大的词语

32 del(counts[word])

33 items = list(counts.items()) #转换成列表形式

34 items.sort(key = lambda x : x[1], reverse = True ) #按次数排序

35 for i in range(N): #依次输出

36 word,count = items[i]

37 print("{:<7}{:>6}".format(word,count))

38

39 if __name__ == '__main__':

40 passage = getText('Detective_Novel') #输入文件名称读入文件内容

41 word_count(passage,20) #调用函数得到词频数

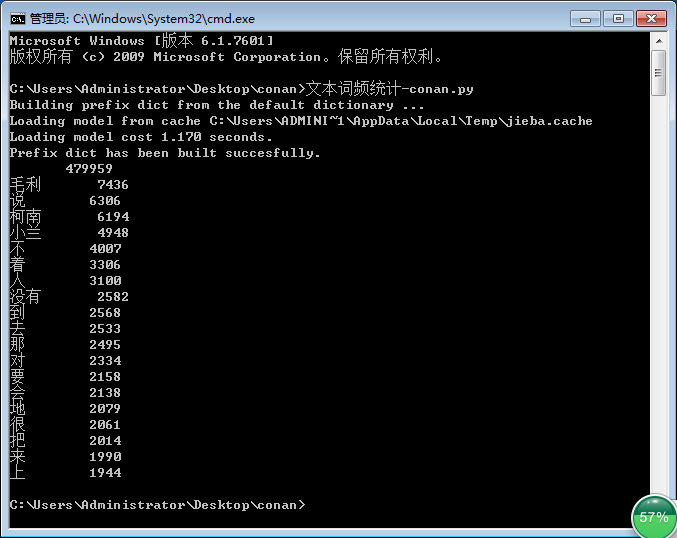

B. 执行结果

(2) jieba 库 和 wordcloud 库 强强联合 --- 词云图

A. 代码实现

1 # -*- coding:utf-8 -*-

2 from wordcloud import WordCloud

3 import matplotlib.pyplot as plt

4 import numpy as np

5 from PIL import Image

6 from jieba import *

7

8 def Replace(text,old,new): #替换列表的字符串

9 for char in old:

10 text = text.replace(char,new)

11 return text

12

13 def getText(filename): #读取文件内容(utf-8 编码格式)

14 #特殊符号和部分无意义的词

15 sign = '''!~·@¥……*“”‘’\n(){}【】;:"'「,」。-、?'''

16 txt = open('{}.txt'.format(filename),encoding='utf-8').read()

17 return Replace(txt,sign," ")

18

19 def creat_word_cloud(filename): #将filename 文件的词语按出现次数输出为词云图

20 text = getText(filename) #读取文件

21 wordlist = lcut(text) #jieba库精确模式分词

22 wl = ' '.join(wordlist) #生成新的字符串

23

24 #设置词云图

25 font = r'C:\Windows\Fonts\simfang.ttf' #设置字体路径

26 wc = WordCloud(

27 background_color = 'black', #背景颜色

28 max_words = 2000, #设置最大显示的词云数

29 font_path = font, #设置字体形式(在本机系统中)

30 height = 1200, #图片高度

31 width = 1600, #图片宽度

32 max_font_size = 100, #字体最大值

33 random_state = 100, #配色方案的种类

34 )

35 myword = wc.generate(wl) #生成词云

36 #展示词云图

37 plt.imshow(myword)

38 plt.axis('off')

39 plt.show()

40 #以原本的filename命名保存词云图

41 wc.to_file('{}.png'.format(filename))

42

43 if __name__ == '__main__':

44 creat_word_cloud('Detective_Novel') #输入文件名生成词云图

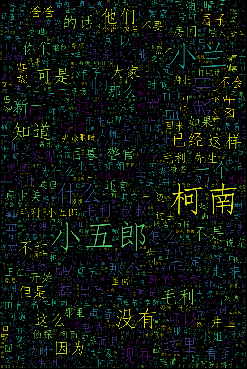

B. 执行结果

Note of Jieba的更多相关文章

- Note of Jieba ( 词云图实例 )

Note of Jieba jieba库是python 一个重要的第三方中文分词函数库,但需要用户自行安装. 一.jieba 库简介 (1) jieba 库的分词原理是利用一个中文词库,将待分词的内容 ...

- jieba库

Note of Jieba ( 词云图实例 ) Note of Jieba jieba库是python 一个重要的第三方中文分词函数库,但需要用户自行安装. 一.jieba 库简介 (1) jieba ...

- python环境jieba分词的安装

我的python环境是Anaconda3安装的,由于项目需要用到分词,使用jieba分词库,在此总结一下安装方法. 安装说明======= 代码对 Python 2/3 均兼容 * 全自动安装:`ea ...

- jieba完整文档

jieba “结巴”中文分词:做最好的 Python 中文分词组件 "Jieba" (Chinese for "to stutter") Chinese tex ...

- jieba分词原理解析:用户词典如何优先于系统词典

目标 查看jieba分词组件源码,分析源码各个模块的功能,找到分词模块,实现能自定义分词字典,且优先级大于系统自带的字典等级,以医疗词语邻域词语为例. jieba分词地址:github地址:https ...

- 三星Note 7停产,原来是吃了流程的亏

三星Note 7发售两个月即成为全球噩梦,从首炸到传言停产仅仅47天.所谓"屋漏偏逢连天雨",相比华为.小米等品牌对其全球市场的挤压.侵蚀,Galaxy Note 7爆炸事件这场连 ...

- 《Note --- Unreal --- MemPro (CONTINUE... ...)》

Mem pro 是一个主要集成内存泄露检测的工具,其具有自身的源码和GUI,在GUI中利用"Launch" button进行加载自己待检测的application,目前支持的平台为 ...

- 《Note --- Unreal 4 --- Sample analyze --- StrategyGame(continue...)》

---------------------------------------------------------------------------------------------------- ...

- 中文分词工具探析(二):Jieba

1. 前言 Jieba是由fxsjy大神开源的一款中文分词工具,一款属于工业界的分词工具--模型易用简单.代码清晰可读,推荐有志学习NLP或Python的读一下源码.与采用分词模型Bigram + H ...

随机推荐

- contenOs7

echo 'export PATH="/home/conda/ls/bin:$PATH"'>>~/.bashrc source ~/.bashrc python

- ieda 快捷键修改方法

框中意思为: 1.增加快捷键 2.增加缩写

- [English] Time complexity wise this solution is the best among all

Time complexity wise this solution is the best among all, we can do all operations in O(1) time. 时间复 ...

- Nginx 常用配置

Nginx的负载均衡方式 1.轮询(默认) 每个请求按时间顺序逐一分配到不同的后端服务器,如果后端服务器down掉,能自动剔除. 2.weight 指定轮询几率,weight和访问比率成正比,用于后端 ...

- git同时存在两个账号(在同一台电脑上)——三步完成

目录 1.首先是常规设置 2.同时添加两个账号 3.最后一步,配置~/.ssh/config文件 4.补充:有时因为设置了全局账号,因此需要清除 由于本人有连个git账号,个人github账号和公司g ...

- 《BUG创造队》第一次作业:团队亮相

项目 内容 这个作业属于哪个课程 2016级软件工程 这个作业的要求在哪里 第五次实验 团队名称 BUG创造队 作业学习目标 通过本次项目了解并熟悉团队开发的过程 关于我们 -我们的队名:BUG创造队 ...

- Mac OS X 操作系统下IntelliJ IDEA激活码(Activation code)破解

Mac OS X 操作系统(版本:10.13.6)下载并安装IntelliJ IDEA: Version: 2018.2.4 Download IntelliJ IDEA 下一步对IntelliJ I ...

- hdu第4场j.Let Sudoku Rotate

Problem J. Let Sudoku Rotate Time Limit: / MS (Java/Others) Memory Limit: / K (Java/Others) Total Su ...

- springMVC的配置与使用

springMVC的配置与使用 spring mvc 核心类与接口 先来了解一下,几个重要的接口与类.现在不知道他们是干什么的没关系,先混个脸熟,为以后认识他们打个基础. DispatcherServ ...

- .net core 2.0 webapi部署iis操作

1.安装 .net core 2.0 runtime, (dotnet-runtime-2.0.7-win-x64.exe) https://www.microsoft.com/net/downloa ...