ELK安装配置及nginx日志分析

一、ELK简介

1、组成

ELK是Elasticsearch、Logstash、Kibana三个开源软件的组合。在实时数据检索和分析场合,三者通常是配合使用,而且又都先后归于 Elastic.co 公司名下,故有此简称。

Elasticsearch是个开源分布式搜索引擎,它的特点有:分布式,零配置,自动发现,索引自动分片,索引副本机制,restful风格接口,多数据源,自动搜索负载等。

Logstash是一个完全开源的工具,它可以对你的日志进行收集、分析,并将其存储供以后使用。

kibana 是一个开源和免费的工具,它可以为 Logstash 和 ElasticSearch 提供的日志分析友好的 Web 界面,可以帮助您汇总、分析和搜索重要数据日志。

2、工作流程

在需要收集日志的所有服务上部署logstash,作为logstash agent(logstash shipper)用于监控并过滤收集日志,将过滤后的内容发送到Redis,然后logstash indexer将日志收集在一起交给全文搜索服务ElasticSearch,可以用ElasticSearch进行自定义搜索通过Kibana 来结合自定义搜索进行页面展示。

二、ELK安装及配置

1、系统及软件版本介绍:

系统:CentOS6.5_64

elasticsearch:elasticsearch-2.3.5.tar.gz

logstash:logstash-2.3.4.tar.gz

kibana:kibana-4.5.4-linux-x64.tar.gz

redis:redis-2.8.17.tar.gz

JDK:jdk-8u73-linux-x64.tar.gz

2、服务器规划

在两台服务器安装ELK组件

A(需要分析的nginx日志服务器):安装logstash(logstash agent)

B(ELK服务端):安装elasticsearch、logstash(logstash index)、kibana、redis

软件包安装目录:/data/elk

3、创建用户

# groupadd app

# useradd -g app -d /data/elk elk

4、安装及配置JDK

logstash及elasticsearch需要JDK支持

# su - elk

$ tar zxf jdk-8u73-linux-x64.tar.gz

$ vim .bash_profile (添加及修改如下内容) JAVA_HOME=/data/elk/jdk1..0_73

PATH=${JAVA_HOME}/bin:$PATH:$HOME/bin export PATH JAVA_HOME $ . .bash_profile

执行java -version命令查看到如下内容表示JDK配置OK。

java version "1.8.0_73"

Java(TM) SE Runtime Environment (build 1.8.0_73-b02)

Java HotSpot(TM) -Bit Server VM (build 25.73-b02, mixed mode)

注:以上3-4步在A、B服务器都需要进行操作。

5、A服务器安装及配置logstash(logstash agent)

$ tar zxf logstash-2.3..tar.gz

$ mv logstash-2.3. logstash

$ mkdir logstash/conf

$ vim logstash/conf/logstash_agent.conf #手动创建logstash配置文件,添加如下内容

input {

file {

type => "nginx access log"

path => ["/app/nginx/logs/access.log"] #nginx日志路径

}

}

output {

redis {

host => "123.56.xx.xx" #redis server IP

port => "" #redis server port

data_type => "list" #redis作为队列服务器,key的类型为list

key => "logstash:redis" #key的名称,可以自定义

}

}

语法检查:

$ ./logstash -t -f ../conf/logstash_agent.conf

Configuration OK

启动logstash(最好是在B服务器安装好redis后再进行启动):

$ cd logstash/bin

$ nohup ./logstash -f ../conf/logstash_agent.conf &

$ tail -f nohup.out #查看日志,输出以下内容,表示logstash正常启动

{:timestamp=>"2016-12-05T11:06:35.407000+0800", :message=>"Pipeline main started"}

注:以下安装及配置内容全部在B服务器上进行

6、安装及配置redis

这个比较简单(过程略,端口使用6079)

启动redis

/data/elk/redis/bin/redis-server /data/elk/redis/conf/redis.conf

7、安装及配置elasticsearch

$ tar zxf elasticsearch-2.3..tar.gz

$ mv elasticsearch-2.3. elasticsearch

$ mkdir elasticsearch/{logs,data} #创建日志及数据存放目录

$ vim elasticsearch/config/elasticsearch.yml #修改如下内容

cluster.name: server

node.name: node-

path.data: /data/elk/elasticsearch/data

path.logs: /data/elk/elasticsearch/logs

network.host: 123.56.xx.xx

http.port:

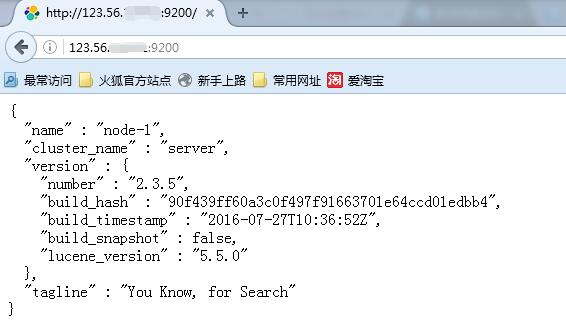

启动elasticsearch

$ cd elasticsearch/

$ nohup ./bin/elasticsearch &

通过浏览器访问:

http://123.56.xx.xx:9200/

安装elasticsearch-head插件:

$ cd elasticsearch/bin/

$ ./plugin install mobz/elasticsearch-head

访问http://123.56.xx.xx:9200/_plugin/head/,可以查看集群状态,集群的内容,执行搜索和普通的rest请求等:

8、安装及配置logstash(logstash index)

$ tar zxf logstash-2.3..tar.gz

$ mv logstash-2.3. logstash

$ mkdir logstash/conf

$ vim logstash/conf/logstash_indexer.conf #手动创建logstash配置文件,添加如下内容

input {

redis {

host => "123.56.xx.xx"

port => ""

data_type => "list"

key => "logstash:redis"

type => "redis-input"

}

}

filter {

grok {

match => { "message" => "%{NGINXACCESS}" }

}

geoip {

source => "clientip"

add_tag => [ "geoip" ]

database => "/data/elk/logstash/GeoLiteCity.dat"

add_field => [ "[geoip][coordinates]", "%{[geoip][longitude]}" ]

add_field => [ "[geoip][coordinates]", "%{[geoip][latitude]}" ]

}

mutate {

convert => [ "[geoip][coordinates]", "float"]

}

date {

match => [ "timestamp","dd/MMM/yyyy:HH:mm:ss Z" ]

remove_field => [ "timestamp" ]

}

useragent {

source => "http_user_agent"

target => "browser"

}

} output {

elasticsearch {

hosts => ["123.56.xx.xx:9200"]

}

stdout {codec => rubydebug}

}

配置Logstash以使用GeoIP,下载最新的GeoLite城市数据库

$ cd /data/elk/logstash

$ curl -O "http://geolite.maxmind.com/download/geoip/database/GeoLiteCity.dat.gz"

$ gzip -d GeoLiteCity.dat.gz

添加geo_point映射

curl -O https://gist.githubusercontent.com/thisismitch/3429023e8438cc25b86c/raw/d8c479e2a1adcea8b1fe86570e42abab0f10f364/filebeat-index-template.json

curl -XPUT 'http://123.56.xx.xx:9200/_template/filebeat?pretty' -d@filebeat-index-template.json

定义nginx日志匹配规则

$ mkdir logstash/patterns

$ vim nginx #添加内容如下:

NGUSERNAME [a-zA-Z\.\@\-\+_%]+

NGUSER %{NGUSERNAME}

NGINXACCESS %{IPORHOST:clientip} - %{NOTSPACE:remote_user} \[%{HTTPDATE:timestamp}\] \"(?:%{WORD:verb} %{NOTSPACE:request}(?: HTTP/%{NUMBER:httpversion})?|%{DATA:rawrequest})\" %{NUMBER:response} (?:%{NUMBER:bytes}|-) %{QS:referrer} %{QS:agent} %{NOTSPACE:http_x_forwarded_for}

检查配置并启动logstash

$ ./logstash -t -f ../conf/logstash_indexer.conf

Configuration OK

nohup ./logstash -f ../conf/logstash_indexer.conf &

9、安装及配置kibana

$ tar zxf kibana-4.5.-linux-x64.tar.gz

$ mv kibana-4.5. kibana

$ vi kibana/config/kibana.yml #修改内容如下

elasticsearch.url: "http://123.56.xx.xx:9200"

启动kibana

$ cd kibana/bin

$ nohup ./kibana &

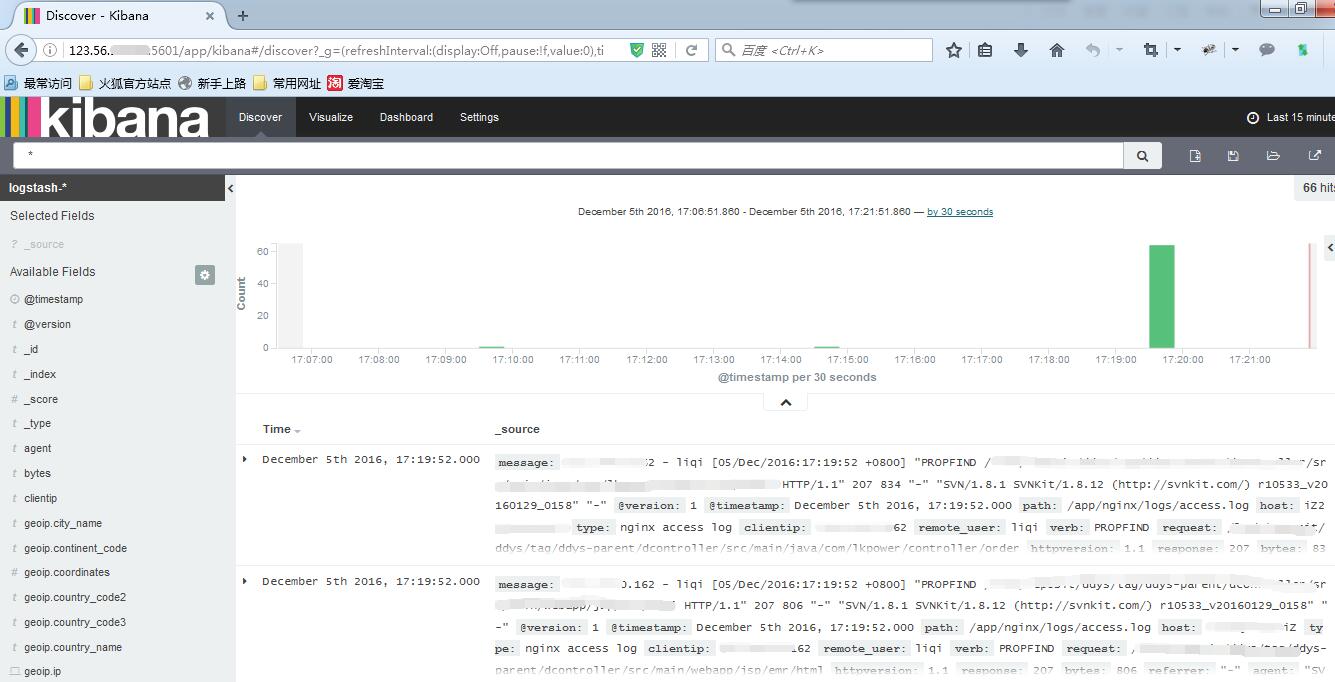

访问kibana

浏览器打开http://123.56.xx.xx:5601/

创建索引

使用默认的logstash-*的索引名称,并且是基于时间的,点击“Create”即可。

ELK安装配置及nginx日志分析的更多相关文章

- ELK+redis搭建nginx日志分析平台

ELK+redis搭建nginx日志分析平台发表于 2015-08-19 | 分类于 Linux/Unix | ELK简介ELKStack即Elasticsearch + Logstas ...

- 使用elk+redis搭建nginx日志分析平台

elk+redis 搭建nginx日志分析平台 logstash,elasticsearch,kibana 怎么进行nginx的日志分析呢?首先,架构方面,nginx是有日志文件的,它的每个请求的状态 ...

- 使用elk+redis搭建nginx日志分析平台(引)

http://www.cnblogs.com/yjf512/p/4199105.html elk+redis 搭建nginx日志分析平台 logstash,elasticsearch,kibana 怎 ...

- elk安装配置

ELK介绍 官网https://www.elastic.co/cn/ 中文指南https://www.gitbook.com/book/chenryn/elk-stack-guide-cn/det ...

- nginx日志分析利器GoAccess

面试的时候一定会被面到的问题是:给出web服务器的访问日志,请写一个脚本来统计访问前10的IP有哪些?访问前10的请求有哪些?当你领略过goaccess之后,你就明白,这些问题,除了考验你的脚本背诵记 ...

- nginx日志分析利器GoAccess(转)

面试的时候一定会被面到的问题是:给出web服务器的访问日志,请写一个脚本来统计访问前10的IP有哪些?访问前10的请求有哪些?当你领略过goaccess之后,你就明白,这些问题,除了考验你的脚本背诵记 ...

- nginx高性能WEB服务器系列之八--nginx日志分析与切割

nginx系列友情链接:nginx高性能WEB服务器系列之一简介及安装https://www.cnblogs.com/maxtgood/p/9597596.htmlnginx高性能WEB服务器系列之二 ...

- Nginx 日志分析及性能排查

Nginx 日志分析及性能排查 2017-03-04 Linux爱好者 (点击上方公众号,可快速关注) 作者:-外星人- my.oschina.net/362228416/blog/844713 如有 ...

- Nginx日志分析及脚本编写

在我们日常的运维中,当Nginx服务器正常运行后,我们会经常密切关注Nginx访问日志的相关情况,发现有异常的日志信息需要进行及时处理. 那今天我将跟大家一起来研究和分析Nginx日志,nginx默认 ...

随机推荐

- Object-C类目(Category)

类目是Object-C中最有用的一个特性.实质上,类目允许你为一个已存在的类添加一些方法而不用子类化该类,也不需要你了解该类的实现细节. 这是特别有用的,因为你可以给一个内建的对象添加方法.当你想在你 ...

- C语言之指针1.1数组

void main() { ]={,,,,,}; ;i++) { printf("%d\n",*(arr+i)); } } 输出结果时候123456

- JavaScript 学习笔记-- ES6学习(一)介绍以及Babel的使用

本文摘自阮一峰老师的<ECMAScript 6入门>,原文地址:http://es6.ruanyifeng.com/#docs/intro ECMAScript 6 是一个泛指,含义是5. ...

- 《JavaScript高级程序设计》笔记(1):<script>元素

使用<script>元素内部的JavaScript代码将从上至下依此解释.在使用<script>嵌入的JavasCript代码时,代码任何地方不能出现"</sc ...

- Linux之C编译器gcc和makefile使用简介

使用gcc编译程序是,其过程主要分为四个阶段:预处理,编译,汇编,连接 程序清单: #include<stdio.h> #include<stdlib.h> int main( ...

- [DevExpress]DxValidationProvider分享

前些日子从研究所临时调回公司,帮忙做另外一个项目的控件验证工作,其实内容非常的简单,就是将用户即将提交至服务器的数据先做一个本地验证,以达到减少服务器压力.提高用户体验的目的. 附上一张图片 这是官方 ...

- ruby环境sass编译中文出现Syntax error: Invalid GBK character错误解决方法

sass文件编译时候使用ruby环境,无论是界面化的koala工具还是命令行模式的都无法通过,真是令人烦恼. 容易出现中文注释时候无法编译通过,或者出现乱码,找了几天的解决方法终于解决了. 这个问题的 ...

- Android 自定义View实现单击和双击事件

自定义View, 1. 自定义一个Runnable线程TouchEventCountThread , 用来统计500ms内的点击次数 2. 在MyView中的 onTouchEvent 中调用 上面 ...

- django之JavaScript的简单学习2

前言:ajax预备知识:json进阶 1.JSON(JavaScript Object Notation) 是一种轻量级的数据交换格式.JSON是用字符串来表示Javascript对象: 请大家记住一 ...

- CentOS下Redis 2.2.14安装配置详解(转载)

一. 下载redis最新版本2.2.14 cd /usr/local/src wget –c http://redis.googlecode.com/files/redis-2.2.14.tar.gz ...