Spark Shuffle(一)ShuffleWrite:Executor如何将Shuffle的结果进行归并写到数据文件中去(转载)

转载自:https://blog.csdn.net/raintungli/article/details/70807376

当Executor进行reduce运算的时候,生成运算结果的临时Shuffle数据,并保存在磁盘中,被最后的Action算子调用,而这个阶段就是在ShuffleMapTask里执行的。

前面博客中也提到了,用什么ShuffleWrite是由ShuffleHandler来决定的,在这篇博客里主要介绍最常见的SortShuffleWrite的核心算法ExternalSorter.

2. 结构AppendOnlyMap

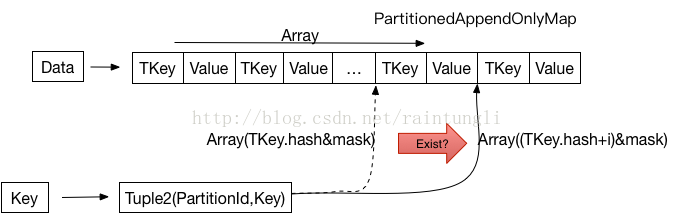

在前面博客中介绍了SortShuffleWriter调用ExternalSorter.insertAll进行数据插入和数据合并的,ExternalSorted里使用了PartitionedAppendOnlyMap作为数据的存储方式

先来看PartitionedAppendOnlyMap的结构

虽然名字为Map,但是在这里和常见的Map的结构并不太一样,里面并没有使用链表结果保存相同的hash值的key,当插入的key的hashcode相同的时但key不相同,会通过i的叠加一直找到数组里空闲的位置。

这里有几个注意点:

- Key 注意这里的Key并不是通过Map里拆分的Key, 而是Tuple2(PartitionId,Key),由分片的段和key组合的联合key

- 如何计算PartitionId? 这是由Partitioner来决定的

2.1 Partitioner

Partitioner的方法

abstract class Partitioner extends Serializable {

def numPartitions: Int

def getPartition(key: Any): Int

}

通过调用getPartition方法找到对应的partition相应的块,而常用的是HashPartitioner

def getPartition(key: Any): Int = key match {

case null =>

case _ => Utils.nonNegativeMod(key.hashCode, numPartitions)

}

计算 key的hashCode,进行总的分片数求余,分配到对应的片区

3. Spill

在大数据的情况下进行归并,由于合并的数据量非常大,仅仅使用AppendOnlyMap进行数据的归并内存显然是不足够的,在这种情况下需要将内存里的已经归并的数据刷到磁盘上避免OOM的风险。

控制Spill到磁盘的阀值

- 内存:虽然Java的堆内存管理是由JVM虚拟机管控,但是Spark自己实现了一个简单的但不精准的内存管理,内存的申请在TaskMemoryManager里进行管理

if (elementsRead % == && currentMemory >= myMemoryThreshold) {

// Claim up to double our current memory from the shuffle memory pool

val amountToRequest = * currentMemory - myMemoryThreshold

val granted = acquireMemory(amountToRequest)

myMemoryThreshold += granted

// If we were granted too little memory to grow further (either tryToAcquire returned 0,

// or we already had more memory than myMemoryThreshold), spill the current collection

shouldSpill = currentMemory >= myMemoryThreshold

}

在每添加32个元素的时候,检查一下当前的内存状况,currentMemory是Map当前大概使用的内存,myMemoryThreshold是可以使用的内存址,初始的时候受参数控制:

spark.shuffle.spill.initialMemoryThreshold

- 数据的数量:有的时候每条数据量比较小,但是数据的数量非常大,为了避免在AppendOnlyMap里有大量的数据,在Spill的时候同时还可以使用数量的控制:

spark.shuffle.spill.numElementsForceSpillThreshold

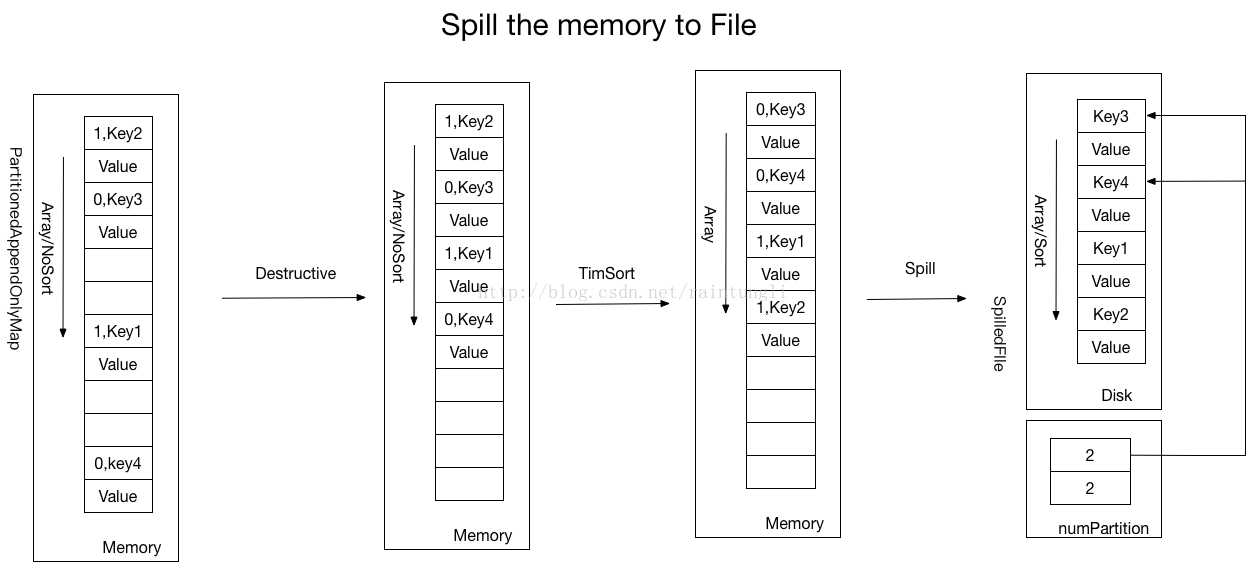

3.1 如何Spill?

- 整理数组,将数组里的不存在KV的空间移除

- 按照区块排序,对同一区块里的Key使用TimeSort进行排序,TimeSort不在此处讨论

- Spill到文件的时候,只是保存了序列化了Key,Value并没有保存Key的区块信息,但在SpilledFile的对象中有记录每个partitionkey的数量的数组

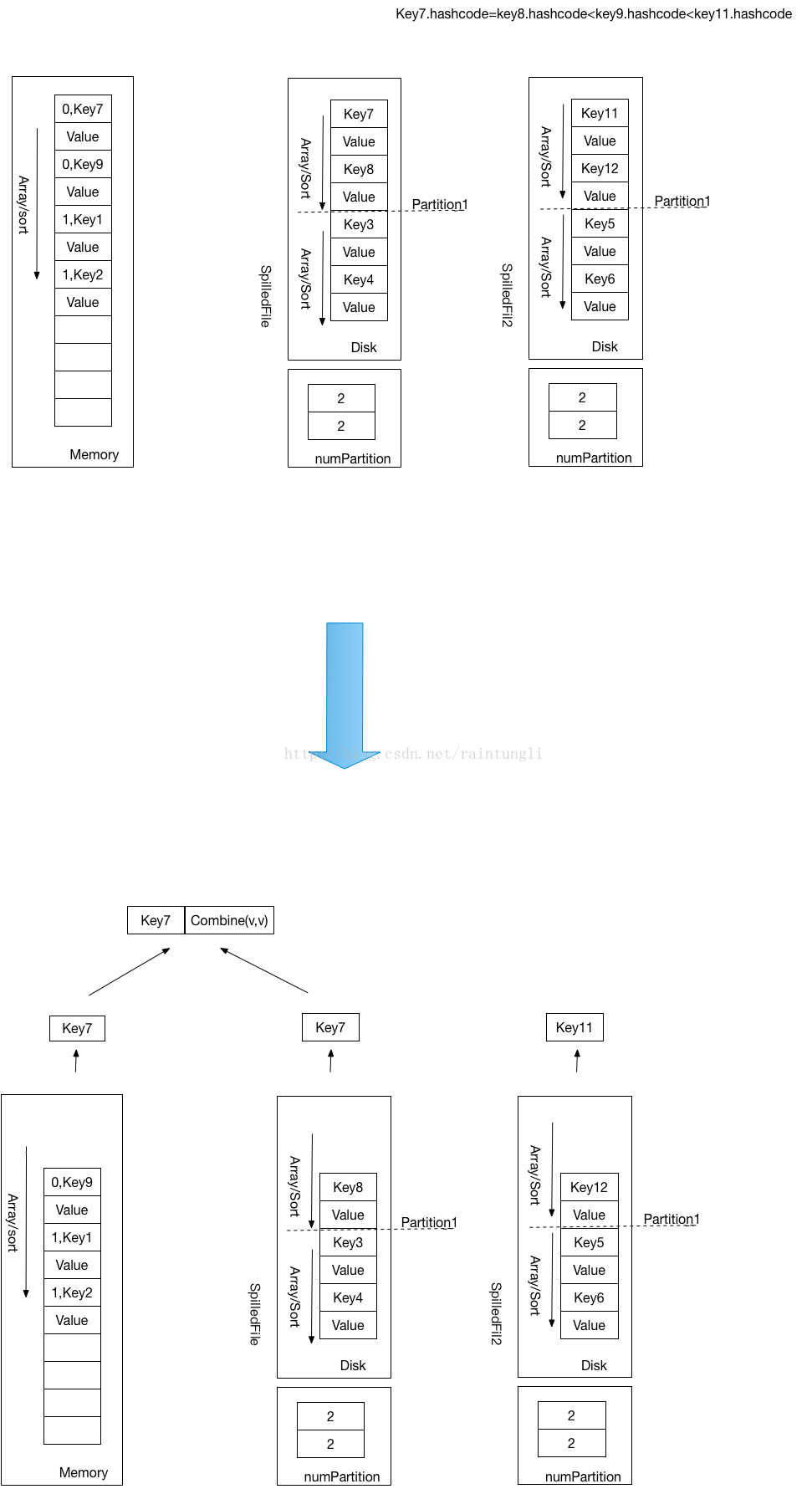

4. 生成ShuffleWrite的数据文件

- 首先对AppendOnlyMap进行归并,排序

- 开始对同一区块的进行归并

- 将AppendOnlyMap,SpilledFile的文件进行优先级的Queue的迭代,每次迭代出所有Queue中一个最小的Key,最小的Key就是HashCode最小

private def mergeSort(iterators: Seq[Iterator[Product2[K, C]]], comparator: Comparator[K])

: Iterator[Product2[K, C]] =

{

val bufferedIters = iterators.filter(_.hasNext).map(_.buffered)

type Iter = BufferedIterator[Product2[K, C]]

val heap = new mutable.PriorityQueue[Iter]()(new Ordering[Iter] {

// Use the reverse of comparator.compare because PriorityQueue dequeues the max

override def compare(x: Iter, y: Iter): Int = -comparator.compare(x.head._1, y.head._1)

})

heap.enqueue(bufferedIters: _*) // Will contain only the iterators with hasNext = true

new Iterator[Product2[K, C]] {

override def hasNext: Boolean = !heap.isEmpty override def next(): Product2[K, C] = {

if (!hasNext) {

throw new NoSuchElementException

}

val firstBuf = heap.dequeue()

val firstPair = firstBuf.next()

if (firstBuf.hasNext) {

heap.enqueue(firstBuf)

}

firstPair

}

}

}

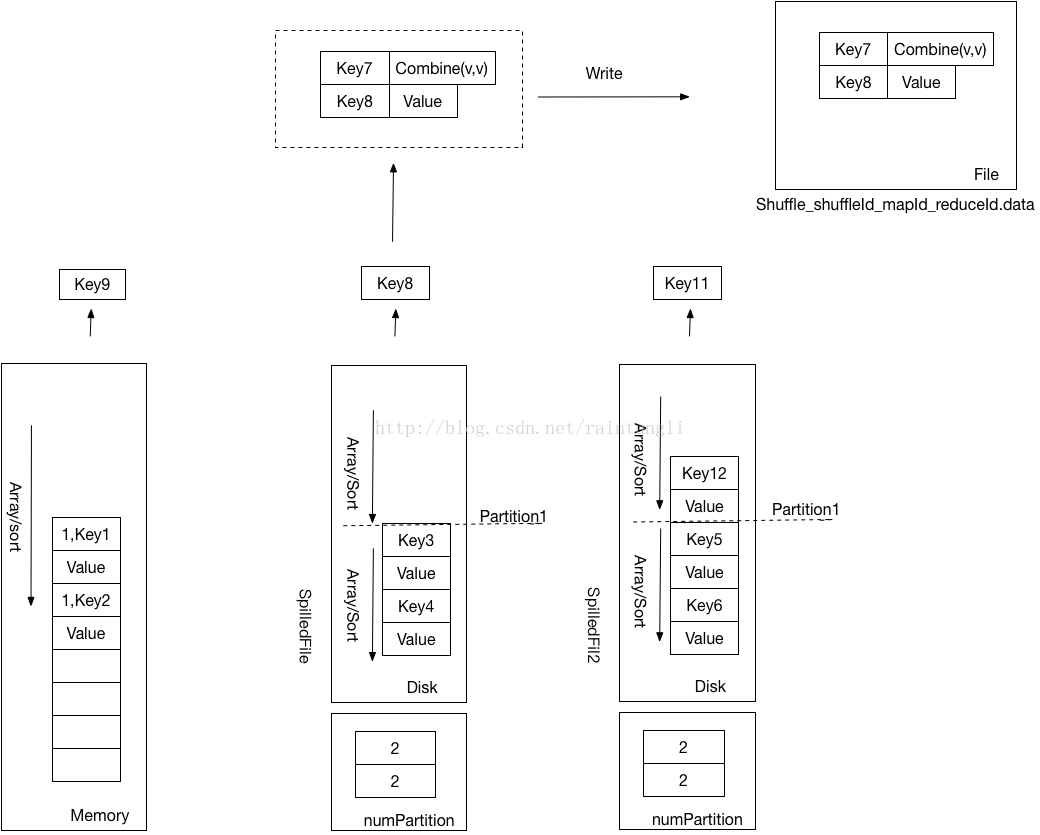

- 当找到一个最小的Key的时候,并不能保存到ShuffleWrite文件中,因为有可能存在相同的最小的key,所以还需要在迭代找到下一个最小的Key,如果key的hashcode相同的时候,要进行相同的Key进行合并(因为Key的排序是依赖于HashCode的大小,所以相同的最小的Key代表的是HashCode相同的Key),如果不同则保存成相同HashCode的数组,进行下一次的优先queue的查找,直到找到的Key的hashcode大于最小的Key结束

if (!hasNext) {

throw new NoSuchElementException

}

keys.clear()

combiners.clear()

val firstPair = sorted.next()

keys += firstPair._1

combiners += firstPair._2

val key = firstPair._1

while (sorted.hasNext && comparator.compare(sorted.head._1, key) == ) {

val pair = sorted.next()

var i =

var foundKey = false

while (i < keys.size && !foundKey) {

if (keys(i) == pair._1) {

combiners(i) = mergeCombiners(combiners(i), pair._2)

foundKey = true

}

i +=

}

if (!foundKey) {

keys += pair._1

combiners += pair._2

}

}

- 将k,v内容写到shufflewrite的文件Shuffle_shuffleId_mapId_reduceId.data中去

- 重复前面的行为直到所有的key被迭代结束

- 前面的归并是以区块(Partition)为单位的,而data的文件里并没有保存区块的相关信息,但在每迭代完一个Partition的时候(SpilledFile文件里面也没有Partition的信息,但是是通过SpilledFile结构中的numPartition的数量来判断Partition的数据是否已经读完),会生成一个Segement,Segement 里记录了这个块保存在data文件里的长度

- 最后生成Shuffle_shuffleId_mapId_reduceId.index文件,文件里记录了每个Partition在data文件中的位移

这样一个完整的Shuffle结果写入data的逻辑执行完了

5 总结

- 使用AppendOnlyMap数据结构进行输入数据的合并计算

- 输入的数据是进行分区合并计算,分区的方式是由Partitioner决定的

- 当内存不够的时候,会进行相同区块下的数据整理排序,Spill到临时文件temp_shuffle_UUID

- 最后对所有的数据集合(AppendOnlyMap里的数据和多个Spill的临时文件)进行区块的数据合并

- 生成Shuffle_shuffleId_mapId_reduceId.data 分区的数据文件,Shuffle_shuffleId_mapId_reduceId.index记录分区的位置

Spark Shuffle(一)ShuffleWrite:Executor如何将Shuffle的结果进行归并写到数据文件中去(转载)的更多相关文章

- Spark Shuffle(三)Executor是如何fetch shuffle的数据文件(转载)

1. 前言 在前面的博客中讨论了Executor, Driver之间如何汇报Executor生成的Shuffle的数据文件,以及Executor获取到Shuffle的数据文件的分布,那么Executo ...

- Spark源码系列(六)Shuffle的过程解析

Spark大会上,所有的演讲嘉宾都认为shuffle是最影响性能的地方,但是又无可奈何.之前去百度面试hadoop的时候,也被问到了这个问题,直接回答了不知道. 这篇文章主要是沿着下面几个问题来开展: ...

- Spark 源码系列(六)Shuffle 的过程解析

Spark 大会上,所有的演讲嘉宾都认为 shuffle 是最影响性能的地方,但是又无可奈何.之前去百度面试 hadoop 的时候,也被问到了这个问题,直接回答了不知道. 这篇文章主要是沿着下面几个问 ...

- Apache Spark源码走读之24 -- Sort-based Shuffle的设计与实现

欢迎转载,转载请注明出处. 概要 Spark 1.1中对spark core的一个重大改进就是引入了sort-based shuffle处理机制,本文就该处理机制的实现进行初步的分析. Sort-ba ...

- Spark原始码系列(六)Shuffle的过程解析

问题导读: 1.shuffle过程的划分? 2.shuffle的中间结果如何存储? 3.shuffle的数据如何拉取过来? Shuffle过程的划分 Spark的操作模型是基于RDD的,当调用RD ...

- spark动态资源(executor)分配

spark动态资源调整其实也就是说的executor数目支持动态增减,动态增减是根据spark应用的实际负载情况来决定. 开启动态资源调整需要(on yarn情况下) 1.将spark.dynamic ...

- spark异常篇-Removing executor 5 with no recent heartbeats: 120504 ms exceeds timeout 120000 ms 可能的解决方案

问题描述与分析 题目中的问题大致可以描述为: 由于某个 Executor 没有按时向 Driver 发送心跳,而被 Driver 判断该 Executor 已挂掉,此时 Driver 要把 该 Exe ...

- spark SQL读取ORC文件从Driver启动到开始执行Task(或stage)间隔时间太长(计算Partition时间太长)且产出orc单个文件中stripe个数太多问题解决方案

1.背景: 控制上游文件个数每天7000个,每个文件大小小于256M,50亿条+,orc格式.查看每个文件的stripe个数,500个左右,查询命令:hdfs fsck viewfs://hadoop ...

- Spark性能调优篇八之shuffle调优

1 task的内存缓冲调节参数 2 reduce端聚合内存占比 spark.shuffle.file.buffer map task的内存缓冲调节参数,默认是3 ...

随机推荐

- 把Excel中的数据转换成Sql语句

假如excel表格中有A.B.C三列数据,希望导入到数据库users表中,相应的字段各自是name,sex,age ,在你的excel表格中添加一列.利用excel的公式自己主动生成sql语句,方法例 ...

- 用rman恢复备库;遇到备库起不来一个案例 ORA-01152:ORA-01110

数据从主库恢复到备库:打开备库发现出现异常 SQL> alter database open; alter database open * ERROR at line 1: ORA-10458: ...

- docker 配置文件:/etc/docker/daemon.json

/etc/docker/daemon.json 是 docker 的配置文件,默认是没有的,需要我们手动创建,可配置项如下: [root@localhost ~]$ vim /etc/docker/d ...

- Runtime 运行时之一:消息转发

解释一 上一篇文章咱们提到了Runtime的消息传递机制,主要围绕三个C语言API来展开进行的.这篇文章我将从另外三个方法来描述Runtime中另一个特性:消息转发机制. 一.消息转发机制 当向某个对 ...

- ExtJS 6.2 基础使用

一. 安装: 下载两个压缩包:分别是 ext-6.2.0-gpl(这个是ExtJS 的SDK文件,创建新项目的时候需要用). SenchaCmd-6.5.2-windows-64bit (这个下载下来 ...

- deferred对象(摘自别人的文章)

对jQuery中的deferred对象的整体认识: Deferred是个工厂类,返回的是内部构建的deferred对象 tuples 创建三个$.Callbacks对象,分别表示成功,失败,处理中三种 ...

- js+jquery

改变元素的不透明度 <!DOCTYPE html> <html> <head> <script> function ChangeOpacity(x) { ...

- 【BZOJ4553】[Tjoi2016&Heoi2016]序列 cdq分治+树状数组

[BZOJ4553][Tjoi2016&Heoi2016]序列 Description 佳媛姐姐过生日的时候,她的小伙伴从某宝上买了一个有趣的玩具送给他.玩具上有一个数列,数列中某些项的值可能 ...

- HTML5+CSS3 表格设计(Table)

<style> body { width: 600px; margin: 40px auto; font-family: 'trebuchet MS', 'Lucida sans', Ar ...

- oracle缩写与术语

术语 定义活动会话池 资源组或子计划允许的当前活动会话数ADDM Automatic Database Diagnostic Monitor(自动数据库诊断监视程序)ASM Automatic Sto ...