机器学习作业(二)逻辑回归——Matlab实现

题目太长啦!文档下载【传送门】

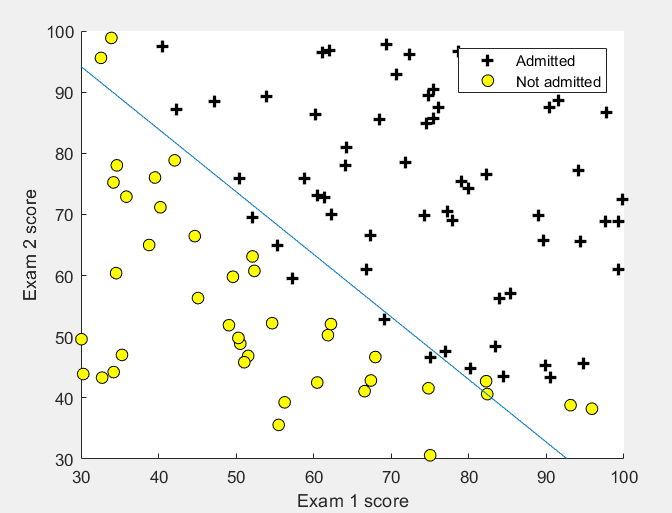

第1题

简述:实现逻辑回归。

第1步:加载数据文件:

data = load('ex2data1.txt');

X = data(:, [1, 2]); y = data(:, 3);

plotData(X, y);

% Put some labels

hold on;

% Labels and Legend

xlabel('Exam 1 score')

ylabel('Exam 2 score')

% Specified in plot order

legend('Admitted', 'Not admitted')

hold off;

第2步:plotData函数实现训练样本的可视化:

function plotData(X, y)

% Create New Figure

figure;

hold on; pos = find(y==1);

neg = find(y==0);

plot(X(pos,1),X(pos,2),'k+','LineWidth',2,'MarkerSize',7);

plot(X(neg,1),X(neg,2),'ko','MarkerFaceColor','y','MarkerSize',7); hold off;

end

第3步:计算代价函数和梯度:

% Setup the data matrix appropriately, and add ones for the intercept term

[m, n] = size(X); % Add intercept term to x and X_test

X = [ones(m, 1) X]; % Initialize fitting parameters

initial_theta = zeros(n + 1, 1); % Compute and display initial cost and gradient

[cost, grad] = costFunction(initial_theta, X, y);

第4步:实现costFunction函数:

function [J, grad] = costFunction(theta, X, y) m = length(y); % number of training examples

J = 0;

grad = zeros(size(theta)); h = sigmoid(X*theta);

J = 1/m*(-y'*log(h)-(1-y')*log(1-h));

grad = 1/m*(X'*(h-y)); end

第5步:实现sigmoid函数:

function g = sigmoid(z)

g = zeros(size(z));

g = 1./(1+exp(-z));

end

第6步:使用fminunc函数求θ和Cost:

% Set options for fminunc

options = optimset('GradObj', 'on', 'MaxIter', 400); % Run fminunc to obtain the optimal theta

% This function will return theta and the cost

[theta, cost] = ...

fminunc(@(t)(costFunction(t, X, y)), initial_theta, options); % Print theta to screen

fprintf('Cost at theta found by fminunc: %f\n', cost);

fprintf('theta: \n');

fprintf(' %f \n', theta); % Plot Boundary

plotDecisionBoundary(theta, X, y); % Put some labels

hold on;

% Labels and Legend

xlabel('Exam 1 score')

ylabel('Exam 2 score') % Specified in plot order

legend('Admitted', 'Not admitted')

hold off;

第7步:实现plotDecisionBoundary函数:

function plotDecisionBoundary(theta, X, y) % Plot Data

plotData(X(:,2:3), y);

hold on if size(X, 2) <= 3

% Only need 2 points to define a line, so choose two endpoints

plot_x = [min(X(:,2))-2, max(X(:,2))+2]; % Calculate the decision boundary line

plot_y = (-1./theta(3)).*(theta(2).*plot_x + theta(1)); % Plot, and adjust axes for better viewing

plot(plot_x, plot_y) % Legend, specific for the exercise

legend('Admitted', 'Not admitted', 'Decision Boundary')

axis([30, 100, 30, 100])

else

% Here is the grid range

u = linspace(-1, 1.5, 50);

v = linspace(-1, 1.5, 50); z = zeros(length(u), length(v));

% Evaluate z = theta*x over the grid

for i = 1:length(u)

for j = 1:length(v)

z(i,j) = mapFeature(u(i), v(j))*theta;

end

end

z = z'; % important to transpose z before calling contour % Plot z = 0

% Notice you need to specify the range [0, 0]

contour(u, v, z, [0, 0], 'LineWidth', 2)

end

hold off end

运行结果:

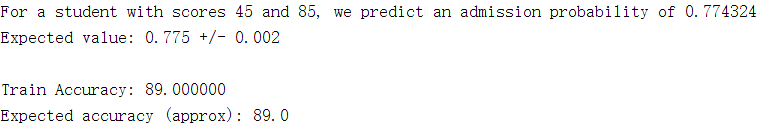

第8步:预测[45 85]成绩的学生,并计算准确率:

prob = sigmoid([1 45 85] * theta);

fprintf(['For a student with scores 45 and 85, we predict an admission ' ...

'probability of %f\n'], prob);

fprintf('Expected value: 0.775 +/- 0.002\n\n'); % Compute accuracy on our training set

p = predict(theta, X); fprintf('Train Accuracy: %f\n', mean(double(p == y)) * 100);

fprintf('Expected accuracy (approx): 89.0\n');

fprintf('\n');

第9步:实现predict预测函数:

function p = predict(theta, X)

m = size(X, 1); % Number of training examples

p = zeros(m, 1);

p = round(sigmoid(X*theta));

end

运行结果:

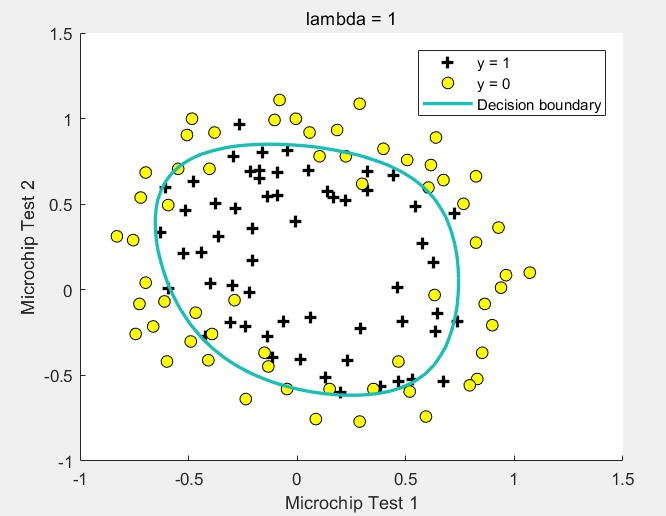

第2题

简述:通过正规化实现逻辑回归。

第1步:加载数据文件:

data = load('ex2data2.txt');

X = data(:, [1, 2]); y = data(:, 3);

plotData(X, y);

% Put some labels

hold on;

% Labels and Legend

xlabel('Microchip Test 1')

ylabel('Microchip Test 2')

% Specified in plot order

legend('y = 1', 'y = 0')

hold off;

第2步:正规化逻辑回归:

% Note that mapFeature also adds a column of ones for us, so the intercept

% term is handled

X = mapFeature(X(:,1), X(:,2)); % Initialize fitting parameters

initial_theta = zeros(size(X, 2), 1); % Set regularization parameter lambda to 1

lambda = 1; % Compute and display initial cost and gradient for regularized logistic

% regression

[cost, grad] = costFunctionReg(initial_theta, X, y, lambda); fprintf('Cost at initial theta (zeros): %f\n', cost);

fprintf('Gradient at initial theta (zeros) - first five values only:\n');

fprintf(' %f \n', grad(1:5));

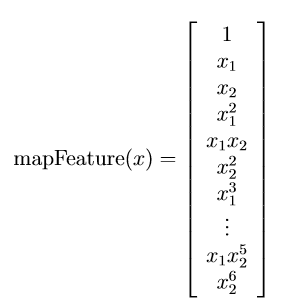

第3步:mapFeature函数实现特征设置:

function out = mapFeature(X1, X2) degree = 6;

out = ones(size(X1(:,1)));

for i = 1:degree

for j = 0:i

out(:, end+1) = (X1.^(i-j)).*(X2.^j);

end

end end

其设置的特征值为:

第4步:实现costFunctionReg函数:

function [J, grad] = costFunctionReg(theta, X, y, lambda) % Initialize some useful values

m = length(y); % number of training examples % You need to return the following variables correctly

J = 0;

grad = zeros(size(theta)); theta2 = theta(2:end,1);

h = sigmoid(X*theta);

J = 1/m*(-y'*log(h)-(1-y')*log(1-h)) + lambda/(2*m)*sum(theta2.^2);

theta(1,1) = 0;

grad = 1/m*(X'*(h-y)) + lambda/m*theta; end

第5步:使用fminunc函数求θ和Cost,并预测准确率:

% Initialize fitting parameters

initial_theta = zeros(size(X, 2), 1); % Set regularization parameter lambda to 1 (you should vary this)

lambda = 1; % Set Options

options = optimset('GradObj', 'on', 'MaxIter', 400); % Optimize

[theta, J, exit_flag] = ...

fminunc(@(t)(costFunctionReg(t, X, y, lambda)), initial_theta, options); % Plot Boundary

plotDecisionBoundary(theta, X, y);

hold on;

title(sprintf('lambda = %g', lambda)) % Labels and Legend

xlabel('Microchip Test 1')

ylabel('Microchip Test 2') legend('y = 1', 'y = 0', 'Decision boundary')

hold off; % Compute accuracy on our training set

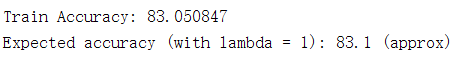

p = predict(theta, X); fprintf('Train Accuracy: %f\n', mean(double(p == y)) * 100);

fprintf('Expected accuracy (with lambda = 1): 83.1 (approx)\n');

运行结果:

机器学习作业(二)逻辑回归——Matlab实现的更多相关文章

- 机器学习二 逻辑回归作业、逻辑回归(Logistic Regression)

机器学习二 逻辑回归作业 作业在这,http://speech.ee.ntu.edu.tw/~tlkagk/courses/ML_2016/Lecture/hw2.pdf 是区分spam的. 57 ...

- 机器学习总结之逻辑回归Logistic Regression

机器学习总结之逻辑回归Logistic Regression 逻辑回归logistic regression,虽然名字是回归,但是实际上它是处理分类问题的算法.简单的说回归问题和分类问题如下: 回归问 ...

- Coursera-AndrewNg(吴恩达)机器学习笔记——第三周编程作业(逻辑回归)

一. 逻辑回归 1.背景:使用逻辑回归预测学生是否会被大学录取. 2.首先对数据进行可视化,代码如下: pos = find(y==); %找到通过学生的序号向量 neg = find(y==); % ...

- scikit-learn机器学习(二)逻辑回归进行二分类(垃圾邮件分类),二分类性能指标,画ROC曲线,计算acc,recall,presicion,f1

数据来自UCI机器学习仓库中的垃圾信息数据集 数据可从http://archive.ics.uci.edu/ml/datasets/sms+spam+collection下载 转成csv载入数据 im ...

- Stanford机器学习---第三讲. 逻辑回归和过拟合问题的解决 logistic Regression & Regularization

原文:http://blog.csdn.net/abcjennifer/article/details/7716281 本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归 ...

- 【机器学习基础】逻辑回归——LogisticRegression

LR算法作为一种比较经典的分类算法,在实际应用和面试中经常受到青睐,虽然在理论方面不是特别复杂,但LR所牵涉的知识点还是比较多的,同时与概率生成模型.神经网络都有着一定的联系,本节就针对这一算法及其所 ...

- 机器学习入门11 - 逻辑回归 (Logistic Regression)

原文链接:https://developers.google.com/machine-learning/crash-course/logistic-regression/ 逻辑回归会生成一个介于 0 ...

- Spark机器学习(2):逻辑回归算法

逻辑回归本质上也是一种线性回归,和普通线性回归不同的是,普通线性回归特征到结果输出的是连续值,而逻辑回归增加了一个函数g(z),能够把连续值映射到0或者1. MLLib的逻辑回归类有两个:Logist ...

- Logistic回归二分类Winner or Losser----台大李宏毅机器学习作业二(HW2)

一.作业说明 给定训练集spam_train.csv,要求根据每个ID各种属性值来判断该ID对应角色是Winner还是Losser(0.1分类). 训练集介绍: (1)CSV文件,大小为4000行X5 ...

随机推荐

- 微信小程序组件构建UI界面小练手 —— 表单登录注册微信小程序

通过微信小程序中丰富的表单组件来完成登录界面.手机快速注册界面.企业用户注册界面的微信小程序设计. 将会用到view视图容器组件.button按钮组件.image图片组件.input输入框组件.che ...

- redis两种持久化方式RDB和AOF

目录 前言 1. Redis 数据库结构 2. RDB 持久化 2.1. RDB 的创建和载入 2.1.1. 手动触发保存 SAVE 命令 BGSAVE 命令 SAVE 和 BGSAVE 的比较 2. ...

- redis 5.0.7 源码阅读——双向链表

redis中双向链表相关的文件为:adlist.h与adlist.c 一.数据结构 redis里定义的双向链表,与普通双向链表大致相同 单个节点: typedef struct listNode { ...

- Hibernate(六)--缓存策略

缓存: 缓存就是数据库数据在内存中的临时容器,包括数据库数据在内存中的临时拷贝,它位于数据库与数据库访问中间层,ORM在查询数据时,首先会根据自身的缓存管理策略,在缓存中查找相关数据,如果发现所需的数 ...

- 1.Android网络编程-HTML介绍

1.HTML介绍 超文本标记语言(HyperText Markup Language,简称:HTML)是一种用于创建网页的标准标记语言. 在Eclipse下则可以使用自带的浏览器浏览html: 2.H ...

- servlet中使用request.getHeader("referer")获取页面从哪跳转过来的

问题 servlet中使用request.getHeader("referer")获取页面从哪跳转过来的,利用这个方法可以判断网页是否正常登录.我做了一个javaweb小项目,其中 ...

- 关于非旋转Treap

刚刚跟着EM-LGH大佬学了非旋转Treap 非常庆幸不用再写万恶的rotate了(来自高级数据结构的恶意) 来记一下 Treap 概念 简单来说,\(Tree_{二叉搜索树} * Heap_堆 = ...

- centos tomcat解压版安装

解压: tar -xzvf apache-tomcat-8.5.23.tar.gz -C /usr/local/java 配置Tomcat的环境变量: export CATALINA_HOME=/us ...

- python三程

1.1 进程与线程简介 1.什么是进程(process)?(进程是资源集合) 定义:1)进程是资源分配最小单位 2)当一个可执行程序被系统执行(分配内存资源)就变成了一个进程 1. 程序并不能单 ...

- C++\CLI使用.net委托,*Callback注意"this"

今天在使用c++\cli的时候遇到了点关于委托,callback使用的问题,简单记录一下 首先贴段简单的C#中使用System.Threading.Timer的代码. Timer GameTim ...