使用Python自动填写问卷星(pyppeteer反爬虫版)

写此文的目的是为了方便寒假自己忘记填问卷星

一开始的想法和去年一样,去年就写过一版,想着今年不过就是改改数据,换换id而已,另外没想到的事情发生了。。。

满怀信心的写完代码

from selenium import webdriver

import time

import random def run():

browser = webdriver.Chrome()

browser.get("网址") # 1

js = "document.getElementById(\"q1\").click()"

browser.execute_script(js)

browser.switch_to.frame("__calendarIframe")

js2 = "document.getElementById(\"selectTodayButton\").click()"

browser.execute_script(js2)

browser.switch_to.parent_frame() # 2

js = "document.getElementById(\"q2\").click()"

browser.execute_script(js)

browser.switch_to.frame("__calendarIframe")

js2 = "document.getElementById(\"selectTodayButton\").click()"

browser.execute_script(js2)

browser.switch_to.parent_frame() # 3

js = "document.getElementById(\"q3_1\").click()"

browser.execute_script(js) # 4

browser.find_element_by_id("q4").send_keys("学号") # 5

browser.find_element_by_id("q5").send_keys("姓名") # 6

js = "document.getElementById(\"q6_1\").click()"

browser.execute_script(js) # 7

js = "document.getElementById(\"q7_3\").click()"

browser.execute_script(js) # 8

js = "document.getElementById(\"q8_1\").click()"

browser.execute_script(js)

browser.find_element_by_class_name("underline").send_keys("第一次1月9日阴性") # 9

js = "document.getElementById(\"q9_2\").click()"

browser.execute_script(js) # 10

js = "document.getElementById(\"q10_2\").click()"

browser.execute_script(js) # 11

js = "document.getElementById(\"q12_2\").click()"

browser.execute_script(js) # 12

browser.find_element_by_id("q14").send_keys("36."+str(random.randint(0,5))+"/36."+str(random.randint(0,5))) #13

js = "document.getElementById(\"q15_2\").click()"

browser.execute_script(js) #14

js = "document.getElementById(\"q17_2\").click()"

browser.execute_script(js) #15

browser.find_element_by_id("q19").click()

time.sleep(1)

browser.switch_to.frame("PDF_i_chezchenz")

browser.find_element_by_id("txtInput").send_keys("地址")

js3="document.getElementById(\"btnSearch\").click()"

browser.execute_script(js3)

time.sleep(1)

browser.find_element_by_css_selector("a.ensure_btn").click()

time.sleep(1)

browser.switch_to.default_content() # 16

js = "document.getElementById(\"q20_2\").click()"

browser.execute_script(js) # 17

browser.find_element_by_id("q22").send_keys("无") # 18

browser.find_element_by_id('select2-q23-container').click()

# js = "document.getElementById('select2-q23-container').click()"

# browser.execute_script(js)

browser.find_element_by_xpath("//li[@class='select2-results__option'][1]").click()

# js = "document.getElementById(\"select2-q23-result-ei9q-1\").click()"

# browser.execute_script(js) # submit

js = "document.getElementById(\"submit_button\").click()"

browser.execute_script(js) if __name__ == "__main__":

while True:

run()

time.sleep(4)

break

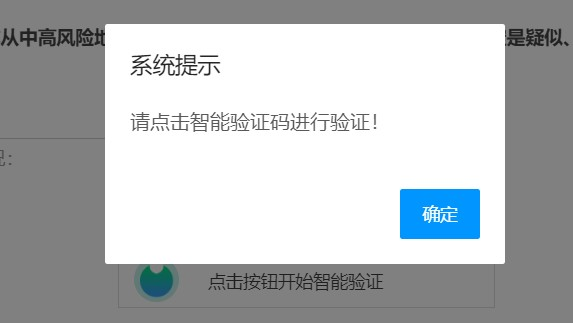

数据都填上了,可他来了一个这玩意

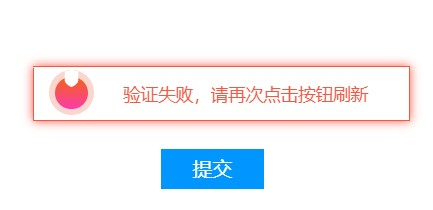

然后

之后了解到用用pyppeteer解决反爬的方法,安装python第三方库asyncio、pyppeteer和pyppeteer_stealth

完整代码如下:

import asyncio

from pyppeteer import launch

from pyppeteer_stealth import stealth #反爬

import random

import time

async def run():

driver = await launch({

# 谷歌浏览器的安装路径

'executablePath': 'C:\Program Files (x86)\Google\Chrome\Application\chrome.exe',

# Pyppeteer 默认使用的是无头浏览器

'headless': False,

# 设置Windows-size和Viewport大小来实现网页完整显示

'args': ['--no-sandbox', '--window-size=1024,768']

})

page = await driver.newPage()

await page.setViewport({'width': 1024, 'height': 768})

# 反爬虫跳入网页

await stealth(page)

await page.goto('网址')

time.sleep(1)

#1 问卷填报日期

date=await page.querySelector('#q1')

await date.click()

frame =page.frames

date2= await frame[1].querySelector('#selectTodayButton')

await date2.click()

#2 体温测量日期

date = await page.querySelector('#q2')

await date.click()

frame = page.frames

date2 = await frame[1].querySelector('#selectTodayButton')

await date2.click()

#3 班级

await page.click('#divquestion3 > ul > li > a')

#4 学号

await page.type('#q4','学号')

#5 姓名

await page.type('#q5','姓名')

# 6 性别

await page.click('#divquestion6 > ul:nth-child(2) > li:nth-child(1) > a')

#7 所在地区

await page.click('#divquestion7 > ul > li:nth-child(3) > a')

#8 核酸

await page.click('#divquestion8 > ul > li:nth-child(1) > a')

await page.type('#divquestion8 > ul > li:nth-child(1) > input.underline','第一次1月9日阴性')

#9 隔离情况

await page.click('#divquestion9 > ul > li:nth-child(2) > a')

#10 密切接触

await page.click('#divquestion10 > ul:nth-child(2) > li:nth-child(2) > a')

#12 病例

await page.click('#divquestion12 > ul:nth-child(2) > li:nth-child(2) > a')

#14 体温

temperature="36."+str(random.randint(2,6))+'/'+"36."+str(random.randint(2,6))

print(temperature)

await page.type('#q14',temperature)

#15 同住人员密切接触

await page.click('#divquestion15 > ul:nth-child(2) > li:nth-child(2) > a')

#17 同住人员病例

await page.click('#divquestion17 > ul:nth-child(2) > li:nth-child(2) > a')

#19 地理位置

address= await page.querySelector('#q19')

await address.click()

time.sleep(5)

frame=page.frames

await frame[2].type('#txtInput','地址')

time.sleep(1)

await frame[2].click('#btnSearch')

time.sleep(1)

await frame[2].click('.ensure_btn')

#20 居住地变化

await page.click('#divquestion20 > ul:nth-child(2) > li:nth-child(2) > a')

# 22 异常情况

await page.type('#q22','无')

#23 同住人员

await page.click('#select2-q23-container')

persion=await page.xpath("//li[@class='select2-results__option'][1]")

await persion[0].click()

time.sleep(2)

#提交

await page.click('#submit_button')

if __name__ == '__main__':

asyncio.get_event_loop().run_until_complete(run())

就提交成功了!!!

使用Python自动填写问卷星(pyppeteer反爬虫版)的更多相关文章

- selenium+python+eclipse 实现 “问卷星”网站,登录与检查登录示例!

1.使用selenium+python+eclipse实现的登录"问卷星",问卷星访问地址:https://www.sojump.com/ 2.实现步骤:1)进入链接---首页-- ...

- python填写问卷星,疫情上报

#!!!注意:修改main里的url为真实的url,按需修改 50行 set_data中的submitdata # 61行 ip 修改为 真ip # submittype可能有错误,在151行 # 提 ...

- JavaScript——问卷星自动填写

一.前言: 我们学校要刷学术章,有些学术章又是指定在某个时间点填写问卷星的问卷报名的.但是由于我手速慢,导致总会有些时候报不上名,于是想着搞个代码实现自动填写问卷星的报名表.一顿操作后,在github ...

- 通过Python实现自动填写调查问卷

0X00 前言 快开学了,看到空间里面各种求填写调查问卷的,我才想起来貌似我也还没做.对于这种无意义的问卷,我是不怎么感冒的,所以我打算使用”特技”来完成,也就是python,顺便重新复习一下pyth ...

- UI自动化填写问卷(selenium)+定时任务(懒人必备)

1.自动填报 UI自动化 selenium 开发程序动机:天天有人催着填写问卷,弄的头大.主要还是懒的每天一个个去填写内容. 开发总时长:2个小时:学习+开发+修改 遇到的小问题: 在自动化填写地图的 ...

- Python爬虫与反爬虫(7)

[Python基础知识]Python爬虫与反爬虫(7) 很久没有补爬虫了,相信在白蚁二周年庆的活动大厅比赛中遇到了关于反爬虫的问题吧 这节我会做个基本分享. 从功能上来讲,爬虫一般分为数据采集,处理, ...

- selenium+python自动化用例登陆界面模板

一.基本逻辑 1.自动填写用户名和密码登录成功后跳转到相应页面 2.验证相应页面的url与给定的url是否一致,如果一致则测试通过,如果不一致则不通过 二.以jenkins登陆界面为例,代码如下 fr ...

- 大型企业都在用的Python反爬虫手段,破了它!

SVG 映射反爬虫 很多人学习python,不知道从何学起.很多人学习python,掌握了基本语法过后,不知道在哪里寻找案例上手.很多已经做案例的人,却不知道如何去学习更加高深的知识.那么针对这三类人 ...

- 【HTML基础习题】HTML5+CSS3做问卷星登录页面

源代码下载地址:https://download.csdn.net/download/weixin_44893902/12839539 码云仓库地址: https://gitee.com/ynavc/ ...

随机推荐

- uniapp-父组件数组变化同步子组件视图渲染

项目中子组件封装的是一个picker,父组件需要传数组到子组件中. 如果父组件的数组出现变更,视图中的子组件或许不能直接刷新渲染,需要反复弹起几下才能看到. 试过深度监听,但都没有用,ref也不知道为 ...

- VMware Workstation 16中安装macOS Big Sur,AMD版

VMware Workstation 16中安装macOS Big Sur,AMD版 目录 VMware Workstation 16中安装macOS Big Sur,AMD版 准备阶段 步骤一:安装 ...

- 2020-2021 “Orz Panda” Cup Programming Contest

2020-2021 "Orz Panda" Cup Programming Contest 比赛情况 我们一共过了道3题 本场贡献:et3_tsy :过了A,提供了H的关键修改 ...

- MyBatis详细源码解析(上篇)

前言 我会一步一步带你剖析MyBatis这个经典的半ORM框架的源码! 我是使用Spring Boot + MyBatis的方式进行测试,但并未进行整合,还是使用最原始的方式. 项目结构 导入依赖: ...

- Greenplum 性能优化之路 --(一)分区表

一.什么是分区表 分区表就是将一个大表在物理上分割成若干小表,并且整个过程对用户是透明的,也就是用户的所有操作仍然是作用在大表上,不需要关心数据实际上落在哪张小表里面.Greenplum 中分区表的原 ...

- Flink读取resource资源文件

public static ParameterTool getParameterTool(String[] args){ try { return ParameterTool .fromPropert ...

- Python 学习笔记(下)

Python 学习笔记(下) 这份笔记是我在系统地学习python时记录的,它不能算是一份完整的参考,但里面大都是我觉得比较重要的地方. 目录 Python 学习笔记(下) 函数设计与使用 形参与实参 ...

- 安装篇五:安装MySQL(5.6.38版本)

#1.MySQL安装 #1.准备环境 # No1:关闭:(iptables)selinux # No2:下载好安装包(这里使用 mysql-5.6.38.tar.gz 包安装) # No3:安装依赖包 ...

- 【命令】ln命令

这是linux中一个非常重要命令,请大家一定要熟悉.它的功能是为某一个文件或目录在另外一个位置建立一个同步的链接,默认是链接是硬链接,常用参数是 "-s" . 对于ln命令,这里 ...

- 【进程/作业管理】篇章四:Linux任务计划、周期性任务执行

命令归纳: at 未来时间点让特定任务运行一次 batch 未来时间点让系统自行选择在系统资源较空闲的时间去执行指定的任务 corn 周期性任务计划(corntad) at命令详解 <--- 假 ...