kafka-stream数据清洗

1、数据清洗业务类LogProcessor

package com.css.kafka.kafka_stream; import org.apache.kafka.streams.processor.Processor;

import org.apache.kafka.streams.processor.ProcessorContext; /**

* 数据清洗*/

public class LogProcessor implements Processor<byte[], byte[]>{ private ProcessorContext context; //初始化

public void init(ProcessorContext context) {

//传输

this.context = context;

} //具体业务逻辑

public void process(byte[] key, byte[] value) {

//1.拿到消息数据,转成字符串

String message = new String(value); //2.如果包含- 去除

if (message.contains("-")) {

//3.把- 去掉 之后去掉左侧数据

message = message.split("-")[1];

}

//4.发送数据

context.forward(key, message.getBytes());

} //释放资源

public void close() {

}

}

2、Application类

package com.css.kafka.kafka_stream; import java.util.Properties; import org.apache.kafka.streams.KafkaStreams;

import org.apache.kafka.streams.StreamsConfig;

import org.apache.kafka.streams.Topology;

import org.apache.kafka.streams.processor.Processor;

import org.apache.kafka.streams.processor.ProcessorSupplier; /**

* 需求:对数据进行清洗操作

*

* 思路:wo-henshuai 把-和wo清洗掉*/

public class Application { public static void main(String[] args) {

//1.定义主题 发送到 另外一个主题中 数据清洗

String oneTopic = "t1";

String twoTopic = "t2"; //2.设置属性

Properties prop = new Properties();

prop.put(StreamsConfig.APPLICATION_ID_CONFIG, "logProcessor");

prop.put(StreamsConfig.BOOTSTRAP_SERVERS_CONFIG, "192.168.146.132:9092,192.168.146.133:9092,192.168.146.134:9092"); //3.实例对象

StreamsConfig config = new StreamsConfig(prop); //4.流计算 拓扑

Topology builder = new Topology(); //5.定义kafka组件数据源

builder.addSource("Source", oneTopic).addProcessor("Processor", new ProcessorSupplier<byte[], byte[]>() { public Processor<byte[], byte[]> get() {

return new LogProcessor();

}

//从哪里来

}, "Source")

//到哪里去

.addSink("Sink", twoTopic, "Processor"); //6.实例化kafkaStream

KafkaStreams kafkaStreams = new KafkaStreams(builder, prop);

kafkaStreams.start();

}

}

3、运行Application类的main方法

4、在hd09-1机器上创建主题t1

bin/kafka-topics.sh --zookeeper hd09-1:2181 --create --replication-factor 3 --partition 1 --topic t1

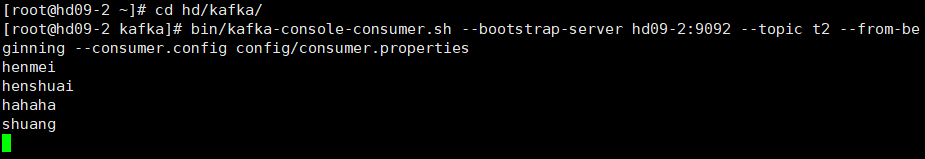

5、在hd09-2机器上启动消费者

bin/kafka-console-consumer.sh --bootstrap-server hd09-2:9092 --topic t2 --from-beginning --consumer.config config/consumer.properties

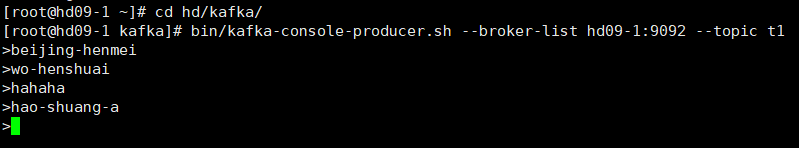

6、在hd09-1机器上启动生产者

bin/kafka-console-producer.sh --broker-list hd09-1:9092 --topic t1

7、此时在hd09-1机器kafka生产者上输入 wo-henshuai,在hd09-2消费者机器上会显示henshuai,即完成了数据清洗,如下图。

kafka-stream数据清洗的更多相关文章

- 告别Kafka Stream,让轻量级流处理更加简单

一说到数据孤岛,所有技术人都不陌生.在 IT 发展过程中,企业不可避免地搭建了各种业务系统,这些系统独立运行且所产生的数据彼此独立封闭,使得企业难以实现数据共享和融合,并形成了"数据孤岛&q ...

- 《Kafka Stream》调研:一种轻量级流计算模式

原文链接:https://yq.aliyun.com/articles/58382 摘要: 流计算,已经有Storm.Spark,Samza,包括最近新起的Flink,Kafka为什么再自己做一套流计 ...

- 流式处理的新贵 Kafka Stream - Kafka设计解析(七)

原创文章,转载请务必将下面这段话置于文章开头处. 本文转发自技术世界,原文链接 http://www.jasongj.com/kafka/kafka_stream/ Kafka Stream背景 Ka ...

- Kafka设计解析(七)- Kafka Stream

本文介绍了Kafka Stream的背景,如Kafka Stream是什么,什么是流式计算,以及为什么要有Kafka Stream.接着介绍了Kafka Stream的整体架构,并行模型,状态存储,以 ...

- Kafka Stream

Kafka Stream是Apache Kafka从0.10版本引入的一个新Feature(当前:1.0.0-rc0,参见:https://github.com/apache/kafka/releas ...

- Kafka设计解析(七)Kafka Stream

转载自 技术世界,原文链接 Kafka设计解析(七)- Kafka Stream 本文介绍了Kafka Stream的背景,如Kafka Stream是什么,什么是流式计算,以及为什么要有Kafka ...

- 流式计算新贵Kafka Stream设计详解--转

原文地址:https://mp.weixin.qq.com/s?__biz=MzA5NzkxMzg1Nw==&mid=2653162822&idx=1&sn=8c4611436 ...

- kafka stream 低级别的Processor API动态生成拓扑图

public class KafkaSream { public static void main(String[] args) { Map<String, Object> props = ...

- 流式计算(二)-Kafka Stream

前面说了Java8的流,这里还说流处理,既然是流,比如水流车流,肯定得有流的源头,源可以有多种,可以自建,也可以从应用端获取,今天就拿非常经典的Kafka做源头来说事,比如要来一套应用日志实时分析框架 ...

- kafka(五) 流式处理 kafka stream

参考文档: http://www.infoq.com/cn/articles/kafka-analysis-part-7?utm_source=infoq&utm_campaign=user_ ...

随机推荐

- jquery 情况form表单的所有内容

#project_file_upload 为表单的id $(':input','#project_file_upload') .not(':button, :submit, :reset, :hidd ...

- 浅析StackTrace

我们在学习函数调用时,都知道每个函数都拥有自己的栈空间.一个函数被调用时,就创建一个新的栈空间.那么通过函数的嵌套调用最后就形成了一个函数调用堆栈.在c#中,使用StackTrace记录这个堆栈.你可 ...

- scp采用无密码在两台linux服务器之间传输数据

一.root用户: 1. 在主机A上执行如下命令来生成配对密钥: ssh-keygen -t rsa 按照提示操作,注意,不要输入passphrase.提示信息如下 Generating public ...

- Datatable添加数据,提示该行已经属于另一个表的解决方法

一.DataTable.Rows.Add(DataRow.ItemArray); 二.DataTable.ImportRow(DataRow) 三.设置DataTable的tablename,然后.R ...

- zabbix 监控 AWS-SQS 队列

zabbix-AWS_SQS-monitor AWS SQS status monitor with zabbix zabbix通过 AWS 云 api 自动发现.监控 AWS-SQS 本版本数据的图 ...

- 【Properties】Properties的load方法

Properties的load方法其实就是传进去一个输入流,字节流或者字符流,字节流利用InputStreamReader转化为字符流, 然后字符流用BufferedReader包装,Buffered ...

- PyQt的QString 和 QStringList

在Qt的C++实现中的QString 和 QStringList 在Python的实现中等效替换为 "str1" 和 ["str1","str2&qu ...

- java守护线程。

java的守护线程:具体定义我也不太清楚,百度和谷歌了看的也不是很明白,但是啊,下边有给出一个例子自己领悟吧. 一.计时器的Timer声明时是否声明为守护线程对计时器的影响. /** * */ pac ...

- List<T>转DataTable

/// <summary> /// 将集合类转换成DataTable /// </summary> /// <param name="list"> ...

- ie设置ActiveX控件不提示

ie设置自动允许activex: 对安全设置-受信任的站点区域-对未标记为可安全执行脚本的ActiveX控件初始化并执形脚本(启用)