神经网络NN笔记

参考:http://www.cnblogs.com/subconscious/p/5058741.html

俗话说,好记性不如烂笔头~~~~

边学边记,方便以后查找~~~~~

一、介绍一下经典的神经网络

这个是人脑的神经网络,是不是很复杂啊~~~~~~科普成人的大脑里有1000亿的神经元(但怎么感觉大脑不够用啊~~~~可怕)

我来盗一波图~~~哈哈

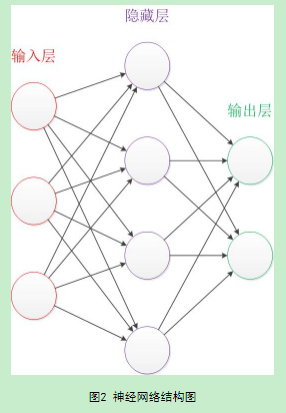

上图2是经典的神经网络图,其中包括输入层3个,隐藏层4个,输出层2个。在设计一个神经网络的时候,输入层和输出层的节点数往往是固定不变的,中间的隐藏层则是自由指定的。这个结构图中的拓扑与箭头代表预测过程时数据的流向,但是这个和训练时还是有一定的区别的~~~~

重要的来了。。图2的一个圆圈代表一个神经元,连接线代表神经元之间的连接,每个连接线对应一个不同的权重,权重的值叫做权值,需要通过训练获得的。

二、神经元

盗图的感觉真棒啊~~~~~

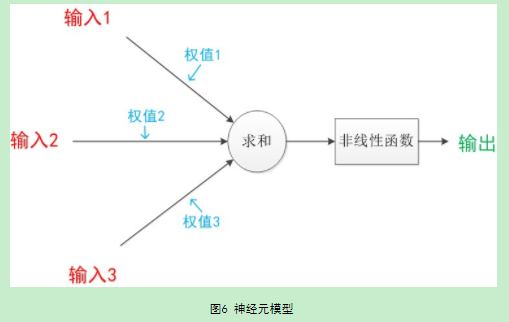

一个神经元的模型,包含输入,输出与计算功能的模型,上图就是3个输入,2个计算功能,1个输出,这些线每个都有一个权值。

(我有一个大胆的想法,可不可以把神经网络缩小化,变成一个神经元~~~两者真的很像)

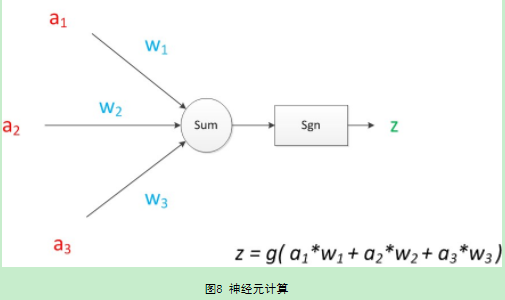

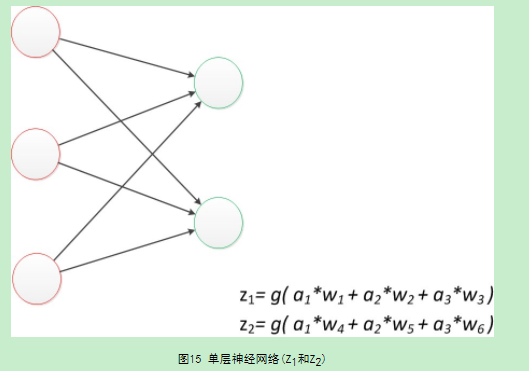

由上图知,z是在输入和权值的线性加权和套了一个函数g的值。

神经元模型的使用时,可以这样理解:假设一个数据data,称之为样本。样本有4个属性,其中三个属性为已知a1,a2,a3,,一个属性为未知,z。我们需要做的是通过三个已知属性预测未知属性,z

z可以通过公式计算出来。

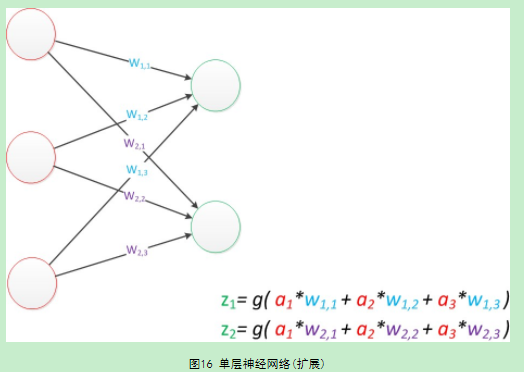

w权值的之间关系用矩阵表示

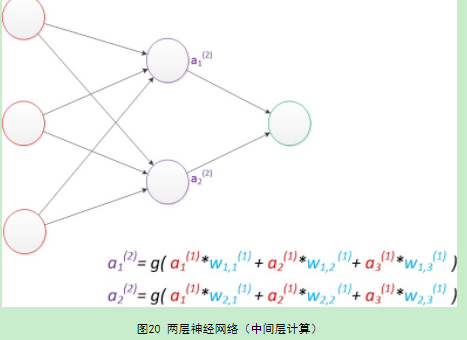

如图,两层的神经网络结构,

三、RNN / CNN/DNN

1.DNN神经网络有深度~~~~

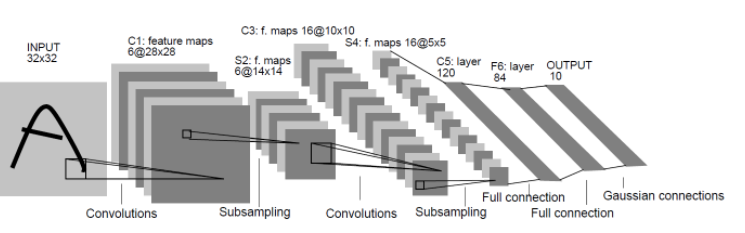

2.CNN卷积神经网络

有时候参数数量的膨胀,容易过拟合,极易陷入局部最优。需要用‘卷积核’作为中介。同一个卷积核在所有图像内是共享的,图像通过卷积操作后仍然保留原先的位置关系。

3.RNN循环神经网络

因为全连接的DNN有一个问题---------无法对时间序列上的变化进行建模。

然而,样本出现时间顺序对于自然语言处理、语音识别等应用非常重要。

对了适应这种需求,RNN循环神经网络。

在RNN中,神经元的输出可以在下一个时间戳直接作用到自身(第i层神经元在m时刻的输入,除了(i-1)层神经元在该时刻的输出外,还包括其自身在(m-1)时刻的输出)

RNN可以看成一个在时间上传递的神经网络,深度是时间的长度~~~

然而梯度消失现象还是要出现,且发生在时间轴上。对于t时刻来说,它产生的梯度在时间轴上向历史传播层之后就消失了,所以无法影响太遥远的过去。

神经网络NN笔记的更多相关文章

- tensorflow中使用mnist数据集训练全连接神经网络-学习笔记

tensorflow中使用mnist数据集训练全连接神经网络 ——学习曹健老师“人工智能实践:tensorflow笔记”的学习笔记, 感谢曹老师 前期准备:mnist数据集下载,并存入data目录: ...

- Python机器学习笔记:卷积神经网络最终笔记

这已经是我的第四篇博客学习卷积神经网络了.之前的文章分别是: 1,Keras深度学习之卷积神经网络(CNN),这是开始学习Keras,了解到CNN,其实不懂的还是有点多,当然第一次笔记主要是给自己心中 ...

- 人工神经网络NN

[面向代码]学习 Deep Learning系列 http://blog.csdn.net/coolluyu/article/details/20214617 正则化的最小二乘法 深入浅出LSTM神经 ...

- 【cs231n】神经网络学习笔记3

+ mu) * v # 位置更新变了形式 对于NAG(Nesterov's Accelerated Momentum)的来源和数学公式推导,我们推荐以下的拓展阅读: Yoshua Bengio的Adv ...

- 【cs231n】神经网络学习笔记1

神经网络推荐博客: 深度学习概述 神经网络基础之逻辑回归 神经网络基础之Python与向量化 浅层神经网络 深层神经网络 前言 首先声明,以下内容绝大部分转自知乎智能单元,他们将官方学习笔记进行了很专 ...

- Python神经网络编程笔记

神经元 想一想便知道,当一个人捏你一下以至于你会痛得叫起来的力度便是神经元的阈值,而我们构建的时候也是把这种现象抽象成一个函数,叫作激活函数. 而这里便是我们使用sigmoid函数的原因,它是一个很简 ...

- 卷积神经网络学习笔记——Siamese networks(孪生神经网络)

完整代码及其数据,请移步小编的GitHub地址 传送门:请点击我 如果点击有误:https://github.com/LeBron-Jian/DeepLearningNote 在整理这些知识点之前,我 ...

- 卷积神经网络学习笔记——SENet

完整代码及其数据,请移步小编的GitHub地址 传送门:请点击我 如果点击有误:https://github.com/LeBron-Jian/DeepLearningNote 这里结合网络的资料和SE ...

- BP神经网络学习笔记_附源代码

BP神经网络基本原理: 误差逆传播(back propagation, BP)算法是一种计算单个权值变化引起网络性能变化的较为简单的方法.由于BP算法过程包含从输出节点开始,反向地向第一隐含层(即最接 ...

随机推荐

- JAVA基础面试(五)

41.a.hashCode() 有什么用?与 a.equals(b) 有什么关系? hashCode() 方法对应对象整型的 hash 值.它常用于基于 hash 的集合类,如 Hash ...

- 两种数据传输的方式——get和post。

Form提供了两种数据传输的方式——get和post.虽然它们都是数据的提交方式,但是在实际传输时确有很大的不同,并且可能会对数据产生严重的影响.虽然为了方便的得到变量值,Web容器已经屏蔽了二者的一 ...

- C语言之找零钱

#include<stdio.h>int main(){ int one,tow,five,num=1; for (one = 1; one < num*10; one++) { f ...

- 使用ThinkPHP的扩展功能

文件上传类的代码位于“\ThinkPHP\Libabry\Think\Uplod.class.php”,实例化电偶用即可.1:在Home模块Index控制器test方法中实现文件上传功能.打开文件\A ...

- Centos7.0 下挂载磁盘

参考:

- linux下php7安装memcached、redis扩展

linux下php7安装memcached.redis扩展 1.php7安装Memcached扩展 比如说我现在使用了最新的 Ubuntu 16.04,虽然内置了 PHP 7 源,但 memcache ...

- idea从git上拉取并管理项目

1:idea从git上拉取项目 (1)FILE --> New --> Project from Version Control --> Git (2):输入项目的Https SSH ...

- RxAndroid中observable的基本使用和表单校验操作

RxAndroid 响应式编程 类似于监听-观察者模式 在观察者模式中,你的对象需要实现 RxJava 中的两个关键接口:Observable 和 Observer.当 Observable 的状态改 ...

- EntityFrameworkCore v1.1.1 问题汇总

随着宇宙第一IDE的最新版本发布[2017/3/7],AspNetCore 和EntityFrameworkCore(团队)都发布了最新的代码. 不过在我看来,这些到还不是最重要的.最重要的是dotn ...

- python 3.6 urllib库实现天气爬取、邮件定时给妹子发送天气

#由于每天早上要和妹子说早安,于是做个定时任务,每天早上自动爬取天气,发送天气问好邮件##涉及模块:#(1)定时任务:windows的定时任务# 配置教程链接:http://b ...