python爬虫--案例分析之针对简单的html文件

python爬虫常用的库:Python 库(urllib、BeautifulSoup、requests、scrapy)实现网页爬虫

python爬虫最简单案例分析: 对一个html文件进行分解,获取里面想要的数据

<html lang="en">

<head>

<meta charset="UTF-8"/>

<title>测试bs4</title>

</head>

<body>

<div>

<p>百里守约</p>

</div> <div class="song">

<p>李清照</p>

<p>王安石</p>

<p>苏轼</p>

<p>柳宗元</p>

<a href="http://www.song.com/" title="赵匡胤" target="_self">

<span>this is span</span>

宋朝是最强大的王朝,不是军队的强大,而是经济很强大,国民都很有钱</a>

<a href="" class="du">总为浮云能蔽日,长安不见使人愁</a>

<img src="http://www.baidu.com/meinv.jpg" alt=""/>

</div> <div class="tang">

<ul>

<li><a href="http://www.baidu.com" title="qing">清明时节雨纷纷,路上行人欲断魂,借问酒家何处有,牧童遥指杏花村</a></li>

<li><a href="http://www.163.com" title="qin">秦时明月汉时关,万里长征人未还,但使龙城飞将在,不教胡马度阴山</a></li>

<li><a href="http://www.126.com" alt="qi">岐王宅里寻常见,崔九堂前几度闻,正是江南好风景,落花时节又逢君</a></li>

<li><a href="http://www.sina.com" class="du">杜甫</a></li>

<li><a href="http://www.dudu.com" class="du">杜牧</a></li>

<li><b>杜小月</b></li>

<li><i>度蜜月</i></li>

<li><a href="http://www.haha.com" id="feng">凤凰台上凤凰游,凤去台空江自流,吴宫花草埋幽径,晋代衣冠成古丘</a></li>

</ul>

</div>

</body>

</html>

import requests

from lxml import etree tree = etree.parse("E:\odoo14\odoo14\myaddons\demo.html") # 获取html文件

tang_info = tree.xpath("//div[@class='tang']/ul/li/a/text()") # 获取标签里的文本

print('tang_info', tang_info)

# "tang_info ['清明时节雨纷纷,路上行人欲断魂,借问酒家何处有,牧童遥指杏花村', '秦时明月汉时关,万里长征人未还,但使龙城飞将在,不教胡马度阴山', '岐王宅里寻常见,崔九堂前几度闻,正是江南好风景,落花时节又逢君', '杜甫', '杜牧', '凤凰台上凤凰游,凤去台空江自流,吴宫花草埋幽径,晋代衣冠成古丘']" song_info = tree.xpath("//div[@class='song']/p/text()") #找到div的class 是song的,标签是p的文本

print('song_info', song_info)

# 结果 "song_info ['李清照', '王安石', '苏轼', '柳宗元']" song_src = tree.xpath("//div[@class='song']/img/@src") #找 到div的class 是song的,的img属性

print('song_src', song_src) # song_src ['http://www.baidu.com/meinv.jpg']

song_src_a = tree.xpath("//div[@class='song']/a/text()")

print('song_src_a', song_src_a)

# song_src_a ['\n ', '\n 宋朝是最强大的王朝,不是军队的强大,而是经济很强大,国民都很有钱', '总为浮云能蔽日,长安不见使人愁']

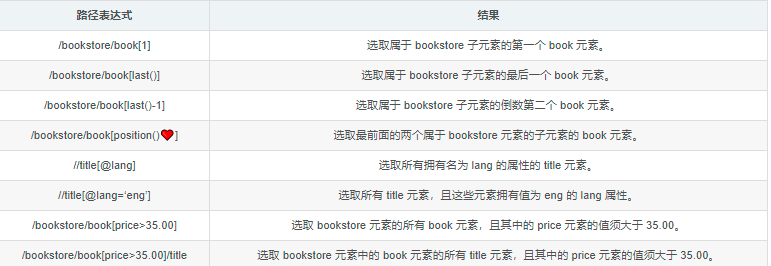

关于xpath路径的写法:XPath(全称XML Path Languang),即XML路径语言,是一种在XML文档中查找信息的语言。

1、/ 表示从根节点选取

2、// 从匹配选择的当前节点选择文档中的节点,而不考虑它们的位置。

3、@ 选取属性 返回所指元素的文本内容。

4、text() 返回所指元素的文本内容

4.1、string() 函数会得到所指元素的所有节点文本内容,这些文本讲会被拼接成一个字符串。

4.3、data():data()函数和string()函数通用,而且不建议经常使用data()函数,有数据表明,该函数会影响XPath的性能。

注意:爬取内容都为数字的时候只能使用data(),不能使用text()或 string(),因为XPath不支持字符串做数学运算。

案例:song_info = tree.xpath("//div[@class='song']/p/text()") #找到div的class 是song的,标签是p的文本

5.查找页面上第一个form元素://form[1]

6.查找页面上id为loginForm的form元素://form[@id=‘loginForm’]

7、/bookstore/book[1] 选取属于 bookstore 子元素的第一个 book 元素。

8、/bookstore/book[last()] 选取属于 bookstore 子元素的最后一个 book 元素。

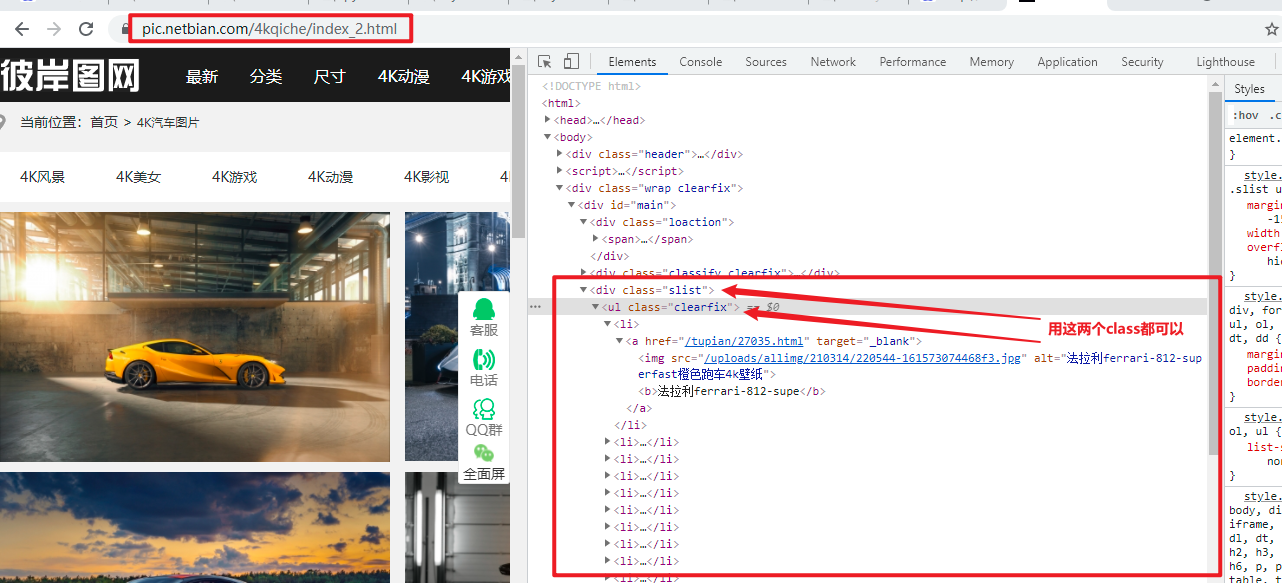

案例2:分析结构:

链接:首页 url = 'http://pic.netbian.com/4kqiche/'

后面分页:url = 'https://pic.netbian.com/4kqiche/index_%s.html' % page

import requests

from lxml import etree headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/73.0.3683.103 Safari/537.36'

}

# url = 'http://pic.netbian.com/4kdongman/' for page in range(1, 23):

if page == 1:

url = 'http://pic.netbian.com/4kqiche/'

else:

url = 'https://pic.netbian.com/4kqiche/index_%s.html' % page response = requests.get(url=url, headers=headers)

# response.encoding = 'utf-8' #手动设定响应数据的编码 page_text = response.text # 数据解析(图片地址,图片名称)

tree = etree.HTML(page_text)

# li_list = tree.xpath('//div[@class="slist"]/ul/li')

li_list = tree.xpath('//ul[@class="clearfix"]/li')

print('------------page--------------:', page)

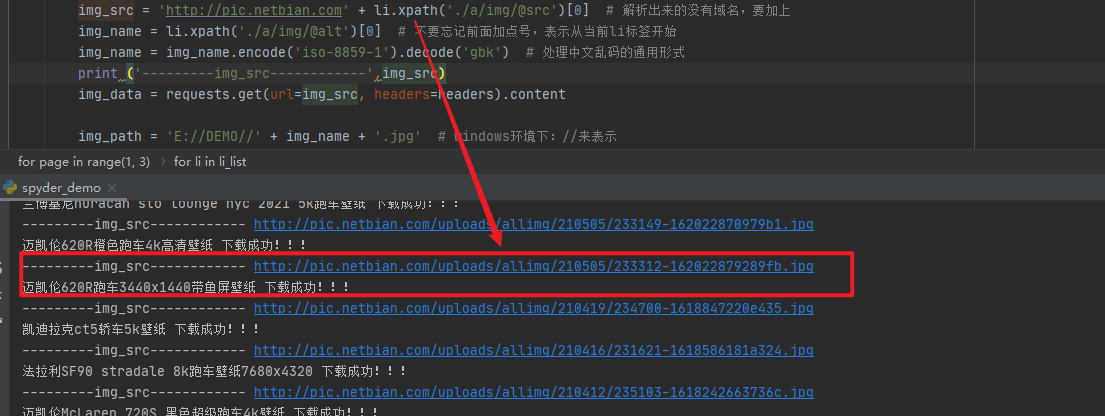

for li in li_list:

# 局部内容解析一定是以./开头。etree和element都可以调用xpath

img_src = 'http://pic.netbian.com' + li.xpath('./a/img/@src')[0] # 解析出来的没有域名,要加上

img_name = li.xpath('./a/img/@alt')[0] # 不要忘记前面加点号,表示从当前li标签开始

img_name = img_name.encode('iso-8859-1').decode('gbk') # 处理中文乱码的通用形式

img_data = requests.get(url=img_src, headers=headers).content img_path = 'E://DEMO//' + img_name + '.jpg' # windows环境下://来表示

with open(img_path, 'wb') as fp:

fp.write(img_data)

print(img_name, '下载成功!!!')

python爬虫--案例分析之针对简单的html文件的更多相关文章

- python爬虫之分析Ajax请求抓取抓取今日头条街拍美图(七)

python爬虫之分析Ajax请求抓取抓取今日头条街拍美图 一.分析网站 1.进入浏览器,搜索今日头条,在搜索栏搜索街拍,然后选择图集这一栏. 2.按F12打开开发者工具,刷新网页,这时网页回弹到综合 ...

- Python爬虫教程-14-爬虫使用filecookiejar保存cookie文件(人人网)

Python爬虫教程-14-爬虫使用filecookiejar保存cookie文件(人人网) 上一篇介绍了利用CookieJar访问人人网,本篇将使用filecookiejar将cookie以文件形式 ...

- 【Python爬虫案例】用Python爬取李子柒B站视频数据

一.视频数据结果 今天是2021.12.7号,前几天用python爬取了李子柒的油管评论并做了数据分析,可移步至: https://www.cnblogs.com/mashukui/p/1622025 ...

- 简单python爬虫案例(爬取慕课网全部实战课程信息)

技术选型 下载器是Requests 解析使用的是正则表达式 效果图: 准备好各个包 # -*- coding: utf-8 -*- import requests #第三方下载器 import re ...

- 【Python爬虫案例学习】分析Ajax请求并抓取今日头条街拍图片

1.抓取索引页内容 利用requests请求目标站点,得到索引网页HTML代码,返回结果. from urllib.parse import urlencode from requests.excep ...

- 【Python爬虫案例学习】python爬取淘宝里的手机报价并以价格排序

第一步: 先分析这个url,"?"后面的都是它的关键字,requests中get函数的关键字的参数是params,post函数的关键字参数是data, 关键字用字典的形式传进去,这 ...

- 【Python爬虫案例学习】Python爬取天涯论坛评论

用到的包有requests - BeautSoup 我爬的是天涯论坛的财经论坛:'http://bbs.tianya.cn/list.jsp?item=develop' 它里面的其中的一个帖子的URL ...

- 【Python爬虫案例学习】下载某图片网站的所有图集

前言 其实很简短就是利用爬虫的第三方库Requests与BeautifulSoup. 其实就几行代码,但希望没有开发基础的人也能一下子看明白,所以大神请绕行. 基本环境配置 python 版本:2.7 ...

- python爬虫案例:使用XPath爬网页图片

用XPath来做一个简单的爬虫,尝试爬取某个贴吧里的所有帖子,并且将该这个帖子里每个楼层发布的图片下载到本地. # -*- coding:utf-8 -*- import urllib import ...

随机推荐

- jmeter--文件上传和下载

文件下载 文件下载的method一般是get.本例中导出excel文件. 下载文件如果要求下载到本地,需要另写脚本.采用jsr223或者beashell PostProcessor都可以. 代码如下: ...

- 【NX二次开发】判断部件是否已修改(判断部件是否需要保存)UF_PART_is_modified();

判断部件是否已修改(判断部件是否需要保存)UF_PART_is_modified(); 注意:函数需要输入原型,不要输入事例.事例转原型:UF_ASSEM_ask_prototype_of_occ() ...

- Java算法面试题(史上最强、持续更新、吐血推荐)

文章很长,建议收藏起来,慢慢读! 疯狂创客圈为小伙伴奉上以下珍贵的学习资源: 疯狂创客圈 经典图书 : <Netty Zookeeper Redis 高并发实战> 面试必备 + 大厂必备 ...

- ANDROID开发之OOM:一张图片(BitMap)占用内存的计算 图片内存优化

Android中一张图片(BitMap)占用的内存主要和以下几个因数有关:图片长度,图片宽度,单位像素占用的字节数. 一张图片(BitMap)占用的内存=图片长度*图片宽度*单位像素占用的字节数 注: ...

- python画图库及函数,绘制图片从文件提取出来的数据集转化为int,不然作为坐标轴的时候因为是字符串而无法排序

转化int:

- excel函数sum、sumif和sumifs

1.sum(a1,a2,a2,...a10)或sum(a1:a10)求a1到a10的和 2.sumif(条件区域,指定的求和条件,求和的区域) =SUMIF($F$2:$F$7,J2,$H$2:$H$ ...

- centos使用yum安装docker

1.先决条件 要安装 Docker 引擎,您需要 CentOS 7 或 8 的维护版本.不支持或测试存档版本. 该centos-extras库必须启用.默认情况下启用此存储库,但如果您已禁用它,则需要 ...

- [Linux]Ansible自动化运维① - 入门知识

目录 一.Ansible 概述 1.1 Ansible 是什么 1.2 Ansible 优势 1.3 Ansible 特性 二.Ansible 入门 2.1 Ansible 架构 2.2 Ansibl ...

- flex PopUpManager createPopUp方式弹出窗口

createPopUp:是上来先设置好弹出方式,然后在new出来一个TitleWindow的对象,然后通过此对象设置他的变现形式. addPopUp:是先new出来对象,设置好表现形式,然后在选择弹出 ...

- 通过PLSQL创建Database link,DBMS_Job,Procedure,实现Oracle跨库传输数据

前一阵领导安排了一个任务:定时将集团数据库某表的数据同步至我们公司服务器的数据库,感觉比写增删改查SQL有趣,特意记录下来,希望能帮到有类似需求的小伙伴,如有错误也希望各位不吝指教 环境描述: 集团数 ...