Flink+Druid构建实时OLAP的探索

场景

k12在线教育公司的业务场景中,有一些业务场景需要实时统计和分析,如分析在线上课老师数量、学生数量,实时销售额,课堂崩溃率等,需要实时反应上课的质量问题,以便于对整个公司的业务情况有大致的了解。

方案对比

对比了很多解决方案,如下几种,列出来供参考。

| 方案 | 实时入库 | SQL支持度 |

|---|---|---|

| Spark+CarbonData | 支持 | Spark SQL语法丰富 |

| Kylin | 不支持 | 支持join |

| Flink+Druid | 支持 | 0.15以前不支持SQL,不支持join |

- 上一篇文章所示,使用Spark+CarbonData也是一种解决方案,但是他的缺点也是比较明显,如不能和Flink进行结合,因为我们整个的大数据规划的大致方向是,Spark用来作为离线计算,Flink作为实时计算,并且这两个大方向短时间内不会改变;

- Kylin一直是老牌OLAP引擎,但是有个缺点无法满足我们的需求,就是在技术选型的那个时间点kylin还不支持实时入库(后续2.0版本支持实时入库),所以就选择了放弃;

- 使用Flink+Druid方式实现,这个时间选择这个方案,简直是顺应潮流呀,Flink现在如日中天,各大厂都在使用,Druid是OLAP的新贵,关于它的文章也有很多,我也不赘述太多。有兴趣的可以看下这篇文章,我的博客其它文章也有最新版本的安装教程,实操方案哦。

设计方案

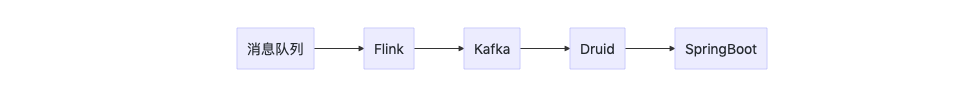

实时处理采用Flink SQL,实时入库Druid方式采用 druid-kafka-indexing-service,另一种方式入库方式,Tranquility,这种方式测试下来问题多多,放弃了。数据流向如下图。

场景举例

实时计算课堂连接掉线率。此事件包含两个埋点上报,进入教室和掉线分别上报数据。druid设计的字段

flink的处理

将上报的数据进行解析,上报使用的是json格式,需要解析出所需要的字段然后发送到kafka。字段包含如下

sysTime,DateTime格式

pt,格式yyyy-MM-dd

eventId,事件类型(enterRoom|disconnect)

lessonId,课程ID

Druid处理

启动Druid Supervisor,消费Kafka里的数据,使用预聚合,配置如下

{

"type": "kafka",

"dataSchema": {

"dataSource": "sac_core_analyze_v1",

"parser": {

"parseSpec": {

"dimensionsSpec": {

"spatialDimensions": [],

"dimensions": [

"eventId",

"pt"

]

},

"format": "json",

"timestampSpec": {

"column": "sysTime",

"format": "auto"

}

},

"type": "string"

},

"metricsSpec": [

{

"filter": {

"type": "selector",

"dimension": "msg_type",

"value": "disconnect"

},

"aggregator": {

"name": "lesson_offline_molecule_id",

"type": "cardinality",

"fields": ["lesson_id"]

},

"type": "filtered"

}, {

"filter": {

"type": "selector",

"dimension": "msg_type",

"value": "enterRoom"

},

"aggregator": {

"name": "lesson_offline_denominator_id",

"type": "cardinality",

"fields": ["lesson_id"]

},

"type": "filtered"

}

],

"granularitySpec": {

"type": "uniform",

"segmentGranularity": "DAY",

"queryGranularity": {

"type": "none"

},

"rollup": true,

"intervals": null

},

"transformSpec": {

"filter": null,

"transforms": []

}

},

"tuningConfig": {

"type": "kafka",

"maxRowsInMemory": 1000000,

"maxBytesInMemory": 0,

"maxRowsPerSegment": 5000000,

"maxTotalRows": null,

"intermediatePersistPeriod": "PT10M",

"basePersistDirectory": "/tmp/1564535441619-2",

"maxPendingPersists": 0,

"indexSpec": {

"bitmap": {

"type": "concise"

},

"dimensionCompression": "lz4",

"metricCompression": "lz4",

"longEncoding": "longs"

},

"buildV9Directly": true,

"reportParseExceptions": false,

"handoffConditionTimeout": 0,

"resetOffsetAutomatically": false,

"segmentWriteOutMediumFactory": null,

"workerThreads": null,

"chatThreads": null,

"chatRetries": 8,

"httpTimeout": "PT10S",

"shutdownTimeout": "PT80S",

"offsetFetchPeriod": "PT30S",

"intermediateHandoffPeriod": "P2147483647D",

"logParseExceptions": false,

"maxParseExceptions": 2147483647,

"maxSavedParseExceptions": 0,

"skipSequenceNumberAvailabilityCheck": false

},

"ioConfig": {

"topic": "sac_druid_analyze_v2",

"replicas": 2,

"taskCount": 1,

"taskDuration": "PT600S",

"consumerProperties": {

"bootstrap.servers": "bd-prod-kafka01:9092,bd-prod-kafka02:9092,bd-prod-kafka03:9092"

},

"pollTimeout": 100,

"startDelay": "PT5S",

"period": "PT30S",

"useEarliestOffset": false,

"completionTimeout": "PT1200S",

"lateMessageRejectionPeriod": null,

"earlyMessageRejectionPeriod": null,

"stream": "sac_druid_analyze_v2",

"useEarliestSequenceNumber": false

},

"context": null,

"suspended": false

}

最重要的配置是metricsSpec,他主要定义了预聚合的字段和条件。

数据查询

数据格式如下

| pt | eventId | lesson_offline_molecule_id | lesson_offline_denominator_id |

|---|---|---|---|

| 2019-08-09 | enterRoom | "AQAAAAAAAA==" | "AQAAAAAAAA==" |

| 2019-08-09 | disconnect | "AQAAAAAAAA==" | "AQAAAAAAAA==" |

结果可以按照这样的SQL出

SELECT pt,CAST(APPROX_COUNT_DISTINCT(lesson_offline_molecule_id) AS DOUBLE)/CAST(APPROX_COUNT_DISTINCT(lesson_offline_denominator_id) AS DOUBLE) from sac_core_analyze_v1 group by pt

可以使用Druid的接口查询结果,肥肠的方便~

Flink+Druid构建实时OLAP的探索的更多相关文章

- druid.io 海量实时OLAP数据仓库 (翻译+总结) (1)

介绍 我是NDPmedia公司的大数据OLAP的资深高级工程师, 专注于OLAP领域, 现将一个成熟的可靠的高性能的海量实时OLAP数据仓库介绍给大家: druid.io NDPmedia在2014年 ...

- druid.io 海量实时OLAP数据仓库 (翻译+总结) (1)——分析框架如hive或者redshift(MPPDB)、ES等

介绍 我是NDPmedia公司的大数据OLAP的资深高级工程师, 专注于OLAP领域, 现将一个成熟的可靠的高性能的海量实时OLAP数据仓库介绍给大家: druid.io NDPmedia在2014年 ...

- DataPipeline丨构建实时数据集成平台时,在技术选型上的考量点

文 | 陈肃 DataPipeline CTO 随着企业应用复杂性的上升和微服务架构的流行,数据正变得越来越以应用为中心. 服务之间仅在必要时以接口或者消息队列方式进行数据交互,从而避免了构建单一数 ...

- OPPO数据中台之基石:基于Flink SQL构建实数据仓库

小结: 1. OPPO数据中台之基石:基于Flink SQL构建实数据仓库 https://mp.weixin.qq.com/s/JsoMgIW6bKEFDGvq_KI6hg 作者 | 张俊编辑 | ...

- 唯品会海量实时OLAP分析技术升级之路

本文转载自公众号 DBAplus社群 , 作者:谢麟炯 谢麟炯,唯品会大数据平台高级技术架构经理,主要负责大数据自助多维分析平台,离线数据开发平台及分析引擎团队的开发和管理工作,加入唯品会以来还曾负责 ...

- Demo:基于 Flink SQL 构建流式应用

Flink 1.10.0 于近期刚发布,释放了许多令人激动的新特性.尤其是 Flink SQL 模块,发展速度非常快,因此本文特意从实践的角度出发,带领大家一起探索使用 Flink SQL 如何快速构 ...

- 腾讯云EMR大数据实时OLAP分析案例解析

OLAP(On-Line Analytical Processing),是数据仓库系统的主要应用形式,帮助分析人员多角度分析数据,挖掘数据价值.本文基于QQ音乐海量大数据实时分析场景,通过QQ音乐与腾 ...

- ElasticSearch做实时OLAP框架~实时搜索、统计和OLAP需求,甚至可以作为NOSQL来使用(转)

使用ElasticSearch作为大数据平台的实时OLAP框架 – lxw的大数据田地 http://lxw1234.com/archives/2015/12/588.htm 一直想找一个用于大数据平 ...

- 使用 Kafka 和 Spark Streaming 构建实时数据处理系统

使用 Kafka 和 Spark Streaming 构建实时数据处理系统 来源:https://www.ibm.com/developerworks,这篇文章转载自微信里文章,正好解决了我项目中的技 ...

随机推荐

- 分析了16年的福利彩票记录,原来可以用Python这么买彩票

目录 0 引言 1 环境 2 需求分析 3 代码实现 4 后记 0 引言 上周被一则新闻震惊到了,<2454万元大奖无人认领!福彩史上第二大弃奖在广东中山产生 >,在2019年5月2日开奖 ...

- RocketMQ与MYSQL事务消息整合

1.基础理论知识篇“两阶段提交”如果你了解可以跳过这段,当然如果你想深入了解你可以购买相关书籍或去搜索相关资料阅读 两阶段提交分为 正常提交和异常提交或异常回滚 上面是正常提交的示意图,协调者发起预提 ...

- Ural 2062:Ambitious Experiment(树状数组 || 分块)

http://acm.timus.ru/problem.aspx?space=1&num=2062 题意:有n个数,有一个值,q个询问,有单点询问操作,也有对于区间[l,r]的每个数i,使得n ...

- java html中文汉字 反转义

import org.apache.commons.lang.StringEscapeUtils; public class EscapeHtml { /** * @param args */ pub ...

- Flink会话窗口测试

Flink会话窗口测试 一.测试结论: 1.会话窗口的间隔时间和水位线作用一样,表示输出现在时间 - 间隔时间之前所有未结算时间的数据,作用类似于水位线,但是和水位线开闭不一样. 2.会话窗口显示的数 ...

- Python C3 算法 手动计算顺序

Python C3 算法 手动计算顺序 手动计算类继承C3算法原则: 以所求类的直接子类的数目分成相应部分 按照从左往右的顺序依次写出继承关系 继承关系第一个第一位,在所有后面关系都是第一个出现的 ...

- 使用wincc C脚本查找窗口句柄的方法

关于窗口句柄的用法,网上可以搜到很多相关的文章,本文以windows API接口函数为例,简单介绍一下基本使用,主要包括找到此窗体,在找到的窗体写入数据,对窗体进行关闭,最大化,最小化的操作: 1.利 ...

- 分布式事务(4)---RocketMQ实现分布式事务项目

RocketMQ实现分布式事务 有关RocketMQ实现分布式事务前面写了一篇博客 1.RocketMQ实现分布式事务原理 下面就这个项目做个整体简单介绍,并在文字最下方附上项目Github地址. 一 ...

- MyBatis从入门到精通:select用法进一步讲解

selectAll:笔记 /* 定义接口方法的返回值的时候,必须注意查询SQL可能返回的结果数量.当 返回值最多只有一个结果的时候,可以将结果返回值定义为SysUser,此时 返回值类型为List&l ...

- CF510C Fox And Names——拓扑排序练习

省委代码: #include<cstdio> #include<cstdlib> #include<cstring> #include<cmath> # ...