week 5: ;Lasso regression & coordinate descent

笔记。

岭回归, 计算回归系数时使( RSS(w)+λ||w||2) 最小

岭回归的结果会是所有的特征的weight都较小,但大多数又不完全为零。

而实际情况中,有的特征的确与输出值相关程度很高,weight本就应该取一个较大的值,

而有的特征与输出结果几乎毫无关系,取一个很小的值不如直接取零。

岭回归的结果,一方面使“非常有用的”特征权值取不到一个较大的值,"有用"的特征无法很好表达,

另一方面又不能有效的筛掉“无用”的特征,很累赘。在特征很少时,这个缺陷可能没什么影响,但当

特征很多时,岭回归的缺陷较为明显。后续计算复杂度显著提高(很多非零的weight实际上很小)。

一个解决方法是在合理的范围里提高结果 (weights)的稀疏度(sparsity),尽量只留下“有用”的

特征的权值,其他相关度低的特征权值直接取零。这样后续计算只需要关注非零的权值,复杂度大大降低。

如何筛选出部分”有用“的特征?

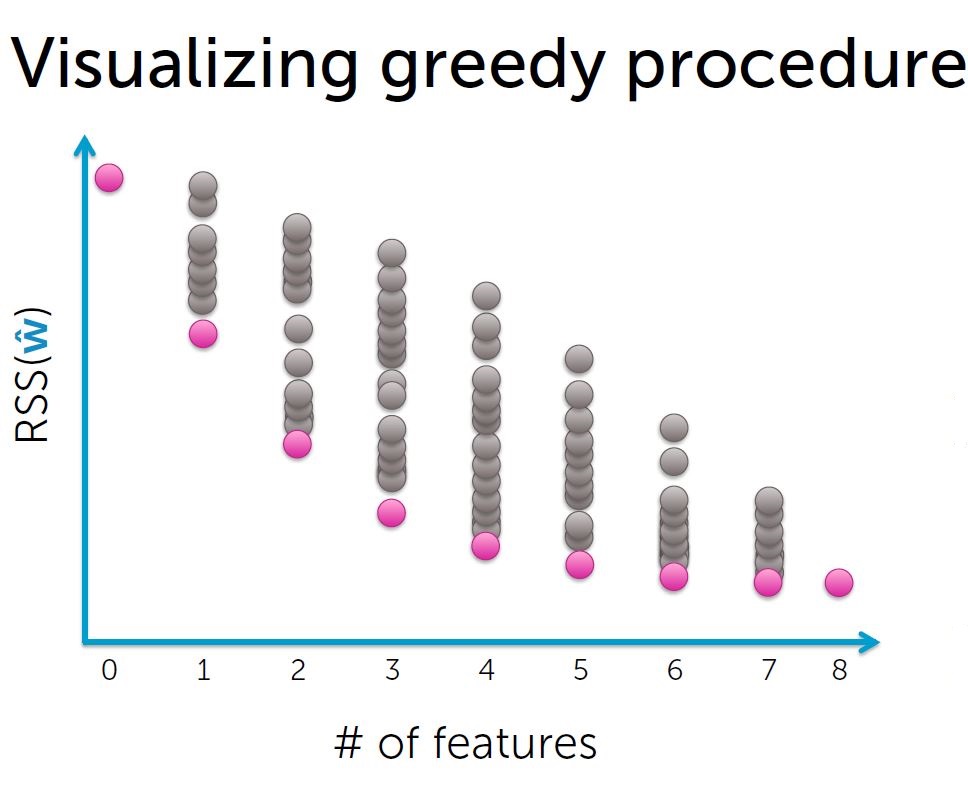

一个方法是使用贪婪算法。

过程:

1. 特征集合F初始为空集;

2.用特征集合F拟合模型,得到weights, 计算training error;

3.选择下一个最佳特征 f:

使用{F+f}作为特征集合可以使training error达到新低;

4. F <-- F+ f

5.递归

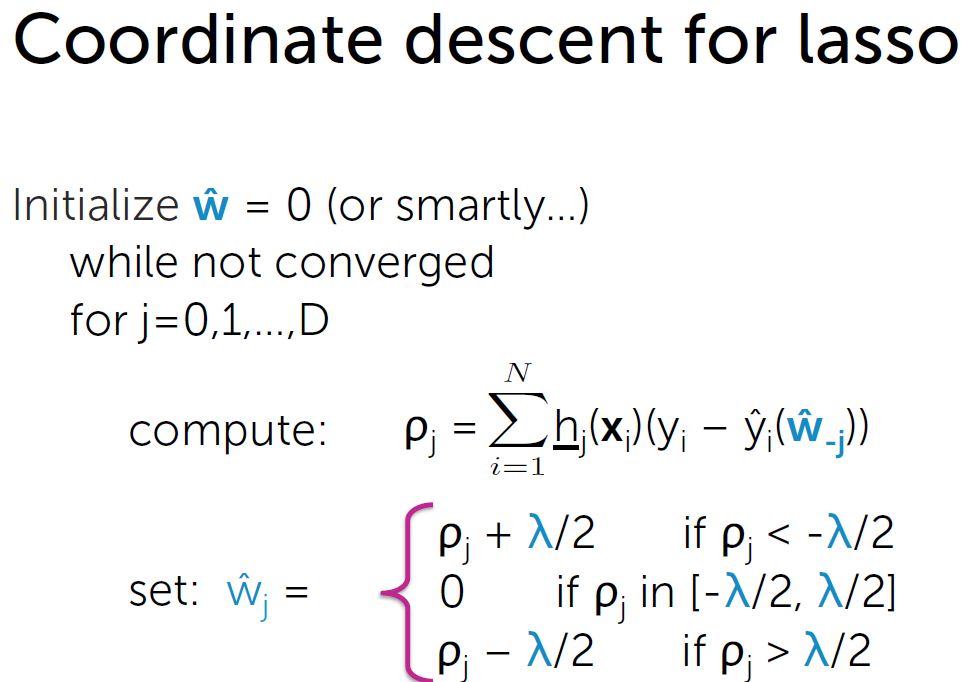

Lasso 回归: minimize (RSS(w)+λ||w||1)

||w||1为L1 范数,系数绝对值之和 |w|

|w|导数?

直接解方程 或 梯度下降 方法都不适用。

可以用subgradient 方法。

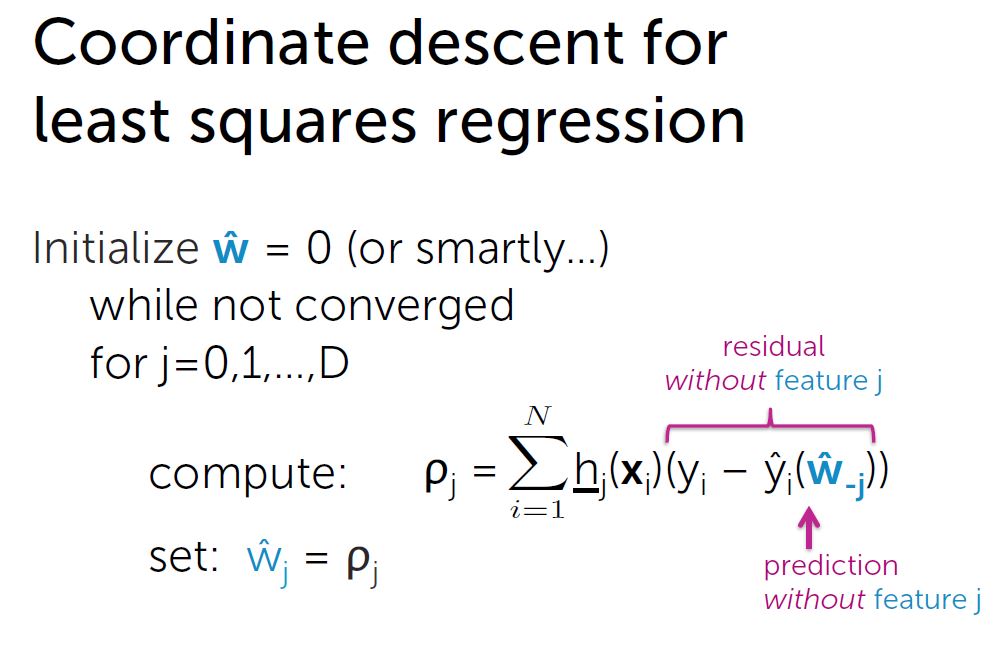

Coordinate descent:

用于解决一类最小值问题。适用于 直接求全局最小值很困难, 但单个坐标求最小值很容易 的函数。

求解过程:

1. 初始化

2. 循环,单个坐标一个个更新到最小值

3. 计算每一步的步长(步长应越来越小),当最大步长 < ε 停止,否则循环

def lasso_coordinate_descent_step(i, feature_matrix, output, weights, l1_penalty):

# compute prediction

prediction = predict_output(feature_matrix, weights)

# compute ro[i] = SUM[ [feature_i]*(output - prediction + weight[i]*[feature_i]) ]

ro_i = np.dot(feature_matrix[:,i],(output - prediction + weights[i]*feature_matrix[:,i])) if i == 0: # intercept -- do not regularize

new_weight_i = ro_i

elif ro_i < -l1_penalty/2.:

weight_i = ro_i + l1_penalty/2.

elif ro_i > l1_penalty/2.:

new_weight_i = ro_i - l1_penalty/2.

else:

new_weight_i = 0. return new_weight_i def lasso_cyclical_coordinate_descent(feature_matrix, output, weights, l1_penalty, tolerance): converged = False while converged == False:

coordinate = []

for i in xrange(len(weights)):

old_weights_i = weights[i] # remember old value of weight[i], as it will be overwritten

# the following line uses new values for weight[0], weight[1], ..., weight[i-1]

# and old values for weight[i], ..., weight[d-1]

weights[i] = lasso_coordinate_descent_step(i, feature_matrix, output, weights, l1_penalty) # use old_weights_i to compute change in coordinate

coordinate.append(abs(weights[i] - old_weights_i))

if max(coordinate) < tolerance:

converged = True return weights

week 5: ;Lasso regression & coordinate descent的更多相关文章

- 坐标下降法(coordinate descent method)求解LASSO的推导

坐标下降法(coordinate descent method)求解LASSO推导 LASSO在尖点是singular的,因此传统的梯度下降法.牛顿法等无法使用.常用的求解算法有最小角回归法.coor ...

- [Scikit-learn] 1.1 Generalized Linear Models - Lasso Regression

Ref: http://blog.csdn.net/daunxx/article/details/51596877 Ref: https://www.youtube.com/watch?v=ipb2M ...

- V-rep学习笔记:机器人逆运动学数值解法(Cyclic Coordinate Descent Method)

When performing inverse kinematics (IK) on a complicated bone chain, it can become too complex for a ...

- 吴恩达深度学习:2.9逻辑回归梯度下降法(Logistic Regression Gradient descent)

1.回顾logistic回归,下式中a是逻辑回归的输出,y是样本的真值标签值 . (1)现在写出该样本的偏导数流程图.假设这个样本只有两个特征x1和x2, 为了计算z,我们需要输入参数w1.w2和b还 ...

- 坐标下降(Coordinate descent)

坐标下降法属于一种非梯度优化的方法,它在每步迭代中沿一个坐标的方向进行线性搜索(线性搜索是不需要求导数的),通过循环使用不同的坐标方法来达到目标函数的局部极小值.

- Python机器学习——线性模型

http://www.dataguru.cn/portal.php?mod=view&aid=3514 摘要 : 最近断断续续地在接触一些python的东西.按照我的习惯,首先从应用层面搞起, ...

- Python大战机器学习——基础知识+前两章内容

一 矩阵求导 复杂矩阵问题求导方法:可以从小到大,从scalar到vector再到matrix. x is a column vector, A is a matrix d(A∗x)/dx=A d( ...

- Scikit Learn: 在python中机器学习

转自:http://my.oschina.net/u/175377/blog/84420#OSC_h2_23 Scikit Learn: 在python中机器学习 Warning 警告:有些没能理解的 ...

- [Example of Sklearn] - Example

reference : http://my.oschina.net/u/175377/blog/84420 目录[-] Scikit Learn: 在python中机器学习 载入示例数据 一个改变数据 ...

随机推荐

- [Python爬虫] 之二十六:Selenium +phantomjs 利用 pyquery抓取智能电视网站图片信息

一.介绍 本例子用Selenium +phantomjs爬取智能电视网站(http://www.tvhome.com/news/)的资讯信息,输入给定关键字抓取图片信息. 给定关键字:数字:融合:电视 ...

- Linux下SVN服务器搭建(CentOS+Subversion)--转

svn(subversion)是近年来崛起的版本管理工具,是CVS的接班人.目前,绝大多数开源软件都使用svn作为代码版本管理软件.svn 服务器有2种运行方式:独立服务器和借助apache等web服 ...

- Eclipse user library位置

原因: 转自:http://happycoolyp.iteye.com/blog/1853135 user libraries的记录文件%eclipse_workspace%\.metadata\.p ...

- HBase源代码分析之MemStore的flush发起时机、推断条件等详情(二)

在<HBase源代码分析之MemStore的flush发起时机.推断条件等详情>一文中,我们具体介绍了MemStore flush的发起时机.推断条件等详情.主要是两类操作.一是会引起Me ...

- Ubuntu git 安装、生成sshkey、克隆、切换分支

#1.安装git apt-get install git; #2生成公钥私钥文件 2.配置git账户: git config --global user.name "yourname&quo ...

- swift算法手记-10

http://blog.csdn.net/myhaspl private func findnode(val:Int)->Bool{//http://blog.csdn.net/myhaspl ...

- CentOS最常用命令

快捷键.常用命令: 文件和目录:# cd /home 进入 '/home' 目录# cd .. 返回上一级目录# cd ../.. 返回上两级目录# cd - 返回上次所在目录# cp file1 f ...

- jquery ui dialog 中使用select2 导致select2的input失去焦点的解决方法

在jqueryUI 的dialog中使用select2,select2的input search无论怎样都获取不到焦点? 解决方法: $(document).ready(function () { $ ...

- 门窗ERP——让门窗幕墙加工更简单

系统特点: 本系统包括:生产销售.采购.库存.财务模块 型材按重量算成本,玻璃按面积算成本 单据采用推送的方式推进单据流程,层层递进严格把握管理流程.保证数据的严密.严谨性. 销售订单支持门窗.幕墙. ...

- (二)Linux——Linux常用指令

1. 文件目录操作命令 ls 显示文件和目录列表 -l 列出文件的详细信息 -a 列出当前目录所有文件,包含隐藏文件 mkdir 创建目录 -p 父目录不存在情况下先生成父目录 cd 切换目录 ...