【翻译】Kinect v2程序设计(C++) Body 篇

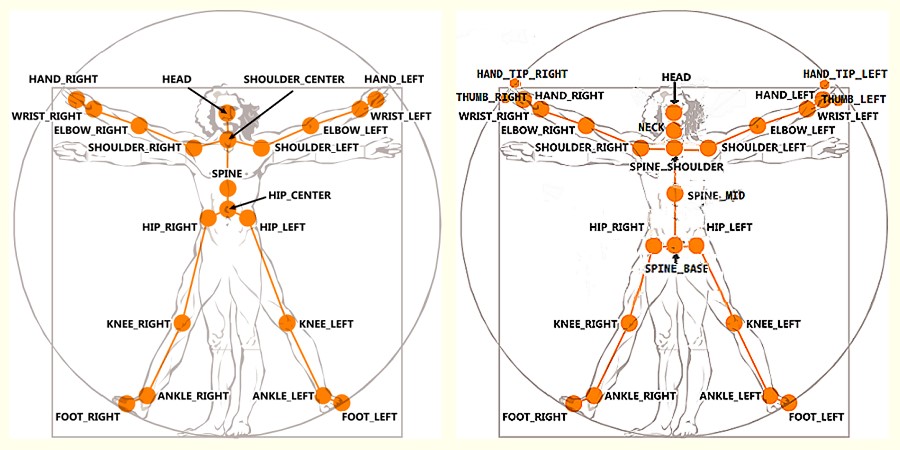

Kinect SDK v2预览版的主要功能的使用介绍,基本上完成了。这次,是关于取得Body(人体姿势)方法的说明。

Body

// Sensor

IKinectSensor* pSensor; ……

HRESULT hResult = S_OK;

hResult = GetDefaultKinectSensor( &pSensor ); ……

if( FAILED( hResult ) ){

std::cerr << "Error : GetDefaultKinectSensor" << std::endl;

return -;

}

hResult = pSensor->Open(); ……

if( FAILED( hResult ) ){

std::cerr << "Error : IKinectSensor::Open()" << std::endl;

return -;

}

// Source

IBodyFrameSource* pBodySource; ……

hResult = pSensor->get_BodyFrameSource( &pBodySource ); ……

if( FAILED( hResult ) ){

std::cerr << "Error : IKinectSensor::get_BodyFrameSource()" << std::endl;

return -;

}

// Reader

IBodyFrameReader* pBodyReader; ……

hResult = pBodySource->OpenReader( &pBodyReader ); ……

if( FAILED( hResult ) ){

std::cerr << "Error : IBodyFrameSource::OpenReader()" << std::endl;

return -;

}

// Coordinate Mapper

ICoordinateMapper* pCoordinateMapper; ……

hResult = pSensor->get_CoordinateMapper( &pCoordinateMapper ); ……

if( FAILED( hResult ) ){

std::cerr << "Error : IKinectSensor::get_CoordinateMapper()" << std::endl;

return -;

}

int width = ;

int height = ;

unsigned int bufferSize = width * height * * sizeof( unsigned char );

cv::Mat bufferMat( height, width, CV_8UC4 );

cv::Mat bodyMat( height / , width / , CV_8UC4 );

cv::namedWindow( "Body" );

// Color Table

cv::Vec3b color[];

color[] = cv::Vec3b( , , );

color[] = cv::Vec3b( , , );

color[] = cv::Vec3b( , , );

color[] = cv::Vec3b( , , );

color[] = cv::Vec3b( , , );

color[] = cv::Vec3b( , , );

while( ){

// Color Frame ……1

IColorFrame* pColorFrame = nullptr;

hResult = pColorReader->AcquireLatestFrame( &pColorFrame );

if( SUCCEEDED( hResult ) ){

hResult = pColorFrame->CopyConvertedFrameDataToArray( bufferSize, reinterpret_cast<BYTE*>( bufferMat.data ), ColorImageFormat_Bgra );

if( SUCCEEDED( hResult ) ){

cv::resize( bufferMat, bodyMat, cv::Size(), 0.5, 0.5 );

}

}

SafeRelease( pColorFrame );

/* Body部分在列表1.6 */

// Show Window

cv::imshow( "Body", bodyMat );

if( cv::waitKey( ) == VK_ESCAPE ){

break;

}

}

列表1.5,相当于图1「Frame」,「Data」的部分(第1部分)

// Body Frame

IBodyFrame* pBodyFrame = nullptr; ……

hResult = pBodyReader->AcquireLatestFrame( &pBodyFrame ); ……

if( SUCCEEDED( hResult ) ){

IBody* pBody[BODY_COUNT] = { }; ……

hResult = pBodyFrame->GetAndRefreshBodyData( BODY_COUNT, pBody ); ……

if( SUCCEEDED( hResult ) ){

for( int count = ; count < BODY_COUNT; count++ ){

BOOLEAN bTracked = false; ……

hResult = pBody[count]->get_IsTracked( &bTracked ); ……

if( SUCCEEDED( hResult ) && bTracked ){

Joint joint[JointType::JointType_Count]; ……

hResult = pBody[count]->GetJoints( JointType::JointType_Count, joint ); ……

if( SUCCEEDED( hResult ) ){

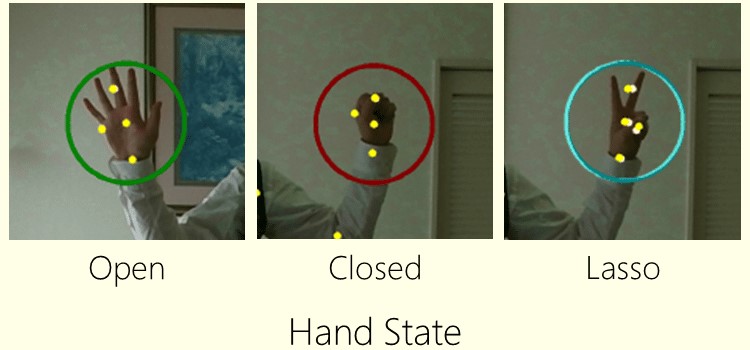

// Left Hand State

HandState leftHandState = HandState::HandState_Unknown; ……

hResult = pBody[count]->get_HandLeftState( &leftHandState ); ……

if( SUCCEEDED( hResult ) ){

ColorSpacePoint colorSpacePoint = { }; ……

hResult = pCoordinateMapper->MapCameraPointToColorSpace( joint[JointType::JointType_HandLeft].Position, &colorSpacePoint ); ……

if( SUCCEEDED( hResult ) ){

int x = static_cast<int>( colorSpacePoint.X );

int y = static_cast<int>( colorSpacePoint.Y );

if( ( x >= ) && ( x < width ) && ( y >= ) && ( y < height ) ){

if( leftHandState == HandState::HandState_Open ){ ……

cv::circle( bufferMat, cv::Point( x, y ), , cv::Scalar( , , ), , CV_AA );

}

else if( leftHandState == HandState::HandState_Closed ){ ……

cv::circle( bufferMat, cv::Point( x, y ), , cv::Scalar( , , ), , CV_AA );

}

else if( leftHandState == HandState::HandState_Lasso ){ ……

cv::circle( bufferMat, cv::Point( x, y ), , cv::Scalar( , , ), , CV_AA );

}

}

}

}

// Right Hand State

/* 和左手一样,获取右手Hand State绘制状态。 */

// Joint ……9

for( int type = ; type < JointType::JointType_Count; type++ ){

ColorSpacePoint colorSpacePoint = { };

pCoordinateMapper->MapCameraPointToColorSpace( joint[type].Position, &colorSpacePoint );

int x = static_cast< int >( colorSpacePoint.X );

int y = static_cast< int >( colorSpacePoint.Y );

if( ( x >= ) && ( x < width ) && ( y >= ) && ( y < height ) ){

cv::circle( bufferMat, cv::Point( x, y ), , static_cast<cv::Scalar>( color[count] ), -, CV_AA );

}

}

}

}

}

cv::resize( bufferMat, bodyMat, cv::Size(), 0.5, 0.5 );

}

}

SafeRelease( pBodyFrame );

| Kinect SDK v1 | Kinect SDK v2预览版 | |

|---|---|---|

| 名称 | Skeleton | Body |

| 人体姿勢可以取得的人数 | 2人 | 6人 |

| Joint(关节) | 20处 | 25处 |

| Hand State(手的状態) | 2種類 | 3種類 |

| Hand State可以取得的人数 | 2人 | 2人 |

图4 Hand State的识别结果

【翻译】Kinect v2程序设计(C++) Body 篇的更多相关文章

- 【翻译】Kinect v2程序设计(C++-) AudioBeam篇

Kinect v2,Microphone Array可以用来对于水平面音源方向的推测(AudioBeam)和语音识别(Speech Recognition).这一节是介绍如何取得AudioBeam. ...

- 【翻译】Kinect v2程序设计(C++) BodyIndex篇

通过Kinect SDK v2预览版,取得BodyIndex(人体区域)的方法和示例代码. 上一节,介绍了从Kinect v2预览版用Kinect SDK v2预览版获取Depth数据的方法. 这 ...

- 【翻译】Kinect v2程序设计(C++) Color篇

Kinect SDK v2预览版,获取数据的基本流程的说明.以及取得Color图像的示例程序的介绍. 上一节,是关于当前型号Kinect for Windows(后面称作Kinect v1)和次世代型 ...

- 【翻译】Kinect v2程序设计(C++) Depth编

Kinect SDK v2预览版,取得Depth数据的方法说明. 上一节,介绍了通过使用Kinect for Windows SDK v2预览版(以下简称为,Kinect SDK v2预览版)从Kin ...

- 【翻译】Kinect v1和Kinect v2的彻底比较

本连载主要是比较Kinect for Windows的现行版(v1)和次世代型的开发者预览版(v2),以C++开发者为背景介绍进化的硬件和软件.本文主要是对传感的配置和运行条件进行彻底的比较. ...

- 【计算机视觉】深度相机(五)--Kinect v2.0

原文:http://blog.csdn.NET/qq1175421841/article/details/50412994 ----微软Build2012大会:Kinect for Windows P ...

- Kinect v2.0 for windows开发环境说明

官方文档里是这些: Supported Operating Systems and Architectures The following operating systems and architec ...

- Kinect v2(Microsoft Kinect for Windows v2 )配置移动电源解决方案

Kinect v2配置移动电源解决方案 Kinect v2如果用于移动机器人上(也可以是其他应用场景),为方便有效地展开后续工作,为其配置移动电源是十分必要的. 一.选择移动电源 Kinect v2原 ...

- Ubuntu_ROS中应用kinect v2笔记

Ubuntu_ROS中应用kinect v2笔记 个人觉得最重要的资料如下: 1. Microsoft Kinect v2 Driver Released http://www.ros.org/new ...

随机推荐

- php编译报错 configure: error: Please reinstall the libcurl distribution - easy.h should be in <curl-dir>/include/curl/

➜ php- yum install -y curl-devel

- .NET的堆和栈01,基本概念、值类型内存分配

当我们对.NET Framework的一些基本面了解之后,实际上,还是很有必要了解一些更底层的知识.比如.NET Framework是如何进行内存管理的,是如何垃圾回收的......这样,我们才能写出 ...

- java基础知识回顾之java Thread类学习(十一)--join方法的理解

以下面例子说明下面的源码:main 线程 和 A线程,A线程是main线程创建并且启动的,main线程优先级比较高,正在执行:这个时候main线程调用A.join()之后,main线程一直等待,直到A ...

- 企业级项目中最常用到的SQL

用SQL语句添加删除修改字段 1.增加字段 alter table docdsp add dspcode char(200) 例如: 表gwamis.d410Sctzmx添加字段f410 ...

- Sonar相关资料

Sonar介绍及安装:http://www.cnblogs.com/suncoolcat/p/3323200.html Sonar安装: http://www.myexception.cn/open- ...

- 在visual studio 2010中调用ffmpeg

转自:http://blog.sina.com.cn/s/blog_4178f4bf01018wqh.html 最近几天一直在折腾ffmpeg,在网上也查了许多资料,费了不少劲,现在在这里和大家分享一 ...

- Bitset 用法(STL)

std::bitset是STL的一个模板类,它的参数是整形的数值,使用位的方式和数组区别不大,相当于只能存一个位的数组.下面看一个例子 bitset<20> b1(5); cout< ...

- Mosquitto关于Connection lost的问题。

文章发自:http://www.cnblogs.com/hark0623/p/4175048.html 转发请注明 如果当你的客户端订阅(sub)mqtt时,发现出现Connection lost ...

- java 输入输出流1 FileInputStrem&&FileOutStream

通过文件输入流读取问价 package unit6; import java.io.FileInputStream; import java.io.FileNotFoundException; imp ...

- PHP API 框架开发的学习

基于互联网的应用正变得越来越普及,在这个过程中,有更多的站点将自身的资源开放给开发者来调用.对外提供的API 调用使得站点之间的内容关联性更强,同时这些开放的平台也为用户.开发者和中小网站带来了更大的 ...