Trident继承kafka

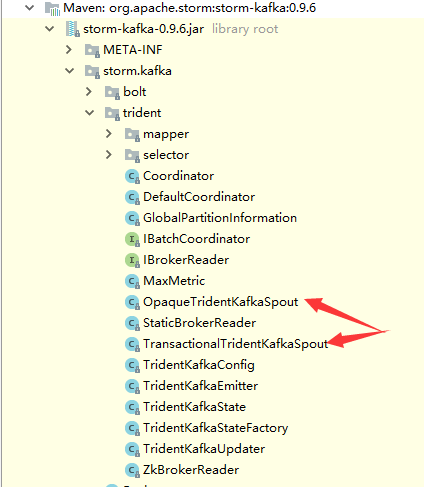

1.Kafka涉及的类

上一个类是不透明事务

后一个是完全事务

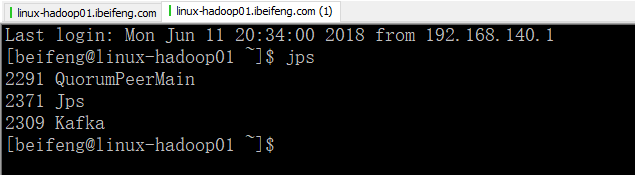

2.启动服务

3..驱动类

重要的地方是修改了两个部分:

1.数据的来源是kafka

2.第二个是字段的Fields是str

package com.jun.tridentWithKafka; import backtype.storm.Config;

import backtype.storm.LocalCluster;

import backtype.storm.StormSubmitter;

import backtype.storm.generated.AlreadyAliveException;

import backtype.storm.generated.InvalidTopologyException;

import backtype.storm.spout.SchemeAsMultiScheme;

import backtype.storm.tuple.Fields;

import backtype.storm.tuple.Values;

import storm.kafka.BrokerHosts;

import storm.kafka.StringScheme;

import storm.kafka.ZkHosts;

import storm.kafka.trident.OpaqueTridentKafkaSpout;

import storm.kafka.trident.TridentKafkaConfig;

import storm.trident.Stream;

import storm.trident.TridentState;

import storm.trident.TridentTopology;

import storm.trident.operation.builtin.Count;

import storm.trident.operation.builtin.Sum;

import storm.trident.testing.FixedBatchSpout;

import storm.trident.testing.MemoryMapState; public class TridentWithKafka {

public static void main(String[] args) throws AlreadyAliveException, InvalidTopologyException {

TridentTopology tridentTopology=new TridentTopology();

//使用Kafka中的数据

BrokerHosts hosts = new ZkHosts("linux-hadoop01.ibeifeng.com:2181");

String topic = "nginxlog";

TridentKafkaConfig conf = new TridentKafkaConfig(hosts, topic); conf.scheme = new SchemeAsMultiScheme(new StringScheme());

conf.forceFromStart = true; OpaqueTridentKafkaSpout spout = new OpaqueTridentKafkaSpout(conf); //流处理

Stream stream=tridentTopology.newStream("orderAnalyse",spout)

//过滤

.each(new Fields("str"),new ValidLogFilter())

//解析

.each(new Fields("str"), new LogParserFunction(),new Fields("orderId","orderTime","orderAmtStr","memberId"))

//投影

.project(new Fields("orderId","orderTime","orderAmtStr","memberId"))

//时间解析

.each(new Fields("orderTime"),new DateTransFormerFunction(),new Fields("day","hour","minter"))

;

//分流

//1.基于minter统计订单数量,分组统计

TridentState state=stream.groupBy(new Fields("minter"))

//全局聚合,使用内存存储状态信息

.persistentAggregate(new MemoryMapState.Factory(),new Count(),new Fields("orderNumByMinter"));

// state.newValuesStream().each(new Fields("minter","orderNumByMinter"),new PrintFilter()); //2.另一个流,基于分钟的订单金额,局部聚合

Stream partitionStream=stream.each(new Fields("orderAmtStr"),new TransforAmtToDoubleFunction(),new Fields("orderAmt"))

.groupBy(new Fields("minter"))

//局部聚合

.chainedAgg() //聚合链

.partitionAggregate(new Fields("orderAmt"),new LocalSum(),new Fields("orderAmtSumOfLocal"))

.chainEnd(); //聚合链

// partitionStream.each(new Fields("minter","orderAmtSumOfLocal"),new PrintFilter());

//做一次全局聚合

TridentState partitionState=partitionStream.groupBy(new Fields("minter"))

//全局聚合

.persistentAggregate(new MemoryMapState.Factory(),new Fields("orderAmtSumOfLocal"),new Sum(),new Fields("totalOrderAmt"));

partitionState.newValuesStream().each(new Fields("minter","totalOrderAmt"),new PrintFilter()); //提交

Config config=new Config();

if(args==null || args.length<=0){

LocalCluster localCluster=new LocalCluster();

localCluster.submitTopology("tridentDemo",config,tridentTopology.build());

}else {

config.setNumWorkers(2);

StormSubmitter.submitTopology(args[0],config,tridentTopology.build());

}

}

}

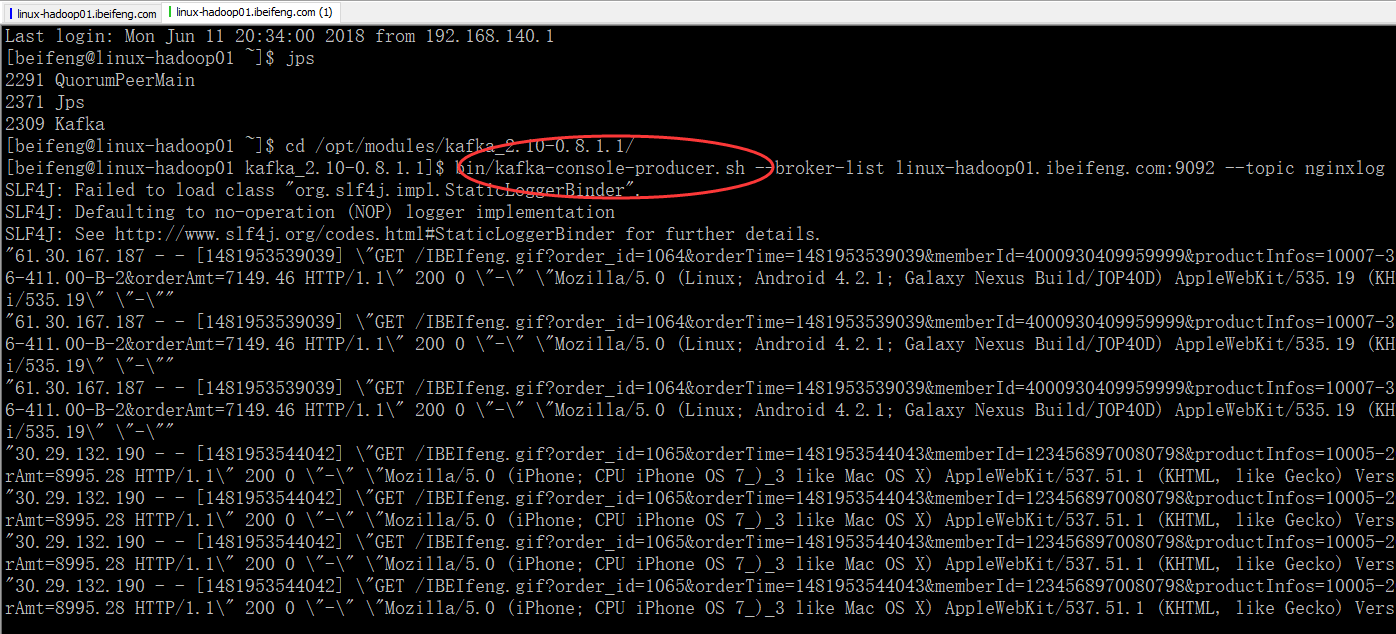

4.输入数据

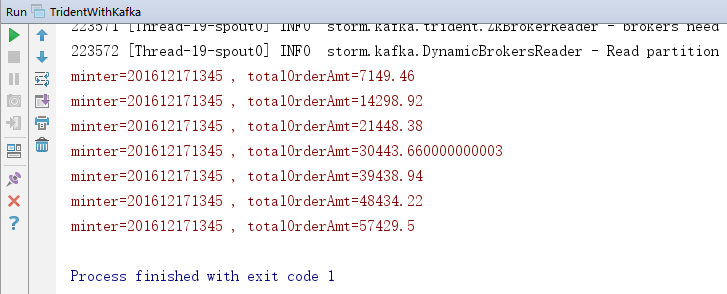

5.控制台

Trident继承kafka的更多相关文章

- Trident整合Kafka

首先编写一个打印函数KafkaPrintFunction import org.apache.storm.trident.operation.BaseFunction; import org.apac ...

- Java操作Kafka执行不成功的解决方法,Kafka Broker Advertised.Listeners属性的设置

创建Spring Boot项目继承Kafka,向Kafka发送消息始终不成功.具体项目配置如下: <?xml version="1.0" encoding="UTF ...

- storm-kafka教程

一.原理介绍 本文内容参考:https://github.com/apache/storm/tree/master/external/storm-kafka#brokerhosts (一)使用st ...

- storm-kafka编程指南

目录 storm-kafka编程指南 一.原理及关键步骤介绍 (一)使用storm-kafka的关键步骤 1.创建ZkHosts 2.创建KafkaConfig 3.设置MultiScheme 4.创 ...

- Apache Storm

作者:jiangzz 电话:15652034180 微信:jiangzz_wx 微信公众账号:jiangzz_wy 背景介绍 流计算:将大规模流动数据在不断变化的运动过程中实现数据的实时分析,捕捉到可 ...

- 认识Linux文件系统的架构

本文主要研究一下storm的OpaquePartitionedTridentSpoutExecutor TridentTopology.newStream storm-core-1.2.2-sourc ...

- Storm集成Kafka的Trident实现

原本打算将storm直接与flume直连,发现相应组件支持比较弱,topology任务对应的supervisor也不一定在哪个节点上,只能采用统一的分布式消息服务Kafka. 原本打算将结构设 ...

- 学好Spark/Kafka必须要掌握的Scala技术点(二)类、单例/伴生对象、继承和trait,模式匹配、样例类(case class)

3. 类.对象.继承和trait 3.1 类 3.1.1 类的定义 Scala中,可以在类中定义类.以在函数中定义函数.可以在类中定义object:可以在函数中定义类,类成员的缺省访问级别是:publ ...

- Flume+Kafka+Storm+Redis 大数据在线实时分析

1.实时处理框架 即从上面的架构中我们可以看出,其由下面的几部分构成: Flume集群 Kafka集群 Storm集群 从构建实时处理系统的角度出发,我们需要做的是,如何让数据在各个不同的集群系统之间 ...

随机推荐

- maven项目部署到Tomcat

1.安装Tomcat,地址:http://tomcat.apache.org,我安装的版本为9.0.0.M22,安装的目录为C:\apache-tomcat,设置环境变量CATALINA_HOME为C ...

- @ModelAttribute设置request、response、session对象

利用spring web提供的@ModelAttribute注解 放在类方法的参数前面表示引用Model中的数据 @ModelAttribute放在类方法上面则表示该Action类中的每个请求调用之前 ...

- HTML5 WebSocket 协议

1. 概述 1.1 说明 WebSocket:是HTML5开始提供的一种在单个TCP连接上进行全双工通讯的协议. WebSocket原理是使用JavaScript调用浏览器的API发出一个WebSoc ...

- linux指定只显示(只打印)文件中的某几行(中间几行)

[一]从第3000行开始,显示1000行.即显示3000~3999行 cat filename | tail -n +3000 | head -n 1000 [二]显示1000行到3000行 cat ...

- Java对象之间的深度复制拷贝

/* * Copyright (c) 1995, 2011, Oracle and/or its affiliates. All rights reserved. * ORACLE PROPRIETA ...

- Confluence 6 在初始化配置时候的问题

提交一个 服务器请求(support request) 然后在你的服务请求中同时提供下面的信息. 下载一个 LDAP 浏览器,你可以通过这个确定你的 LDAP 服务器配置正确.Atlassian 推荐 ...

- dubbo源码之服务发布与注册

服务端发布流程: dubbo 是基于 spring 配置来实现服务的发布的,对于dubbo 配置文件中看到的<dubbo:service>等标签都是服务发布的重要配置 ,对于这些提供可配置 ...

- 从xtrabackup备份恢复单表

目前对MySQL比较流行的备份方式有两种,一种上是使用自带的mysqldump,另一种是xtrabackup,对于数据时大的环境,普遍使用了xtrabackup+binlog进行全量或者增量备份,那么 ...

- 即时通讯协议之XMPP

目前IM即时通信有四种协议 1.即时信息和空间协议(IMPP) 2.空间和即时信息协议(PRIM) 3.针对即时通讯和空间平衡扩充的进程开始协议SIP 4.XMPP协议: 该协议的前身是Jabber, ...

- SpringBoot整合Kafka

一.准备工作 提前启动zk,kafka,并且创建一个Topic("Hello-Kafk") bin/kafka-topics.sh --create --zookeeper 192 ...