requests+多进程poll+pymongo实现抓取小说

今天看着有个很吸引人的小说作品信息:一家只在深夜开门营业的书屋,欢迎您的光临。

作为东野奎吾《深夜食堂》漫画的fans,看到这个标题按捺不住我的好奇心........

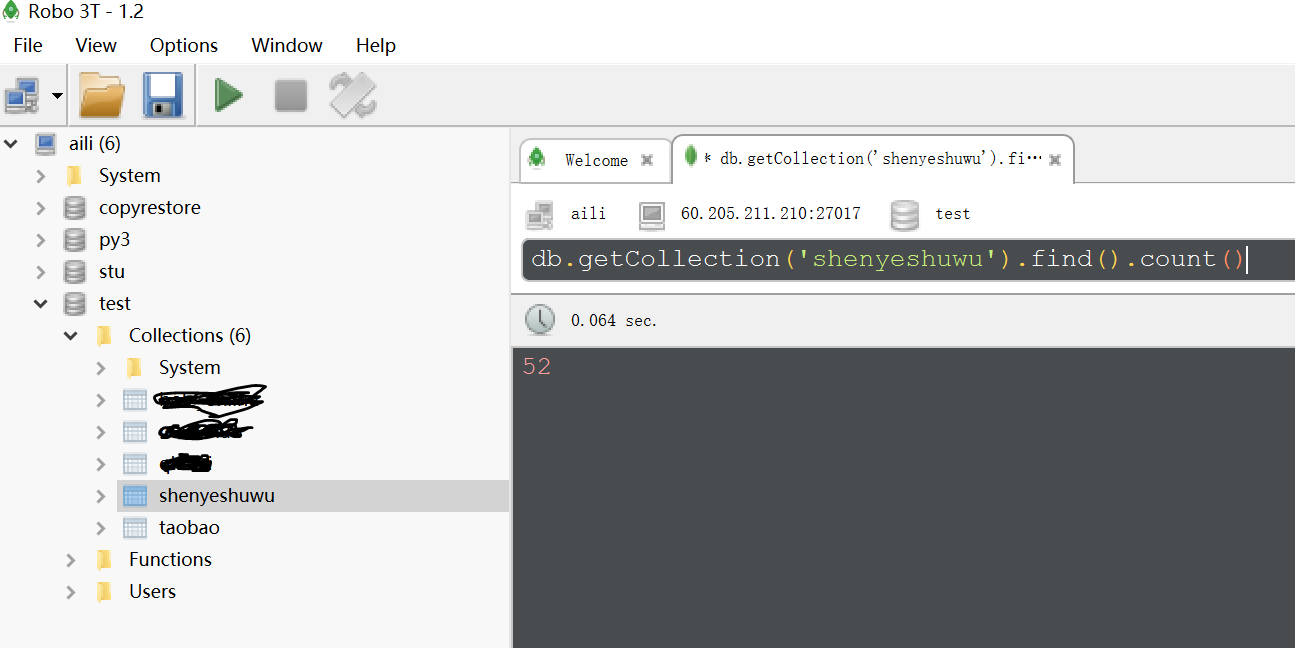

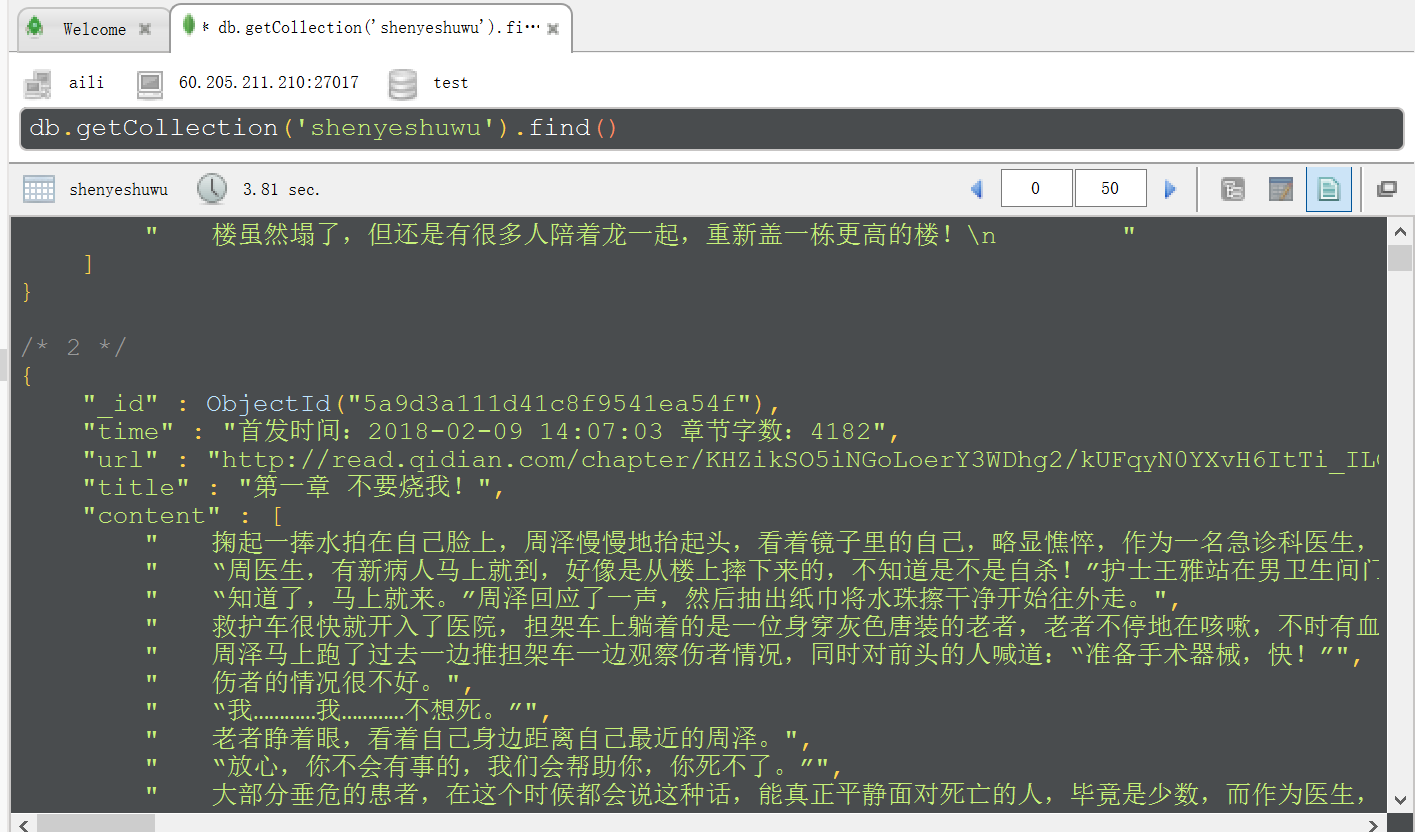

所以我又抓下来了,总共52章,下面有源码,写的有点乱哦,凑合看看,关键看结果,@~@。。。。

代码写完,几秒钟就抓取下来,比下载效率高不少,小激动~~~~~~

readme>>>环境python2,我的python2还有多长寿命;其他內库依赖见代码体现

# coding:utf-8 from multiprocessing import Pool

from lxml import etree

import requests

import pymongo def save_mongo(data):

client = pymongo.MongoClient('60.205.211.210',27017)

db = client.test

collection = db.shenyeshuwu

collection.insert(dict(data))

print('--------%s---------存储完毕' %data['title']) def parse_content(url):

resp = requests.get(url).content

html = etree.HTML(resp)

contents = html.xpath('//*[@id="j_chapterBox"]/div[2]/div/div[2]/p/text()|//*[@id="j_chapterBox"]/div[1]/div/div[2]/p/text()')

return contents def parse_html(html):

'''

[{

'title':title,

'url':url,

'content':content

}]

'''

page = etree.HTML(html)

article_url_list = page.xpath('//ul[@class="cf"]/li/a')

for i in article_url_list:

url = 'http:' + i.xpath('./@href')[0]

# print(url)

title = i.xpath('./text()')[0]

# print(title)

time = i.xpath('./@title')[0]

# print(time)

con = parse_content(url)

# print(con)

data = {

'url': url,

'title': title,

'time': time,

'content': con

}

print(data)

save_mongo(data) def get_page(url):

header = {

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/64.0.3282.186 Safari/537.36'

}

resp = requests.get(url,headers=header).content

parse_html(resp) def main():

url = 'https://book.qidian.com/info/1011335417#Catalog'

# get_page(url)

# 使用进程池 map(func,iterable)

pool = Pool(4)

# pool.map(parse_content,data)

pool.apply_async(get_page,args=(url,))

pool.close()

pool.join() if __name__ == '__main__':

main()

如往常,把截图展示下:

requests+多进程poll+pymongo实现抓取小说的更多相关文章

- C# 爬虫 抓取小说

心血来潮,想研究下爬虫,爬点小说. 通过百度选择了个小说网站,随便找了一本小书http://www.23us.so/files/article/html/13/13655/index.html. 1. ...

- C# 爬虫 正则、NSoup、HtmlAgilityPack、Jumony四种方式抓取小说

心血来潮,想爬点小说.通过百度选择了个小说网站,随便找了一本小说http://www.23us.so/files/article/html/13/13655/index.html. 1.分析html规 ...

- Python抓取小说

Python抓取小说 前言 这个脚本命令MAC在抓取小说写,使用Python它有几个码. 代码 # coding=utf-8 import re import urllib2 import chard ...

- scrapy抓取小说

用scrapy建立一个project,名字为Spider scrapy startproject Spider 因为之前一直用的是电脑自带的python版本,所以在安装scrapy时,有很多问题,也没 ...

- python requests 模拟登陆网站,抓取数据

抓取页面数据的时候,有时候我们需要登陆才可以获取页面资源,那么我们需要登陆以后才可以跳转到对应的资源页面,那么我们需要通过模拟登陆,登陆成功以后再次去抓取对应的数据. 首先我们需要通过手动方式来登陆一 ...

- python爬虫之抓取小说(逆天邪神)

2022-03-06 23:05:11 申明:自我娱乐,对自我学习过程的总结. 正文: 环境: 系统:win10, python版本:python3.10.2, 工具:pycharm. 项目目标: 实 ...

- Python 爬虫-抓取小说《盗墓笔记-怒海潜沙》

最近想看盗墓笔记,看了一下网页代码,竟然不是js防爬虫,那就用简单的代码爬下了一节: """ 爬取盗墓笔记小说-七星鲁王宫 """ from ...

- Python 爬虫-抓取小说《鬼吹灯之精绝古城》

想看小说<鬼吹灯之精绝古城>,可是网页版的好多广告,还要一页一页的翻,还无法复制,于是写了个小爬虫,保存到word里慢慢看. 代码如下: """ 爬取< ...

- jsoup使用样式class抓取数据时空格的处理

最近在研究用android和jsoup抓取小说数据,jsoup的使用可以参照http://www.open-open.com/jsoup/;在抓纵横中文网永生这本书的目录内容时碰到了问题, 永生的书简 ...

随机推荐

- node 在控制台打印有色彩的输出

在学习 node 过程中,因为没有找到有断点的调试方法,只能退而次之,在控制台打印调试. 但整个控制台的输出都是一种颜色,有时候很难找到自己需要的信息,这时,有颜色的打印就会帮上很大的忙. conso ...

- TP手册学习第二天

默认情况下,URL是不区分大小写的,访问规则:--模块/控制器/操作/参数/值,如果要访问驼峰法的控制器类BlogTest,则需要使用:blog_test MVC是一个设计模式,它强制性的使应用程序的 ...

- awk匹配某一段内容,打印第一段

要求: awk 文本在文本中搜索abc搜到后再从搜到的那一行开始一直输出后面的行,直到某一行含有bcd就停止 测试文本: [root@localhost]# cat awktest sadfj sdj ...

- Haproxy+Keepalived负载均衡

Haproxy介绍 HAProxy是一个特别适用于高可用性环境的TCP/HTTP开源的反向代理和负载均衡软件.在7层负载均衡方面的功能很强大(支持cookie track, header rewrit ...

- 前端-css

页面css排版不错乱: 1.最外层div中 定义width=980px,当页面缩小以后,就在下面出现滚动条 2.使用 media 技术,bootstrp技术.页面自使用 一.css选择器 选择器 样式 ...

- python小白之路

阅读目录: 第一章:计算机基础 计算机硬件.操作系统.网络协议 第二章:python基础 初识python.常量变量.输入输出运算符.条件与循环语句.数字与字符串.列表与字典.元组与集合.阶段小测.字 ...

- 使用xUnit为.net core程序进行单元测试(3)

第1部分: http://www.cnblogs.com/cgzl/p/8283610.html 第2部分: http://www.cnblogs.com/cgzl/p/8287588.html 请使 ...

- Codeforces 250 E. The Child and Binary Tree [多项式开根 生成函数]

CF Round250 E. The Child and Binary Tree 题意:n种权值集合C, 求点权值和为1...m的二叉树的个数, 形态不同的二叉树不同. 也就是说:不带标号,孩子有序 ...

- Java流机制学习

基本概念 BaseStream 基础流是一个可行并行或者串行的汇聚操作的元素序列.可以进行顺序遍历,也可以进行并发遍历.通过它也可以得到一个并行流或者串行流. Stream 是Java中流的表现接口, ...

- Windows下快速建立cocos2d-x项目

准备工作 1.根据当前系统版本,下载对应版本的Python 32位下载地址:http://www.python.org/ftp/python/2.7.5/python-2.7. ...