mnist全连接层网络权值可视化

一、数据准备

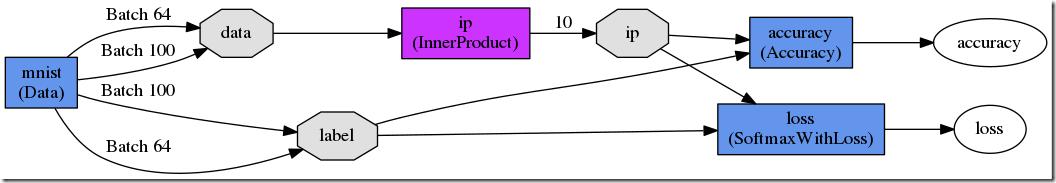

网络结构:lenet_lr.prototxt

训练好的模型:lenet_lr_iter_10000.caffemodel

下载地址:链接:https://pan.baidu.com/s/1uBDTKapT1yFHX4TEMaxQvQ 密码:2mla

二、利用pycaffe可视化,只需根据prototxt文件即可得到

~/caffe/caffe/examples/mnist$ python /home/tingpan/caffe/caffe/python/draw_net.py lenet_lr.prototxt lenet_lr.png

三、matlab权值可视化

1、切换至caffe目录下,在matlab目录中新建mnist_lr_weights_vis.m

clear;

clc;

close all;

addpath('matlab')

caffe.set_mode_cpu();

caffe.version()

net = caffe.Net('examples/mnist/lenet_lr.prototxt' , ...

'examples/mnist/lenet_lr_iter_10000.caffemodel', 'test');

net.layer_names

net.blob_names

ip_layer = net.layer_vec();

weight_blob = ip_layer.params();

w = weight_blob.get_data();

size(w) %784x10

bias_blob = ip_layer.params();

b = bias_blob.get_data();

size(b) %10x1 w = w - min(min(w));

w = w/(max(max(w)))*;

w = uint8(w);

figure; imshow(w);

imwrite(w, './matlab/ip_weight.bmp');

sprintf('finish')

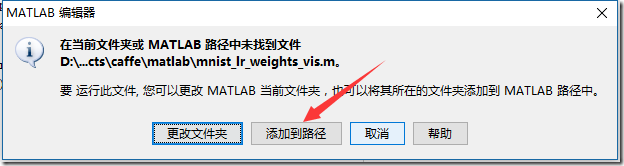

2、点击运行

点击添加到路径。

3、输出:

ans =

1.0.

ans =

× cell 数组

'mnist'

'label_mnist_1_split'

'ip'

'ip_ip_0_split'

'accuracy'

'loss'

ans =

× cell 数组

'data'

'label'

'label_mnist_1_split_0'

'label_mnist_1_split_1'

'ip'

'ip_ip_0_split_0'

'ip_ip_0_split_1'

'accuracy'

'loss'

ans =

ans =

ans =

finish

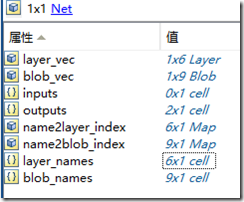

4、分析

net内容为

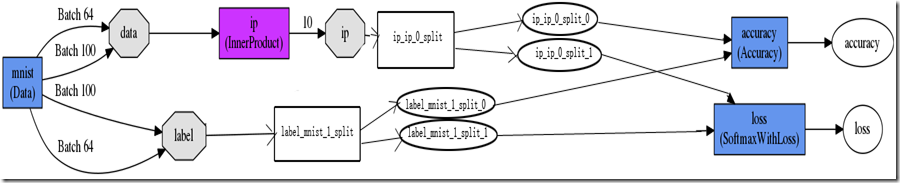

可得matlab可视化得到的网络模型是

从图中可输出layer有6层(6个矩形),blob有9个(9个椭圆形或多边形);

其中,InnerProduct(内积层,也即全连接层),存有权重信息。该权重尺寸为784x10,可推出blob的data的size为100x784,blob中的ip的size为100x10;

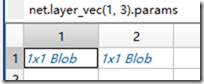

net.layer_vec中只有ip层的params不为空

其中第一个blob的size为748x10,为权重;第二个blob的size为10x1,为偏置参数。

得到的权值图片为:caffe/matlab/ip_weight.bmp

end

mnist全连接层网络权值可视化的更多相关文章

- bvlc_reference_caffenet网络权值可视化

一.网络结构 models/bvlc_reference_caffenet/deploy.prototxt 二.显示conv1的网络权值 clear; clc; close all; addpath( ...

- 深度学习原理与框架-卷积网络细节-图像分类与图像位置回归任务 1.模型加载 2.串接新的全连接层 3.使用SGD梯度对参数更新 4.模型结果测试 5.各个模型效果对比

对于图像的目标检测任务:通常分为目标的类别检测和目标的位置检测 目标的类别检测使用的指标:准确率, 预测的结果是类别值,即cat 目标的位置检测使用的指标:欧式距离,预测的结果是(x, y, w, h ...

- caffe之(四)全连接层

在caffe中,网络的结构由prototxt文件中给出,由一些列的Layer(层)组成,常用的层如:数据加载层.卷积操作层.pooling层.非线性变换层.内积运算层.归一化层.损失计算层等:本篇主要 ...

- 全连接层(FC)与全局平均池化层(GAP)

在卷积神经网络的最后,往往会出现一两层全连接层,全连接一般会把卷积输出的二维特征图转化成一维的一个向量,全连接层的每一个节点都与上一层每个节点连接,是把前一层的输出特征都综合起来,所以该层的权值参数是 ...

- fc全连接层的作用、卷积层的作用、pooling层、激活函数的作用

fc:1.起到分类器的作用.对前层的特征进行一个加权和,(卷积层是将数据输入映射到隐层特征空间)将特征空间通过线性变换映射到样本标记空间(也就是label) 2.1*1卷积等价于fc:跟原featur ...

- CNN学习笔记:全连接层

CNN学习笔记:全连接层 全连接层 全连接层在整个网络卷积神经网络中起到“分类器”的作用.如果说卷积层.池化层和激活函数等操作是将原始数据映射到隐层特征空间的话,全连接层则起到将学到的特征表示映射到样 ...

- 深度学习Keras框架笔记之Dense类(标准的一维全连接层)

深度学习Keras框架笔记之Dense类(标准的一维全连接层) 例: keras.layers.core.Dense(output_dim,init='glorot_uniform', activat ...

- PyTorch全连接ReLU网络

PyTorch全连接ReLU网络 1.PyTorch的核心是两个主要特征: 一个n维张量,类似于numpy,但可以在GPU上运行 搭建和训练神经网络时的自动微分/求导机制 本文将使用全连接的ReLU网 ...

- resnet18全连接层改成卷积层

想要尝试一下将resnet18最后一层的全连接层改成卷积层看会不会对网络效果和网络大小有什么影响 1.首先先对train.py中的更改是: train.py代码可见:pytorch实现性别检测 # m ...

随机推荐

- ATDD

什么是ATDD 首先,ATDD不是一种测试方法论,而是一种开发方法论. UTDD涉及的人员仅仅是开发人员,那么ATDD仅仅涉及测试人员吗?不是,产品.开发.测试都需要参与到ATDD中来. 在ATDD活 ...

- JAVA-抽象类/类继承

1.当一个类继承一个抽象类的时候,必须实现抽象类的方法.如果子类没有实现父类的抽象方法,则必须将子类也定义为abstract类. 2.被final修饰的类为最终类,不能被继承.而类前面如果有abstr ...

- Spring Boot读取配置的几种方式

读取application文件 在application.yml或者properties文件中添加: info.address=USAinfo.company=Springinfo.degree=hi ...

- Jellyfish详解

一.Jellyfish简介 JELLYFISH是CBCB(Center for Bioinformatics and Computational Biology)的Guillaume Marçais ...

- 5、SAMBA服务二:配置实例

①:SAMBA服务一:参数详解 ②:SAMBA服务二:配置实例 5.2.3.Samba共享目录配置实例 1.允许匿名用户读取/it共享目录,修改/etc/samba/smb.conf,在最后添加以下内 ...

- 『Python CoolBook』C扩展库_其一_用法讲解

不依靠其他工具,直接使用Python的扩展API来编写一些简单的C扩展模块. 本篇参考PythonCookbook第15节和Python核心编程完成,值得注意的是,Python2.X和Python3. ...

- learning makefile 定义命令包

- vs中正常IIS发布网站后css样式、图片丢失jQuery报错 $ is not defined

问题描述: VS运行能够正常看到样式和图片 ,IIS发布后样式丢失.图片不显示.并且jQuery报错“$ is not defined”. 问题分析: 1.首先怀疑是样式文件.图片等发布的时候没有发布 ...

- 在Tomcat中部署Web项目的操作方法,maven项目在Tomcat里登录首页报404

maven项目在Tomcat里登录首页报404, 解决:编辑conf/server.xml进行配置<Host>里的<Context>标签里的path. <Context ...

- springboot学习之构建简单项目搭建

概述 相信对于Java开发者而言,spring和springMvc两个框架一定不陌生,这两个框架需要我们手动配置的地方非常多,各种的xml文件,properties文件,构建一个项目还是挺复杂的,在这 ...