爬取伯乐在线文章(二)通过xpath提取源文件中需要的内容

爬取说明

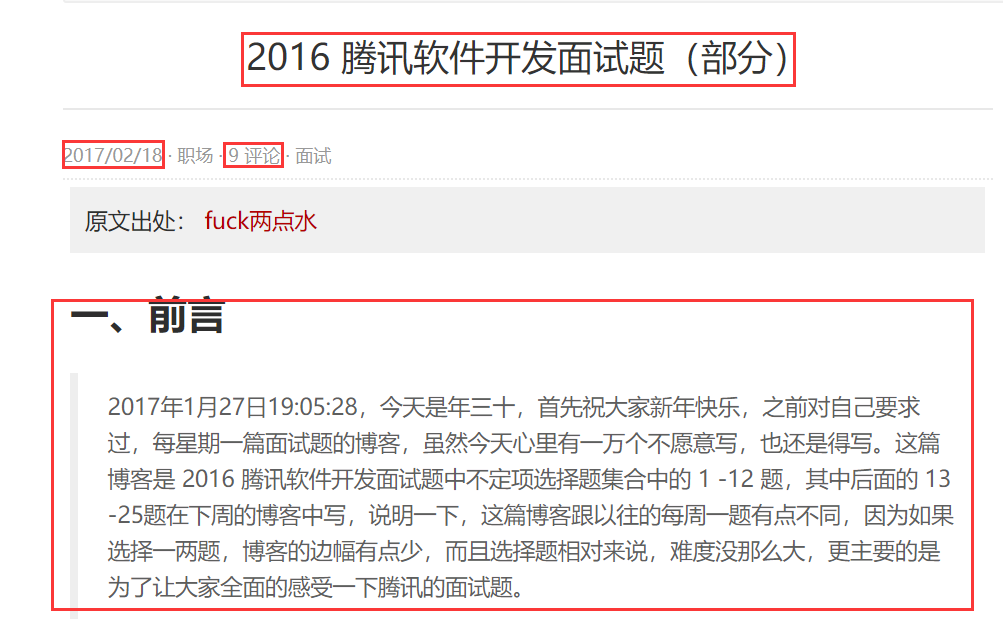

以单个页面为例,如:http://blog.jobbole.com/110287/

我们可以提取标题、日期、多少个评论、正文内容等

Xpath介绍

1. xpath简介

(1) xpath使用路径表达式在xml和html中进行导航

(2) xpath包含标准函数库

(3) xpath是一个w3c标准

2. Xpath的节点关系

(1) 父节点

(2) 子节点

(3) 同胞节点

(4) 先辈节点

(5) 后代节点

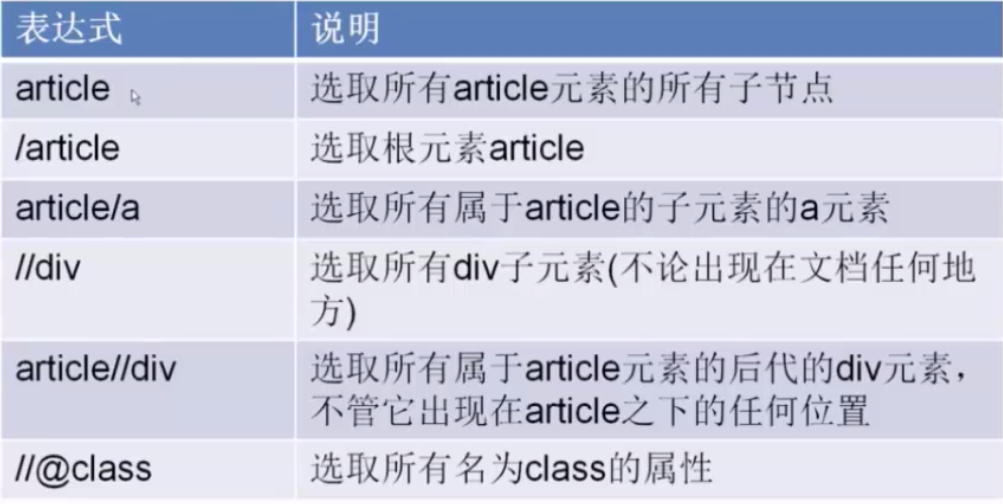

3. Xpath语法

开始爬取

1. 将starts_urls修改为http://blog.jobbole.com/110287/

2. def parse(self, response)方法中的response自带有xpath方法

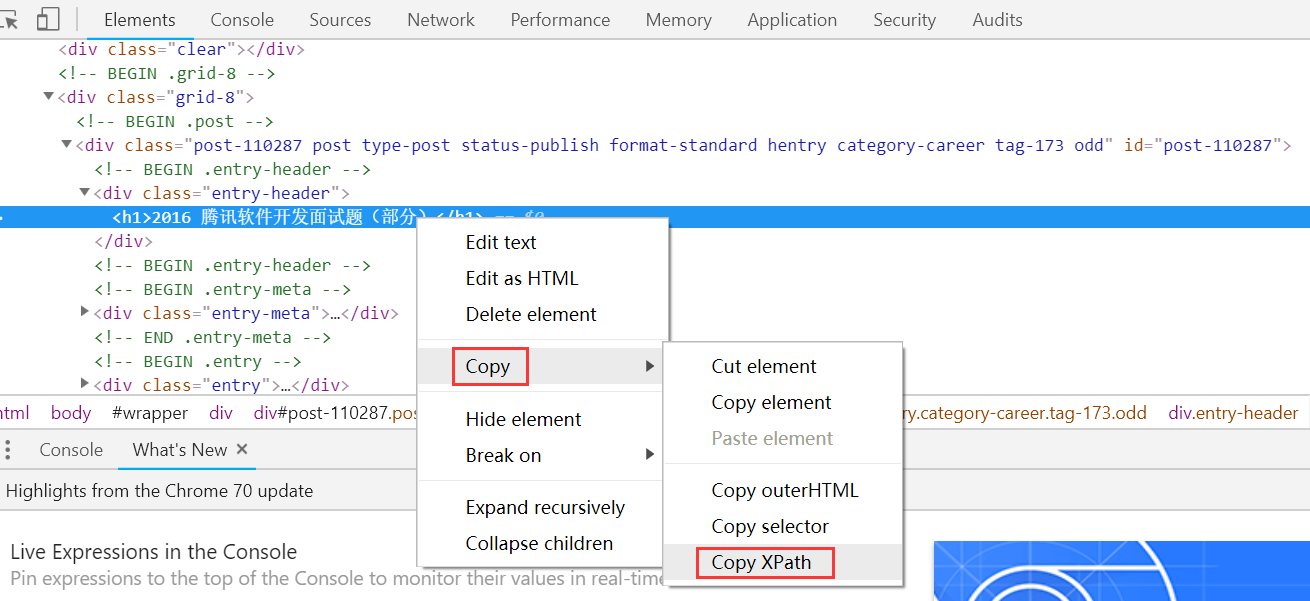

结果为://*[@id="post-110287"]/div[1]/h1

在parse方法里面进行解析:

#业务逻辑

def parse(self, response):

title_selector = response.xpath('//*[@id="post-110287"]/div[1]/h1')

pass

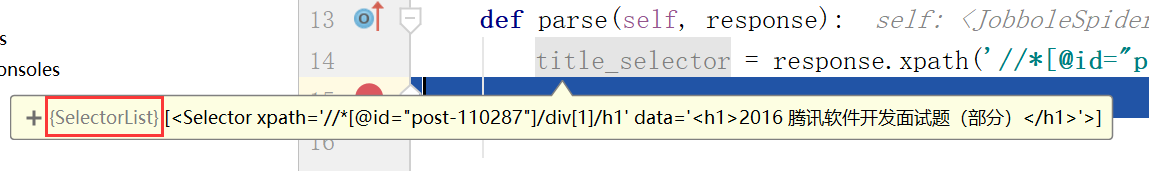

断点查看返回的title_selector的类型是SelectorList,里面存放的是一个selector,为什么不直接返回一个node类型,这是因为我们获取的h1下面可能还有很多层,我们可以进一步的做xpath筛选,直接返回node的话就无法做xpath筛选,所以scrapy做了进一步的封装,可以让我们进一步进行xpath筛选。

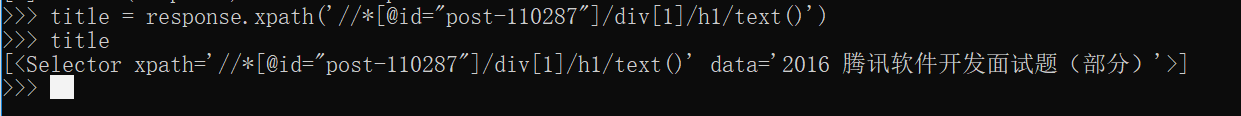

我们可以看到data里面的值是一个h1标签,我们可以直接调用一个text()函数获取里面的值,如下

title_selector = response.xpath('//*[@id="post-110287"]/div[1]/h1/text()')

此时在看data里面值就是我们需要的内容了

调试Xpath

在scarpy里面进行调试是比较慢的,scrapy提供了一种shell模式,可以在里面对某个URL进行调试,如下在cmd里面

(scrapyenv) E:\Python\Envs\EnterpriseSpider>scrapy shell http://blog.jobbole.com/110287/

(scrapyenv) E:\Python\Envs\EnterpriseSpider>scrapy shell http://blog.jobbole.com/110287/

2018-11-05 10:14:15 [scrapy.utils.log] INFO: Scrapy 1.5.1 started (bot: EnterpriseSpider)

2018-11-05 10:14:15 [scrapy.utils.log] INFO: Versions: lxml 4.2.5.0, libxml2 2.9.5, cssselect 1.0.3, parsel 1.5.1, w3lib 1.19.0, Twisted 18.9.0, Python 3.6.6 (v3.6.6:4cf1f54eb7, Jun 27 2018, 03:37:03) [MSC v.1900 64 bit (AMD64)], pyOpenSSL 18.0.0 (OpenSSL 1.1.0i 14 Aug 2018), cryptography 2.3.1, Platform Windows-10-10.0.17134-SP0

2018-11-05 10:14:15 [scrapy.crawler] INFO: Overridden settings: {'BOT_NAME': 'EnterpriseSpider', 'DUPEFILTER_CLASS': 'scrapy.dupefilters.BaseDupeFilter', 'LOGSTATS_INTERVAL': 0, 'NEWSPIDER_MODULE': 'EnterpriseSpider.spiders', 'SPIDER_MODULES': ['EnterpriseSpider.spiders']}

2018-11-05 10:14:15 [scrapy.middleware] INFO: Enabled extensions:

['scrapy.extensions.corestats.CoreStats',

'scrapy.extensions.telnet.TelnetConsole']

2018-11-05 10:14:15 [scrapy.middleware] INFO: Enabled downloader middlewares:

['scrapy.downloadermiddlewares.httpauth.HttpAuthMiddleware',

'scrapy.downloadermiddlewares.downloadtimeout.DownloadTimeoutMiddleware',

'scrapy.downloadermiddlewares.defaultheaders.DefaultHeadersMiddleware',

'scrapy.downloadermiddlewares.useragent.UserAgentMiddleware',

'scrapy.downloadermiddlewares.retry.RetryMiddleware',

'scrapy.downloadermiddlewares.redirect.MetaRefreshMiddleware',

'scrapy.downloadermiddlewares.httpcompression.HttpCompressionMiddleware',

'scrapy.downloadermiddlewares.redirect.RedirectMiddleware',

'scrapy.downloadermiddlewares.cookies.CookiesMiddleware',

'scrapy.downloadermiddlewares.httpproxy.HttpProxyMiddleware',

'scrapy.downloadermiddlewares.stats.DownloaderStats']

2018-11-05 10:14:15 [scrapy.middleware] INFO: Enabled spider middlewares:

['scrapy.spidermiddlewares.httperror.HttpErrorMiddleware',

'scrapy.spidermiddlewares.offsite.OffsiteMiddleware',

'scrapy.spidermiddlewares.referer.RefererMiddleware',

'scrapy.spidermiddlewares.urllength.UrlLengthMiddleware',

'scrapy.spidermiddlewares.depth.DepthMiddleware']

2018-11-05 10:14:15 [scrapy.middleware] INFO: Enabled item pipelines:

[]

2018-11-05 10:14:15 [scrapy.extensions.telnet] DEBUG: Telnet console listening on 127.0.0.1:6023

2018-11-05 10:14:15 [scrapy.core.engine] INFO: Spider opened

2018-11-05 10:14:15 [scrapy.core.engine] DEBUG: Crawled (200) <GET http://blog.jobbole.com/110287/> (referer: None)

[s] Available Scrapy objects:

[s] scrapy scrapy module (contains scrapy.Request, scrapy.Selector, etc)

[s] crawler <scrapy.crawler.Crawler object at 0x000002C00C180080>

[s] item {}

[s] request <GET http://blog.jobbole.com/110287/>

[s] response <200 http://blog.jobbole.com/110287/>

[s] settings <scrapy.settings.Settings object at 0x000002C00E7DD898>

[s] spider <JobboleSpider 'jobbole' at 0x2c00ea8b160>

[s] Useful shortcuts:

[s] fetch(url[, redirect=True]) Fetch URL and update local objects (by default, redirects are followed)

[s] fetch(req) Fetch a scrapy.Request and update local objects

[s] shelp() Shell help (print this help)

[s] view(response) View response in a browser

>>>

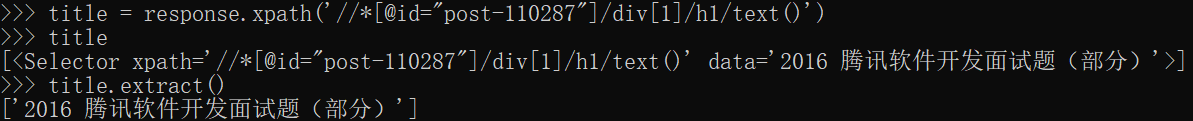

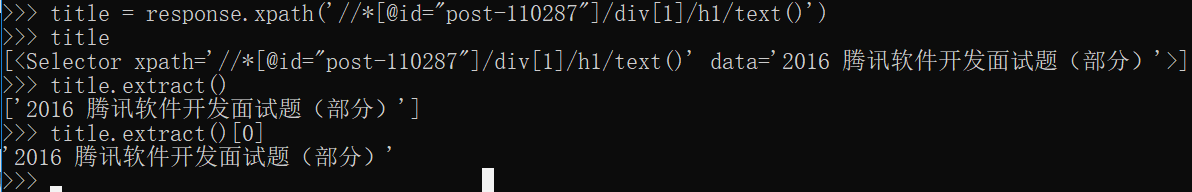

使用如下

获取data里面值可以用Selector的extract方法,返回的是一个数组

在获取数组里面的第一个值就可以获取我们需要的内容

爬取伯乐在线文章(二)通过xpath提取源文件中需要的内容的更多相关文章

- 爬取伯乐在线文章(四)将爬取结果保存到MySQL

Item Pipeline 当Item在Spider中被收集之后,它将会被传递到Item Pipeline,这些Item Pipeline组件按定义的顺序处理Item. 每个Item Pipeline ...

- 第三天,爬取伯乐在线文章代码,编写items.py,保存数据到本地json文件中

一. 爬取http://blog.jobbole.com/all-posts/中的所有文章 1. 编写jobbole.py简单代码 import scrapy from scrapy. ...

- 爬取伯乐在线文章(五)itemloader

ItemLoader 在我们执行scrapy爬取字段中,会有大量的CSS或是Xpath代码,当要爬取的网站多了,要维护起来很麻烦,为解决这类问题,我们可以根据scrapy提供的loader机制. 导入 ...

- Scrapy爬取伯乐在线文章

首先搭建虚拟环境,创建工程 scrapy startproject ArticleSpider cd ArticleSpider scrapy genspider jobbole blog.jobbo ...

- scrapy爬取伯乐在线文章数据

创建项目 切换到ArticleSpider目录下创建爬虫文件 设置settings.py爬虫协议为False 编写启动爬虫文件main.py

- python爬虫scrapy框架——爬取伯乐在线网站文章

一.前言 1. scrapy依赖包: 二.创建工程 1. 创建scrapy工程: scrapy staratproject ArticleSpider 2. 开始(创建)新的爬虫: cd Artic ...

- 爬虫实战——Scrapy爬取伯乐在线所有文章

Scrapy简单介绍及爬取伯乐在线所有文章 一.简说安装相关环境及依赖包 1.安装Python(2或3都行,我这里用的是3) 2.虚拟环境搭建: 依赖包:virtualenv,virtualenvwr ...

- Scrapy爬取伯乐在线的所有文章

本篇文章将从搭建虚拟环境开始,爬取伯乐在线上的所有文章的数据. 搭建虚拟环境之前需要配置环境变量,该环境变量的变量值为虚拟环境的存放目录 1. 配置环境变量 2.创建虚拟环境 用mkvirtualen ...

- Scrapy基础(六)————Scrapy爬取伯乐在线一通过css和xpath解析文章字段

上次我们介绍了scrapy的安装和加入debug的main文件,这次重要介绍创建的爬虫的基本爬取有用信息 通过命令(这篇博文)创建了jobbole这个爬虫,并且生成了jobbole.py这个文件,又写 ...

随机推荐

- JVM-String.intern()

故事起源于书籍<深入理解Java虚拟机>,案例如下: public class RunTimeConstantPoolOOM { public static void main(Strin ...

- 51单片机定时器实现LED闪烁

要启用一个定时器,先要开启定时器,然后产生中断 系统中断: 初始化程序应完成如下工作: 对TMOD赋值,以确定T0和T1的工作方式. 计算初值,并将其写入TH0.TL0或TH1.TL1. 中断方式时, ...

- wp rest api 授权方法步骤(使用JWT Authentication插件)

环境:wordpress 4.7 以上,WP自带的 rest api v2 目标:使用javascript与wp rest api交互,其中编辑.新增.删除等需要Oauth认证授权 方法: 步骤一: ...

- select2 插件编辑时设置默认值

function htDate(selectCustomerId, val) { var customerId = selectCustomerId; var values = val; ajaxJs ...

- select2 插件加载后端数据

//html <select class="form-group form-control" name="roomId" id="roomLis ...

- nginx 转将http跳转到https

#websoceket 使用map map $http_upgrade $connection_upgrade { default upgrade; '' close; } upstream abc. ...

- Phaser.js之简单的跑酷游戏

采用的物理引擎是Phaser.js 官网地址:http://phaser.io/ 在这里对此引擎不做过多介绍(因为我也是小白,嘿嘿) 效果展示: 源码(详细源码图片资源可点击文章下方或屏幕右上方的gi ...

- Android为TV端助力 不需要Socket的跨进程推送消息AIDL!

上篇介绍了跨进程实时通讯http://www.cnblogs.com/xiaoxiaing/p/5818161.html 但是他有个缺点就是服务端无法推送消息给客户端,今天这篇文章主要说的就是服务器推 ...

- java读取excel文件的代码

如下内容段是关于java读取excel文件的内容,应该能对各朋友有所用途. package com.zsmj.utilit; import java.io.FileInputStream;import ...

- Spinner的简单使用

<?xml version="1.0" encoding="utf-8"?> <LinearLayout xmlns:android=&quo ...