cuda编程-并行规约

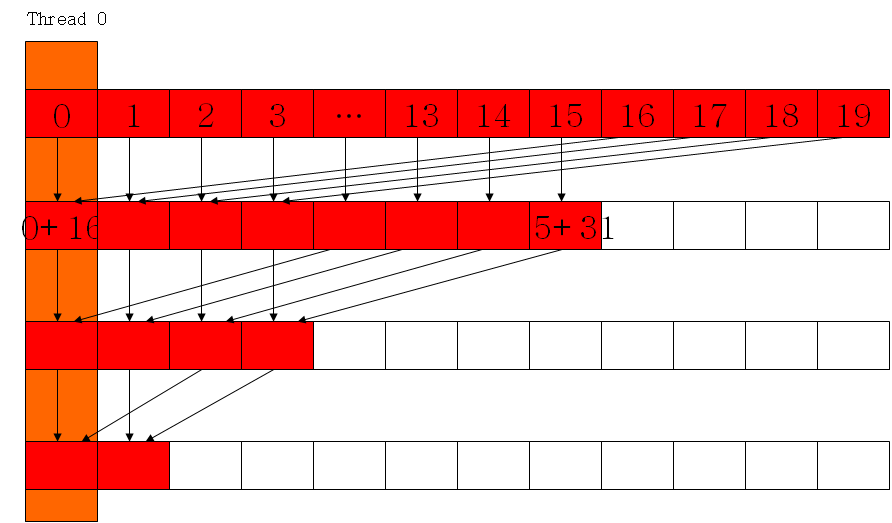

利用shared memory计算,并避免bank conflict;通过每个block内部规约,然后再把所有block的计算结果在CPU端累加

代码:

#include <cuda_runtime.h>

#include <device_launch_parameters.h>

#include <stdio.h>

#include <stdlib.h>

#include <memory>

#include <iostream> #define DATA_SIZE 128

#define TILE_SIZE 64 __global__ void reductionKernel(float *in, float *out){

int tx = threadIdx.x;

int bx = blockIdx.x; __shared__ float data_shm[TILE_SIZE];

data_shm[tx] = in[bx * blockDim.x + tx];

__syncthreads(); for (int i = blockDim.x / ; i > ; i >>= ){

if (tx < i){

data_shm[tx] += data_shm[tx + i];

}

__syncthreads();

} if (tx == )

out[bx] = data_shm[];

} void reduction(){

int out_size = (DATA_SIZE + TILE_SIZE - ) / TILE_SIZE;

float *in = (float*)malloc(DATA_SIZE * sizeof(float));

float *out = (float*)malloc(out_size*sizeof(float));

for (int i = ; i < DATA_SIZE; ++i){

in[i] = i;

}

memset(out, , out_size*sizeof(float)); float *d_in, *d_out;

cudaMalloc((void**)&d_in, DATA_SIZE * sizeof(float));

cudaMalloc((void**)&d_out, out_size*sizeof(float));

cudaMemcpy(d_in, in, DATA_SIZE * sizeof(float), cudaMemcpyHostToDevice); dim3 block(TILE_SIZE, );

dim3 grid(out_size, );

reductionKernel << <grid, block >> >(d_in, d_out); cudaMemcpy(in, d_in, DATA_SIZE * sizeof(float), cudaMemcpyDeviceToHost);

cudaMemcpy(out, d_out, out_size * sizeof(float), cudaMemcpyDeviceToHost); float sum = ;

for (int i = ; i < out_size; ++i){

sum += out[i];

}

std::cout << sum << std::endl; // Check on CPU

float sum_cpu = ;

for (int i = ; i < DATA_SIZE; ++i){

sum_cpu += in[i];

}

std::cout << sum_cpu << std::endl; }

cuda编程-并行规约的更多相关文章

- CUDA中并行规约(Parallel Reduction)的优化

转自: http://hackecho.com/2013/04/cuda-parallel-reduction/ Parallel Reduction是NVIDIA-CUDA自带的例子,也几乎是所有C ...

- 【Cuda编程】加法归约

目录 cuda编程并行归约 AtomicAdd调用出错 gpu cpu下时间计算 加法的归约 矩阵乘法 矩阵转置 统计数目 平方和求和 分块处理 线程相邻 多block计算 cuda编程并行归约 At ...

- CUDA编程(六)进一步并行

CUDA编程(六) 进一步并行 在之前我们使用Thread完毕了简单的并行加速,尽管我们的程序运行速度有了50甚至上百倍的提升,可是依据内存带宽来评估的话我们的程序还远远不够.在上一篇博客中给大家介绍 ...

- cuda编程基础

转自: http://blog.csdn.net/augusdi/article/details/12529247 CUDA编程模型 CUDA编程模型将CPU作为主机,GPU作为协处理器(co-pro ...

- CUDA学习笔记(一)——CUDA编程模型

转自:http://blog.sina.com.cn/s/blog_48b9e1f90100fm56.html CUDA的代码分成两部分,一部分在host(CPU)上运行,是普通的C代码:另一部分在d ...

- CUDA编程

目录: 1.什么是CUDA 2.为什么要用到CUDA 3.CUDA环境搭建 4.第一个CUDA程序 5. CUDA编程 5.1. 基本概念 5.2. 线程层次结构 5.3. 存储器层次结构 5.4. ...

- CUDA编程-(1)Tesla服务器Kepler架构和万年的HelloWorld

结合CUDA范例精解以及CUDA并行编程.由于正在学习CUDA,CUDA用的比较多,因此翻译一些个人认为重点的章节和句子,作为学习,程序将通过NVIDIA K40服务器得出结果.如果想通过本书进行CU ...

- CUDA编程模型

1. 典型的CUDA编程包括五个步骤: 分配GPU内存 从CPU内存中拷贝数据到GPU内存中 调用CUDA内核函数来完成指定的任务 将数据从GPU内存中拷贝回CPU内存中 释放GPU内存 *2. 数据 ...

- CUDA编程之快速入门

CUDA(Compute Unified Device Architecture)的中文全称为计算统一设备架构.做图像视觉领域的同学多多少少都会接触到CUDA,毕竟要做性能速度优化,CUDA是个很重要 ...

随机推荐

- Golang 爬虫-广度优先(获取html文档中的超链接)

package main import( "fmt" "net/http" "io/ioutil" "regexp" & ...

- 剑指offer——链表中倒数第k个结点

输入一个链表,输出该链表中倒数第k个结点. class Solution { public: ListNode* FindKthToTail(ListNode* pListHead, unsigned ...

- zabbix API应用

1.模拟登录 curl -i -X POST -H 'Content-Type:application/json' -d '{"jsonrpc":"2.0",& ...

- bat性能效率受啥影响

代码效率的提升往往由算法决定,曾发过专贴(浅谈提高代码效率的编写习惯:http://tieba.baidu.com/p/1187281687),但是以实例为主,并没有太多的文字说明,现在归纳一下:影响 ...

- 响应式卡片抽奖插件 CardShow

GitHub: https://github.com/nzbin/CardShow/ Demo: https://nzbin.github.io/CardShow/ 前言 这个小项目(卡片秀)是一个卡 ...

- 豆瓣读书爬虫(requests + re)

前面整理了一些爬虫的内容,今天写一个小小的栗子,内容不深,大佬请忽略.内容包括对豆瓣读书网站中的书籍的基本信息进行爬取,并整理,便于我们快速了解每本书的中心. 一.爬取信息 每当爬取某个网页的信息时, ...

- .net core 监听性能,异常

https://www.cnblogs.com/laozhang-is-phi/p/10287023.html#autoid-2-2-0

- 朱晔的互联网架构实践心得S1E10:数据的权衡和折腾【系列完】

朱晔的互联网架构实践心得S1E10:数据的权衡和折腾[系列完] [下载本文PDF进行阅读] 本文站在数据的维度谈一下在架构设计中的一些方案对数据的权衡以及数据流转过程中的折腾这两个事情.最后进行系列文 ...

- 在Linux的Windows子系统上(WSL)使用Docker(Ubuntu)

背景 平时开发大部人都是在提供了高效GUI的window下工作,但是真正部署环境普遍都是在Linux中,所以为了让开发环境和部署环境统一,我们需要在windows模拟LInux环境,以前我们可能通过虚 ...

- require('./expample.js).default详解

最近总碰到类似于 var a = require('./expample.js).default 这样的代码,感觉很奇葩,总结一波. 为什么会出现这个问题? import 是静态编译的,而 requi ...