Spark程序本地运行

Spark程序本地运行

本次安装是在JDK安装完成的基础上进行的! SPARK版本和hadoop版本必须对应!!!

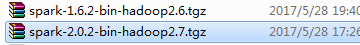

spark是基于hadoop运算的,两者有依赖关系,见下图:

前言:

1.环境变量配置:

1.1 打开“控制面板”选项

1.2.找到“系统”选项卡

1.3.点击“高级系统设置”

1.4.点击“环境变量”

2.新建和编辑环境变量

1.下载hadoop-2.6.0.tar.gz文件,并解压在本地

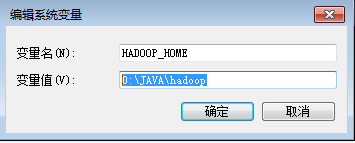

1.1 新建环境变量上配置

HADOOP_HOME

D:\JAVA\hadoop

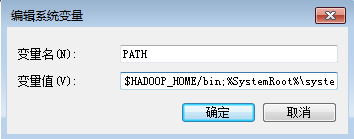

1.2 修改PATH路径

$HADOOP_HOME/bin;

2.下载scala-2.10.6.zip文件,并解压在本地

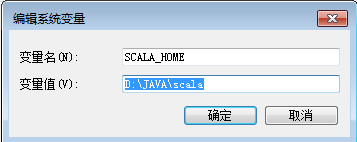

2.1 新建环境变量上配置

SCALA_HOME

D:\JAVA\scala

2.2 修改PATH路径

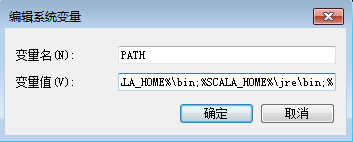

%SCALA_HOME%\bin;%SCALA_HOME%\jre\bin;

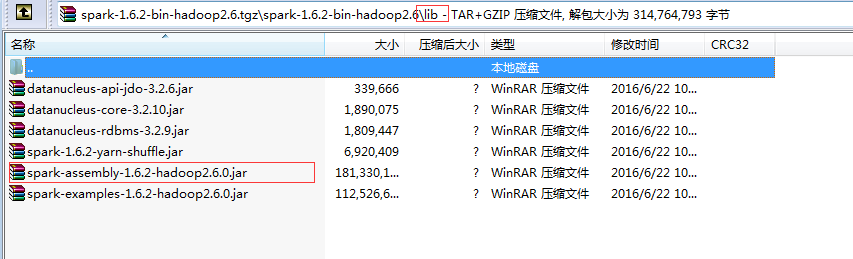

3.下载spark-1.6.2-bin-hadoop2.6.tgz文件,并解压在本地

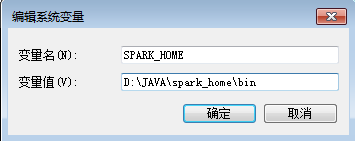

3.1 新建环境变量上配置

SPARK_HOME

D:\JAVA\spark_home\bin

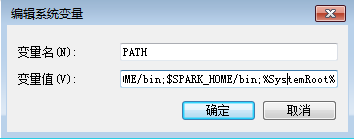

3.2 修改PATH路径

PATH $SPARK_HOME/bin;

4.下载scala-IDE.zip文件,并解压在本地

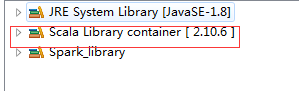

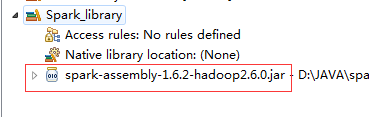

新建一个工程,修改library:

Scala library一定要是:2.10.X

新建一个自己的library:添加一个Jar文件(${spark_home}/lib)

下跟Word Count代码

package com import org.apache.spark.SparkConf

import org.apache.spark.api.java.JavaSparkContext

import org.apache.spark.SparkContext /**

* 统计字符出现次数

*/

object WordCount {

def main(args: Array[String]): Unit = { System.setProperty("hadoop.home.dir", "D:\\JAVA\\hadoop");

val sc = new SparkContext("local", "My App")

val line = sc.textFile("/srv/1.txt") line.map((_, 1)).reduceByKey(_+_).collect().foreach(println) sc.stop()

println(111111)

}

}

hadoop下载点击这里

spark下载点击这里

scala安装包,scala IDE下载点击这里

Spark程序本地运行的更多相关文章

- spark 程序 windows 运行报错

1 java.io.IOException: Could not locate executable null\bin\winutils.exe in the Hadoop binaries. at ...

- spark window本地运行wordcount错误

在运行本地运行spark或者hadoop代码时可能会遇到一下三种问题 1.Exception in thread "main" java.lang.UnsatisfiedLin ...

- 在local模式下的spark程序打包到集群上运行

一.前期准备 前期的环境准备,在Linux系统下要有Hadoop系统,spark伪分布式或者分布式,具体的教程可以查阅我的这两篇博客: Hadoop2.0伪分布式平台环境搭建 Spark2.4.0伪分 ...

- scala IDE for Eclipse开发Spark程序

1.开发环境准备 scala IDE for Eclipse:版本(4.6.1) 官网下载:http://scala-ide.org/download/sdk.html 百度云盘下载:链接:http: ...

- 初识Spark程序

执行第一个spark程序 普通模式提交任务: bin/spark-submit \ --class org.apache.spark.examples.SparkPi \ --master spark ...

- [Spark]如何设置使得spark程序不输出 INFO级别的内容

Spark程序在运行的时候,总是输出很多INFO级别内容 查看了网上的一些文章,进行了试验. 发现在 /etc/spark/conf 目录下,有一个 log4j.properties.template ...

- spark之scala程序开发(本地运行模式):单词出现次数统计

准备工作: 将运行Scala-Eclipse的机器节点(CloudDeskTop)内存调整至4G,因为需要在该节点上跑本地(local)Spark程序,本地Spark程序会启动Worker进程耗用大量 ...

- 如何在本地使用scala或python运行Spark程序

如何在本地使用scala或python运行Spark程序 包含两个部分: 本地scala语言编写程序,并编译打包成jar,在本地运行. 本地使用python语言编写程序,直接调用spark的接口, ...

- Spark认识&环境搭建&运行第一个Spark程序

摘要:Spark作为新一代大数据计算引擎,因为内存计算的特性,具有比hadoop更快的计算速度.这里总结下对Spark的认识.虚拟机Spark安装.Spark开发环境搭建及编写第一个scala程序.运 ...

随机推荐

- [H5-Compress-Image]利用canvas实现 javascript 图片压缩处理_基于requirejs模块化的代码实现

// 还存在有问题的代码,问题在于processFile()中// 问题:在ipone 5c 下,某些图片压缩处理后,上传到服务器生成的文件size为0,即是空白 ;define(['mod/tool ...

- Android-Xml文件生成,Xml数据格式写入

在上一篇博客,Android-XML格式描述,介绍来XML在Android中的格式: 生成xml文件格式数据,Android提供了Xml.newSerializer();,可以理解为Xml序列化: 序 ...

- ListView的另一种可读性更强的ViewHolder模式写法

常见的写法是这样的: @Override public View getView(int position, View convertView, ViewGroup parent) { ViewHol ...

- Index--过滤索引和参数化

--============================================ 领导指点我去给某台数据库调优下,结果屁颠屁颠地干完,还自我感觉良好,刚刚别人博客时,才发现自己踩坑了!! ...

- 设计模式之工厂模式(Factory Pattern)

一.什么是工厂模式? 1.“简单工厂模式”,Simple Factory Pattern 也就是常用的在Factory类中定义静态方法负责new对象的方式. 摘要中提到过“严格地说,这种被称为“简单工 ...

- mysql恢复备份错误:Got a packet bigger than 'max_allowed_packet' bytes

最近恢复mysql数据库备份时,出现了一个错误:Got a packet bigger than 'max_allowed_packet' bytes 该问题主要是由于mysql的my.ini文件中设 ...

- 在Asp.Net MVC中实现上传图片并显示

实现思路大概分为两步: 1. 通过上传接口,将图片上传到服务器,返回文件路径给客户端: 2. 点击保存上传,将文件路径保存到数据库,如果是多张图片,路径用逗号分隔. 核心上传代码: /// <s ...

- MongoDB复制集成员及状态转换

此文已由作者温正湖授权网易云社区发布. 欢迎访问网易云社区,了解更多网易技术产品运营经验. 复制集(Replica Set)是MongoDB核心组件,相比早期版本采用的主从(Master-Slave) ...

- 如何使用socket进行java网络编程(四)

在上一篇的结尾,提到过用来处理每一个服务端accept到的socket,我们由原来最开始的单线程改成了多线程去处理,但是对每一个接收到的socket都new一个thread去处理,这样效率太低,我们需 ...

- IDEA批量修改变量名操作

批量修改变量名操作:shift+F6选中变量---->修改变量---->Enter回车