直观理解神经网络最后一层全连接+Softmax

博客:blog.shinelee.me | 博客园 | CSDN

写在前面

这篇文章将从3个角度:加权、模版匹配与几何来理解最后一层全连接+Softmax。掌握了这3种视角,可以更好地理解深度学习中的正则项、参数可视化以及一些损失函数背后的设计思想。

全连接层与Softmax回顾

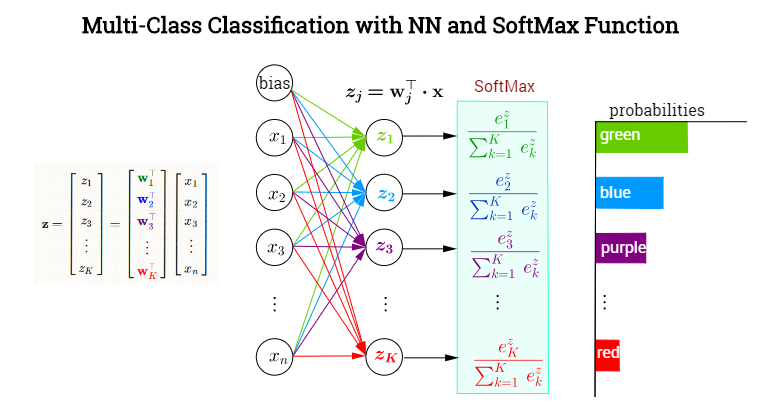

深度神经网络的最后一层往往是全连接层+Softmax(分类网络),如下图所示,图片来自StackExchange。

先看一下计算方式:全连接层将权重矩阵与输入向量相乘再加上偏置,将\(n\)个\((-\infty, +\infty)\)的实数映射为\(K\)个\((-\infty, +\infty)\)的实数(分数);Softmax将\(K\)个\((-\infty, +\infty)\)的实数映射为\(K\)个\((0, 1)\)的实数(概率),同时保证它们之和为1。具体如下:

\[\hat{\mathrm{y}} = softmax(\mathrm{z}) = softmax(\mathrm{W}^{T} \mathrm{x} + \mathrm{b})\]

其中,\(\mathrm{x}\)为全连接层的输入,\(W_{n \times K}\) 为权重,\(\mathrm{b}\)为偏置项,\(\hat{\mathrm{y}}\)为Softmax输出的概率,Softmax的计算方式如下:

\[softmax(z_j) = \frac{e^{z_j}}{\sum_K e^{z_j}}\]

若拆成每个类别的概率如下:

\[\hat{y_j} = softmax(z_j) = softmax(\mathrm{w}_{j} \cdot \mathrm{x} + b_j)\]

其中,\(\mathrm{w}_{j}\)为图中全连接层同一颜色权重组成的向量。

该如何理解?

下面提供3个理解角度:加权角度、模版匹配角度与几何角度

加权角度

加权角度可能是最直接的理解角度。

通常将网络最后一个全连接层的输入,即上面的\(\mathrm{x}\),视为网络从输入数据提取到的特征。

\[z_j = \mathrm{w}_{j} \cdot \mathrm{x} + b_j = w_{j1} x_1 + w_{j2} x_2 + \dots + w_{jn} x_n + b_j\]

将\(\mathrm{w}_{j}\)视为第\(j\)类下特征的权重,即每维特征的重要程度、对最终分数的影响程度,通过对特征加权求和得到每个类别的分数,再经过Softmax映射为概率。

模板匹配

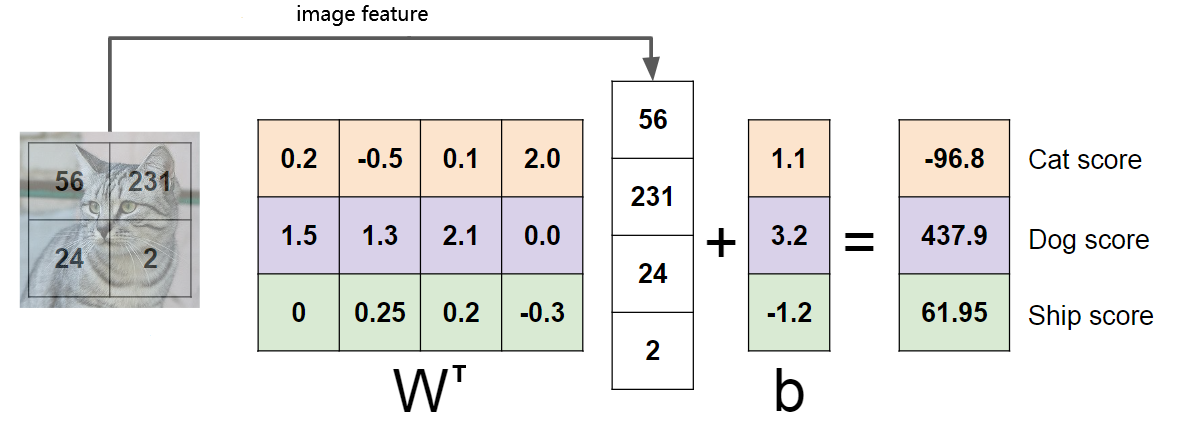

也可以将\(\mathrm{w}_{j}\)视为第\(j\)类的特征模板,特征与每个类别的模板进行模版匹配,得到与每个类别的相似程度,然后通过Softmax将相似程度映射为概率。如下图所示,图片素材来自CS231n。

如果是只有一个全连接层的神经网络(相当于线性分类器),将每个类别的模板可以直接可视化如下,图片素材来自CS231n。

如果是多层神经网络,最后一个全连接层的模板是特征空间的模板,可视化需要映射回输入空间。

几何角度

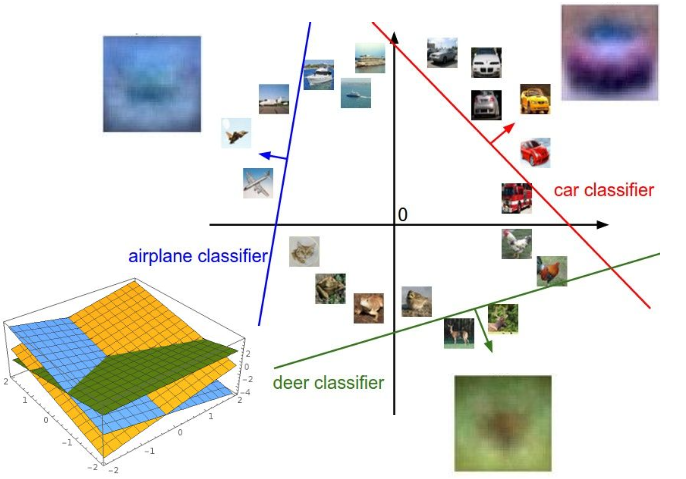

仍将全连接层的输入\(\mathrm{x}\)视为网络从输入数据提取到的特征,一个特征对应多维空间中的一个点。

如果是二分类问题,使用线性分类器\(\hat{y} = \mathrm{w} \cdot \mathrm{x} + b\),若\(\hat{y}>0\)即位于超平面的上方,则为正类,\(\hat{y}<0\)则为负类。

多分类怎么办?为每个类别设置一个超平面,通过多个超平面对特征空间进行划分,一个区域对应一个类别。\(\mathrm{w}_{j}\)为每个超平面的法向量,指向正值的方向,超平面上分数为0,如果求特征与每个超平面间的距离(带正负)为

\[d_j = \frac{\mathrm{w}_{j} \cdot \mathrm{x} + b_j}{||\mathrm{w}_{j}||}\]

而分数\(z_j = ||\mathrm{w}_{j}|| d_j\),再进一步通过Softmax映射为概率。

如下图所示:

Softmax的作用

相比\((-\infty, +\infty)\)范围内的分数,概率天然具有更好的可解释性,让后续取阈值等操作顺理成章。

经过全连接层,我们获得了\(K\)个类别\((-\infty, +\infty)\)范围内的分数\(z_j\),为了得到属于每个类别的概率,先通过\(e^{z_j}\)将分数映射到\((0, +\infty)\),然后再归一化到\((0 ,1)\),这便是Softmax的思想:

\[\hat{y_j} = softmax(z_j) = \frac{e^{z_j}}{\sum_K e^{z_j}}\]

总结

本文介绍了3种角度来更直观地理解全连接层+Softmax,

- 加权角度,将权重视为每维特征的重要程度,可以帮助理解L1、L2等正则项

- 模板匹配角度,可以帮助理解参数的可视化

- 几何角度,将特征视为多维空间中的点,可以帮助理解一些损失函数背后的设计思想(希望不同类的点具有何种性质)

视角不同,看到的画面就不同,就会萌生不同的idea。有些时候,换换视角问题就迎刃而解了。

以上。

参考

直观理解神经网络最后一层全连接+Softmax的更多相关文章

- 机器不学习:CNN入门讲解-为什么要有最后一层全连接

哈哈哈,又到了讲段子的时间 准备好了吗? 今天要说的是CNN最后一层了,CNN入门就要讲完啦..... 先来一段官方的语言介绍全连接层(Fully Connected Layer) 全连接层常简称为 ...

- CNN入门讲解-为什么要有最后一层全连接?

原文地址:https://baijiahao.baidu.com/s?id=1590121601889191549&wfr=spider&for=pc 今天要说的是CNN最后一层了,C ...

- 【TensorFlow/简单网络】MNIST数据集-softmax、全连接神经网络,卷积神经网络模型

初学tensorflow,参考了以下几篇博客: soft模型 tensorflow构建全连接神经网络 tensorflow构建卷积神经网络 tensorflow构建卷积神经网络 tensorflow构 ...

- 全连接与softmax[转载]

转自:https://www.jianshu.com/p/88bb976ccbd9 1.全连接示例: 2.softmax softmax输入层应和输出层(输出维度与类别数一致)纬度一样,如果不一样,就 ...

- 神经网络全连接层+softmax:

如下图:(图片来自StackExchange) 强化说明全连接层: 1.通常将网络最后一个全连接层的输入,即上面的x \mathrm{x}x,视为网络从输入数据提取到的特征. 2. 强化说明softm ...

- Tensorflow 多层全连接神经网络

本节涉及: 身份证问题 单层网络的模型 多层全连接神经网络 激活函数 tanh 身份证问题新模型的代码实现 模型的优化 一.身份证问题 身份证号码是18位的数字[此处暂不考虑字母的情况],身份证倒数第 ...

- TensorFlow之DNN(一):构建“裸机版”全连接神经网络

博客断更了一周,干啥去了?想做个聊天机器人出来,去看教程了,然后大受打击,哭着回来补TensorFlow和自然语言处理的基础了.本来如意算盘打得挺响,作为一个初学者,直接看项目(不是指MINIST手写 ...

- Python3 卷积神经网络卷积层,池化层,全连接层前馈实现

# -*- coding: utf-8 -*- """ Created on Sun Mar 4 09:21:41 2018 @author: markli " ...

- 全连接BP神经网络

前馈神经网络 前馈神经网络(feedforward neural network)是最朴素的神经网络,通常我们所说的前馈神经网络有两种,一种叫反向传播网络(Back propagation Netwo ...

随机推荐

- JavaScript对json操作小记

JSON是一种轻量级的数据交换格式,同时,JSON是 JavaScript 原生格式,因此我们可以直接处理它不需要依赖任何工具包或者插件.因此,好多后台都会选择返回给前端这种非常友好的数据格式. 引子 ...

- C#现代代码风格指南

参考资料: asp.net 主页仓库 代码风格 -- 一般原则 最通用的指导原则是我们使用所有的VS默认设置的代码格式,除了我们把系统命名空间放在其他命名空间之前(这在VS中是默认的,但是在VS的更新 ...

- DX11 Without DirectX SDK--06 DirectXMath数学库

回到 DirectX11--使用Windows SDK来进行开发 xnamath.h原本是位于DirectX SDK的一个数学库,但是现在Windows SDK包含的数学库已经抛弃掉原来的xnamat ...

- 读《图解HTTP》有感-(返回结果的HTTP状态码)

写在前面 HTTP状态码是由服务端产生,用于告诉客户端,服务端处理结果的编码 正文 1.状态码的作用是什么?具有什么特征? 状态码的作用是当客户端向服务器发送请求时,描述服务器的响应结果(如:服务器正 ...

- Spring Boot实战笔记(一)-- Spring简介

一.Spring 概述 Spring框架是一个轻量级的企业级开发的一站式解决方案.所谓的解决方案就是可以基于Spring解决所有的Java EE开发的所有问题. Spring框架主要提供了Ioc(In ...

- 2017年BackBox5和Ubuntu16.04.1国内更新源

BackBox是基于Ubuntu的Linux发行版,因此,我们可以使用Ubuntu的更新源作为BackBox的更新源. 1.查看系统版本信息: 输入: uname -a 显示计算机及操作系统的有关信息 ...

- Whitelabel Error Page 专题

Spring boot为错误视图提供了如下错误属性:timestamp:错误发生的时间status:HTTP状态码error:错误原因exception:异常的类名message:异常消息(如果这个错 ...

- Load balancer does not have available server for client

最近在研究spring-cloud,研究zuul组件时发生下列错误: Caused by: com.netflix.client.ClientException: Load balancer does ...

- Spring Security-- 验证码功能的实现

spring security4 添加验证码 http://www.itwendao.com/article/detail/165400.html http://www.itdadao.com/art ...

- 你不知道的JavaScript--Item25 创建对象(类)的8种方法总结

1. 使用Object构造函数来创建一个对象 下面代码创建了一个person对象,并用两种方式打印出了Name的属性值. var person = new Object(); person.name= ...