爬虫-selenium的使用

安装

pip install selenium

开始

# coding=utf-8

from selenium import webdriver # 引用selenium库

import time # 实例化一个浏览器

driver = webdriver.Chrome()

# 请求网页地址

driver.get("http://www.baidu.com")

# 元素定位方法

driver.find_element_by_id("kw").send_keys("python")

driver.find_element_by_id("su").click() # 退出浏览器

time.sleep(3)

driver.quit()

报错

raceback (most recent call last):

File "D:/python_work/18-20爬虫代码V3.1/爬虫代码V3.1/day06/code/01_try_selenium.py", line 6, in <module>

driver = webdriver.Chrome()

File "D:\Programs\Python\Python35\lib\site-packages\selenium\webdriver\chrome\webdriver.py", line 73, in __init__

self.service.start()

File "D:\Programs\Python\Python35\lib\site-packages\selenium\webdriver\common\service.py", line 83, in start

os.path.basename(self.path), self.start_error_message)

selenium.common.exceptions.WebDriverException: Message: 'chromedriver' executable needs to be in PATH. Please see https://sites.google.com/a/chromium.org/chromedriver/home

原因:没有安装chromedriver

chromedriver下载地址:https://chromedriver.storage.googleapis.com/index.html

解压缩

unzip chromedriver_linux64.zip

把文件夹移动到/usr/bin目录下

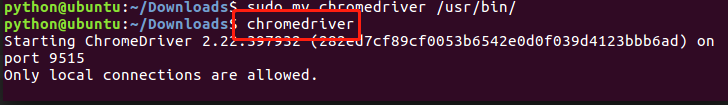

sudo mv chromedriver /usr/bin/

测试是否成功

继续运行代码,成功

selenium用法

# coding=utf-8

from selenium import webdriver # 引用selenium库

import time # 实例化一个浏览器

driver = webdriver.Chrome()

# 请求网页地址

driver.get("http://www.baidu.com")

# 最大化窗口

# driver.maximize_window()

# 自定义窗口大小

driver.set_window_size("","")

# 保存图片

driver.save_screenshot('./baidu.png') # 元素定位方法

driver.find_element_by_id("kw").send_keys("python")

driver.find_element_by_id("su").click() # 请求

# 获取cookies

cookies = driver.get_cookies()

cookies = {i["name"]:i["value"] for i in cookies}

print(cookies)

# 获取网页elenments 即 html字符串

html = driver.page_source

print(html)

# 获取当前请求的url

current_url = driver.current_url

print(current_url) # 退出当前页面

driver.close()

# 退出浏览器

driver.quit()

find_element

# coding=utf-8

from selenium import webdriver

import time driver = webdriver.Chrome()

driver.get("https://www.baidu.com/s?ie=UTF-8&wd=python") # find_element和find_elements区别

# find_element返回一个对象,如果没有会报错

# find_elements返回一个对象集组成的列表,如果没有返回一个空列表 # 获取内容块列表

ret = driver.find_elements_by_xpath("//div[@id='content_left']//div[contains(@class,'c-container')]")

# by_xpath中获取属性需要使用get_attribute()

for i in ret:

# print(i.get_attribute('srcid'))

pass

# by_xpath中获取文本钥匙用text 注:不是text()

# 获取"下一页>"文本所在的链接

print(driver.find_elements_by_link_text("下一页>")[0].get_attribute("href"))

# 获取含有"下一页"文字的文本所在的链接

print(driver.find_element_by_partial_link_text("下一页").get_attribute("href"))

# 根据表签名获取内容

ret1 = driver.find_elements_by_tag_name("h3")

for i in ret1:

# print(i.text)

pass

# 根据class获取内容

ret2 = driver.find_elements_by_class_name("c-container")

print(ret2)

# 获取css选择器

print(driver.find_element_by_class_name("table,img")) driver.quit()

frame操作

# coding=utf-8

from selenium import webdriver

import time driver = webdriver.Chrome()

driver.get("https://mail.qq.com") # 切换到iframe

driver.switch_to.frame("login_frame")

# 如果没有切换到iframe的话 会找不到元素而报错

driver.find_element_by_id("u").send_keys("") time.sleep(3)

driver.quit()

爬虫-selenium的使用的更多相关文章

- [Python爬虫] Selenium实现自动登录163邮箱和Locating Elements介绍

前三篇文章介绍了安装过程和通过Selenium实现访问Firefox浏览器并自动搜索"Eastmount"关键字及截图的功能.而这篇文章主要简单介绍如何实现自动登录163邮箱,同时 ...

- [Python爬虫] Selenium+Phantomjs动态获取CSDN下载资源信息和评论

前面几篇文章介绍了Selenium.PhantomJS的基础知识及安装过程,这篇文章是一篇应用.通过Selenium调用Phantomjs获取CSDN下载资源的信息,最重要的是动态获取资源的评论,它是 ...

- [Python爬虫] Selenium获取百度百科旅游景点的InfoBox消息盒

前面我讲述过如何通过BeautifulSoup获取维基百科的消息盒,同样可以通过Spider获取网站内容,最近学习了Selenium+Phantomjs后,准备利用它们获取百度百科的旅游景点消息盒(I ...

- [Python爬虫] Selenium爬取新浪微博客户端用户信息、热点话题及评论 (上)

转载自:http://blog.csdn.net/eastmount/article/details/51231852 一. 文章介绍 源码下载地址:http://download.csdn.net/ ...

- python爬虫---selenium库的用法

python爬虫---selenium库的用法 selenium是一个自动化测试工具,支持Firefox,Chrome等众多浏览器 在爬虫中的应用主要是用来解决JS渲染的问题. 1.使用前需要安装这个 ...

- [python爬虫] Selenium常见元素定位方法和操作的学习介绍

这篇文章主要Selenium+Python自动测试或爬虫中的常见定位方法.鼠标操作.键盘操作介绍,希望该篇基础性文章对你有所帮助,如果有错误或不足之处,请海涵~同时CSDN总是屏蔽这篇文章,再加上最近 ...

- [python爬虫] Selenium常见元素定位方法和操作的学习介绍(转载)

转载地址:[python爬虫] Selenium常见元素定位方法和操作的学习介绍 一. 定位元素方法 官网地址:http://selenium-python.readthedocs.org/locat ...

- 笔记-爬虫-selenium常用方法

笔记-爬虫-selenium常用方法 1. 查找元素 常用的查找方法 find_element_by_name find_element_by_xpath find_element_by_l ...

- Python爬虫-selenium的使用(2)

使用selenium打开chrome浏览器百度进行搜索 12345678910111213141516171819202122232425 from selenium import webdriver ...

- [Python爬虫] Selenium自动访问Firefox和Chrome并实现搜索截图

前两篇文章介绍了安装,此篇文章算是一个简单的进阶应用吧!它是在Windows下通过Selenium+Python实现自动访问Firefox和Chrome并实现搜索截图的功能. [Pyth ...

随机推荐

- JavaScript 系列--JavaScript一些奇淫技巧的实现方法(二)数字格式化 1234567890转1,234,567,890;argruments 对象(类数组)转换成数组

一.前言 之前写了一篇文章:JavaScript 系列--JavaScript一些奇淫技巧的实现方法(一)简短的sleep函数,获取时间戳 https://www.mwcxs.top/page/746 ...

- ASPNETCore开源日志面板 :LogDashboard

LogDashboard logdashboard是在github上开源的aspnetcore项目, 它旨在帮助开发人员排查项目运行中出现错误时快速查看日志排查问题 通常我们会在项目中使用nlog.l ...

- iptables 【转载】

一:前言 防火墙,其实说白了讲,就是用于实现Linux下访问控制的功能的,它分为硬件的或者软件的防火墙两种.无论是在哪个网络中,防火墙工作的地方一定是在网络的边缘.而我们的任务就是需要去定义到底防 ...

- 在Jenkins远程链接Linux系统,然后执行shell命令-亲测可用【转】

版权声明:本文为博主原创文章,未经博主允许不得转载.部分为转载其他人的,如要使用,也请提前通知一声 https://blog.csdn.net/a136332462/article/details/7 ...

- SFTP 定时任务下载

1.上传 winscp.exe /console /command "option batch continue" "option confirm off" & ...

- 《 .NET并发编程实战》阅读指南 - 第12章

先发表生成URL以印在书里面.等书籍正式出版销售后会公开内容.

- STM32 串口通信基础知识

1.串口通信简介 通信接口的两种方式: 并行通信 -传输原理:数据各个位同时传输. -优点:速度快 -缺点:占用引脚资源多 串行通信 -传输原理:数据按位顺序传输. -优点:占用引脚资源少 -缺点:速 ...

- .net core - 配置管理 - json文件配置

Json 文件配置 public class Startup { public Startup(IHostingEnvironment env) { var builder = new Configu ...

- K8S CoreDNS部署失败,问题分析

1. 查询k8s集群部署pod的基本情况 如下图,我们可知容器coredns和dnsutils都部署成功,但是由于域名解析的问题,导致coredns和dnsutils的容器不断重启(原因heath检查 ...

- .Net Core实战教程(二):设置Kestrel的IP与端口的几种方法

.Net Core实战教程(二):设置Kestrel的IP与端口的几种方法 1.直接写在代码方式 Program.cs代码如下: using System; using System.Collecti ...