机器学习作业(二)逻辑回归——Python(numpy)实现

题目太长啦!文档下载【传送门】

第1题

简述:实现逻辑回归。

此处使用了minimize函数代替Matlab的fminunc函数,参考了该博客【传送门】。

import numpy as np

import matplotlib.pyplot as plt

import scipy.optimize as op #S函数

def sigmoid(z):

g = 1/(1+np.exp(-z))

return g #cost计算函数

def costFunction(theta, X, y):

theta = np.array(theta).reshape((np.size(theta),1))

m = np.size(y)

h = sigmoid(np.dot(X, theta))

J = 1/m*(-np.dot(y.T, np.log(h)) - np.dot((1-y.T), np.log(1-h)))

return J.flatten() def gradient(theta, X, y):

theta = np.array(theta).reshape((np.size(theta), 1))

m = np.size(y)

h = sigmoid(np.dot(X, theta))

grad = 1/m*np.dot(X.T, h - y)

return grad.flatten() #读取数据,第一列是成绩1,第二列是成绩2,第三列是yes/no

data = np.loadtxt('ex2data1.txt', delimiter=',', dtype='float')

m = np.size(data[:, 0])

# print(data) #绘制样本点

X = data[:, 0:2]

y = data[:, 2:3]

pos = np.where(y == 1)[0]

neg = np.where(y == 0)[0]

X1 = X[pos, 0:2]

X0 = X[neg, 0:2]

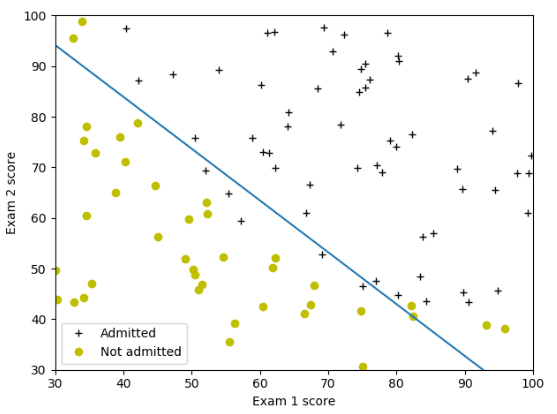

plt.plot(X1[:, 0], X1[:, 1], 'k+')

plt.plot(X0[:, 0], X0[:, 1], 'yo')

plt.xlabel('Exam 1 score')

plt.ylabel('Exam 2 score') #求解最优解

one = np.ones(m)

X = np.insert(X, 0, values=one, axis=1)

initial_theta = np.zeros(np.size(X, 1))

result = op.minimize(fun=costFunction, x0=initial_theta, args=(X, y), method='TNC', jac=gradient)

# print(result)

theta = result.x

cost = result.fun

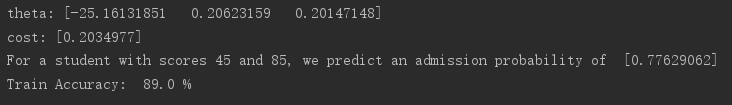

print('theta:', theta)

print('cost:', cost) #绘制决策边界

plot_x = np.array([np.min(X[:, 1]), np.max(X[:, 2])])

# print(plot_x)

plot_y = (-1/theta[2])*(theta[1]*plot_x+theta[0])

# print(plot_y)

plt.plot(plot_x,plot_y)

plt.legend(labels=['Admitted', 'Not admitted'])

plt.axis([30, 100, 30, 100])

plt.show() #预测[45 85]成绩的学生,并计算准确率

theta = np.array(theta).reshape((np.size(theta),1))

z = np.dot([1, 45, 85], theta)

prob = sigmoid(z)

print('For a student with scores 45 and 85, we predict an admission probability of ', prob)

p = np.round(sigmoid(np.dot(X,theta)))

acc = np.mean(p==y)*100

print('Train Accuracy: ',acc,'%')

运行结果:

第2题

简述:通过正规化实现逻辑回归。

import numpy as np

import matplotlib.pyplot as plt

import scipy.optimize as op #S函数

def sigmoid(z):

g = 1/(1+np.exp(-z))

return g #cost计算函数

def costFunction(theta, X, y, lamb):

theta = np.array(theta).reshape((np.size(theta), 1))

m = np.size(y)

h = sigmoid(np.dot(X, theta))

J = 1/m*(-np.dot(y.T, np.log(h)) - np.dot((1-y.T), np.log(1-h)))

# 添加项

theta2 = theta[1:, 0]

Jadd = lamb/(2*m)*np.sum(theta2**2)

J = J + Jadd

return J.flatten() #求梯度

def gradient(theta, X, y, lamb):

theta = np.array(theta).reshape((np.size(theta), 1))

m = np.size(y)

h = sigmoid(np.dot(X, theta))

grad = 1/m*np.dot(X.T, h - y)

#添加项

theta[0,0] = 0

gradadd = lamb/m*theta

grad = grad + gradadd

return grad.flatten() #求特征矩阵

def mapFeature(X1, X2):

degree = 6

out = np.ones((np.size(X1),1))

for i in range(1, degree+1):

for j in range(0, i+1):

res = np.multiply(np.power(X1, i-j), np.power(X2, j))

out = np.insert(out, np.size(out[0, :]), values=res, axis=1)

return out #读取数据,第一列是成绩1,第二列是成绩2,第三列是yes/no

data = np.loadtxt('ex2data2.txt', delimiter=',', dtype='float')

m = np.size(data[:, 0]) #绘制样本点

X = data[:, 0:2]

y = data[:, 2:3]

pos = np.where(y == 1)[0]

neg = np.where(y == 0)[0]

X1 = X[pos, 0:2]

X0 = X[neg, 0:2]

plt.plot(X1[:, 0], X1[:, 1], 'k+')

plt.plot(X0[:, 0], X0[:, 1], 'yo')

plt.xlabel('Microchip Test 1')

plt.ylabel('Microchip Test 2')

plt.legend(labels=['y = 1', 'y = 0']) #数据初始化

X = mapFeature(X[:, 0], X[:, 1])

# print(X)

lamb = 1

initial_theta = np.zeros(np.size(X, 1)) #求解最优解

result = op.minimize(fun=costFunction, x0=initial_theta, args=(X, y, lamb), method='TNC', jac=gradient)

# print(result)

cost = result.fun

theta = result.x

print('theta:', theta)

print('cost:', cost) #绘制决策边界

u = np.linspace(-1, 1.5, 50)

v = np.linspace(-1, 1.5, 50)

z = np.zeros((np.size(u),np.size(v)))

theta = np.array(theta).reshape((np.size(theta), 1))

for i in range(0, np.size(u)):

for j in range(0, np.size(v)):

z[i, j] = np.dot(mapFeature(u[i], v[j]), theta)

# print(z)

plt.contour(u, v, z.T, [0])

plt.show() #计算准确率

p = np.round(sigmoid(np.dot(X,theta)))

acc = np.mean(p==y)*100

print('Train Accuracy: ',acc,'%')

运行结果:

机器学习作业(二)逻辑回归——Python(numpy)实现的更多相关文章

- 机器学习二 逻辑回归作业、逻辑回归(Logistic Regression)

机器学习二 逻辑回归作业 作业在这,http://speech.ee.ntu.edu.tw/~tlkagk/courses/ML_2016/Lecture/hw2.pdf 是区分spam的. 57 ...

- 机器学习总结之逻辑回归Logistic Regression

机器学习总结之逻辑回归Logistic Regression 逻辑回归logistic regression,虽然名字是回归,但是实际上它是处理分类问题的算法.简单的说回归问题和分类问题如下: 回归问 ...

- 机器学习算法整理(二)梯度下降求解逻辑回归 python实现

逻辑回归(Logistic regression) 以下均为自己看视频做的笔记,自用,侵删! 还参考了:http://www.ai-start.com/ml2014/ 用梯度下降求解逻辑回归 Logi ...

- scikit-learn机器学习(二)逻辑回归进行二分类(垃圾邮件分类),二分类性能指标,画ROC曲线,计算acc,recall,presicion,f1

数据来自UCI机器学习仓库中的垃圾信息数据集 数据可从http://archive.ics.uci.edu/ml/datasets/sms+spam+collection下载 转成csv载入数据 im ...

- Coursera-AndrewNg(吴恩达)机器学习笔记——第三周编程作业(逻辑回归)

一. 逻辑回归 1.背景:使用逻辑回归预测学生是否会被大学录取. 2.首先对数据进行可视化,代码如下: pos = find(y==); %找到通过学生的序号向量 neg = find(y==); % ...

- 【机器学习基础】逻辑回归——LogisticRegression

LR算法作为一种比较经典的分类算法,在实际应用和面试中经常受到青睐,虽然在理论方面不是特别复杂,但LR所牵涉的知识点还是比较多的,同时与概率生成模型.神经网络都有着一定的联系,本节就针对这一算法及其所 ...

- Stanford机器学习---第三讲. 逻辑回归和过拟合问题的解决 logistic Regression & Regularization

原文:http://blog.csdn.net/abcjennifer/article/details/7716281 本栏目(Machine learning)包括单参数的线性回归.多参数的线性回归 ...

- 机器学习入门11 - 逻辑回归 (Logistic Regression)

原文链接:https://developers.google.com/machine-learning/crash-course/logistic-regression/ 逻辑回归会生成一个介于 0 ...

- Spark机器学习(2):逻辑回归算法

逻辑回归本质上也是一种线性回归,和普通线性回归不同的是,普通线性回归特征到结果输出的是连续值,而逻辑回归增加了一个函数g(z),能够把连续值映射到0或者1. MLLib的逻辑回归类有两个:Logist ...

随机推荐

- Java高级项目实战02:客户关系管理系统CRM系统模块分析与介绍

本文承接上一篇:Java高级项目实战之CRM系统01:CRM系统概念和分类.企业项目开发流程 先来CRM系统结构图: 每个模块作用介绍如下: 1.营销管理 营销机会管理:针对企业中客户的质询需求所建立 ...

- [CQOI2015]选数(莫比乌斯反演,杜教筛)

[CQOI2015]选数(luogu) Description 题目描述 我们知道,从区间 [L,H](L 和 H 为整数)中选取 N 个整数,总共有 (H-L+1)^N 种方案. 小 z 很好奇这样 ...

- ASPNetCore 发布到IIS

ASPNetCore 发布到IIS 准备工作 1.1. 安装IIS.(具体操作不再说明) 安装成功后再浏览器输入localhost得到的页面如下 1.2. 安装dotnet-hosting-2.2 ...

- Android Binder实现浅析-Binder驱动

简介 Android是如何实现跨进程通信的,大家熟悉的Binder是什么,怎么设计的,进程间的数据如何发送接收的.本文将以及解析,并对Binder驱动实现.Native层实现.Java层实现三块做一个 ...

- mysql实现远程登录

CentOS7上安装mysql后,想要实现mysql远程登录. 主要解决二个问题:(1)为mysql用户授予远程登录权限(改表法或授权法):(2)防火墙开放3306端口. (一)授予登录权限 mysq ...

- 非常简洁简单的tcp socket库 XKSocket

一个非常简洁简单的异步tcp socket库,主要就是分包的问题,处理组包,粘包等问题 非常适合新手:) 项目中带有使用示例. http://git.oschina.net/dreamzgj/XKSo ...

- [Linux] git add时的注意事项

git add -A 提交所有变化 git add -u 提交被修改(modified)和被删除(deleted)文件,不包括新文件(new) git add . 提交新文件(new)和被修改( ...

- STM32 & RT-Thread的逆向入门

STM32 & RT-Thread的逆向入门 backahasten@0xFA 现在,各种MCU的价格越来越低,同等条件下能买到的ROM和RAM资源也多了.对 ...

- CentOS8中进行IP和主机名的网络配置的过程图解

摘要: 很多人不知道如何在字符界面下配置主机名和ip,所以写了这个文章,本人也是新手,希望指出错误与不足.(本文只是在字符界面下教程) 一.输入你的账号密码登录 1)ifconfig 查看你目前的 主 ...

- UVA1395 (最苗条的最小生成树)

链接 https://vjudge.net/problem/UVA-1395 代码 #include<bits/stdc++.h> using namespace std; #define ...