二、Linear Regression 练习(转载)

转载链接:http://www.cnblogs.com/tornadomeet/archive/2013/03/15/2961660.html

前言

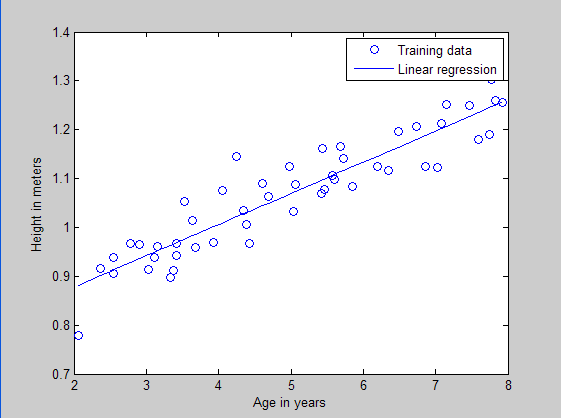

本文是多元线性回归的练习,这里练习的是最简单的二元线性回归,参考斯坦福大学的教学网http://openclassroom.stanford.edu/MainFolder/DocumentPage.php?course=DeepLearning&doc=exercises/ex2/ex2.html。本题给出的是50个数据样本点,其中x为这50个小朋友到的年龄,年龄为2岁到8岁,年龄可有小数形式呈现。Y为这50个小朋友对应的身高,当然也是小数形式表示的。现在的问题是要根据这50个训练样本,估计出3.5岁和7岁时小孩子的身高。通过画出训练样本点的分布凭直觉可以发现这是一个典型的线性回归问题。

matlab函数介绍:

legend:

比如legend('Training data', 'Linear regression'),它表示的是标出图像中各曲线标志所代表的意义,这里图像的第一条曲线(其实是离散的点)表示的是训练样本数据,第二条曲线(其实是一条直线)表示的是回归曲线。

hold on, hold off:

hold on指在前一幅图的情况下打开画纸,允许在上面继续画曲线。hold off指关闭前一副画的画纸。

linspace:

比如linspace(-3, 3, 100)指的是给出-3到3之间的100个数,均匀的选取,即线性的选取。

logspace:

比如logspace(-2, 2, 15),指的是在10^(-2)到10^(2)之间选取15个数,这些数按照指数大小来选取,即指数部分是均匀选取的,但是由于都取了10为底的指数,所以最终是服从指数分布选取的。

实验结果:

训练样本散点和回归曲线预测图:

损失函数与参数之间的曲面图:

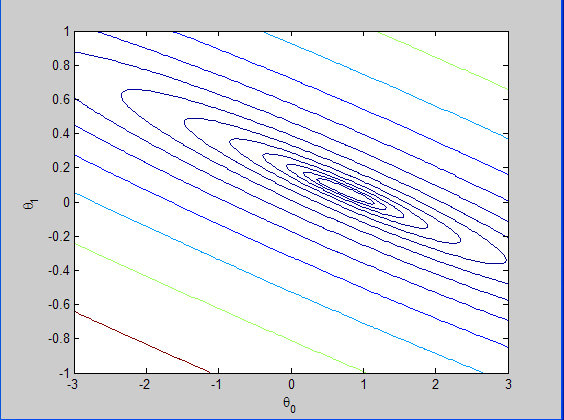

损失函数的等高线图:

程序代码及注释:

(1)采用正规方程求解:

%%方法一

x = load('ex2x.dat');

y = load('ex2y.dat');

plot(x,y,'*')

xlabel('height')

ylabel('age')

x = [ones(size(x),),x];

w=inv(x'*x)*x'*y

hold on

%plot(x,0.0639*x+0.7502)

plot(x(:,),0.0639*x(:,)+0.7502)%更正后的代码

(2)采用BGD方法:

% Exercise Linear Regression % Data is roughly based on CDC growth figures

% for boys

%

% x refers to a boy's age

% y is a boy's height in meters

% clear all; close all; clc

x = load('ex2x.dat'); y = load('ex2y.dat'); m = length(y); % number of training examples % Plot the training data

figure; % open a new figure window

plot(x, y, 'o');

ylabel('Height in meters')

xlabel('Age in years') % Gradient descent

x = [ones(m, ) x]; % Add a column of ones to x

theta = zeros(size(x(,:)))'; % initialize fitting parameters

MAX_ITR = ;

alpha = 0.07; for num_iterations = :MAX_ITR

% This is a vectorized version of the

% gradient descent update formula

% It's also fine to use the summation formula from the videos % Here is the gradient

grad = (/m).* x' * ((x * theta) - y); % Here is the actual update

theta = theta - alpha .* grad; % Sequential update: The wrong way to do gradient descent

% grad1 = (/m).* x(:,)' * ((x * theta) - y);

% theta() = theta() + alpha*grad1;

% grad2 = (/m).* x(:,)' * ((x * theta) - y);

% theta() = theta() + alpha*grad2;

end

% print theta to screen

theta % Plot the linear fit

hold on; % keep previous plot visible

plot(x(:,), x*theta, '-')

legend('Training data', 'Linear regression')%标出图像中各曲线标志所代表的意义

hold off % don't overlay any more plots on this figure,指关掉前面的那幅图 % Closed form solution for reference

% You will learn about this method in future videos

exact_theta = (x' * x)\x' * y % Predict values for age 3.5 and

predict1 = [, 3.5] *theta

predict2 = [, ] * theta % Calculate J matrix % Grid over which we will calculate J

theta0_vals = linspace(-, , );

theta1_vals = linspace(-, , ); % initialize J_vals to a matrix of 's

J_vals = zeros(length(theta0_vals), length(theta1_vals)); for i = :length(theta0_vals)

for j = :length(theta1_vals)

t = [theta0_vals(i); theta1_vals(j)];

J_vals(i,j) = (0.5/m) .* (x * t - y)' * (x * t - y);

end

end %Surf() :绘制某一区间内的完整曲面;matlab的surf函数中是在z的线性存储中,先固定y然后移动x,顺序选取。也就是说,Z(i,j)是在x(j),y(i)时候选取的。所以必须在绘制图形的时候对z转置

J_vals = J_vals';

% Surface plot

figure;

surf(theta0_vals, theta1_vals, J_vals)

xlabel('\theta_0'); ylabel('\theta_1'); % Contour plot

figure;

% Plot J_vals as contours spaced logarithmically between 0.01 and

contour(theta0_vals, theta1_vals, J_vals, logspace(-, , ))%画出等高线

xlabel('\theta_0'); ylabel('\theta_1');%类似于转义字符,但是最多只能是到参数0~

参考资料:

二、Linear Regression 练习(转载)的更多相关文章

- 转载 Deep learning:二(linear regression练习)

前言 本文是多元线性回归的练习,这里练习的是最简单的二元线性回归,参考斯坦福大学的教学网http://openclassroom.stanford.edu/MainFolder/DocumentPag ...

- 转载 Deep learning:三(Multivariance Linear Regression练习)

前言: 本文主要是来练习多变量线性回归问题(其实本文也就3个变量),参考资料见网页:http://openclassroom.stanford.edu/MainFolder/DocumentPage. ...

- [UFLDL] Linear Regression & Classification

博客内容取材于:http://www.cnblogs.com/tornadomeet/archive/2012/06/24/2560261.html Deep learning:六(regulariz ...

- 机器学习 (二) 多变量线性回归 Linear Regression with Multiple Variables

文章内容均来自斯坦福大学的Andrew Ng教授讲解的Machine Learning课程,本文是针对该课程的个人学习笔记,如有疏漏,请以原课程所讲述内容为准.感谢博主Rachel Zhang 的个人 ...

- 线性回归、梯度下降(Linear Regression、Gradient Descent)

转载请注明出自BYRans博客:http://www.cnblogs.com/BYRans/ 实例 首先举个例子,假设我们有一个二手房交易记录的数据集,已知房屋面积.卧室数量和房屋的交易价格,如下表: ...

- ISLR系列:(1)线性回归 Linear Regression

Linear Regression 此博文是 An Introduction to Statistical Learning with Applications in R 的系列读书笔记,作为本 ...

- 机器学习经典算法具体解释及Python实现--线性回归(Linear Regression)算法

(一)认识回归 回归是统计学中最有力的工具之中的一个. 机器学习监督学习算法分为分类算法和回归算法两种,事实上就是依据类别标签分布类型为离散型.连续性而定义的. 顾名思义.分类算法用于离散型分布预測, ...

- 贝叶斯线性回归(Bayesian Linear Regression)

贝叶斯线性回归(Bayesian Linear Regression) 2016年06月21日 09:50:40 Duanxx 阅读数 54254更多 分类专栏: 监督学习 版权声明:本文为博主原 ...

- Multivariance Linear Regression练习

%% 方法一:梯度下降法 x = load('E:\workstation\data\ex3x.dat'); y = load('E:\workstation\data\ex3y.dat'); x = ...

随机推荐

- 14 Zabbix Item类型之Simple checks类型

点击返回:自学Zabbix之路 点击返回:自学Zabbix4.0之路 点击返回:自学zabbix集锦 14 Zabbix Item类型之Simple checks类型 Simple checks通常用 ...

- 自学Zabbix2.4-web页面配置zabbix

点击返回:自学Zabbix之路 ....

- UVALive - 6439(思维题)

题目链接:https://vjudge.net/contest/241341#problem/F 题目大意:给你一个字符串,你可以用任意单个字符代替其中的一个子串,使它形成一个回文串,要求形成的回文串 ...

- Ubuntu无法进入Windows的NTFS分区

在Ubuntu进入NTFS分区出现问题,无法访问. 不能访问 新加卷 Error mounting /dev/sda8 at /media/zhuxiaoxi/新加卷: Command-line `m ...

- STL总结

容器类放入的都是元素的拷贝,而非引用.所以如果需要对元素做出改动,最好是把元素存在data[N]数组中,而仅仅在容器中存放数组下标. 函数传递容器类参数时,需要传引用,否则会超时. vector ve ...

- python之配置日志的几种方式

作为开发者,我们可以通过以下3种方式来配置logging: 1)使用Python代码显式的创建loggers, handlers和formatters并分别调用它们的配置函数: 2)创建一个日志配置文 ...

- win10下通过Anaconda安装TensorFlow-GPU1.3版本,并配置pycharm运行Mnist手写识别程序

折腾了一天半终于装好了win10下的TensorFlow-GPU版,在这里做个记录. 准备安装包: visual studio 2015: Anaconda3-4.2.0-Windows-x86_64 ...

- 高效的SQLSERVER分页查询

Sqlserver数据库分页查询一直是Sqlserver的短板,闲来无事,想出几种方法,假设有表ARTICLE,字段ID.YEAR...(其他省略),数据53210条(客户真实数据,量不大),分页查询 ...

- python小demo-01: 线程池+多进程实现cpu密集型操作

起因: 公司有一个小项目,大概逻辑如下: 服务器A会不断向队列中push消息,消息主要内容是视频的地址,服务器B则需要不断从队列中pop消息,然后将该视频进行剪辑最终将剪辑后的视频保存到云服务器.个人 ...

- Python全栈问答小技巧_2

Python全栈测试题(二) 作者:尹正杰 声明:答案如有偏差,欢迎指正!欢迎加入高级运维工程师之路:598432640 本文答题用的Python版本是:Python 3.5.2,请知晓! 1. 计算 ...