深度理解select、poll和epoll

在linux 没有实现epoll事件驱动机制之前,我们一般选择用select或者poll等IO多路复用的方法来实现并发服务程序。在大数据、高并发、集群等一些名词唱得火热之年代,select和poll的用武之地越来越有限,风头已经被epoll占尽。

select()和poll() IO多路复用模型

select的缺点:

- 单个进程能够监视的文件描述符的数量存在最大限制,通常是1024,当然可以更改数量,但由于select采用轮询的方式扫描文件描述符,文件描述符数量越多,性能越差;(在linux内核头文件中,有这样的定义:

#define __FD_SETSIZE 1024) - 内核 / 用户空间内存拷贝问题,select需要复制大量的句柄数据结构,产生巨大的开销;

- select返回的是含有整个句柄的数组,应用程序需要遍历整个数组才能发现哪些句柄发生了事件;

- select的触发方式是水平触发,应用程序如果没有完成对一个已经就绪的文件描述符进行IO操作,那么之后每次select调用还是会将这些文件描述符通知进程。

相比select模型,poll使用链表保存文件描述符,因此没有了监视文件数量的限制,但其他三个缺点依然存在。

拿select模型为例,假设我们的服务器需要支持100万的并发连接,则在__FD_SETSIZE 为1024的情况下,则我们至少需要开辟1k个进程才能实现100万的并发连接。除了进程间上下文切换的时间消耗外,从内核/用户空间大量的无脑内存拷贝、数组轮询等,是系统难以承受的。因此,基于select模型的服务器程序,要达到10万级别的并发访问,是一个很难完成的任务。

因此,该epoll上场了。

epoll IO多路复用模型实现机制

由于epoll的实现机制与select/poll机制完全不同,上面所说的 select的缺点在epoll上不复存在。

设想一下如下场景:有100万个客户端同时与一个服务器进程保持着TCP连接。而每一时刻,通常只有几百上千个TCP连接是活跃的(事实上大部分场景都是这种情况)。如何实现这样的高并发?

epoll的设计和实现与select完全不同。epoll通过在Linux内核中申请一个简易的文件系统(文件系统一般用什么数据结构实现?B+树)。把原先的select/poll调用分成了3个部分:

- 调用epoll_create()建立一个epoll对象(在epoll文件系统中为这个句柄对象分配资源)

- 调用epoll_ctl向epoll对象中添加这100万个连接的套接字

- 调用epoll_wait收集发生的事件的连接

如此一来,要实现上面说是的场景,只需要在进程启动时建立一个epoll对象,然后在需要的时候向这个epoll对象中添加或者删除连接。同时,epoll_wait的效率也非常高,因为调用epoll_wait时,并没有一股脑的向操作系统复制这100万个连接的句柄数据,内核也不需要去遍历全部的连接。

下面来看看Linux内核具体的epoll机制实现思路。

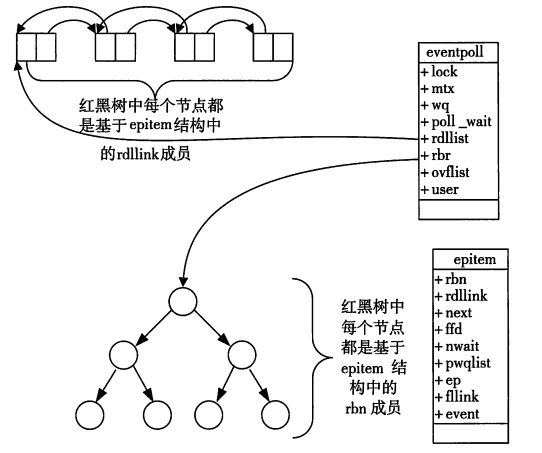

当某一进程调用epoll_create方法时,Linux内核会创建一个eventpoll结构体,这个结构体中有两个成员与epoll的使用方式密切相关。eventpoll结构体如下所示:

struct eventpoll{

....

/*红黑树的根节点,这颗树中存储着所有添加到epoll中的需要监控的事件*/

struct rb_root rbr;

/*双链表中则存放着将要通过epoll_wait返回给用户的满足条件的事件*/

struct list_head rdlist;

....

};

每一个epoll对象都有一个独立的eventpoll结构体,用于存放通过epoll_ctl方法向epoll对象中添加进来的事件。这些事件都会挂载在红黑树中,如此,重复添加的事件就可以通过红黑树而高效的识别出来(红黑树的插入时间效率是lgn,其中n为树的高度)。

而所有添加到epoll中的事件都会与设备(网卡)驱动程序建立回调关系,也就是说,当相应的事件发生时会调用这个回调方法。这个回调方法在内核中叫ep_poll_callback,它会将发生的事件添加到rdlist双链表中。

在epoll中,对于每一个事件,都会建立一个epitem结构体,如下所示:

struct epitem{

struct rb_node rbn;//红黑树节点

struct list_head rdllink;//双向链表节点

struct epoll_filefd ffd; //事件句柄信息

struct eventpoll *ep; //指向其所属的eventpoll对象

struct epoll_event event; //期待发生的事件类型

}

当调用epoll_wait检查是否有事件发生时,只需要检查eventpoll对象中的rdlist双链表中是否有epitem元素即可。如果rdlist不为空,则把发生的事件复制到用户态,同时将事件数量返回给用户。

从上面的讲解可知:通过红黑树和双链表数据结构,并结合回调机制,造就了epoll的高效。

OK,讲解完了Epoll的机理,我们便能很容易掌握epoll的用法了。一句话描述就是:三步曲。

- epoll_create()系统调用。此调用返回一个句柄,之后所有的使用都依靠这个句柄来标识。

- epoll_ctl()系统调用。通过此调用向epoll对象中添加、删除、修改感兴趣的事件,返回0标识成功,返回-1表示失败。

- epoll_wait()系统调用。通过此调用收集收集在epoll监控中已经发生的事件。

最后,附上一个epoll编程实例。(作者为sparkliang)

//

// a simple echo server using epoll in linux

//

// 2009-11-05

// 2013-03-22:修改了几个问题,1是/n格式问题,2是去掉了原代码不小心加上的ET模式;

// 本来只是简单的示意程序,决定还是加上 recv/send时的buffer偏移

// by sparkling

//

#include <sys/socket.h>

#include <sys/epoll.h>

#include <netinet/in.h>

#include <arpa/inet.h>

#include <fcntl.h>

#include <unistd.h>

#include <stdio.h>

#include <errno.h>

#include <iostream>

using namespace std;

#define MAX_EVENTS 500

struct myevent_s

{

int fd;

void (*call_back)(int fd, int events, void *arg);

int events;

void *arg;

int status; // 1: in epoll wait list, 0 not in

char buff[128]; // recv data buffer

int len, s_offset;

long last_active; // last active time

};

// set event

void EventSet(myevent_s *ev, int fd, void (*call_back)(int, int, void*), void *arg)

{

ev->fd = fd;

ev->call_back = call_back;

ev->events = 0;

ev->arg = arg;

ev->status = 0;

bzero(ev->buff, sizeof(ev->buff));

ev->s_offset = 0;

ev->len = 0;

ev->last_active = time(NULL);

}

// add/mod an event to epoll

void EventAdd(int epollFd, int events, myevent_s *ev)

{

struct epoll_event epv = {0, {0}};

int op;

epv.data.ptr = ev;

epv.events = ev->events = events;

if(ev->status == 1){

op = EPOLL_CTL_MOD;

}

else{

op = EPOLL_CTL_ADD;

ev->status = 1;

}

if(epoll_ctl(epollFd, op, ev->fd, &epv) < 0)

printf("Event Add failed[fd=%d], evnets[%d]\n", ev->fd, events);

else

printf("Event Add OK[fd=%d], op=%d, evnets[%0X]\n", ev->fd, op, events);

}

// delete an event from epoll

void EventDel(int epollFd, myevent_s *ev)

{

struct epoll_event epv = {0, {0}};

if(ev->status != 1) return;

epv.data.ptr = ev;

ev->status = 0;

epoll_ctl(epollFd, EPOLL_CTL_DEL, ev->fd, &epv);

}

int g_epollFd;

myevent_s g_Events[MAX_EVENTS+1]; // g_Events[MAX_EVENTS] is used by listen fd

void RecvData(int fd, int events, void *arg);

void SendData(int fd, int events, void *arg);

// accept new connections from clients

void AcceptConn(int fd, int events, void *arg)

{

struct sockaddr_in sin;

socklen_t len = sizeof(struct sockaddr_in);

int nfd, i;

// accept

if((nfd = accept(fd, (struct sockaddr*)&sin, &len)) == -1)

{

if(errno != EAGAIN && errno != EINTR)

{

}

printf("%s: accept, %d", __func__, errno);

return;

}

do

{

for(i = 0; i < MAX_EVENTS; i++)

{

if(g_Events[i].status == 0)

{

break;

}

}

if(i == MAX_EVENTS)

{

printf("%s:max connection limit[%d].", __func__, MAX_EVENTS);

break;

}

// set nonblocking

int iret = 0;

if((iret = fcntl(nfd, F_SETFL, O_NONBLOCK)) < 0)

{

printf("%s: fcntl nonblocking failed:%d", __func__, iret);

break;

}

// add a read event for receive data

EventSet(&g_Events[i], nfd, RecvData, &g_Events[i]);

EventAdd(g_epollFd, EPOLLIN, &g_Events[i]);

}while(0);

printf("new conn[%s:%d][time:%d], pos[%d]\n", inet_ntoa(sin.sin_addr),

ntohs(sin.sin_port), g_Events[i].last_active, i);

}

// receive data

void RecvData(int fd, int events, void *arg)

{

struct myevent_s *ev = (struct myevent_s*)arg;

int len;

// receive data

len = recv(fd, ev->buff+ev->len, sizeof(ev->buff)-1-ev->len, 0);

EventDel(g_epollFd, ev);

if(len > 0)

{

ev->len += len;

ev->buff[len] = '\0';

printf("C[%d]:%s\n", fd, ev->buff);

// change to send event

EventSet(ev, fd, SendData, ev);

EventAdd(g_epollFd, EPOLLOUT, ev);

}

else if(len == 0)

{

close(ev->fd);

printf("[fd=%d] pos[%d], closed gracefully.\n", fd, ev-g_Events);

}

else

{

close(ev->fd);

printf("recv[fd=%d] error[%d]:%s\n", fd, errno, strerror(errno));

}

}

// send data

void SendData(int fd, int events, void *arg)

{

struct myevent_s *ev = (struct myevent_s*)arg;

int len;

// send data

len = send(fd, ev->buff + ev->s_offset, ev->len - ev->s_offset, 0);

if(len > 0)

{

printf("send[fd=%d], [%d<->%d]%s\n", fd, len, ev->len, ev->buff);

ev->s_offset += len;

if(ev->s_offset == ev->len)

{

// change to receive event

EventDel(g_epollFd, ev);

EventSet(ev, fd, RecvData, ev);

EventAdd(g_epollFd, EPOLLIN, ev);

}

}

else

{

close(ev->fd);

EventDel(g_epollFd, ev);

printf("send[fd=%d] error[%d]\n", fd, errno);

}

}

void InitListenSocket(int epollFd, short port)

{

int listenFd = socket(AF_INET, SOCK_STREAM, 0);

fcntl(listenFd, F_SETFL, O_NONBLOCK); // set non-blocking

printf("server listen fd=%d\n", listenFd);

EventSet(&g_Events[MAX_EVENTS], listenFd, AcceptConn, &g_Events[MAX_EVENTS]);

// add listen socket

EventAdd(epollFd, EPOLLIN, &g_Events[MAX_EVENTS]);

// bind & listen

sockaddr_in sin;

bzero(&sin, sizeof(sin));

sin.sin_family = AF_INET;

sin.sin_addr.s_addr = INADDR_ANY;

sin.sin_port = htons(port);

bind(listenFd, (const sockaddr*)&sin, sizeof(sin));

listen(listenFd, 5);

}

int main(int argc, char **argv)

{

unsigned short port = 12345; // default port

if(argc == 2){

port = atoi(argv[1]);

}

// create epoll

g_epollFd = epoll_create(MAX_EVENTS);

if(g_epollFd <= 0) printf("create epoll failed.%d\n", g_epollFd);

// create & bind listen socket, and add to epoll, set non-blocking

InitListenSocket(g_epollFd, port);

// event loop

struct epoll_event events[MAX_EVENTS];

printf("server running:port[%d]\n", port);

int checkPos = 0;

while(1){

// a simple timeout check here, every time 100, better to use a mini-heap, and add timer event

long now = time(NULL);

for(int i = 0; i < 100; i++, checkPos++) // doesn't check listen fd

{

if(checkPos == MAX_EVENTS) checkPos = 0; // recycle

if(g_Events[checkPos].status != 1) continue;

long duration = now - g_Events[checkPos].last_active;

if(duration >= 60) // 60s timeout

{

close(g_Events[checkPos].fd);

printf("[fd=%d] timeout[%d--%d].\n", g_Events[checkPos].fd, g_Events[checkPos].last_active, now);

EventDel(g_epollFd, &g_Events[checkPos]);

}

}

// wait for events to happen

int fds = epoll_wait(g_epollFd, events, MAX_EVENTS, 1000);

if(fds < 0){

printf("epoll_wait error, exit\n");

break;

}

for(int i = 0; i < fds; i++){

myevent_s *ev = (struct myevent_s*)events[i].data.ptr;

if((events[i].events&EPOLLIN)&&(ev->events&EPOLLIN)) // read event

{

ev->call_back(ev->fd, events[i].events, ev->arg);

}

if((events[i].events&EPOLLOUT)&&(ev->events&EPOLLOUT)) // write event

{

ev->call_back(ev->fd, events[i].events, ev->arg);

}

}

}

// free resource

return 0;

}

深度理解select、poll和epoll的更多相关文章

- Linux下select, poll和epoll IO模型的详解

http://blog.csdn.net/tianmohust/article/details/6677985 一).Epoll 介绍 Epoll 可是当前在 Linux 下开发大规模并发网络程序的热 ...

- I/O复用中的 select poll 和 epoll

I/O复用中的 select poll 和 epoll: 这里有一些不错的资料: I/O多路复用技术之select模型: http://blog.csdn.net/nk_test/article/de ...

- (转)Linux下select, poll和epoll IO模型的详解

Linux下select, poll和epoll IO模型的详解 原文:http://blog.csdn.net/tianmohust/article/details/6677985 一).Epoll ...

- linux select poll and epoll

这里以socket文件来阐述它们之间的区别,假设现在服务器端有100 000个连接,即已经创建了100 000个socket. 1 select和poll 在我们的线程中,我们会弄一个死循环,在循环里 ...

- Select,poll,epoll复用

Select,poll,epoll复用 1)select模块以列表的形式接受四个参数,分别是可读对象,可写对象,产生异常的对象,和超时设置.当监控符对象发生变化时,select会返回发生变化的对象列表 ...

- 聊聊select, poll 和 epoll

聊聊select, poll 和 epoll 假设项目上需要实现一个TCP的客户端和服务器从而进行跨机器的数据收发,我们很可能翻阅一些资料,然后写出如下的代码. 服务端 void func(int s ...

- select poll和 epoll

select .poll.epoll 都是多路io复用的机制,i/o多路复用就通过一种机制,可以监视多个描述符,一旦某个描述符就绪(一般是读就绪或者写就绪),能够通知乡音的程序进行相应的读写操作.但s ...

- 1 select,poll和epoll

其实所有的I/O都是轮询的方法,只不过实现的层面不同罢了. 基本上select有3个缺点: 连接数受限 查找配对速度慢 数据由内核拷贝到用户态 poll改善了第一个缺点 epoll改了三个缺点. se ...

- select poll和epoll

select poll epoll都是IO多路复用机制.这里的复用其实可以理解为复用的线程,即一个(或者较少的)线程完成多个IO的读写.这里总结下这三个函数的区别. 1 select 1.1 sele ...

随机推荐

- 使用jdk的keytool 生成CA证书的方法

一.CA证书生成设置总共分为以下5步: 步骤: 1.根据java的keytool生成CA根证书,放在服务器 2.根据服务器CA根证书导出客户端证书 3.tomcat增加SSL配置 4.客户端IE浏览器 ...

- 配置文件热加载的go语言实现

通常我们更新应用程序的配置文件,都需要手动重启程序或手动重新加载配置.假设一组服务部署在10台机器上,你需要借助批量运维工具执行重启命令,而且10台同时重启可能还会造成服务短暂不可用.要是更新配置后, ...

- 进程间通信IPC-管道

管道是UNIX系统IPC的最古老的形式,所有的UNIX系统都提供此通讯机制.管道有以下两种局限性: 1, 历史上,它们是半双工的(即数据只能在一个方向上流动).现在某些系统提供了全双工管道,但是为了最 ...

- Django 学习笔记(三) --- HTML 模版加载 css、js、img 静态文件

人生苦短 ~ Tips:仅适用于 Python 3+(反正差别不大,py2 改改也能用).因为据 Python 之父 Guido van Rossum 说会在 2020 年停止对 Python 2 的 ...

- .Net Core中的日志组件(Logging)

1.介绍 Logging组件是微软实现的日志记录组件包括控制台(Console).调试(Debug).事件日志(EventLog)和TraceSource,但是没有实现最常用用的文件记录日志功能(可以 ...

- Mybatis缓存(1)--------系统缓存及简单配置介绍

前言 Mybatis的缓存主要有两种: 系统缓存,也就是我们一级缓存与二级缓存: 自定义的缓存,比如Redis.Enhance等,需要额外的单独配置与实现,具体日后主要学习介绍. 在这里主要记录系统缓 ...

- ssh隧道的妙用

场景说明:A主机和B主机在同一个园区网,A主机可以出公网,B主机不可以出公网.渗透工程师已经拿下A主机控制权. 一.如何在外网访问到B主机 方案:ssh本地端口映射背景:当我们拿下A主机之后想和B主机 ...

- 新建 .NET Core 控制台项目

1. 安装 .NET Core SDK 1.0 参考微软官方网站 https://www.microsoft.com/net/download/windows 2. 打开命令提示符:输入以下代码验证S ...

- NPOI 通过excel模板写入数据并导出

private void ToExcel(string id) { //模板文件 string TempletFileName = Server.MapPath("template.xls& ...

- 【原】Spring AOP实现对Redis的缓存同步

前言:刚开始采用spring cache作为缓存数据,到后面发现扩展性不灵活,于是基于sprig cache原理自定义一套规则用于缓存数据. 请求过程: 根据请求参数生成Key,后面我们会对生成Key ...