机器学习中的权重衰退 —— 深度学习中的权重衰退 —— 权重衰退 —— weight decay

在看代码时看到了这个概念,以前虽然也看到过但是没有太在意,再次看到于是研究了一下。

引自:

https://sota.jiqizhixin.com/models/methods/0bdb8f87-9c05-483e-af49-e1140b9e7d19

直接说答案,weight decay 就是L2 Regularization 。

引自:

https://www.jianshu.com/p/995516301b0a

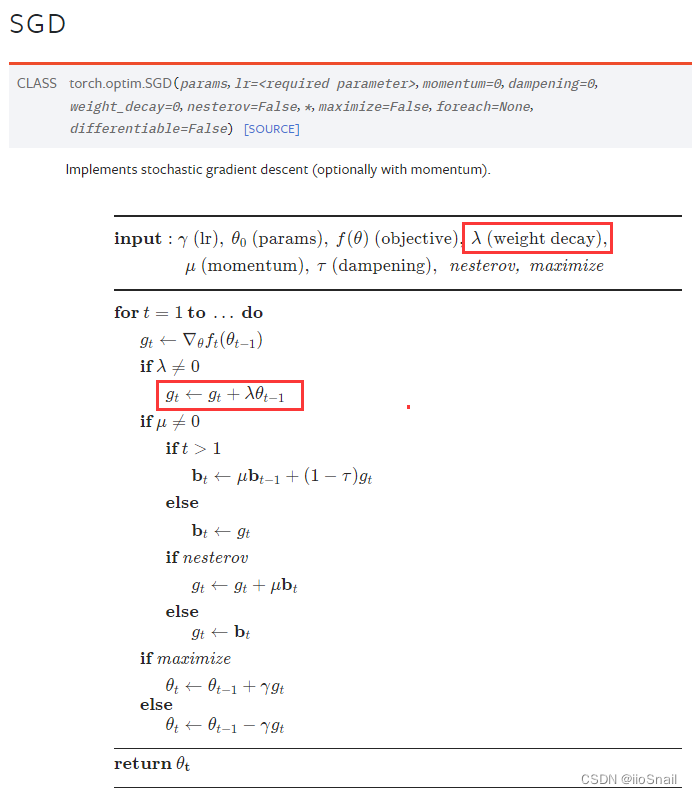

其实在深度学习框架中的优化器参数中就可以设置weight decay,如:

============================================

引自:

https://blog.csdn.net/zhaohongfei_358/article/details/129625803

weight_decay的一些trick:

- weight_decay并没有你想想中的那么好,它的效果可能只有一点点,不要太指望它。尤其是当你的模型很复杂时,权重衰退的效果可能会更小了。

- 通常取1e-3,如果要尝试的话,一般也就是1e-2, 1e-3, 1e-4 这些选项。

- 权重衰退通常不对bias做。但通常bias做不做权重衰退其实效果差不多,不过最好不要做。

- weight_decay取值越大,对抑制模型的强度越大。但这并不说明越大越好,太大的话,可能会导致模型欠拟合。

============================================

给出chainer框架中的实现:(不对bias进行decay,只对weight进行decay)

地址:

https://github.com/chainer/chainerrl/blob/master/chainerrl/optimizers/nonbias_weight_decay.py

class NonbiasWeightDecay(object):

"""Weight decay only for non-bias parameters.

This hook can be used just like chainer.optimizer_hooks.WeightDecay except

that this hook does not apply weight decay to bias parameters.

This hook assumes that all the bias parameters have the name of "b". Any

parameter whose name is "b" is considered as a bias and excluded from

weight decay.

"""

name = 'NonbiasWeightDecay'

call_for_each_param = True

timing = 'pre'

def __init__(self, rate):

self.rate = rate

def __call__(self, rule, param):

if param.name == 'b':

return

p, g = param.array, param.grad

if p is None or g is None:

return

with cuda.get_device_from_array(p) as dev:

if int(dev) == -1:

g += self.rate * p

else:

kernel = cuda.elementwise(

'T p, T decay', 'T g', 'g += decay * p', 'weight_decay')

kernel(p, self.rate, g)

def add_hook(self, hook, name=None, timing='auto'):

"""Adds a hook function. The hook function is called before or after any updates (see the timing

attribute). Args:

hook (callable): Hook function to be added. It takes two

arguments: the update rule object and the parameter variable.

name (str): Name of the hook function. The name attribute of the

hook function is used by default.

timing (str): Specifies when the hook is called. If 'auto', the

timimg property of the hook will decide the timing.

If 'pre', the hook will be called before any updates.

If 'post', the hook will be called after any updates.

If 'auto' and the timing property of the hook is not

available, timing will default to 'pre'. """

if not callable(hook):

raise TypeError('hook function must be callable')

if timing not in ('pre', 'post', 'auto'):

raise ValueError("timing must be one of ('pre', 'post', 'auto')")

if timing == 'auto':

timing = getattr(hook, 'timing', 'pre') if name is None:

name = getattr(hook, 'name', getattr(hook, '__name__', None))

if name is None:

raise ValueError(

'the name of the hook function is not specified')

if name in self._pre_update_hooks or name in self._post_update_hooks:

raise ValueError('hook "{}" already exists'.format(name)) if timing == 'pre':

self._pre_update_hooks[name] = hook

else:

self._post_update_hooks[name] = hook def remove_hook(self, name):

"""Removes the specified hook function. Args:

name (str): Name of the hook function to be removed. The hook

function registered with this name will be removed. """

try:

del self._pre_update_hooks[name]

except KeyError:

del self._post_update_hooks[name] def update(self, param):

"""Invokes hook functions and updates the parameter. Args:

param (~chainer.Variable): Variable to be updated. """

if not self.enabled:

return self.t += 1 if self._use_fp32_update and param.dtype == numpy.float16:

if self._fp32_param is None:

self._fp32_param = variable.Variable(

param.array.astype(numpy.float32),

name=param.name)

fp32_param = self._fp32_param

fp32_param.grad = param.grad.astype(numpy.float32) if fp32_param.data is not None:

self._prepare(fp32_param)

if param._loss_scale is not None:

fp32_param.grad /= param._loss_scale

for hook in six.itervalues(self._pre_update_hooks):

hook(self, fp32_param)

self.update_core(fp32_param)

for hook in six.itervalues(self._post_update_hooks):

hook(self, fp32_param) param.data = fp32_param.data.astype(param.dtype)

fp32_param.grad = None

else:

if param.data is not None:

self._prepare(param)

if param._loss_scale is not None:

param.grad /= param._loss_scale

for hook in six.itervalues(self._pre_update_hooks):

hook(self, param)

self.update_core(param)

for hook in six.itervalues(self._post_update_hooks):

hook(self, param)

============================================

参考:

https://www.jianshu.com/p/995516301b0a

https://blog.csdn.net/zhaohongfei_358/article/details/129625803

机器学习中的权重衰退 —— 深度学习中的权重衰退 —— 权重衰退 —— weight decay的更多相关文章

- 机器学习之路:tensorflow 深度学习中 分类问题的损失函数 交叉熵

经典的损失函数----交叉熵 1 交叉熵: 分类问题中使用比较广泛的一种损失函数, 它刻画两个概率分布之间的距离 给定两个概率分布p和q, 交叉熵为: H(p, q) = -∑ p(x) log q( ...

- 深度学习中常见的 Normlization 及权重初始化相关知识(原理及公式推导)

Batch Normlization(BN) 为什么要进行 BN 防止深度神经网络,每一层得参数更新会导致上层的输入数据发生变化,通过层层叠加,高层的输入分布变化会十分剧烈,这就使得高层需要不断去重新 ...

- 深度学习中Dropout原理解析

1. Dropout简介 1.1 Dropout出现的原因 在机器学习的模型中,如果模型的参数太多,而训练样本又太少,训练出来的模型很容易产生过拟合的现象. 在训练神经网络的时候经常会遇到过拟合的问题 ...

- 卷积在深度学习中的作用(转自http://timdettmers.com/2015/03/26/convolution-deep-learning/)

卷积可能是现在深入学习中最重要的概念.卷积网络和卷积网络将深度学习推向了几乎所有机器学习任务的最前沿.但是,卷积如此强大呢?它是如何工作的?在这篇博客文章中,我将解释卷积并将其与其他概念联系起来,以帮 ...

- 深度学习中的Normalization模型

Batch Normalization(简称 BN)自从提出之后,因为效果特别好,很快被作为深度学习的标准工具应用在了各种场合.BN 大法虽然好,但是也存在一些局限和问题,诸如当 BatchSize ...

- [优化]深度学习中的 Normalization 模型

来源:https://www.chainnews.com/articles/504060702149.htm 机器之心专栏 作者:张俊林 Batch Normalization (简称 BN)自从提出 ...

- Hebye 深度学习中Dropout原理解析

1. Dropout简介 1.1 Dropout出现的原因 在机器学习的模型中,如果模型的参数太多,而训练样本又太少,训练出来的模型很容易产生过拟合的现象. 在训练神经网络的时候经常会遇到过拟合的问题 ...

- zz详解深度学习中的Normalization,BN/LN/WN

详解深度学习中的Normalization,BN/LN/WN 讲得是相当之透彻清晰了 深度神经网络模型训练之难众所周知,其中一个重要的现象就是 Internal Covariate Shift. Ba ...

- 模型汇总24 - 深度学习中Attention Mechanism详细介绍:原理、分类及应用

模型汇总24 - 深度学习中Attention Mechanism详细介绍:原理.分类及应用 lqfarmer 深度学习研究员.欢迎扫描头像二维码,获取更多精彩内容. 946 人赞同了该文章 Atte ...

- 深度学习中正则化技术概述(附Python代码)

欢迎大家关注我们的网站和系列教程:http://www.tensorflownews.com/,学习更多的机器学习.深度学习的知识! 磐石 介绍 数据科学研究者们最常遇见的问题之一就是怎样避免过拟合. ...

随机推荐

- 战66 WIN11 亮度热键 快捷键无效

型号:HP ZHAN 66 Pro A 14 G3. 用FN 调节音量是正常的,唯独亮度无效. 参考:怎样调节笔记本电脑屏幕亮度(惠普笔记本亮度调节快捷键失灵) | 说明书网 (shuomingshu ...

- C#.NET Rsa私钥加密公钥解密

在C#中,RSA私钥只能签名,不能加密,如果要加密,要借助BouncyCastle库. nuget 中引用 Portable.BouncyCastle. 工具类: RsaEncryptUtil usi ...

- Android开发基础——真机测试错误,ADB启动不了,程序安装不了,the connection to adb is down,INSTALL_CANCELED_BY_USER...

在Android开发中,无论是真机测试还是AVD测试,都会报出这些错误.在这里,我会详细说明一下怎么会出现这些错误的,然后要怎么样才能解决这些错误. 错误一: The connection to ad ...

- SpringBoot启动报错:Parameter 0 of method hmset in com.qcby.rbac.util.RedisUtils required a bean of type

SpringBoot启动报错,报错信息如下: 报错是由于A类中定义了含参数的构造函数,Spring自动构造和注入时未为该Bean传入参数,引起报错. 查了很多资料,最后发现,我是因为注释的时候没有把@ ...

- 天地图添加多个覆盖物,点击切换选中icon

天地图添加多个覆盖物,点击覆盖物,切换选中的icon,移除之前的icon,再次点击移除之前的... 这个是react写的,先是确定中心位置,然后渲染点位,添加覆盖物,选中icon的不同, 主要看 ...

- Arduino实现温湿度传感器以及数据上传到云(乐维互联)

0 准备材料 0.1 ESP-01S 引脚及定义 官方定义: 序号 pin 功能 1 GND 地线 2 IO0/GPIO0 工作模式选择:①悬空:Flash Boot,工作模式 ②下拉:UART Do ...

- typora markdown笔记

前言 此为个人markdown笔记,不定时更新. 正文 1. mermaid 使用 横向流程图 源码 graph LR a(起始)-->b(中间) b-->c1<-->d b- ...

- Centos7搭建Minio环境(配置开机自启)

Minio 添加环境变量 # 设置控制台账号 最少3位 export MINIO_ACCESS_KEY=admin # 设置密码 最少8位 export MINIO_SECRET_KEY=123456 ...

- TCP/UDP 协议和 HTTP/FTP/SMTP 协议之间的区别

前言 我们经常会听到HTTP协议.TCP/IP协议.UDP协议.Socket.Socket长连接.Socket连接池等字眼,然而它们之间的关系.区别及原理并不是所有人都能理解清楚. 计算机网络体系结构 ...

- go语言的基础语法

字符串数组 package main import ( "fmt" ) func main() { var str string str = "hello world&q ...