Spark-自定义排序

一、自定义排序规则-封装类

import org.apache.spark.rdd.RDD

import org.apache.spark.{SparkConf, SparkContext} /**

* 实现自定义的排序

*/

object MySort1 {

def main(args: Array[String]): Unit = {

//1.spark程序的入口

val conf: SparkConf = new SparkConf().setAppName("MySort1").setMaster("local[2]")

val sc: SparkContext = new SparkContext(conf) //2.创建数组

val girl: Array[String] = Array("Mary,18,80","Jenny,22,100","Joe,30,80","Tom,18,78") //3.转换RDD

val grdd1: RDD[String] = sc.parallelize(girl) //4.切分数据

val grdd2: RDD[Girl] = grdd1.map(line => {

val fields: Array[String] = line.split(",") //拿到每个属性

val name = fields(0)

val age = fields(1).toInt

val weight = fields(2).toInt //元组输出

//(name, age, weight)

new Girl(name, age, weight)

}) // val sorted: RDD[(String, String, Int)] = grdd2.sortBy(t => t._2, false)

// val r: Array[(String, String, Int)] = sorted.collect()

// println(r.toBuffer) val sorted: RDD[Girl] = grdd2.sortBy(s => s)

val r = sorted.collect()

println(r.toBuffer)

sc.stop()

}

} //自定义类 scala Ordered

class Girl(val name: String, val age: Int, val weight: Int) extends Ordered[Girl] with Serializable {

override def compare(that: Girl): Int = {

//如果年龄相同 体重重的往前排

if(this.age == that.age){

//如果正数 正序 负数 倒序

-(this.weight - that.weight)

}else{

//年龄小的往前排

this.age - that.age

} }

override def toString: String = s"名字:$name,年龄:$age,体重:$weight"

}

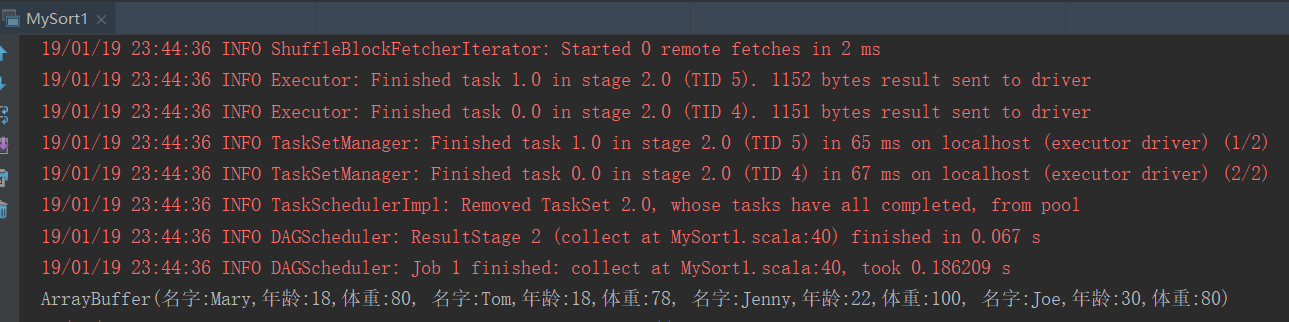

结果:

二、

二、

二、自定义排序规则-模式匹配

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.rdd.RDD

object MySort2 {

def main(args: Array[String]): Unit = {

//1.spark程序的入口

val conf: SparkConf = new SparkConf().setAppName("MySort2").setMaster("local[2]")

val sc: SparkContext = new SparkContext(conf)

//2.创建数组

val girl: Array[String] = Array("Mary,18,80","Jenny,22,100","Joe,30,80","Tom,18,78")

//3.转换RDD

val grdd1: RDD[String] = sc.parallelize(girl)

//4.切分数据

val grdd2: RDD[(String, Int, Int)] = grdd1.map(line => {

val fields: Array[String] = line.split(",")

//拿到每个属性

val name = fields(0)

val age = fields(1).toInt

val weight = fields(2).toInt

//元组输出

(name, age, weight)

})

//5.模式匹配方式进行排序

val sorted = grdd2.sortBy(s => Girl2(s._1, s._2, s._3))

val r = sorted.collect()

println(r.toBuffer)

sc.stop()

}

}

//自定义类 scala Ordered

case class Girl2(val name: String, val age: Int, val weight: Int) extends Ordered[Girl2] {

override def compare(that: Girl2): Int = {

//如果年龄相同 体重重的往前排

if(this.age == that.age){

//如果正数 正序 负数 倒序

-(this.weight - that.weight)

}else{

//年龄小的往前排

this.age - that.age

}

}

override def toString: String = s"名字:$name,年龄:$age,体重:$weight"

}

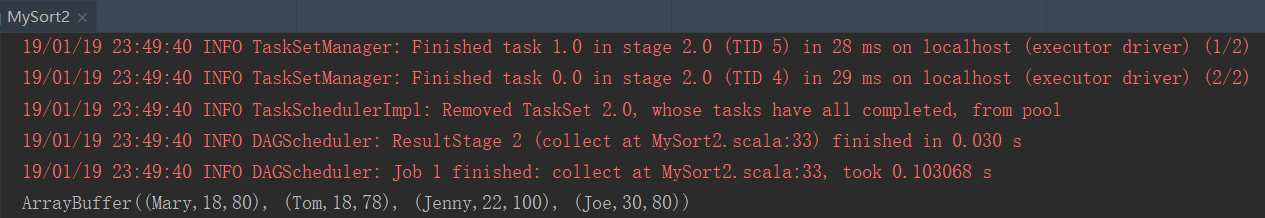

结果:

三、

三、

三、自定义排序规则-隐式转换

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.rdd.RDD

//定义一个专门处理隐式的类

object ImplicitRules {

//定义隐式规则

implicit object OrderingGirl extends Ordering[Girl1]{

override def compare(x: Girl1, y: Girl1): Int = {

if(x.age == y.age){

//体重重的往前排

-(x.weight - y.weight)

}else{

//年龄小的往前排

x.age - y.age

}

}

}

}

object MySort3 {

def main(args: Array[String]): Unit = {

//1.spark程序的入口

val conf: SparkConf = new SparkConf().setAppName("MySort3").setMaster("local[2]")

val sc: SparkContext = new SparkContext(conf)

//2.创建数组

val girl: Array[String] = Array("Mary,18,80","Jenny,22,100","Joe,30,80","Tom,18,78")

//3.转换RDD

val grdd1: RDD[String] = sc.parallelize(girl)

//4.切分数据

val grdd2 = grdd1.map(line => {

val fields: Array[String] = line.split(",")

//拿到每个属性

val name = fields(0)

val age = fields(1).toInt

val weight = fields(2).toInt

//元组输出

(name, age, weight)

})

import ImplicitRules.OrderingGirl

val sorted = grdd2.sortBy(s => Girl1(s._1, s._2, s._3))

val r = sorted.collect()

println(r.toBuffer)

sc.stop()

}

}

//自定义类 scala Ordered

case class Girl1(val name: String, val age: Int, val weight: Int)

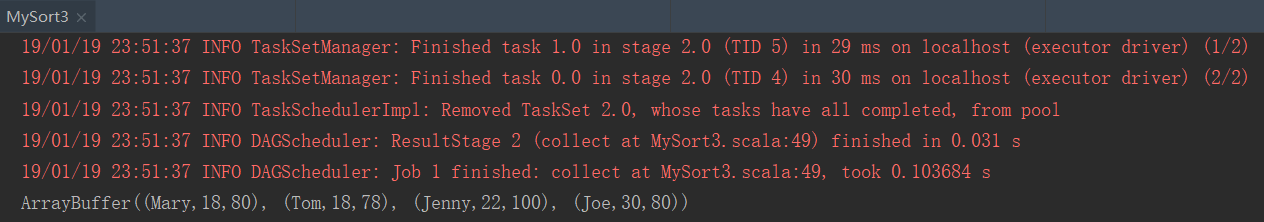

结果:

Spark-自定义排序的更多相关文章

- Spark(三)【RDD中的自定义排序】

在RDD中默认的算子sortBy,sortByKey只能真的值类型数据升序或者降序 现需要对自定义对象进行自定义排序. 一组Person对象 /** * Person 样例类 * @param nam ...

- 大数据学习day22------spark05------1. 学科最受欢迎老师解法补充 2. 自定义排序 3. spark任务执行过程 4. SparkTask的分类 5. Task的序列化 6. Task的多线程问题

1. 学科最受欢迎老师解法补充 day21中该案例的解法四还有一个问题,就是当各个老师受欢迎度是一样的时候,其排序规则就处理不了,以下是对其优化的解法 实现方式五 FavoriteTeacher5 p ...

- Spark基础排序+二次排序(java+scala)

1.基础排序算法 sc.textFile()).reduceByKey(_+_,).map(pair=>(pair._2,pair._1)).sortByKey(false).map(pair= ...

- spark高级排序彻底解秘

排序,真的非常重要! RDD.scala(源码) 在其,没有罗列排序,不是说它不重要! 1.基础排序算法实战 2.二次排序算法实战 3.更高级别排序算法 4.排序算法内幕解密 1.基础排序算法实战 启 ...

- 大数据学习day29-----spark09-------1. 练习: 统计店铺按月份的销售额和累计到该月的总销售额(SQL, DSL,RDD) 2. 分组topN的实现(row_number(), rank(), dense_rank()方法的区别)3. spark自定义函数-UDF

1. 练习 数据: (1)需求1:统计有过连续3天以上销售的店铺有哪些,并且计算出连续三天以上的销售额 第一步:将每天的金额求和(同一天可能会有多个订单) SELECT sid,dt,SUM(mone ...

- Java集合框架实现自定义排序

Java集合框架针对不同的数据结构提供了多种排序的方法,虽然很多时候我们可以自己实现排序,比如数组等,但是灵活的使用JDK提供的排序方法,可以提高开发效率,而且通常JDK的实现要比自己造的轮子性能更优 ...

- DataTable自定义排序

使用JQ DataTable 的时候,希望某列数据可以进行自定义排序,操作如下:(以中文排序和百分比排序为例) 1:定义排序类型: //百分率排序 jQuery.fn.dataTableExt.oSo ...

- 干货之UICollectionViewFlowLayout自定义排序和拖拽手势

使用UICollectionView,需要使用UICollectionViewLayout控制UICollectionViewCell布局,虽然UICollectionViewLayout提供了高度自 ...

- DataGridView 绑定List集合后实现自定义排序

这里只贴主要代码,dataList是已添加数据的全局变量,绑定数据源 datagridview1.DataSource = dataList,以下是核心代码. 实现点击列表头实现自定义排序 priva ...

- 【转】c++中Vector等STL容器的自定义排序

如果要自己定义STL容器的元素类最好满足STL容器对元素的要求 必须要求: 1.Copy构造函数 2.赋值=操作符 3.能够销毁对象的析构函数 另外: 1. ...

随机推荐

- LINUX网络之ifconfig命令与ping

ifconfig命令 网络配置 ifconfig命令被用于配置和显示Linux内核中网络接口的网络参数.用ifconfig命令配置的网卡信息,在网卡重启后机器重启后,配置就不存在.要想将上述的配置信息 ...

- 自定义 Core Data 迁移

本文转载至 http://objccn.io/issue-4-7/ 感谢本文作者 朱宏旭 的不啬分享 自定义 Core Data 迁移似乎是一个不太起眼的话题.苹果在这方面只提供了很少的文档,若是初次 ...

- [转]window下使用SetUnhandledExceptionFilter捕获让程序的崩溃

简单使用SetUnhandledExceptionFilter()函数让程序优雅崩溃 虽然是大公司的产品,QQ它还是会在我们的折腾下崩溃的,但是它总是崩溃的很优雅,还要弹出自己的对话框来结束.并且发送 ...

- Linux配置示例:配置java环境变量

1.修改/etc/profile文件 如果你的计算机仅仅作为开发使用时推荐使用这种方法,因为所有用户的shell都有权使用这些环境变量,可能会给系统带来安全性问题. (1)用文本编辑器打开/etc ...

- JSP基本用法(一)运行机制和语法

一.概述 JSP是一种建立在Servlet规范功能上的动态网页技术,在网页文件中嵌入Java代码和JSP标记用于产生动态内容. 本文简单介绍JSP的运行机制和JSP的语法. 二.JSP的运行机制 JS ...

- 详解SQL中的GROUP BY语句

下面为您介绍SQL语句中GROUP BY 语句,GROUP BY 语句用于结合合计函数,根据一个或多个列对结果集进行分组. 希望对您学习SQL语句有所帮助. SQL GROUP BY 语法 SELEC ...

- 【easyswoole】 解决安装报错

在使用swoole 创建项目时候,报错 创建命令 composer create-project easyswoole/app easyswoole 错误信息: 解决办法,切换composer 源 镜 ...

- DELPHIER,正转向PYTHON了

用了10多年的DELPHI ,现在准备学PYTHON了, 理由是: 1)现在是云计算时代了,需要学习一门适应该时代的语言,研究了很久,PYTHON是最佳选择,排除了PHP,PERL,RUBY等,至于G ...

- 【SpringBoot整合Elasticsearch】SpringBoot整合ElasticSearch

一.Linux下安装ElasticSearch 1.检测是否安装了Elasticsearch ps aux |grep elasticsearch 2.安装JDK 3.下载Elasticsearch ...

- GoldenGate的监控

1.进入GoldenGate安装目录,运行GGSCI,然后使用info all查看整体的运行状况 GGSCI (aix212) 1> info all Program Status Group ...