spark集成hbase与hive数据转换与代码练习

帮一个朋友写个样例,顺便练手啦~一直在做平台的各种事,但是代码后续还要精进啊。。。

import java.util.Date import org.apache.hadoop.hbase.HBaseConfiguration

import org.apache.hadoop.hbase.client.{Put, Scan, Result}

import org.apache.hadoop.hbase.io.ImmutableBytesWritable

import org.apache.hadoop.hbase.mapred.TableOutputFormat

import org.apache.hadoop.hbase.mapreduce.TableInputFormat

import org.apache.hadoop.hbase.util.Bytes

import org.apache.hadoop.mapred.JobConf

import org.apache.log4j.{Level, Logger}

import org.apache.spark.rdd.RDD

import org.apache.spark.sql.DataFrame

import org.apache.spark.sql.hive.HiveContext

import org.apache.spark.{SparkContext, SparkConf} /**

* Created by ysy on 2/10/17.

*/

object test { case class ysyTest(LS_certifier_no: String,loc: String,LS_phone_no: String) def main (args: Array[String]) {

val sparkConf = new SparkConf().setMaster("local").setAppName("ysy").set("spark.executor.memory", "1g")

val sc = new SparkContext(sparkConf)

val sqlContext = new HiveContext(sc)

sqlContext.sql("drop table pkq")

val columns = "LS_certifier_no,LS_location,LS_phone_no"

val hbaseRDD = dataInit(sc,"EVENT_LOG_LBS",columns).map(data =>{

val id =Bytes.toString(data._2.getValue("f1".getBytes, "LS_certifier_no".getBytes))

val loc = Bytes.toString(data._2.getValue("f1".getBytes, "LS_location".getBytes))

val phone = Bytes.toString(data._2.getValue("f1".getBytes, "LS_phone_no".getBytes))

(id,loc,phone)

})

val showData = hbaseRDD.foreach(println)

val datas = hbaseRDD.filter(_._1 != null).filter(_._2 != null).filter(_._3 != null)

val hiveDF = initHiveTableFromHbase(sc:SparkContext,sqlContext,datas)

writeHiveTableToHbase(sc,hiveDF) } def initHiveTableFromHbase(sc:SparkContext,sqlContext: HiveContext,hiveRDD:RDD[(String,String,String)]) : DataFrame = {

val hRDD = hiveRDD.map(p => ysyTest(p._1,p._2,p._3))

val hiveRDDSchema = sqlContext.createDataFrame(hiveRDD)

hiveRDDSchema.registerTempTable("pkq")

hiveRDDSchema.show(10)

hiveRDDSchema

} def dataInit(sc : SparkContext,tableName : String,columns : String) : RDD[(ImmutableBytesWritable,Result)] = {

val configuration = HBaseConfiguration.create()

configuration.addResource("hbase-site.xml")

configuration.set(TableInputFormat.INPUT_TABLE,tableName )

val scan = new Scan

val column = columns.split(",")

for(columnName <- column){

scan.addColumn("f1".getBytes(),columnName.getBytes())

}

val hbaseRDD = sc.newAPIHadoopRDD(configuration,classOf[TableInputFormat],classOf[org.apache.hadoop.hbase.io.ImmutableBytesWritable],classOf[org.apache.hadoop.hbase.client.Result])

System.out.println(hbaseRDD.count())

hbaseRDD

} def writeHiveTableToHbase(sc : SparkContext,hiveDF : DataFrame) = {

val configuration = HBaseConfiguration.create()

configuration.addResource("hbase-site.xml ")

configuration.set(TableOutputFormat.OUTPUT_TABLE,"EVENT_LOG_LBS")

val jobConf = new JobConf(configuration)

jobConf.setOutputFormat(classOf[TableOutputFormat]) val putData = hiveDF.map(data =>{

val LS_certifier_no = data(0)

val LS_location = data(1)

val LS_phone_no = data(2)

(LS_certifier_no,LS_location,LS_phone_no)

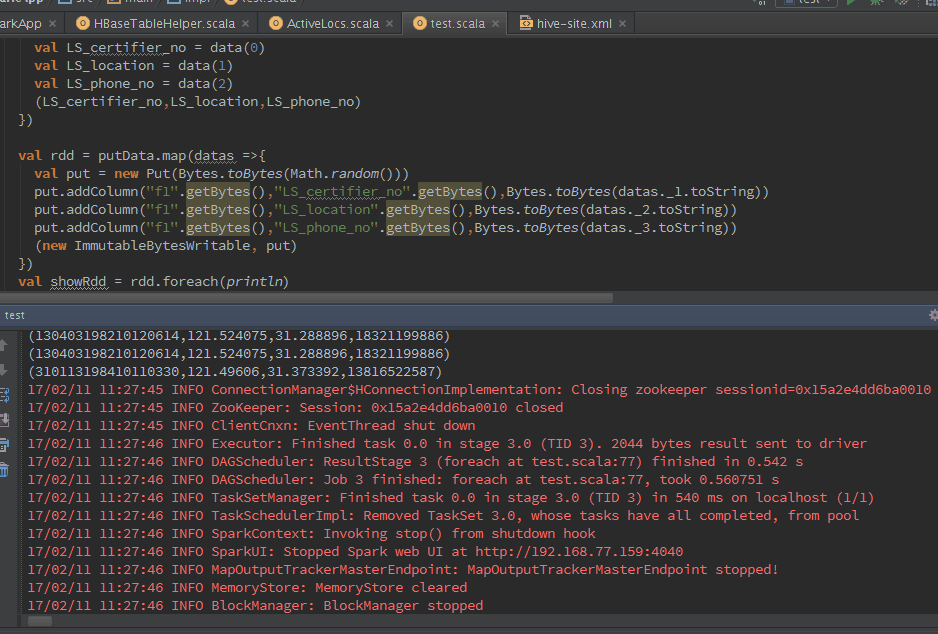

}) val rdd = putData.map(datas =>{

val put = new Put(Bytes.toBytes(Math.random()))

put.addColumn("f1".getBytes(),"LS_certifier_no".getBytes(),Bytes.toBytes(datas._1.toString))

put.addColumn("f1".getBytes(),"LS_location".getBytes(),Bytes.toBytes(datas._2.toString))

put.addColumn("f1".getBytes(),"LS_phone_no".getBytes(),Bytes.toBytes(datas._3.toString))

(new ImmutableBytesWritable, put)

})

val showRdd = rdd.foreach(println)

rdd.saveAsHadoopDataset(jobConf)

} }

spark集成hbase与hive数据转换与代码练习的更多相关文章

- 大数据学习系列之八----- Hadoop、Spark、HBase、Hive搭建环境遇到的错误以及解决方法

前言 在搭建大数据Hadoop相关的环境时候,遇到很多了很多错误.我是个喜欢做笔记的人,这些错误基本都记载,并且将解决办法也写上了.因此写成博客,希望能够帮助那些搭建大数据环境的人解决问题. 说明: ...

- Spark整合HBase,Hive

背景: 场景需求1:使用spark直接读取HBASE表 场景需求2:使用spark直接读取HIVE表 场景需求3:使用spark读取HBASE在Hive的外表 摘要: 1.背景 2.提交脚本 内容 场 ...

- spark集成hive遭遇mysql check失败的问题

问题: spark集成hive,启动spark-shell或者spark-sql的时候,报错: INFO MetaStoreDirectSql: MySQL check failed, assumin ...

- 大数据学习系列之九---- Hive整合Spark和HBase以及相关测试

前言 在之前的大数据学习系列之七 ----- Hadoop+Spark+Zookeeper+HBase+Hive集群搭建 中介绍了集群的环境搭建,但是在使用hive进行数据查询的时候会非常的慢,因为h ...

- HBASE与hive对比使用以及HBASE常用shell操作。与sqoop的集成

2.6.与 Hive 的集成2.6.1.HBase 与 Hive 的对比1) Hive(1) 数据仓库Hive 的本质其实就相当于将 HDFS 中已经存储的文件在 Mysql 中做了一个双射关系,以方 ...

- 大数据技术之_11_HBase学习_02_HBase API 操作 + HBase 与 Hive 集成 + HBase 优化

第6章 HBase API 操作6.1 环境准备6.2 HBase API6.2.1 判断表是否存在6.2.2 抽取获取 Configuration.Connection.Admin 对象的方法以及关 ...

- Hbase与hive集成与对比

HBase与Hive的对比 1.Hive (1) 数据仓库 Hive的本质其实就相当于将HDFS中已经存储的文件在Mysql中做了一个双射关系,以方便使用HQL去管理查询. (2) 用于数据分析.清洗 ...

- hbase与Hive的集成

1 HBase与Hive的对比 1.Hive (1) 数据仓库 Hive的本质其实就相当于将HDFS中已经存储的文件在Mysql中做了一个双射关系,以方便使用HQL去管理查询. (2) 用于数据分析. ...

- Hive集成HBase;安装pig

Hive集成HBase 配置 将hive的lib/中的HBase.jar包用实际安装的Hbase的jar包替换掉 cd /opt/hive/lib/ ls hbase-0.94.2* rm -rf ...

随机推荐

- libz.dylib

1. .dylib意味着这是一个动态链接库. 2. libz.dylib是提供zip压缩解压缩的库

- Schema与数据类型优化

良好的逻辑设计和物理设计是高性能的基石,应该根据系统将要执行的查询数据来设计schema,这往往需要权衡各种因素. MySQL支持的数据类型非常多,选择正确的数据类型对于获得高性能至关重要. 更小的通 ...

- [one day one question] Vue数组变更不能触发刷新

问题描述:Vue数组变更不能触发刷新,特别是数组的每个元素都是对象的时候,对象中某个属性的值发生变化,根本无法触发Vue的dom刷新,这怎么破? 解决方案:this.$set(array, index ...

- linux中操作java进程

通过 ps -ef|grep java 来得到真正运行的线程 通过kill -9 XXXXX来杀死正在运行的线程,其中XXXXX是上面java线程的序号. 另外还有2个指令我也不熟悉,一个是cat,一 ...

- Linux系统中调用短信猫发送短信(笔记)

1, 拷贝底层串口依赖的librxtxSerial.so到JDK安装路径cp librxtxSerial.so /usr/java/{0}/jre/lib/{1} # {0}: JDK的基础目录,例如 ...

- 【转】C++易混知识点5:实例讲解Public Protected Private作用域,继承的区别和用意

大学生涯,涉及到类的作用域,继承都是用的public 共有继承,当时也没想那么多,觉得共有继承多方便,多简单,反正没有太多的限制,不管是类的成员或者是基类的成员函数都可以访问.没有深究.其实这里面真是 ...

- redis数据类型-有序集合

有序集合类型 在集合类型的基础上有序集合类型为集合中的每个元素都关联了一个分数,这使得我们不仅可以完成插入.删除和判断元素是否存在等集合类型支持的操作,还能够获得分数最高(或最低)的前N个元素.获得指 ...

- 【视频编解码·学习笔记】5. NAL Unit 结构分析

在上篇笔记中通过一个小程序,可以提取NAL Unit所包含的的字节数据.H.264码流中的每一个NAL Unit的作用并不是相同的,而是根据不同的类型起不同的作用.下面将对NAL Unit中的数据进行 ...

- 使用CefSharp开发一个12306“安心刷票弹窗通知”工具

有需求就要改进 最近两年没有在春节回家过年了,主要是票太难买,虽然之前写了一个12306“无声购票弹窗”工具,解决了抢票问题,但是全家老小一起回去还是很累,干脆就在北京过年了.这两天突然有一个朋友问我 ...

- python之金融与量化分析

一.金融 二.ipython 基础功能 ipython 快捷键