Python 自动爬取B站视频

文件名自定义(文件格式为.py),脚本内容:

#!/usr/bin/env python

#-*-coding:utf-8-*-

import requests

import random

import time

def get_json(url):

headers = {

'User-Agent':

'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.100 Safari/537.36'

}

params = {

'page_size': 10,

'next_offset': str(num),

'tag': '今日热门',

'platform': 'pc'

}

try:

html = requests.get(url,params=params,headers=headers)

return html.json()

except BaseException:

print('request error')

pass

def download(url,path):

start = time.time() # 开始时间

size = 0

headers = {

'User-Agent':

'Mozilla/5.0 (X11; Linux x86_64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/69.0.3497.100 Safari/537.36'

}

response = requests.get(url,headers=headers,stream=True) # stream属性必须带上

chunk_size = 1024 # 每次下载的数据大小

content_size = int(response.headers['content-length']) # 总大小

if response.status_code == 200:

print('[文件大小]:%0.2f MB' %(content_size / chunk_size / 1024)) # 换算单位

with open(path,'wb') as file:

for data in response.iter_content(chunk_size=chunk_size):

file.write(data)

size += len(data) # 已下载的文件大小

if __name__ == '__main__':

for i in range(10):

url = 'http://api.vc.bilibili.com/board/v1/ranking/top?'

num = i*10 + 1

html = get_json(url)

infos = html['data']['items']

for info in infos:

title = info['item']['description'] # 小视频的标题

video_url = info['item']['video_playurl'] # 小视频的下载链接

print(title)

# 为了防止有些视频没有提供下载链接的情况

try:

download(video_url,path='videos/%s.mp4' %title)

print('成功下载一个!')

except BaseException:

print('凉凉,下载失败')

pass

time.sleep(int(format(random.randint(2,8)))) # 设置随机等待时间

爬取效果如下:

爬取的文件:

生成一个windows平台可执行exe程序

工具安装:pip install PyInstaller

生成exe程序:

pyinstaller -i test.ico -F Grasp.py

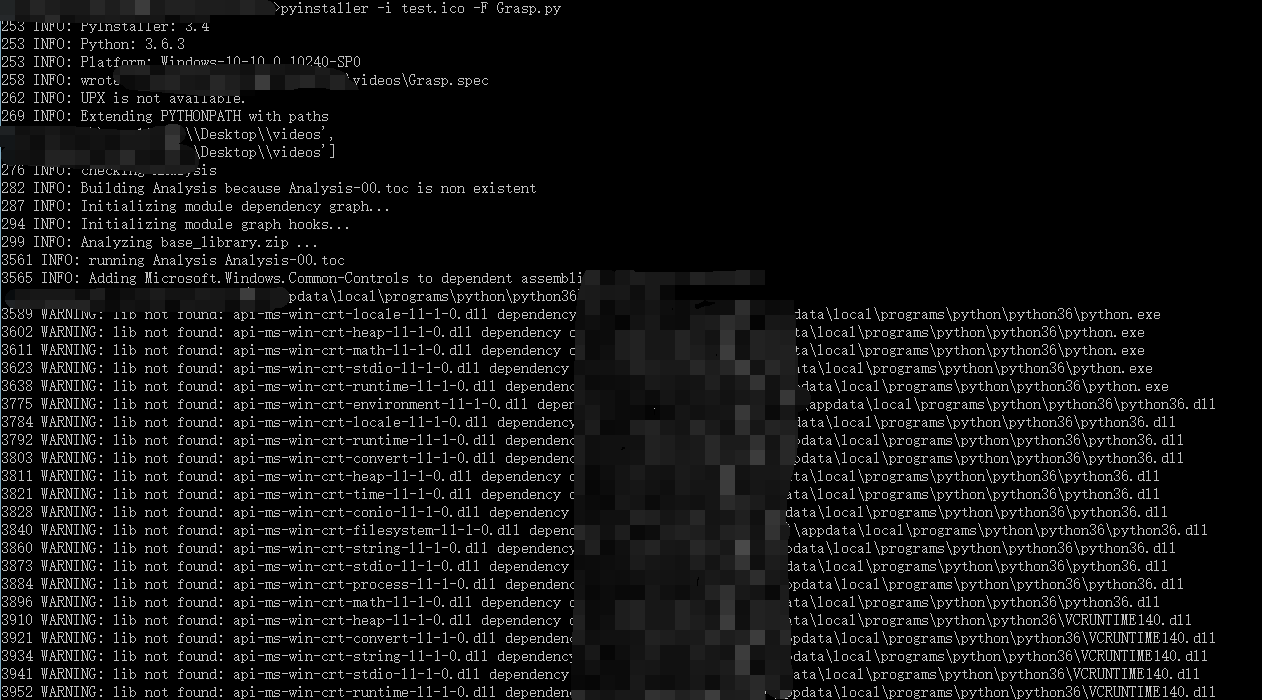

打包过程:

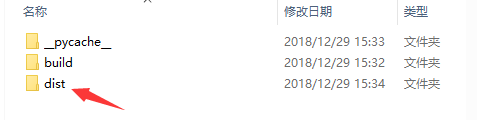

打包好的文件:

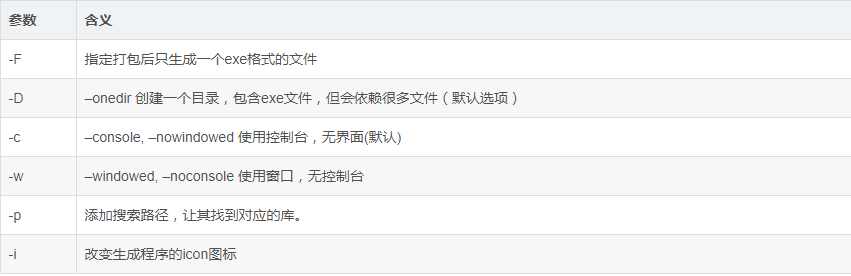

参数含义:

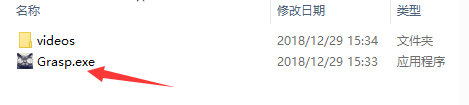

程序:

百度云下载链接

链接:百度云

提取码:hqhr

脚本内容收集自互联网,不保证生成的程序时效

Python 自动爬取B站视频的更多相关文章

- 如何手动写一个Python脚本自动爬取Bilibili小视频

如何手动写一个Python脚本自动爬取Bilibili小视频 国庆结束之余,某个不务正业的码农不好好干活,在B站瞎逛着,毕竟国庆嘛,还让不让人休息了诶-- 我身边的很多小伙伴们在朋友圈里面晒着出去游玩 ...

- 爬虫之爬取B站视频及破解知乎登录方法(进阶)

今日内容概要 爬虫思路之破解知乎登录 爬虫思路之破解红薯网小说 爬取b站视频 Xpath选择器 MongoDB数据库 爬取b站视频 """ 爬取大的视频网站资源的时候,一 ...

- Python爬取B站视频信息

该文内容已失效,现已实现scrapy+scrapy-splash来爬取该网站视频及用户信息,由于B站的反爬封IP,以及网上的免费代理IP绝大部分失效,无法实现一个可靠的IP代理池,免费代理网站又是各种 ...

- python爬虫:爬取慕课网视频

前段时间安装了一个慕课网app,发现不用注册就可以在线看其中的视频,就有了想爬取其中的视频,用来在电脑上学习.决定花两天时间用学了一段时间的python做一做.(我的新书<Python爬虫开发与 ...

- 从0实现python批量爬取p站插画

一.本文编写缘由 很久没有写过爬虫,已经忘得差不多了.以爬取p站图片为着手点,进行爬虫复习与实践. 欢迎学习Python的小伙伴可以加我扣群86七06七945,大家一起学习讨论 二.获取网页源码 爬取 ...

- python爬取B站视频弹幕分析并制作词云

1.分析网页 视频地址: www.bilibili.com/video/BV19E… 本身博主同时也是一名up主,虽然已经断更好久了,但是不妨碍我爬取弹幕信息来分析呀. 这次我选取的是自己 唯一的爆款 ...

- python 爬取B站视频弹幕信息

获取B站视频弹幕,相对来说很简单,需要用到的知识点有requests.re两个库.requests用来获得网页信息,re正则匹配获取你需要的信息,当然还有其他的方法,例如Xpath.进入你所观看的视频 ...

- 爬取B站视频

先安装you_get pip install you_get 爬取代码,爬了个ASMR的,学习困了自我催眠 import sys from you_get import common as you_g ...

- python爬虫——爬取B站用户在线人数

国庆期间想要统计一下bilibili网站的在线人数变化,写了一个简单的爬虫程序.主要是对https://api.bilibili.com/x/web-interface/online返回的参数进行分析 ...

随机推荐

- Python spli指定多个分隔符

#!/usr/bin/python # -*- coding: UTF-8 -*- import re a='Beautiful, is; better*than\nugly' 以竖线"|& ...

- R语法:<<-为全局变量赋值

例:在函数内部为全局变量赋值 all_predata_time <- data.frame(pd=0.1,Row=1,preRow=0,pt=0.1,stasid='1',InitDate='1 ...

- Python高级编程和异步IO并发编程

第1章 课程简介介绍如何配置系统的开发环境以及如何加入github私人仓库获取最新源码. 1-1 导学 试看 1-2 开发环境配置 1-3 资源获取方式第2章 python中一切皆对象本章节首先对比静 ...

- 初识Qt文字绘制

1.新建一个Qt Gui应用,项目名称为myDraw,基类选择为QMainWindow,类名设置为MainWindow. 2.在mainwindow.h头文件中添加void paintEvent(QP ...

- 神经网络中Epoch、Iteration、Batchsize相关理解

batch 深度学习的优化算法,说白了就是梯度下降.每次的参数更新有两种方式. 第一种,遍历全部数据集算一次损失函数,然后算函数对各个参数的梯度,更新梯度.这种方法每更新一次参数都要把数据集里的所有样 ...

- Oracle(一)执行计划

目录 一.什么是执行计划 二.如何查看执行计划 三.如何读懂执行计划 1. 执行顺序的原则 2. 执行计划中字段解释 3. 谓词说明 4. JOIN方式 4.1 HASH JOIN(散列连接) 4.2 ...

- ubuntu16.04系统gcc下降和升级

gcc下降 1 安装 sudo apt-get install -y gcc-4.7 sudo apt-get install -y g++-4.7 2 重新建立软连接 cd /usr/bin #进入 ...

- 0CO_PC_01 成本对象控制: 计划/实际数据

用户提出要取生产订单的成本分析明细,分析目标和实际的差异. 查了一下,可以使用 BW标准数据源:0CO_PC_01 其中,值类型:10(实际).20(计划).30(目标) 货币类型:20(成本控制范围 ...

- STM32 HAL库学习系列第1篇 ADC配置 及 DAC配置

ADC工作均为非阻塞状态 轮询模式 中断模式 DMA模式 库函数: HAL_StatusTypeDef HAL_ADC_Start(ADC_HandleTypeDef* hadc);//轮询模式,需放 ...

- Rails 自定义验证的错误信息

Active Record 验证辅助方法的默认错误消息都是英文,为了提高用户体验,有时候我们经常会被要求按特定的文本展示错误信息.此时有两种实现方式. 1. 直接在:message添加文案 class ...