论文解读(ECACL)《ECACL: A Holistic Framework for Semi-Supervised Domain Adaptation》

Note:[ wechat:Y466551 | 付费咨询,非诚勿扰 ]

论文信息

论文标题:ECACL: A Holistic Framework for Semi-Supervised Domain Adaptation

论文作者:Kai Li, Chang Liu, Handong Zhao, Yulun Zhang, Y. Fu

论文来源:2021 ICCV

论文地址:download

论文代码:download

视屏讲解:click

1 介绍

出发点:半监督领域自适应(SSDA)是一个实用但尚未被研究的研究课题;

2 方法

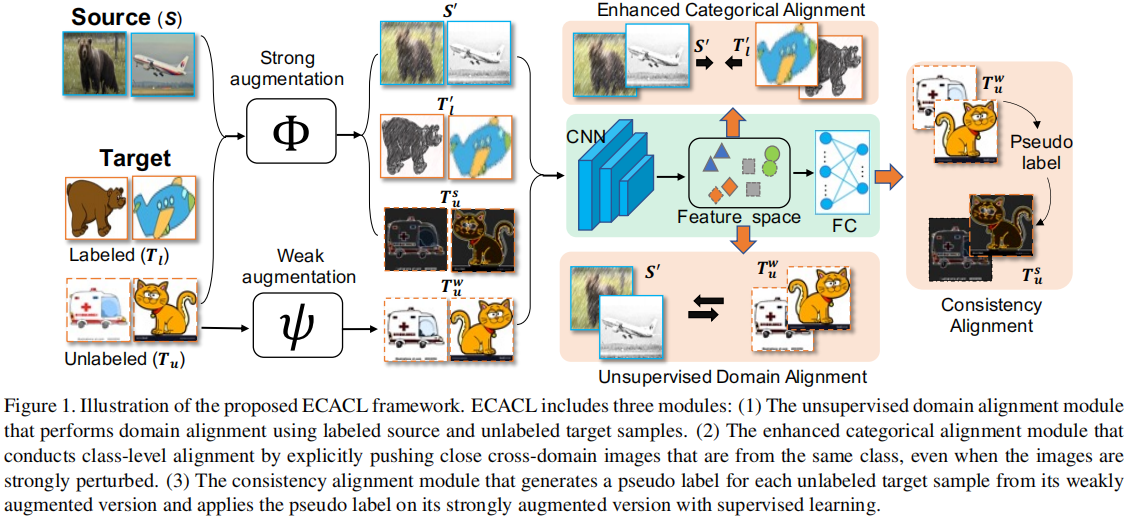

2.1 模型框架

2.2 类对齐

基于原型损失的方法

使用目标域带标记数据计算原型:

$\mathbf{c}_{k}=\frac{1}{\left|\mathcal{T}_{k}\right|} \sum_{\left(\mathbf{t}_{i}, y_{i}\right) \in \mathcal{T}_{k}} f\left(\mathbf{t}_{i}\right) \quad\quad(1)$

使用上述得到的目标原型,计算源域样本原型分布:

$p\left(y_{i}^{s}=y \mid \mathbf{s}_{i}\right)=\frac{\exp \left(-\left\|f\left(\mathbf{s}_{i}\right)-\mathbf{c}_{y}\right\|_{2}\right)}{\sum_{k=1}^{C} \exp \left(-\left\|f\left(\mathbf{s}_{i}\right)-\mathbf{c}_{k}\right\|_{2}\right)}\quad\quad(2)$

然后,可计算出所有源样本的原型损失:

$L_{p a}=\frac{1}{C N_{s}} \sum_{\left(\mathbf{s}_{i}, y_{i}^{s}\right) \sim \mathcal{S}} \sum_{y \sim \mathcal{Y}} y_{i}^{s} \log \left[-p\left(y_{i}^{s}=y \mid \mathbf{s}_{i}\right)\right] \quad\quad(3)$

基于三重损失的方法

目的:使同一类的跨域样本应该比来自不同类[16]的样本具有更高的相似性。

具体来说,对于目标域带标记样本 $\left(\mathbf{t}_{i}, y_{i}^{t}\right) \in \mathcal{T}_{l}$,从 $\mathcal{S}$ 中发现属于 $y_t$ 类,但最不相似的源样本 $\left(\mathbf{s}_{p}, y_{p}\right)$。同时,也从 $\mathcal{S}$ 中找到不属于 $y_t$ 类,但最相似的样本 $\left(\mathbf{s}_{n}, y_{n}\right)$。三联体 $\left(\mathbf{t}_{i}, \mathbf{s}_{n}, \mathbf{s}_{p}\right)$,将以下三联体损失优化为:

$\begin{aligned}L_{t a}= & \frac{1}{N_{t}} \sum_{\left(\mathbf{t}_{i}, y_{t}\right) \sim \mathcal{T}_{l}}\left[\left\|f\left(\mathbf{t}_{i}\right)-f\left(\mathbf{s}_{p}\right)\right\|_{2}^{2}-\right.\left.\left\|f\left(\mathbf{t}_{i}\right)-f\left(\mathbf{s}_{n}\right)\right\|_{2}^{2}+m\right]_{+} \end{aligned}\quad\quad(4)$

2.3 域对齐与数据增强

增强的类对齐

最近的研究表明,创建高度扰动图像的强增强为监督学习[6,7]带来了显著的性能提高。因此,$\text{Eq.1-4}$ 均基于随机强数据增强样本计算得出。

一致性对齐

对于每个未标记的目标样本 $\mathbf{u}_{i} \in \mathcal{T}_{u}$,应用弱增强 $\psi$ 和强增强 $\Phi$:

$\begin{aligned}\mathbf{u}_{i}^{w} & =\psi\left(\mathbf{u}_{i}\right)\\\mathbf{u}_{i}^{s} & =\Phi\left(\mathbf{u}_{i}\right)\end{aligned}\quad\quad(5)$

优化以下目标函数:

$L_{\text {cona }}=\sum_{\mathbf{u}_{i} \sim \mathcal{U}}\left[\mathbb{1}\left(\max \left(\mathbf{p}_{w}\right) \geq \sigma\right) H\left(\tilde{\mathbf{p}}_{w}, \mathbf{p}_{s}\right)\right]\quad\quad(6)$

其中,$\tilde{\mathbf{p}}_{w}= \arg \max \left(\mathbf{p}_{w}\right) $,$H(., . )$ 代表着交叉熵;

2.4 训练目标

总体学习目标是 UDA损失、增强的类对齐损失和一致性对齐损失的加权组合:

$L=L_{\text {uda }}+\lambda_{1} L_{\text {cata }}+\lambda_{2} L_{\text {cona }}, \quad L_{\text {cata }}=\left\{L_{p a}^{\prime}, L_{\text {ta }}^{\prime}\right\}$

其中,$L_{c a t a}=L_{p a}^{\prime}$ 或者 $L_{\text {cata }}=L_{t a}^{\prime} $;

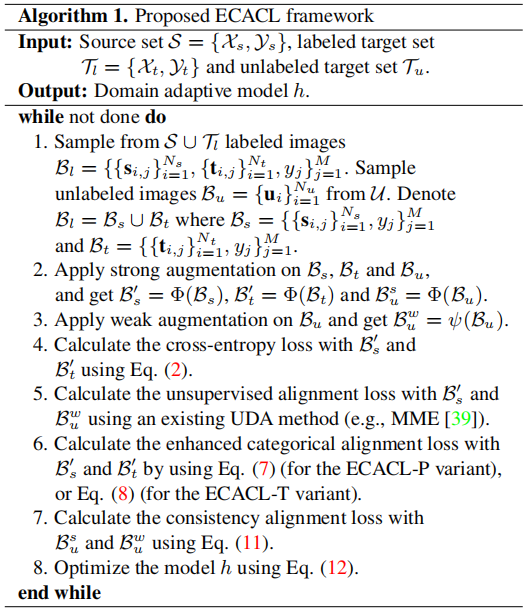

算法:

3 实验

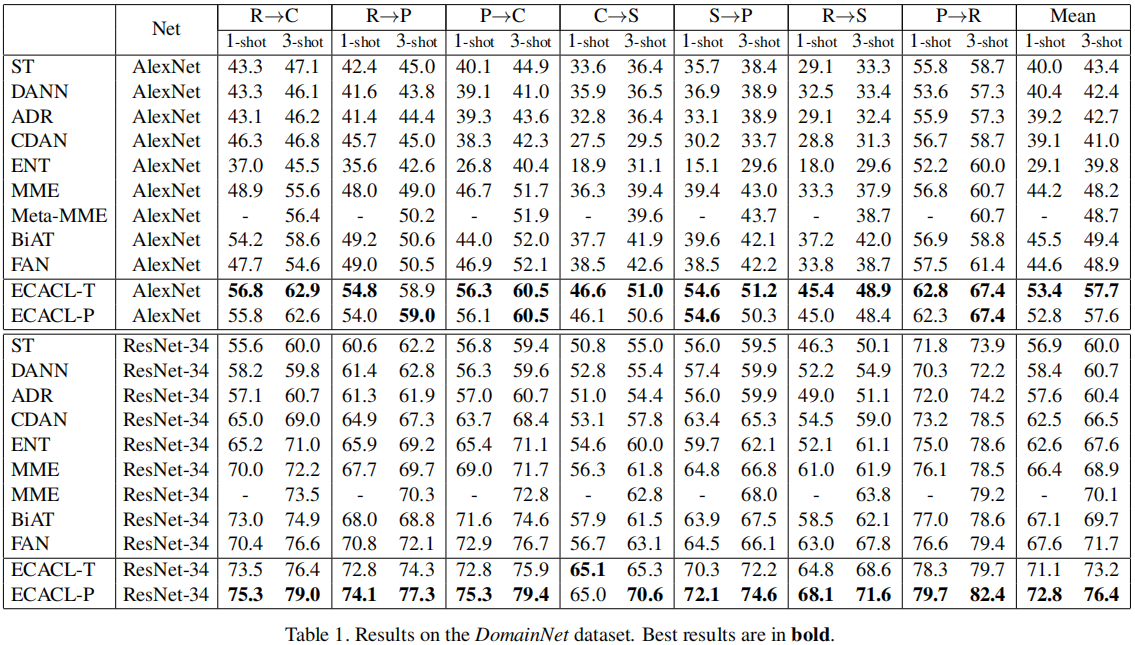

分类

论文解读(ECACL)《ECACL: A Holistic Framework for Semi-Supervised Domain Adaptation》的更多相关文章

- 论文解读(PCL)《Probabilistic Contrastive Learning for Domain Adaptation》

论文信息 论文标题:Probabilistic Contrastive Learning for Domain Adaptation论文作者:Junjie Li, Yixin Zhang, Zilei ...

- 论文解读(SimGRACE)《SimGRACE: A Simple Framework for Graph Contrastive Learning without Data Augmentation》

论文信息 论文标题:SimGRACE: A Simple Framework for Graph Contrastive Learning without Data Augmentation论文作者: ...

- 自监督学习(Self-Supervised Learning)多篇论文解读(下)

自监督学习(Self-Supervised Learning)多篇论文解读(下) 之前的研究思路主要是设计各种各样的pretext任务,比如patch相对位置预测.旋转预测.灰度图片上色.视频帧排序等 ...

- 论文解读(SDNE)《Structural Deep Network Embedding》

论文题目:<Structural Deep Network Embedding>发表时间: KDD 2016 论文作者: Aditya Grover;Aditya Grover; Ju ...

- 论文解读(IDEC)《Improved Deep Embedded Clustering with Local Structure Preservation》

Paper Information Title:<Improved Deep Embedded Clustering with Local Structure Preservation>A ...

- 论文解读(KP-GNN)《How Powerful are K-hop Message Passing Graph Neural Networks》

论文信息 论文标题:How Powerful are K-hop Message Passing Graph Neural Networks论文作者:Jiarui Feng, Yixin Chen, ...

- 论文解读(SR-GNN)《Shift-Robust GNNs: Overcoming the Limitations of Localized Graph Training Data》

论文信息 论文标题:Shift-Robust GNNs: Overcoming the Limitations of Localized Graph Training Data论文作者:Qi Zhu, ...

- itemKNN发展史----推荐系统的三篇重要的论文解读

itemKNN发展史----推荐系统的三篇重要的论文解读 本文用到的符号标识 1.Item-based CF 基本过程: 计算相似度矩阵 Cosine相似度 皮尔逊相似系数 参数聚合进行推荐 根据用户 ...

- CVPR2019 | Mask Scoring R-CNN 论文解读

Mask Scoring R-CNN CVPR2019 | Mask Scoring R-CNN 论文解读 作者 | 文永亮 研究方向 | 目标检测.GAN 推荐理由: 本文解读的是一篇发表于CVPR ...

- AAAI2019 | 基于区域分解集成的目标检测 论文解读

Object Detection based on Region Decomposition and Assembly AAAI2019 | 基于区域分解集成的目标检测 论文解读 作者 | 文永亮 学 ...

随机推荐

- 2022-02-26:k8s安装swagger,yaml如何写?

2022-02-26:k8s安装swagger,yaml如何写? 答案2022-02-26: yaml如下: apiVersion: apps/v1 kind: Deployment metadata ...

- 2021-08-30:给定两个字符串str1和str2,在str1中寻找一个最短子串,能包含str2的所有字符,字符顺序无所谓,str1的这个最短子串也可以包含多余的字符。返回这个最短包含子串。

2021-08-30:给定两个字符串str1和str2,在str1中寻找一个最短子串,能包含str2的所有字符,字符顺序无所谓,str1的这个最短子串也可以包含多余的字符.返回这个最短包含子串. 福大 ...

- Netty自定义协议要素

魔数:用来判断是否是无效数据包 协议版本号:可以支持协议的升级 序列化算法:消息正文使用哪种序列化方式,可以扩展.例如:protobuf,json,hessian等 指令类型:跟业务相关,例如:登录, ...

- vue全家桶进阶之路50:Vue3 环境变量+跨域设置实例

使用.env加后缀的方式来建立某个模式下的环境变量, 例如:项目根目录新建两个环境变量文件(development开发环境和production生产环境): .env.development .env ...

- C语言访问数据对象在内存中真实位模式的一个方法

在判定机器采用大端还是小端存储时,可以按字节输出某数据对象的机器表示的位模式.机器表示的位模式即某数据对象在内存中的二进制串.下面是一个访问数据对象位模式的方法: //传入一个数据对象,从低地址到高地 ...

- L2-3 智能护理中心统计

题目描述: 智能护理中心系统将辖下的护理点分属若干个大区,例如华东区.华北区等:每个大区又分若干个省来进行管理:省又分市,等等.我们将所有这些有管理或护理功能的单位称为"管理结点" ...

- 用token辅助 密码爆破

第一步:打开皮卡丘,点击暴力破解,token防爆破,输入正确用户名,错误密码 BP拦截请求,点击皮卡丘Login,然后拦截后, 发送给Intruder 第二步: 爆破方式选择音叉方式, & ...

- 记一次 .NET 某医院预约平台 非托管泄露分析

一:背景 1. 讲故事 前几天有位朋友找到我,说他的程序有内存泄露,让我帮忙排查一下,截图如下: 说实话看到 32bit, 1.5G 这些关键词之后,职业敏感告诉我,他这个可能是虚拟地址紧张所致,不管 ...

- Flex布局常用属性详解

1. Flex布局与响应式布局 1.1 为什么需要响应式布局? 在电脑PC端,使用浮动,定位同时使用像素px单位就可以完成大部分布局,而且布局完之后不会有大问题,但是到了移动端,移动设备的屏幕尺寸多种 ...

- python中引用自己封装的包飘红线处理办法

1.安装 opencv-contrib-python 可解决引用自己包名提示 无法识别 2.取消unresolved referencesde 的勾勾