因果卷积(causal)与扩展卷积(dilated)

因果卷积(causal)与扩展卷积(dilated)之An Empirical Evaluation of Generic Convolutional and Recurrent Networks for Sequence Modeling

author:gswycf

最近在看关于NLP(自然语言处理)方面的文章,(其实不是自己要看),anyway,看了一个“An Empirical Evaluation of Generic Convolutional and Recurrent Networks for Sequence Modeling“,讲到了:虽然人们现在都在用RNN和LSTm去处理序列问题(sequence modeling),但是明显最近几年这些模型在这些问题上出现了瓶颈,你们之前都说CNN不适合处理sequence modeling问题,但其实并不是的,作者提出了一个普适的CNNN模型,在多个序列问题上和之前的RNN和LSTM比较,结果发现,CNN在这方面的能力确实是被低估了,CNN建立的model要比之前人们之前用的RNN要好很多,而且简洁。

这篇blog并不是要讲那篇文章,我可能会单独写一篇(看有没有时间),这篇blog主要是结束那篇文章中提出的两个概念:因果卷积(causal)与扩展卷积(dilated)

因果卷积:

因为要处理序列问题(即要考虑时间问题,)就不能使用普通的CNN卷积,必须使用新的CNN模型,这个就是因果卷积的作用,看下面一个公式,对与序列问题(sequence modeling),主要抽象为,根据x1......xt和y1.....yt-1去预测yt,使得yt接近于实际值

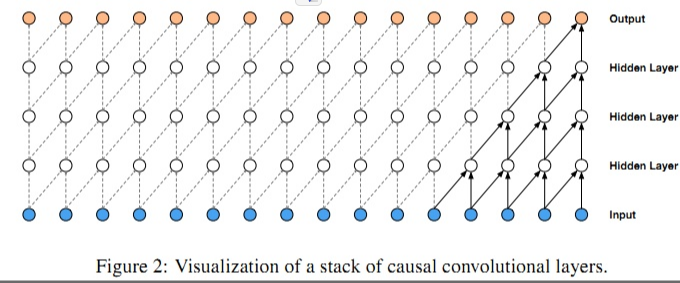

我们根据图片来看下因果卷积的样子,下面这个图片来自:https://deepmind.com/blog/wavenet-generative-model-raw-audio/

上面的图片可以详细的解释因果卷积,但是问题就来,如果我要考虑很久之前的变量x,那么卷积层数就必须增加(自行体会)。。。卷积层数的增加就带来:梯度消失,训练复杂,拟合效果不好的问题,为了决绝这个问题,出现了扩展卷积(dilated)

因果卷积:

对于因果卷积,存在的一个问题是需要很多层或者很大的filter来增加卷积的感受野。本文中,我们通过大小排列来的扩大卷积来增加感受野。扩大卷积(dilated convolution)是通过跳过部分输入来使filter可以应用于大于filter本身长度的区域。等同于通过增加零来从原始filter中生成更大的filter。

这就可以解决因果卷积带来的问题,在示意图中,卷积感受野扩大了1,2,4,8倍。扩大卷积(dilated convolution)可以使模型在层数不大的情况下有非常大的感受野。

因果卷积(causal)与扩展卷积(dilated)的更多相关文章

- Convolution Network及其变种(反卷积、扩展卷积、因果卷积、图卷积)

今天,主要和大家分享一下最近研究的卷积网络和它的一些变种. 首先,介绍一下基础的卷积网络. 通过PPT上的这个经典的动态图片可以很好的理解卷积的过程.图中蓝色的大矩阵是我们的输入,黄色的小矩阵是卷积核 ...

- 场景分割:MIT Scene Parsing 与DilatedNet 扩展卷积网络

MIT Scene Parsing Benchmark简介 Scene parsing is to segment and parse an image into different image re ...

- RepLKNet:不是大卷积不好,而是卷积不够大,31x31卷积了解一下 | CVPR 2022

论文提出引入少数超大卷积核层来有效地扩大有效感受域,拉近了CNN网络与ViT网络之间的差距,特别是下游任务中的性能.整篇论文阐述十分详细,而且也优化了实际运行的表现,值得读一读.试一试 来源:晓飞 ...

- 由浅入深:CNN中卷积层与转置卷积层的关系

欢迎大家前往腾讯云+社区,获取更多腾讯海量技术实践干货哦~ 本文由forrestlin发表于云+社区专栏 导语:转置卷积层(Transpose Convolution Layer)又称反卷积层或分数卷 ...

- 深度学习原理与框架-卷积神经网络基本原理 1.卷积层的前向传播 2.卷积参数共享 3. 卷积后的维度计算 4. max池化操作 5.卷积流程图 6.卷积层的反向传播 7.池化层的反向传播

卷积神经网络的应用:卷积神经网络使用卷积提取图像的特征来进行图像的分类和识别 分类 相似图像搜索 ...

- 卷积神经网络(CNN)之一维卷积、二维卷积、三维卷积详解

作者:szx_spark 由于计算机视觉的大红大紫,二维卷积的用处范围最广.因此本文首先介绍二维卷积,之后再介绍一维卷积与三维卷积的具体流程,并描述其各自的具体应用. 1. 二维卷积 图中的输入的数据 ...

- 深度学习方法(十三):卷积神经网络结构变化——可变形卷积网络deformable convolutional networks

上一篇我们介绍了:深度学习方法(十二):卷积神经网络结构变化--Spatial Transformer Networks,STN创造性地在CNN结构中装入了一个可学习的仿射变换,目的是增加CNN的旋转 ...

- deeplearning.ai 卷积神经网络 Week 2 卷积神经网络经典架构

1. Case study:学习经典网络的原因是它们可以被迁移到其他任务中. 1.1)几种经典的网络: a)LeNet-5(LeCun et al., 1998. Gradient-based lea ...

- tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图

tensorflow CNN 卷积神经网络中的卷积层和池化层的代码和效果图 因为很多 demo 都比较复杂,专门抽出这两个函数,写的 demo. 更多教程:http://www.tensorflown ...

随机推荐

- Altium Designer chapter4总结

原理图设计进阶中需要注意如下: (1)多电路原理图的设计:图纸连接符是连接各个电路图的电器连接:VCC GND属于特殊的网络标号,在多电路原理图中不需要添加. (2)层次式电路原理图设计:注意自上而下 ...

- linux flock()

表头文件 #include<sys/file.h> 定义函数 int flock(int fd,int operation); 函数说明 flock()会依参数operation所指 ...

- meta标签viewport的深入理解(转)

移动前端开发之viewport的深入理解 在移动设备上进行网页的重构或开发,首先得搞明白的就是移动设备上的viewport了,只有明白了viewport的概念以及弄清楚了跟viewport有关的met ...

- pipenv虚拟环境

虚拟环境 之前用的 virtualenv +virtualenvwrapper 今天在学习 flask 框架 用到了pipenv pipenv Pipfile 文件是 TOML 格式而不是 ...

- mysql 主从复制 (2)

今天说一下MySQL的主从复制如何做到! 准备工作: 1.两个虚拟机:我这里用的是CentOS5.5,IP地址分别是192.168.1.101 和192.168.1.105: 101做主服务器,105 ...

- Codeforces 1082G(最大权闭合子图)

题面 传送门 分析 没想到压轴题是道模板裸题 由于子图的权值=边权和-点权和 将边和点都看成新图中的点 S向原来的边i连边,权值为边权 点i向T连边,权值为点权 边i:(u,v,w)向u,v,连边,权 ...

- Vue对象的生命周期

<!doctype html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- Spring学习笔记(3)——快速入门

项目目录如下: Say.java为主函数通过ApplicationContext创建对象,利用方法ClassPathXmlApplicationContext访问配置文件Applicationcont ...

- 攻防世界--crackme

测试文件:https://adworld.xctf.org.cn/media/task/attachments/088c3bd10de44fa988a3601dc5585da8.exe 1.准备 获取 ...

- JS变量连续赋值

下面就是这个经典案例: var a = {n: 1}; var b = a; a.x = a = {n: 2}; console.log(a);console.log(b); console.log( ...