Factorized Hidden Variability Learning For Adaptation Of Short Duration Language Identification Models

基于因子分解的隐层变量学习,应用于短语句语种识别模型的自适应

LFVs(Language Feature Vectors,语种特征向量)[11],与BSVs(Bottleneck Speaker Vectors)类似,即瓶颈特征

3.1. 神经元调制

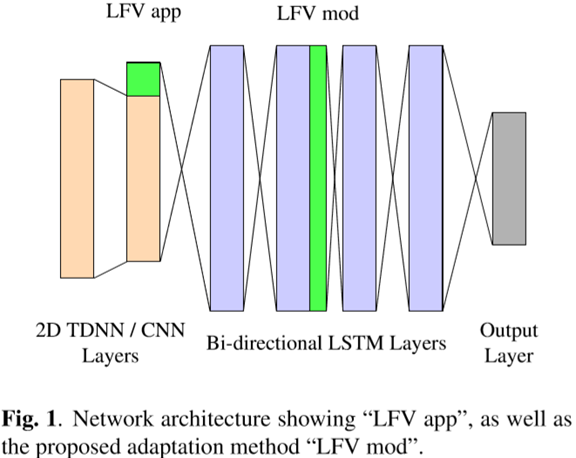

由于说话人特性的变化反映在语音信号中,因此将表示说话人适应声学特性的特征拼接到特征中。如VTLN或fMLLR,是直接对声学特征进行操作的自适应方法。可以训练一个说话人自适应系统以基于说话人属性直接对输入特征进行转换,这样效果与基于i-Vector的自适应类似[8]。但是与说话人变化特性相比,语言特性是更高阶的概念。在某些方面基于声学。例如,具有相同音素的多种语言,可以在某种程度上可以观察到语言特定属性。但是,声学特征变换适应性方法无法考虑到音位配列学或者不同声学单元集的知识。在这里,在更深层次的DNN处添加特征可能会改善自适应性。[17]基于Meta-PI网络进行了尝试。关键点是使用Meta-PI连接,它允许通过将隐层单元乘以系数来调制神经元的输出。应用于语种自适应,我们用LFV来对隐藏层的输出进行调制。基于语种特征的调制,LSTM单元的输出被衰减或增强。这迫使隐藏层中的单元基于语种特征来学习或适应。调制可以被认为与Dropout有关[18],其中网络连接以随机概率被丢弃。在结果部分中,我们将此方法称为"LFV调制"。

所示的网络配置。基本架构受百度Deepspeech 2的启发。它将两个TDNN/CNN层与4个双向LSTM层组合在一起。输出层是一个前馈层,它将最后一个LSTM层的输出映射到目标。将每层LSTM单元维数设定为LFV维数的数倍。这样就可以构建包含相同单位数量的LSTM单元的隐藏层组。然后用LFV的某一维对每组的输出进行调制。该图显示了两种配置,"LFV 拼接"和"LFV 调制",但一次只应用一种方法。在初步实验中,我们得出在第二个LSTM层的输出处进行调制可以获得最佳性能。

Factorized Hidden Variability Learning For Adaptation Of Short Duration Language Identification Models的更多相关文章

- Coursera Deep Learning笔记 序列模型(三)Sequence models & Attention mechanism(序列模型和注意力机制)

参考 1. 基础模型(Basic Model) Sequence to sequence模型(Seq2Seq) 从机器翻译到语音识别方面都有着广泛的应用. 举例: 该机器翻译问题,可以使用" ...

- ICLR 2013 International Conference on Learning Representations深度学习论文papers

ICLR 2013 International Conference on Learning Representations May 02 - 04, 2013, Scottsdale, Arizon ...

- Machine and Deep Learning with Python

Machine and Deep Learning with Python Education Tutorials and courses Supervised learning superstiti ...

- Deep Learning in a Nutshell: History and Training

Deep Learning in a Nutshell: History and Training This series of blog posts aims to provide an intui ...

- Machine Learning for Developers

Machine Learning for Developers Most developers these days have heard of machine learning, but when ...

- How do I learn machine learning?

https://www.quora.com/How-do-I-learn-machine-learning-1?redirected_qid=6578644 How Can I Learn X? ...

- (转) Ensemble Methods for Deep Learning Neural Networks to Reduce Variance and Improve Performance

Ensemble Methods for Deep Learning Neural Networks to Reduce Variance and Improve Performance 2018-1 ...

- (转)Understanding, generalisation, and transfer learning in deep neural networks

Understanding, generalisation, and transfer learning in deep neural networks FEBRUARY 27, 2017 Thi ...

- Rolling in the Deep (Learning)

Rolling in the Deep (Learning) Deep Learning has been getting a lot of press lately, and is one of t ...

随机推荐

- 数组和list互转

数组转list 方法1: String[] stringArray = { "a", "b", "c", "d", &q ...

- A1121. Damn Single

"Damn Single (单身狗)" is the Chinese nickname for someone who is being single. You are suppo ...

- numpy学习之前的必要数学知识:线性代数

行列式 主要内容 1.行列式的定义及性质 2.行列式的展开公式 一.行列式的定义 1.排列和逆序 排列:由n个数1,2,…,n组成的一个有序数组称为一个n级排列,n级排列共有n!个 逆序:在一个排列中 ...

- Day23--Python--常用模块02--序列化,configparser

1. 序列化 把对象打散成bytes或者字符串. 方便存储和传输 序列化 把bytes或者字符串转换回对象. 反序列化 2. pickle(比较重要) 把python中所有的对象都可以转化成bytes ...

- Struts2上传文件出错

出现错误: Error setting expression 'myFile' with value '[Ljava.lang.String;@47fb02e8' 解决方法: 这是由于没有设置 < ...

- 5.2 SW1控制LED1亮灭(中断功能)

中断:CPU收到中断请求后暂停正在执行的程序,而去执行中断服务函数中的程序,处理结束后,继续执行原来的程序. 能够产生中断请求的中断源如下: CC2530中断设置步骤:使能端口组中断(IEN)——端口 ...

- HTML学习笔记Day3

一.CSS样式 1.每个css样式都必须由两部分组成:选择符(Selector)+声明(Deleration) 注:声明又包括属性(Properyt)和属性值(value) 2.css属性:属性是指定 ...

- Go条件语句、switch和循环语句

一:Go条件语句 package main import "fmt" //========go条件判断语句=== func main() { { fmt.Println(" ...

- ELK-6.5.3学习笔记–使用filebeat管理微服务日志

微服务日志打印. 转载于http://www.eryajf.net/2369.html 上边是输出了nginx日志,从而进行展示,以及各种绘图分析,而现在的需求是,要将微服务当中的日志汇总到elk当中 ...

- pcntl_exec()

<?php /******************************* *查看phpinfo编译参数--enable-pcntl *作者 Spider *nc -vvlp 443 **** ...