ELK 日志学习

一.Elasticsearch 安装(所有的版本均使用5.5.0 ,且版需要相同 logstash \ kibana \ filebeat )

官网下载地址:https://www.elastic.co/cn/

(下载Linux版),上传到本地虚拟机服务器 ,tar -zxvf 解压,运行

遇到的问题1 : 不允许 root 用户启动

解决:

adduser test

passwd test

chown -R test 文件根目录

遇到的问题2:

max file descriptors [4096] for elasticsearch process likely too low, increase to at least [65536]

max number of threads [1024] for user [lishang] likely too low, increase to at least [2048]

解决:(切记,添加完退出登陆,再登陆,否则不会生效)

vim /etc/security/limits.conf

添加如下内容: * soft nofile * hard nofile * soft nproc * hard nproc

遇到的问题3:

max number of threads [1024] for user [lish] likely too low, increase to at least [2048]

解决:

vim /etc/security/limits.d/-nproc.conf

修改或者添加下:

* soft nproc

遇到的问题4:

max virtual memory areas vm.max_map_count [65530] likely too low, increase to at least [262144]

解决:

vim /etc/sysctl.conf

添加

vm.max_map_count=

退出执行

sysctl -p

遇到的问题5:

再虚拟机中 127.0.0.1:9200 成功 , 外部 :虚拟机 ip:9200 失败

解决:

在conf 文件下添加:

net.host: 虚拟机IP

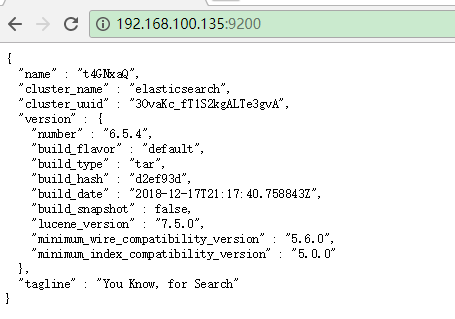

最后:在主机

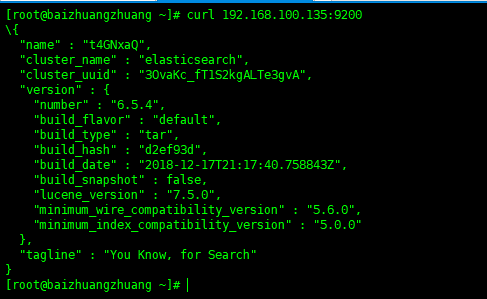

在虚拟机:

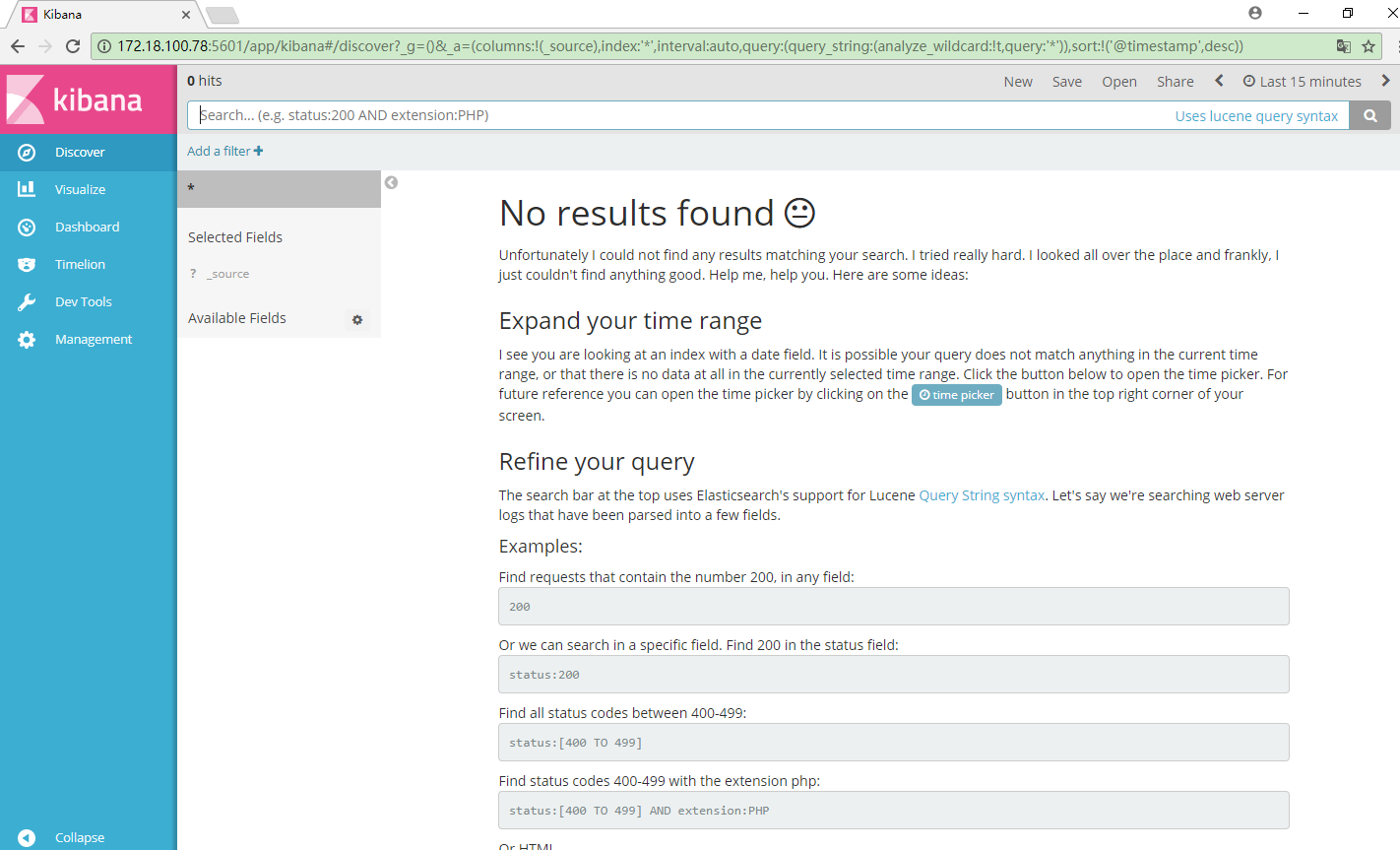

二、安装 kibana (数据展示)

在elasticsearch.org 官网有一系列的软件可以下载,下载5.5.0版本的 kibana

解压同elasticsrarch 上

修改配置:/kibana/config/kibana.yml

server.host:"0.0.0.0" elasticsearch.url : "http://localhost:9200"

启动 kibana

./bin/kibana

浏览器访问:服务器ip:5601

三、logstash 安装启动

下载解压同上,配置区别较大

1.在logstash 根目录下建立 logstash.conf 目录,内容包括如下

input {

beats{

port =>

}

}

filter{

}

output {

elasticsearch{

hosts => ["172.18.100.78:9200"]

index => "tomcat_ctmpweb_%{+YYYY.MM.dd}"

}

stdout{

codec =>rubydebug

}

}

~

其中 input 为输入数据端,此处设置数据来源为 filebeat 搜集,稍后配置

输出数据为 elasticsearch

启动 logstash

bin/logstash -f nginx_logs.conf

四、安装启动 filebeat

下载,解压,配置 filebeat.yml

1.配置日志文件读取路径

2.(默认输出到elasticsearch ),注释掉elasticsearch,开放 logstash

3.启动 filebeat

./filebeat -e -c filebeat.yml -d "publish"

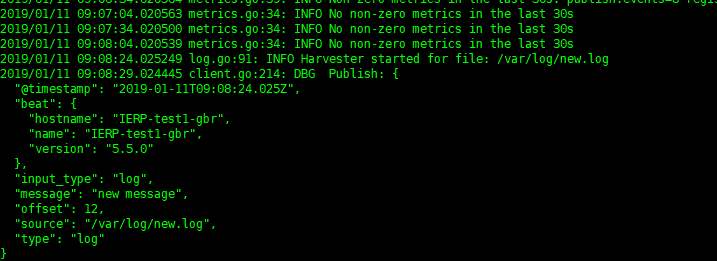

五、分析日志

在监听的日志文件中加入new.log ,当有新的日志加入,会及时分析如下

若想要重新开始扫描日志,删掉filebeat 目录下data目录中的数据,则filebeat 会重新扫描

ELK 日志学习的更多相关文章

- ELK日志分析 学习笔记

(贴一篇之前工作期间整理的elk学习笔记) ELK官网 https://www.elastic.co ELK日志分析系统 学习笔记 概念:ELK = elasticsearch + logstas ...

- 浅谈ELK日志分析平台

作者:珂珂链接:https://zhuanlan.zhihu.com/p/22104361来源:知乎著作权归作者所有.商业转载请联系作者获得授权,非商业转载请注明出处. 小编的话 “技术干货”系列文章 ...

- ELK日志分析系统-Logstack

ELK日志分析系统 作者:Danbo 2016-*-* 本文是学习笔记,参考ELK Stack中文指南,链接:https://www.gitbook.com/book/chenryn/kibana-g ...

- Docker笔记(十):使用Docker来搭建一套ELK日志分析系统

一段时间没关注ELK(elasticsearch —— 搜索引擎,可用于存储.索引日志, logstash —— 可用于日志传输.转换,kibana —— WebUI,将日志可视化),发现最新版已到7 ...

- ELK 日志平台构建

elastic中文社区 https://elasticsearch.cn/ 完整参考 ELK实时日志分析平台环境部署--完整记录 https://www.cnblogs.com/kevingrace/ ...

- ELK日志分析之安装

ELK日志分析之安装 1.介绍: NRT elasticsearch是一个近似实时的搜索平台,从索引文档到可搜索有些延迟,通常为1秒. 集群 集群就是一个或多个节点存储数据,其中一个节点为主节点,这个 ...

- 【ELK】ELK日志套件安装与使用

ELK日志套件安装与使用 1.ELK介绍 ELK不是一款软件,而是elasticsearch+Logstash+kibana三款开源软件组合而成的日志收集处理套件,堪称神器.其中Logstash负 ...

- springboot 集成 elk 日志收集功能

Lilishop 技术栈 官方公众号 & 开源不易,如有帮助请点Star 介绍 官网:https://pickmall.cn Lilishop 是一款Java开发,基于SpringBoot研发 ...

- ELK 日志分析体系

ELK 日志分析体系 ELK 是指 Elasticsearch.Logstash.Kibana三个开源软件的组合. logstash 负责日志的收集,处 ...

随机推荐

- 通俗理解cookies,sessionStorage,localStorage的区别

sessionStorage .localStorage 和 cookie 之间的区别共同点:都是保存在浏览器端,且同源的. 区别:cookie数据始终在同源的http请求中携带(即使不需要),即co ...

- uva-10954-贪心

题意:俩个数相加,产生的和就是这次加法的代价,问,所有数都加起来,最小代价是多少 解题思路:贪心,每次都选取最小俩个数相加,如果只有一个数,计算完毕,注意,加法的和要再次入队列. #include & ...

- css:蓝环章鱼

许多海洋生物色彩艳丽,这次用css仿制一下蓝环章鱼的蓝环 <script type="text/javascript" src="http://cdn.bootcs ...

- 代码:jquery自定义插件 demo

jquery自定义插件 demo 2016-1-13 只是一个简易的示例 <script type="text/javascript" src="http://cd ...

- iOS基础知识之类别

本类从三个方面介绍iOS中的类别,分别是 什么是类别:类别的语法:类别的作用.具体内容如下: 一.类别: 类的补丁:当不能获取现有类的源码,但需要对现有类的功能进行补充时,这种情况下使用类别. 类别 ...

- Mybatis九( mybatis插件的原理及使用)

1.插件执行原理 一.demo 1.测试类 @Test public void test1() { String resource = "mybatis-config.xml"; ...

- vue eslint 代码自动格式化

vue-cli 代码风格为 JavaScript Standard Style 代码检查规范严格,一不小心就无法运行,使用eslint的autoFixOnSave可以在保存代码的时候自动格式化代码 V ...

- 【平台兼容性】jeecg3.7 兼容weblogic 部署改造方案

MyEclipse 配置 WebLogic 10.3.3请参考: https://my.oschina.net/aini3884/blog/895689 常见问题: 1. problem: cvc-e ...

- python-玉米(小米)商城作业

<!DOCTYPE html> <html lang="en"> <head> <meta charset="UTF-8&quo ...

- jsfl 导出指定名称的swf

var _openDOC = fl.openDocument("file:///E|TE/dt.fla"); var _exName = _openDOC.pathURI.spli ...