「Flink」Flink中的时间类型

Flink中的时间类型和窗口是非常重要概念,是学习Flink必须要掌握的两个知识点。

Flink中的时间类型

时间类型介绍

Flink流式处理中支持不同类型的时间。分为以下几种:

- 处理时间

- Flink程序执行对应操作的系统时间。所有基于时间的操作(例如:时间窗口)都将使用运行相应operator的系统时间。例如:每个小时的处理时间窗口包括在系统时间范围内所有operator接收到的记录。例如:如果应用程序在09:15开始运行,则第一个滚动时间窗口将包括:09:15 – 10:00 之间的处理事件,下一个窗口包括上午10:00 – 11:00之间的处理事件

- 这种处理时间方式实时性是最好的,但数据未必准确

- 事件时间

- 每个事件发生的时间。这个时间一般是在进入到Flink之前就包含在事件中

- 针对Eventtime,事件被处理的时间以来与事件本身

- Eventtime必须要指定如何生成Eventtime Watermark(水印)

- 理想情况,不管事件何时到达或者顺序如何,事件时间处理能够得到完整一致地结果。

- 事件处理在等待乱序事件时,会产生一些延迟。这样会对Eventtime的应用性能有一定的影响

- 摄入时间

- 摄入时间是事件进入Flink的时间

- 在source operator中,每个记录以时间戳的形式获取源的当前时间

- 它在概念是处于事件时间和处理时间中间

- 摄入时间不能处理乱序问题或者延迟数据,摄入时间可以由流式系统自动生成水印

Flink支持的这几种时间刚好和我们上一篇播客中的内容相对应。

https://www.cnblogs.com/ilovezihan/p/12254479.html

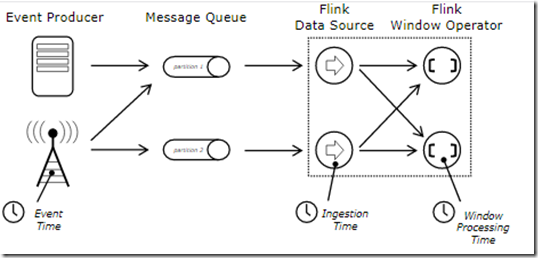

应用一张Flink官网的图。

Flink代码中设置时间类型

通常,我们在Flink初始化流式运行环境时,就会设置流处理时间特性。这个设置很重要,它决定了数据流的行为方式。(例如:是否需要给事件分配时间戳),以及窗口操作应该使用什么样的时间类型。例如:KeyedStream.timeWindow(Time.seconds(30))。

我们接下来通过实现一个每5秒中进行一次单词计数的案例,来说明Flink中如何指定时间类型。

public class WordCountWindow {

public static void main(String[] args) throws Exception {

// 1. 初始化流式运行环境

Configuration conf = new Configuration();

StreamExecutionEnvironment env = StreamExecutionEnvironment.createLocalEnvironmentWithWebUI(conf);

// 2. 设置时间处理类型,这里设置的方式处理时间

env.setStreamTimeCharacteristic(TimeCharacteristic.ProcessingTime);

// 3. 定义数据源,每秒发送一个hadoop单词

DataStreamSource<String> wordDS = env.addSource(new RichSourceFunction<String>() {

private boolean isCanaled = false;

@Override

public void run(SourceContext<String> ctx) throws Exception {

while (!isCanaled) {

ctx.collect("hadooop");

Thread.sleep(1000);

}

}

@Override

public void cancel() {

isCanaled = true;

}

});

// 4. 每5秒进行一次,分组统计

// 4.1 转换为元组

wordDS.map(word -> Tuple2.of(word, 1))

// 指定返回类型

.returns(Types.TUPLE(Types.STRING, Types.INT))

// 按照单词进行分组

.keyBy(t -> t.f0)

// 滚动窗口,3秒计算一次

.timeWindow(Time.seconds(3))

.reduce(new ReduceFunction<Tuple2<String, Integer>>() {

@Override

public Tuple2<String, Integer> reduce(Tuple2<String, Integer> value1, Tuple2<String, Integer> value2) throws Exception {

return Tuple2.of(value1.f0, value1.f1 + value2.f1);

}

}, new RichWindowFunction<Tuple2<String, Integer>, Tuple2<String, Integer>, String, TimeWindow>() {

@Override

public void apply(String word, TimeWindow window, Iterable<Tuple2<String, Integer>> input, Collector<Tuple2<String, Integer>> out) throws Exception {

// 打印窗口开始、结束时间

SimpleDateFormat sdf = new SimpleDateFormat("yyyy-MM-dd HH:mm:ss");

System.out.println("窗口开始时间:" + sdf.format(window.getStart())

+ " 窗口结束时间:" + sdf.format(window.getEnd())

+ " 窗口计算时间:" + sdf.format(System.currentTimeMillis()));

int sum = 0;

Iterator<Tuple2<String, Integer>> iterator = input.iterator();

while(iterator.hasNext()) {

Integer count = iterator.next().f1;

sum += count;

}

out.collect(Tuple2.of(word, sum));

}

}).print();

env.execute("app");

}

}

窗口开始时间:2020-02-05 00:22:21 窗口结束时间:2020-02-05 00:22:24 窗口计算时间:2020-02-05 00:22:24

4> (hadooop,2)

窗口开始时间:2020-02-05 00:22:24 窗口结束时间:2020-02-05 00:22:27 窗口计算时间:2020-02-05 00:22:27

4> (hadooop,3)

窗口开始时间:2020-02-05 00:22:27 窗口结束时间:2020-02-05 00:22:30 窗口计算时间:2020-02-05 00:22:30

4> (hadooop,3)

窗口开始时间:2020-02-05 00:22:30 窗口结束时间:2020-02-05 00:22:33 窗口计算时间:2020-02-05 00:22:33

4> (hadooop,3)

窗口开始时间:2020-02-05 00:22:33 窗口结束时间:2020-02-05 00:22:36 窗口计算时间:2020-02-05 00:22:36

4> (hadooop,3)

窗口开始时间:2020-02-05 00:22:36 窗口结束时间:2020-02-05 00:22:39 窗口计算时间:2020-02-05 00:22:39

我们可以看到,这个滚动窗口,每3秒计算一次,是按照系统时间来计算的。

我们再把时间窗口设置为1分钟,再试试。

窗口开始时间:2020-02-05 00:27:00 窗口结束时间:2020-02-05 00:28:00 窗口计算时间:2020-02-05 00:28:00

4> (hadooop,32)窗口开始时间:2020-02-05 00:28:00 窗口结束时间:2020-02-05 00:29:00 窗口计算时间:2020-02-05 00:29:00

4> (hadooop,60)

刚好在 00:27:00 – 00:28:00之间。

参考文件:

https://ci.apache.org/projects/flink/flink-docs-release-1.9/dev/event_time.html

「Flink」Flink中的时间类型的更多相关文章

- 「翻译」Unity中的AssetBundle详解(二)

为AssetBundles准备资源 使用AssetBundles时,您可以随意将任何Asset分配给所需的任何Bundle.但是,在设置Bundles时,需要考虑一些策略.这些分组策略可以使用到任何你 ...

- 「翻译」Unity中的AssetBundle详解(一)

AssetBundles AssetBundle是一个存档文件,其中包含平台在运行时加载的特定资产(模型,纹理,预制,音频剪辑,甚至整个场景).AssetBundles可以表示彼此之间的依赖关系;例如 ...

- 1 Java中的时间类型

总结:sql中的时间转 util的时间直接赋值即可:反过来,必须先吧util下的时间转换成毫秒,再通过sql的构造器生成sql的时间格式. 1 Java中的时间类型 java.sql包下给出三个与数据 ...

- 「JSOI2013」游戏中的学问

「JSOI2013」游戏中的学问 传送门 考虑 \(\text{DP}\) 设 \(dp_{i, j}\) 表示将前 \(i\) 个人分成 \(j\) 个集合,并且第 \(i\) 个人在第 \(j\) ...

- 「Kafka」Kafka中offset偏移量提交

在消费Kafka中分区的数据时,我们需要跟踪哪些消息是读取过的.哪些是没有读取过的.这是读取消息不丢失的关键所在. Kafka是通过offset顺序读取事件的.如果一个消费者退出,再重启的时候,它知道 ...

- MySql中的时间类型datetime,timestamp,date,year比较

MySQL日期类型.日期格式.存储空间.日期范围比较.日期类型 存储空间 日期格式 日期范围------------ --------- ...

- 由echarts想到的js中的时间类型

在工作中使用echarts时,偶然发现折线图中对时间类型变量的用法: now前面的+号何解? now = new Date(+now + oneDay); 后来查阅资料,看到一篇博客,解释如下:这是对 ...

- C++中各种时间类型的转换(包括MFC中的时间类型)

平时写代码会经常遇到时间类型转换的问题,如时间戳转为格式化时间,或者反过来等,时间类型有的为time_t,还有FILETIME一堆,在这里记录下他们之间是如何转换的. 时间类型及其意义 FILETIM ...

- 「Flink」Flink的状态管理与容错

在Flink中的每个函数和运算符都是有状态的.在处理过程中可以用状态来存储数据,这样可以利用状态来构建复杂操作.为了让状态容错,Flink需要设置checkpoint状态.Flink程序是通过chec ...

随机推荐

- Easy C 编程 in Linux

入坑Ubuntu有4,5天了,当时各种不习惯,但现在渐渐喜欢上了这种简单大方的显示界面和快速高效的命令行模式,各种没有的功能也都有网页版,非常不错呢. 现在最让我感到神奇之处,便是Linux的C编程是 ...

- go编写简单接口的过程

环境 系统 Windows server 2016 Datacener go version go1.13.3 windows/amd64 数据库 Microsoft SQL Server 2014( ...

- zabbix3.4源码安装步骤

zabbix3.4源码安装步骤1.安装环境: 安装机器:22.224.9.227 以下简称监控机: 操作系统信息:内核版本: Linux version 2.6.18-194.1.AXS3 (pack ...

- EL表达式(Exprission language)

EL介绍 Expressive Language, JSP2.0引入,简化jsp开发中对对象的引用,(可以直接读取对象的属性,不需要像之前java脚本那样去做,比较繁琐),使得访问存储在JavaBea ...

- Ubuntu通过终端命令行换阿里源

检查Ubuntu系统的Codename $ lsb_release -a 得到结果: No LSB modules are available. Distributor ID: Ubuntu Desc ...

- c++中值传递,址传递,引用传递

概念详解 1. 值传递: 形参是实参的拷贝,改变形参的值并不会影响外部实参的值. 从被调用函数的角度来说,值传递是单向的(实参->形参),参数的值只能传入,不能传出: 当函数内部需要修改参数,并 ...

- JavaScript 替换所有匹配内容

由于JavaScript 的 replace 只能替换一次,因此另外编写一个能现替换全部匹配内容方法,代码如下: /*把 content 中所有的 searchValue 替换为 replaceVal ...

- ubuntu16.04+Pangolin安装

学习视觉Slam十四讲到第三章的可视化演示的时候需要Panglolin的使用,因此在Githup上下载了安装包:https://github.com/stevenlovegrove/Pangolin ...

- POJ_3627_贪心

题目描述: 给你N个数和一个总和,要求求出最少个数的数相加大于等于这个总和. 思路: 很简单的贪心,先排序,从大到小加一次,比较一次,直到符合条件. 我用了优先队列,运行时间好像多了一倍= = #in ...

- ajax jsonp跨域 【转】

跨域的基本原理: JSONP跨域GET请求是一个常用的解决方案, JSONP的最基本的原理是:动态添加一个<script>标签,而script标签的src属性是没有跨域的限制的 ...