Scala,Java,Python 3种语言编写Spark WordCount示例

首先,我先定义一个文件,hello.txt,里面的内容如下:

hello spark

hello hadoop

hello flink

hello storm

Scala方式

scala版本是2.11.8。

配置maven文件,三个依赖:

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.6.0-cdh5.7.0</version>

</dependency>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>2.11.8</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.11</artifactId>

<version>2.2.0</version>

</dependency>

package com.darrenchan.spark

import org.apache.spark.{SparkConf, SparkContext}

object SparkCoreApp2 {

def main(args: Array[String]): Unit = {

val sparkConf = new SparkConf().setMaster("local[2]").setAppName("WordCountApp")

val sc = new SparkContext(sparkConf)

//业务逻辑

val counts = sc.textFile("D:\\hello.txt").

flatMap(_.split(" ")).

map((_, 1)).

reduceByKey(_+_)

println(counts.collect().mkString("\n"))

sc.stop()

}

}

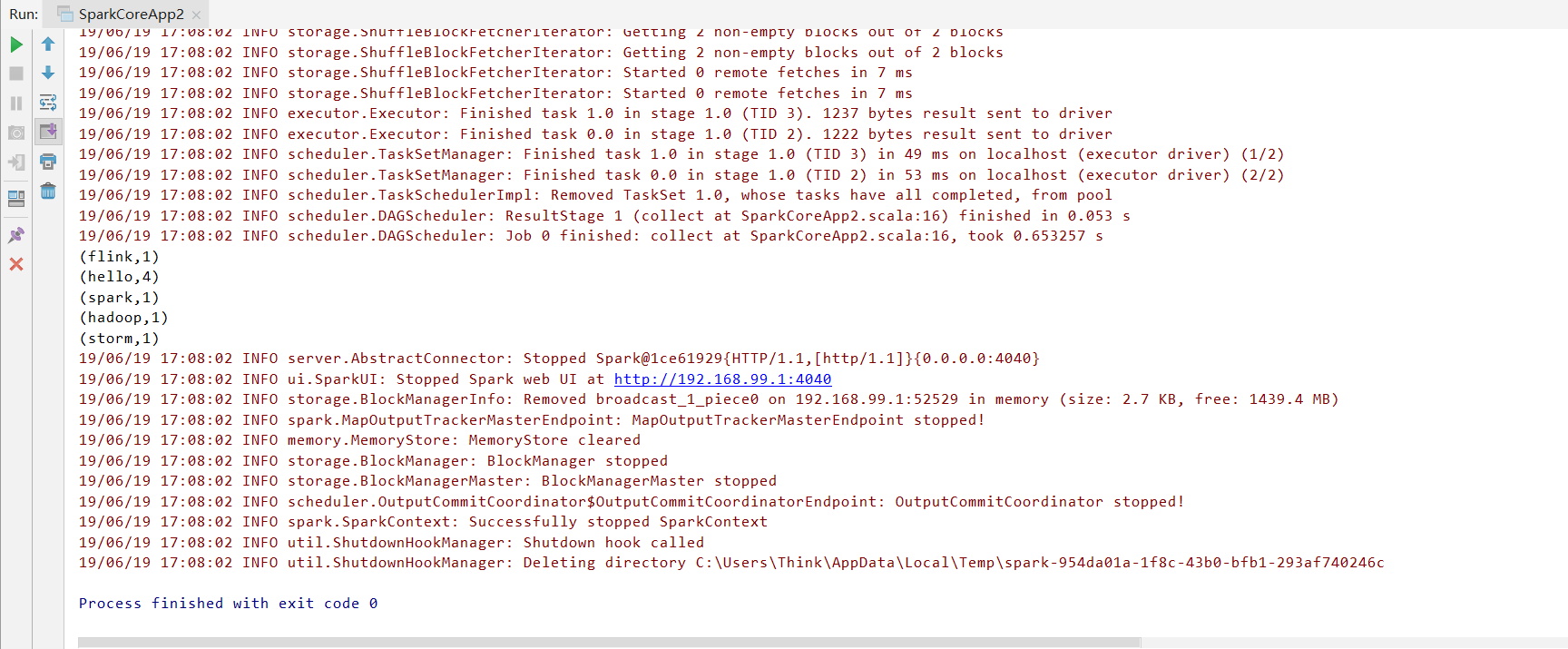

运行结果:

Java方式

Java8,用lamda表达式。

package com.darrenchan.spark.javaapi; import org.apache.spark.SparkConf;

import org.apache.spark.SparkContext;

import org.apache.spark.api.java.JavaPairRDD;

import org.apache.spark.api.java.JavaRDD;

import org.apache.spark.api.java.JavaSparkContext;

import org.apache.spark.sql.SparkSession;

import scala.Tuple2; import java.util.Arrays; public class WordCountApp2 {

public static void main(String[] args) {

SparkConf sparkConf = new SparkConf().setMaster("local[2]").setAppName("WordCountApp");

JavaSparkContext sc = new JavaSparkContext(sparkConf); //业务逻辑

JavaPairRDD<String, Integer> counts =

sc.textFile("D:\\hello.txt").

flatMap(line -> Arrays.asList(line.split(" ")).iterator()).

mapToPair(word -> new Tuple2<>(word, 1)).

reduceByKey((a, b) -> a + b); System.out.println(counts.collect()); sc.stop();

}

}

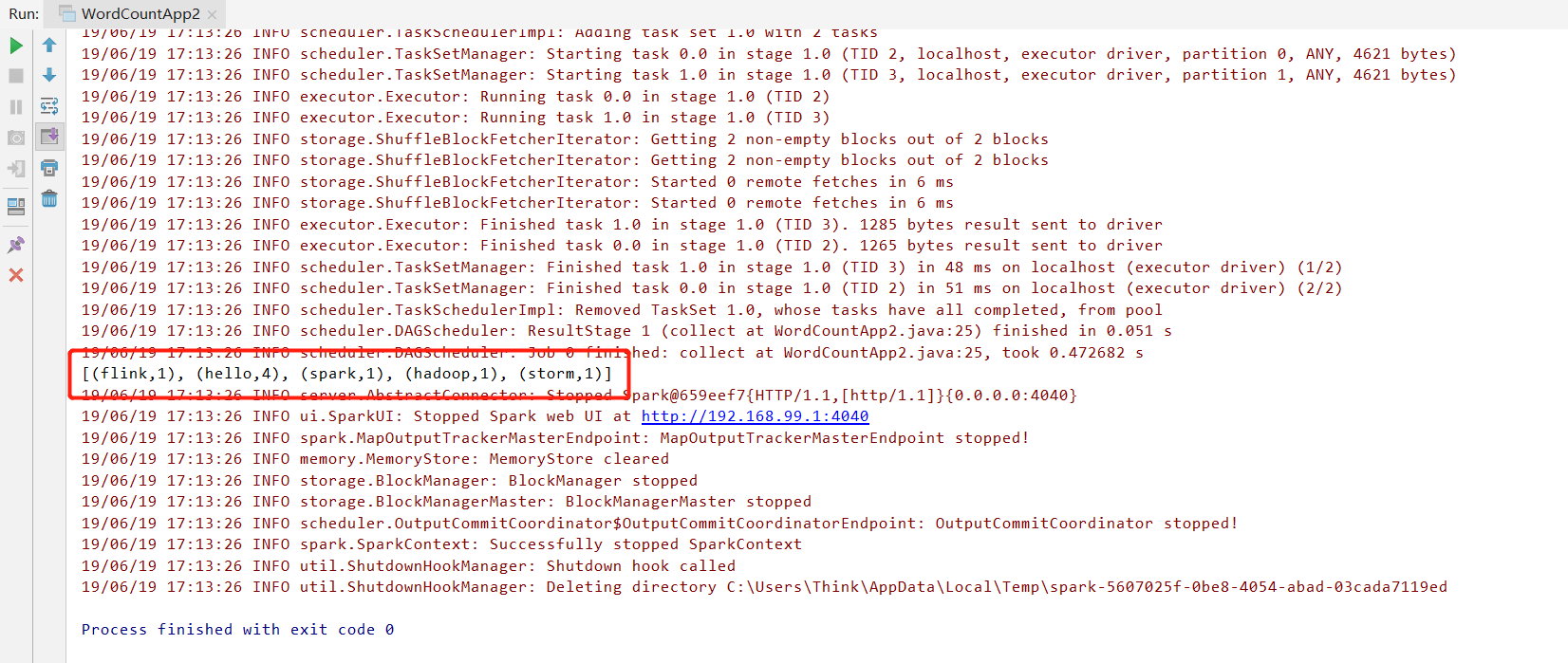

运行结果:

Python方式

Python 3.6.5。

from pyspark import SparkConf, SparkContext def main():

# 创建SparkConf,设置Spark相关的参数信息

conf = SparkConf().setMaster("local[2]").setAppName("spark_app")

# 创建SparkContext

sc = SparkContext(conf=conf) # 业务逻辑开发

counts = sc.textFile("D:\\hello.txt").\

flatMap(lambda line: line.split(" ")).\

map(lambda word: (word, 1)).\

reduceByKey(lambda a, b: a + b) print(counts.collect()) sc.stop() if __name__ == '__main__':

main()

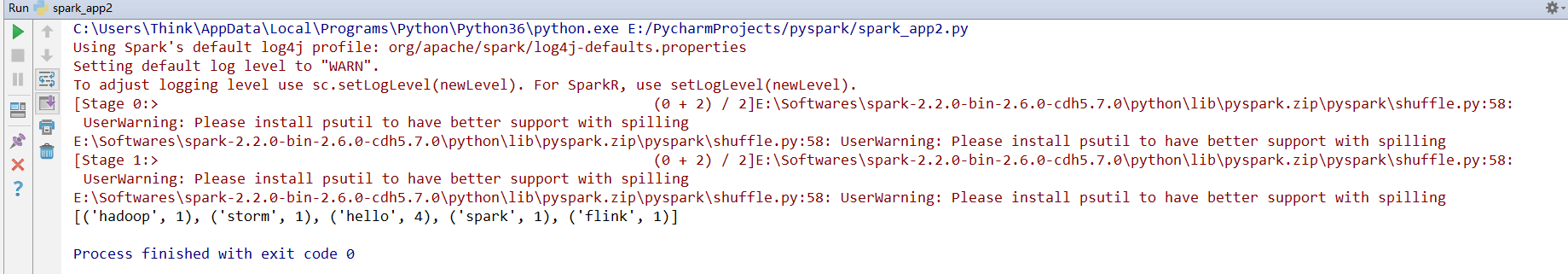

运行结果:

使用Python在Windows下运行Spark有很多坑,详见如下链接:

http://note.youdao.com/noteshare?id=aad06f5810f9463a94a2d42144279ea4

Scala,Java,Python 3种语言编写Spark WordCount示例的更多相关文章

- 插入算法分别从C,java,python三种语言进行书写

真正学懂计算机的人(不只是“编程匠”)都对数学有相当的造诣,既能用科学家的严谨思维来求证,也能用工程师的务实手段来解决问题——而这种思维和手段的最佳演绎就是“算法”. 作为一个初级编程人员或者说是一个 ...

- 梯度迭代树(GBDT)算法原理及Spark MLlib调用实例(Scala/Java/python)

梯度迭代树(GBDT)算法原理及Spark MLlib调用实例(Scala/Java/python) http://blog.csdn.net/liulingyuan6/article/details ...

- 近50种语言编写的“Hello, World”,你会几种?可不要贪杯哦~

本文转自公众号CSDN(ID:CSDNnews)作者:Sylvain Saurel,译者:风车云马

- 三种文本特征提取(TF-IDF/Word2Vec/CountVectorizer)及Spark MLlib调用实例(Scala/Java/python)

https://blog.csdn.net/liulingyuan6/article/details/53390949

- spark Using MLLib in Scala/Java/Python

Using MLLib in ScalaFollowing code snippets can be executed in spark-shell. Binary ClassificationThe ...

- 朴素贝叶斯算法原理及Spark MLlib实例(Scala/Java/Python)

朴素贝叶斯 算法介绍: 朴素贝叶斯法是基于贝叶斯定理与特征条件独立假设的分类方法. 朴素贝叶斯的思想基础是这样的:对于给出的待分类项,求解在此项出现的条件下各个类别出现的概率,在没有其它可用信息下,我 ...

- Spark机器学习1·编程入门(scala/java/python)

Spark安装目录 /Users/erichan/Garden/spark-1.4.0-bin-hadoop2.6 基本测试 ./bin/run-example org.apache.spark.ex ...

- idea配置scala编写spark wordcount程序

1.创建scala maven项目 选择骨架的时候为org.scala-tools.archetypes:scala-aechetype-simple 1.2 2.导入包,进入spark官网Docum ...

- Java用n种方法编写实现双色球随机摇号案例

方法清单 规则 实现方式一 实现方式二 实现方式三 实现方式四 实现方法五 之前我用JavaScript编写过一个实现双色球随机摇号的案例, 点击此处查看,今天我再用Java语言来实现这一效果. 规则 ...

随机推荐

- 【使用篇二】SpringBoot定时任务Scheduled(14)

在日常项目运行中,我们总会有需求在某一时间段周期性的执行某个动作.比如每天在某个时间段导出报表,或者每隔多久统计一次现在在线的用户量.在springboot中可以有很多方案去帮我们完成定时器的工作,有 ...

- JS获取url请求参数

JS获取url请求参数,代码如下: // 获取url请求参数 function getQueryParams() { var query = location.search.substring(1) ...

- vue路由传参和获取参数

参考链接 https://router.vuejs.org/zh/guide/essentials/passing-props.html#%E5%B8%83%E5%B0%94%E6%A8%A1%E5% ...

- Assign a Standard Image 设置图标

eXpressApp Framework (XAF) includes standard images embedded into the DevExpress.Images assembly. In ...

- MySQL中if的写法

关键词:IF --if 判断,如果 device_num 的值为1,则赋值为100,反之为200 SELECT district, shop_name, IF ( device_num , , ) A ...

- JS&Jquery基础之对象和数组以及类型转换

一.{ } 大括号,表示定义一个对象,大部分情况下要有成对的属性和值,或是函数. 如:var LangShen = {"Name":"Langshen",&qu ...

- postman---postman导出python脚本

前面一直写关于postman的一些文章,大家现在都应该简单了解,其实postman还有许多的功能,这个要大家一点点的挖掘出来了,安静在给大家分享一个关于postman导出python脚本 Postma ...

- NOIP 2012 文化之旅

洛谷 P1078 文化之旅 洛谷传送门 JDOJ 1788: [NOIP2012]文化之旅 T4 JDOJ传送门 Description Input Output Sample Input Input ...

- WPF 绑定属性 XAML 时间格式化

原文:WPF 绑定属性 XAML 时间格式化 XAML 时间格式化{Binding Birthday,StringFormat='yyyy-MM-dd '} public class AssetCla ...

- bzoj5092 分割序列

题目链接 problem 对于一个长度为n的非负整数序列\(b_1,b_2,...,b_n\),定义这个序列的能量为:\(f(b)=\max\limits_{i=0,1,...,n}(b_1 \oti ...