【现学现卖】python小爬虫

1.给小表弟汇总一个院校列表,想来想去可以写一个小爬虫爬下来方便些,所以就看了看怎么用python写,到了基本能用的程度,没有什么特别的技巧,大多都是百度搜的,遇事不决问百度啦

2.基本流程就是:

用request爬取一个页面之后用BeautifulSoup4对爬到的页面进行处理,

然后需要的东西进行预处理之后存到桌面上的.txt文件里,

之后再对.txt文件里的字符串进行分割,

最后把数据存到excel表里

3.准备:需要下载安装requests库,以及BeautifulSoup4的库,还有xlsxwriter库,相关安装方法网上一大堆

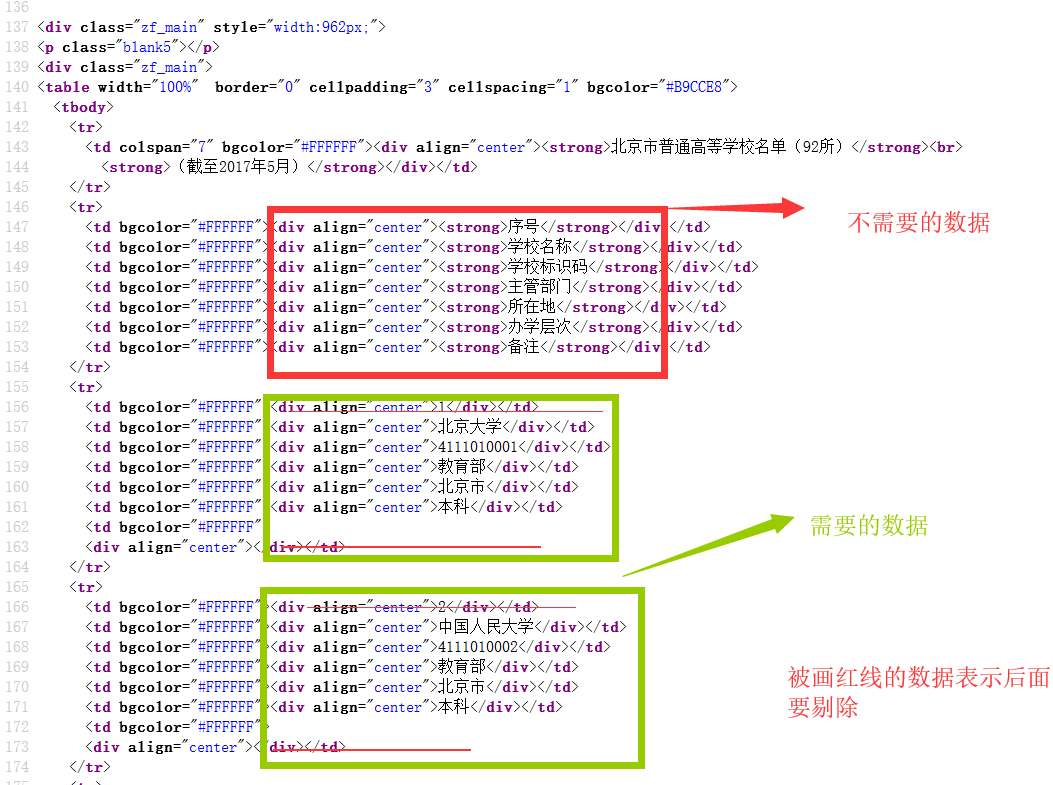

4.爬取页面的网页源代码:

5.将爬取的数据存到.txt文件中:

from bs4 import BeautifulSoup

import requests

import os def get_soup():

r = requests.get("http://www.eol.cn/html/g/gxmd/bj/", timeout=30)

# 判断网络链接的状态,连接错误将产生一个异常

#print(r.status_code)

r.encoding = r.apparent_encoding

soup = BeautifulSoup(r.text,features="html.parser")

return soup; #删除前几个元素

def del_previous_ele(full_list):

for i in range(8):

full_list.remove(full_list[0])

return full_list; #获取学校名称,学校编号,主管部门,办学层次

def select_school_ele(full_list):

school_list = []

for i in range(full_list.__len__()):

//这里是对获取的所有学校列表进行遍历,取出需要的数据

if (i % 7) == 1 or (i % 7) == 2 or (i % 7) == 3 or (i%7) == 5 :

school_list.append(full_list[i].string+"\t")

//获取到一个学校完整的信息之后就在后面换行

if (i%7) == 5:

school_list.append(" \n")

else:

pass return school_list;

#将数据写入文件

def createFile(txt):

file = open('C:\\Users\\XXXXXXXXXXXXXXX\\Desktop\\school.txt', 'w')

file.writelines(txt)

file.close();

print("写入成功") if __name__ == "__main__":

soup = get_soup()

full_list = del_previous_ele(soup.find_all(align="center"))

school_list = select_school_ele(full_list)

createFile(school_list)

6.对school.txt文件进行处理,处理完了存到excel文件里

import os

import xlsxwriter

def get_file(path,mode_):

list = "";

file = open(path,mode_)

list = file.read()

file.close() return list def write_excel(list):

workbook = xlsxwriter.Workbook("C:\\Users\\XXXXXXXXXXXXXXXXX\\Desktop\\school.xlsx")

worksheet = workbook.add_worksheet("school")

#5个属性为一组

list_5_item = list.split("\n")

# print(len(list_5_item))

for i in range(len(list_5_item)):

specific_school = list_5_item[i].split("\t")

print(len(specific_school))

for j in range(len(specific_school)):

worksheet.write( i , j , specific_school[j]) if __name__ == "__main__":

list = get_file('C:\\Users\\XXXXXXXXXXXXXXXXXXXXXXXXXXXx\\Desktop\\new.txt', 'r')

write_excel(list)

7.完成结果:

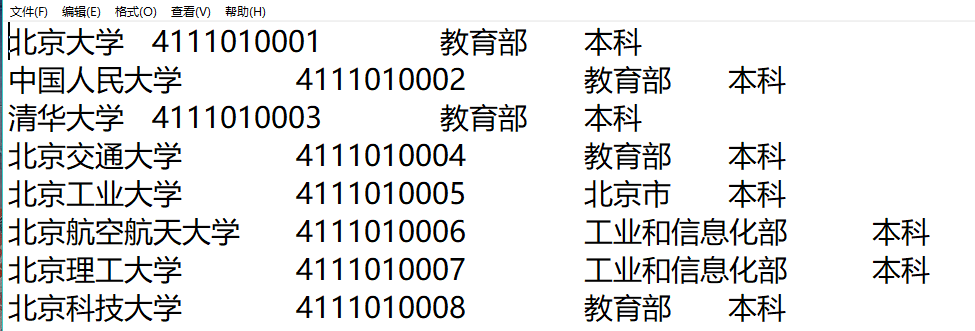

文本文件:

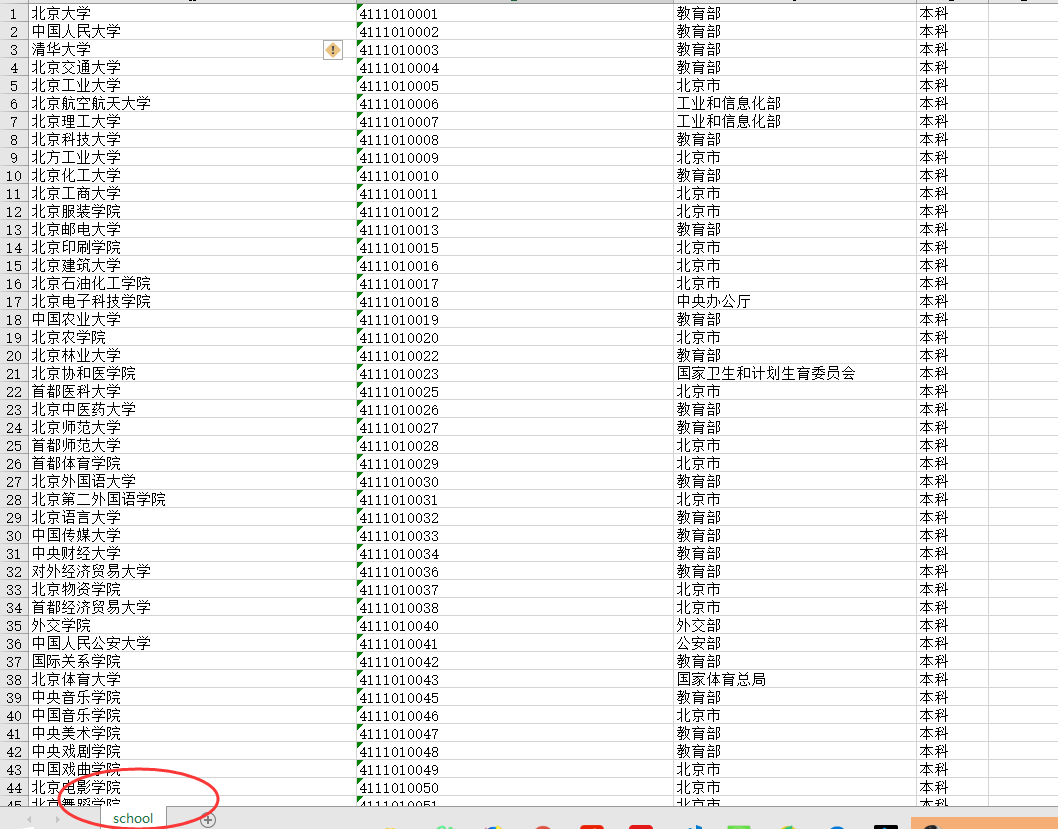

school.xlsx文件:

8.到这里就结束啦,因为刚接触写爬虫,所以有些地方难免写的不好,不喜勿喷啦

【现学现卖】python小爬虫的更多相关文章

- python小爬虫练手

一个人无聊,写了个小爬虫爬取不可描述图片.... 代码太短,就暂时先往这里贴一下做备份吧. 注:这是很严肃的技术研究,当然爬下来的图片我会带着批判性的眼光审查一遍的.... :) #! /usr/ ...

- Python爬虫:现学现用xpath爬取豆瓣音乐

爬虫的抓取方式有好几种,正则表达式,Lxml(xpath)与BeautifulSoup,我在网上查了一下资料,了解到三者之间的使用难度与性能 三种爬虫方式的对比. 这样一比较我我选择了Lxml(xpa ...

- 现学现卖】IntelliJ+EmmyLua 开发调试Unity中Xlua

http://blog.csdn.net/u010019717/article/details/77510066?ref=myread http://blog.csdn.NET/u010019717 ...

- 现学现卖——VS2013 C#测试

VS2013 C#测试 首先安装Unit Test Generator.方法为:工具->扩展和更新->联机->搜索“Unit Test Generator”,图标为装有蓝色液体的小试 ...

- 程序猿的日常——Mybatis现学现卖

最近有一个小项目需求,需要用spring mvc + mybatis实现一个复杂的配置系统.其中遇到了很多不太常见的问题,在这里特意记录下: 主要涉及的内容有 事务 多表删除 插入并返回主键 1 sp ...

- 现学现卖——Keil uVision 使用教程

Keil uVision 使用教程 1.如果有旧的工程在,先关闭旧工程.Project -> Close Project2.新建工程.Project -> New uVision Proj ...

- 【现学现卖】th:href标签动态路径设置,thymeleaf获取session中的属性值

update:2020-02-28:按道理来说这个功能在前后端分离的时候应该不怎么用的上,基本到现在我还是没遇到过有这样的需求,不过也是一种方法就是.th:href="@{/{role}/l ...

- Python 小爬虫流程总结

接触Python3一个月了,在此分享一下知识点,也算是温故而知新了. 接触python之前是做前端的.一直希望接触面能深一点.因工作需求开始学python,几乎做的都是爬虫..第一个demo就是爬取X ...

- Python小爬虫-自动下载三亿文库文档

新手学python,写了一个抓取网页后自动下载文档的脚本,和大家分享. 首先我们打开三亿文库下载栏目的网址,比如专业资料(IT/计算机/互联网)http://3y.uu456.com/bl-197?o ...

随机推荐

- asp.net mvc中的安全性

1.重复提交攻击:通过Bind特性指定要绑定和不绑定的值. 2.Cookie盗窃:阻止脚本对站点中Cookie的访问,webconfig文件中添加<HttpCookies domain=&quo ...

- [zebra源码]分片语句ShardPreparedStatement执行过程

主要过程包括: 分库分表的路由定位 sql语句的 ast 抽象语法树的解析 通过自定义 SQLASTVisitor (MySQLSelectASTVisitor) 遍历sql ast,解析出逻辑表名 ...

- CDN相关知识及CDN绕过

#什么是CDN? 内容分发网络(Content Delivery Network,简称CDN)是建立并覆盖在承载网之上,由分布在不同区域的边缘节点服务器群组成的分布式网络.CDN应用广泛,支持多种行业 ...

- 1.前言-聊聊Java这条路

一.解决大家的疑问 1.零基础学习编程? 有编程基础的比零基础的困难,毕竟有一些固定思维 目标:爱好.做网站.做游戏 2.英语不好能学吗? 程序并没有大家想象的那么多英语,天天都在用,慢慢就掌握了 3 ...

- C语言:位运算加密

数据加密解密是一个常用的功能,如果你不希望让别人看到文件中的内容,可以通过密钥(也称"密码")将文件的内容加密.比如文本文件(.txt),加密前的内容是能够读懂的,加密后的内容是& ...

- docker容器技术基础之linux cgroup、namespace

一.开头 接触过docker的同学多多少少听过这样一句话"docker容器通过linux namespace.cgroup特性实现资源的隔离与限制".今天我们来尝试学习一下这两个东 ...

- Python语言对Json对象进行新增替换操作

# Json字符串进行新增操作import jsonimport os# os.path.dirname(__file__):表示当前目录path = os.path.join(os.path.dir ...

- 关于maven打包与jdk版本的一些关系

最近让不同JAVA版本的容器maven打包折腾的不行,终于理出了一点头绪.在这里记录下备忘. 1. Maven与jdk版本的关系 先明确一个概念,关高版本JDK运行maven,是可以打出低版本的JAV ...

- koa踩坑记录

1.koa热更新用nodemon 2.koa中暂不支持import/export 3.只发送options请求,没有后续请求 当ctx.set('Access-Control-Allow-Cred ...

- mongodb使用场景及与mysql区别

MySQL是关系型数据库. 优势: 在不同的引擎上有不同 的存储方式. 查询语句是使用传统的sql语句,拥有较为成熟的体系,成熟度很高. 开源数据库的份额在不断增加,mysql的份额页在持续增长. 缺 ...