【爬虫】如何用python+selenium网页爬虫

一、前提

爬虫网页(只是演示,切勿频繁请求):https://www.kaola.com/

需要的知识:Python,selenium 库,PyQuery

参考网站:https://selenium-python-zh.readthedocs.io/en/latest/waits.html

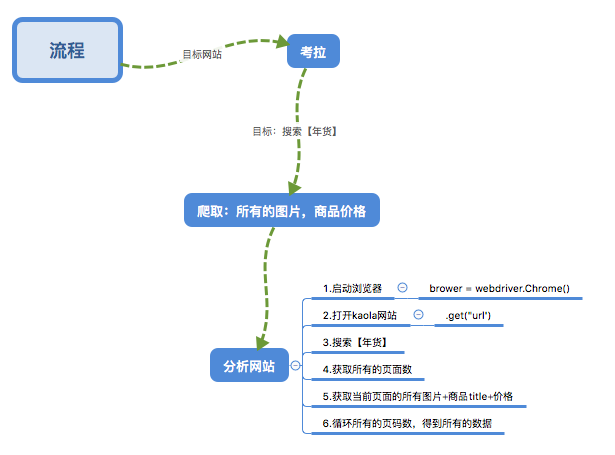

二、简单的分析下网站

三、步骤

1.目标:

1.open brower

2.open url

from selenium import webdriver

from selenium.common.exceptions import TimeoutException

from selenium.webdriver.common.by import By

import time

from selenium.webdriver.support.wait import WebDriverWait

from selenium.webdriver.support import expected_conditions as EC

from pyquery import PyQuery as py

brower = webdriver.Chrome() //定义一个brower ,声明webdriver,调用Chrome()方法

wait = WebDriverWait(brower,20) //设置一个全局等待时间

brower.get("https://www.kaola.com/")

2.搜索【年货】

def search():

try:

brower.get("https://www.kaola.com/")

//红包

close_windows = wait.until(

EC.presence_of_element_located((By.XPATH,'//div[@class="cntbox"]//div[@class="u-close"]'))

)

//输入框

input = wait.until(

EC.presence_of_element_located((By.CSS_SELECTOR,'#topSearchInput'))

)

//搜索

submit = wait.until(

EC.presence_of_element_located((By.XPATH,'//*[@id="topSearchBtn"]'))

)

close_windows.click()

input.send_keys('年货') time.sleep(2) submit.click()

//获取年货所有的页数

total = wait.until(

EC.presence_of_element_located((By.CSS_SELECTOR,'#resultwrap > div.splitPages > a:nth-child(11)'))

)

return total.text

except TimeoutException:

return 'error'

3.获取页面的信息

//使用pyQurey解析页面

def get_product():

wait.until(

EC.presence_of_element_located((By.XPATH,'//*[@id="result"]//li[@class="goods"]'))

)

html = brower.page_source

doc = py(html)

goods = doc('#result .goods .goodswrap')

for good in goods.items():

product = {

'image' : good.find('a').attr('href'),

'title':good.find('a').attr('title'),

'price':good.find('.price .cur').text()

}

print(product)

def main():

get_product()

brower.close

.....后续更新

【爬虫】如何用python+selenium网页爬虫的更多相关文章

- Python编写网页爬虫爬取oj上的代码信息

OJ升级,代码可能会丢失. 所以要事先备份. 一開始傻傻的复制粘贴, 后来实在不能忍, 得益于大潇的启示和聪神的原始代码, 网页爬虫走起! 已经有段时间没看Python, 这次网页爬虫的原始代码是 p ...

- Python动态网页爬虫-----动态网页真实地址破解原理

参考链接:Python动态网页爬虫-----动态网页真实地址破解原理

- Python 简单网页爬虫学习

#coding=utf-8 # 参考文章: # 1. python实现简单爬虫功能 # http://www.cnblogs.com/fnng/p/3576154.html # 2. Python 2 ...

- 【网络爬虫】【python】网络爬虫(五):scrapy爬虫初探——爬取网页及选择器

在上一篇文章的末尾,我们创建了一个scrapy框架的爬虫项目test,现在来运行下一个简单的爬虫,看看scrapy爬取的过程是怎样的. 一.爬虫类编写(spider.py) from scrapy.s ...

- 【网络爬虫】【python】网络爬虫(四):scrapy爬虫框架(架构、win/linux安装、文件结构)

scrapy框架的学习,目前个人觉得比较详尽的资料主要有两个: 1.官方教程文档.scrapy的github wiki: 2.一个很好的scrapy中文文档:http://scrapy-chs.rea ...

- Python静态网页爬虫相关知识

想要开发一个简单的Python爬虫案例,并在Python3以上的环境下运行,那么需要掌握哪些知识才能完成一个简单的Python爬虫呢? 爬虫的架构实现 爬虫包括调度器,管理器,解析器,下载器和输出器. ...

- Python学习---网页爬虫[下载图片]

爬虫学习--下载图片 1.主要用到了urllib和re库 2.利用urllib.urlopen()函数获得页面源代码 3.利用正则匹配图片类型,当然正则越准确,下载的越多 4.利用urllib.url ...

- Python简单网页爬虫——极客学院视频自动下载

http://blog.csdn.net/supercooly/article/details/51003921

- python静态网页爬虫之xpath(简单的博客更新提醒功能)

直接上代码: #!/usr/bin/env python3 #antuor:Alan #-*- coding: utf-8 -*- import requests from lxml import e ...

随机推荐

- C# 异常:索引超出了数组界限。

数组如果只取到了三个元素, 而引用数组的时候引用了五个, 就会有此错误.

- 苹果IOS下text-shadow与box-shadow失效的解决办法

加入以下样式,可以解决苹果IOS下text-shadow与box-shadow失效的问题 -webkit-appearance: none

- .NET--------枚举扩展方法(枚举转list,获取枚举描述)

/// <summary> /// get enum description by name /// </summary> /// <typeparam name=&qu ...

- Problem 9: Special Pythagorean triplet

flag = 0 for a in range(1,1000): for b in range(a+1,1000): if a*a + b*b == (1000-a-b)**2: print(a,b) ...

- 最近在研究syslog日志,就说一下syslog格式吧

syslog格式:<PRI>HEADER MESSAGE syslog的消息长度:不超过1024.syslog格式举例:<15>Jul 10 12:00:00 192.168. ...

- 预先封装数据的思路.md

预先封装数据的思路.md python3 最近有两位同学开发开发了用程序在线竞猜数字的小游戏,可以通过以下两个网址去玩: bbaa的游戏 http://bbaass.tk/math/ codetige ...

- php 多维数组 array sort 排序 :array_multisort

1.参考链接: php简单实现多维数组排序的方法 参考二: 这个链接很好,可以直接看这个:PHP array_multisort—对多个数组或多维数组进行排序 2.案例一: //13: 最佳: pub ...

- NHibernate4使用Oracle.ManagedDataAccess.dll连接oracle及配置多个数据库连接

NHibernate数据库配置参数在hibernate.cfg.xml中 <?xml version="1.0" encoding="utf-8"?> ...

- 网络-Cisco

选择题(每题2分,共20分) 1.192.168.11.1/23的网络地址是( A) A.192.168.10.0 B.192.168.11.0 C.192.168.10.255 D.192.168 ...

- linux 常见技巧

1.# :表示权限用户(如:root) $:表示普通用户 开机提示:login:输入用户名 password:输入口令 用户是系统注册用户成功登陆后, 可以进入相应的用户环境. 退出当前shell,输 ...